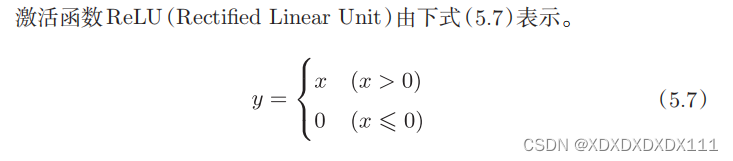

一、ReLU激活函数的介绍

ReLU函数的定义如下:对于输入x,如果x大于等于0,则输出为x本身;如果x小于0,则输出为0。可以表示为 ReLU(x) = max(0, x)。

二、ReLU激活函数的的作用

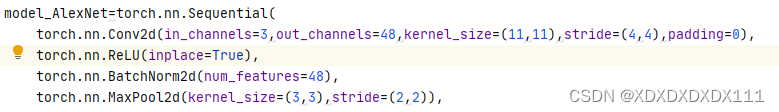

torch.nn.ReLU(inplace=True)是PyTorch中的一个激活函数,其功能是对输入进行逐元素的非线性变换。

当参数inplace=True表示将变换后的结果直接覆盖原来的输入张量,节省内存空间。如果没有指定inplace=True,则会返回一个新的张量作为输出。

通过应用torch.nn.ReLU(inplace=True),可以实现将负值部分截断为0的操作,从而增强神经网络的非线性特性,并且可以帮助网络更好地学习特征。

三、ReLU激活函数的举例用法

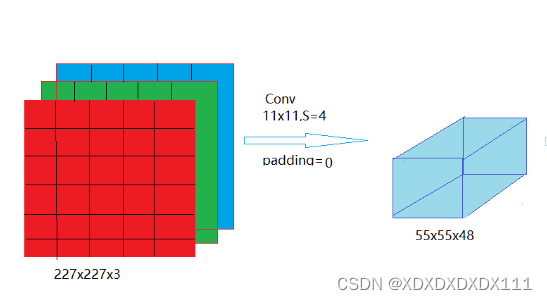

AlexNet网络结构中的第一层卷积为例:

其输入的图像大小为:227x227x3的图像

filter:11x11x48,stride=4,padding=0

output_size=(input_size+2xpadding-kernel_size)/stride+1=(227+2x0-11)/4+1=55

输出:55x55x48

激活函数:ReLU

本文介绍了ReLU激活函数的定义、在PyTorch中的使用(包括inplace选项),以及如何在AlexNet网络中应用,重点强调了其增强非线性特性和内存优化的作用。

本文介绍了ReLU激活函数的定义、在PyTorch中的使用(包括inplace选项),以及如何在AlexNet网络中应用,重点强调了其增强非线性特性和内存优化的作用。

1577

1577

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?