简介

提出了RetroMAE算法,算法有三个主要的设计:

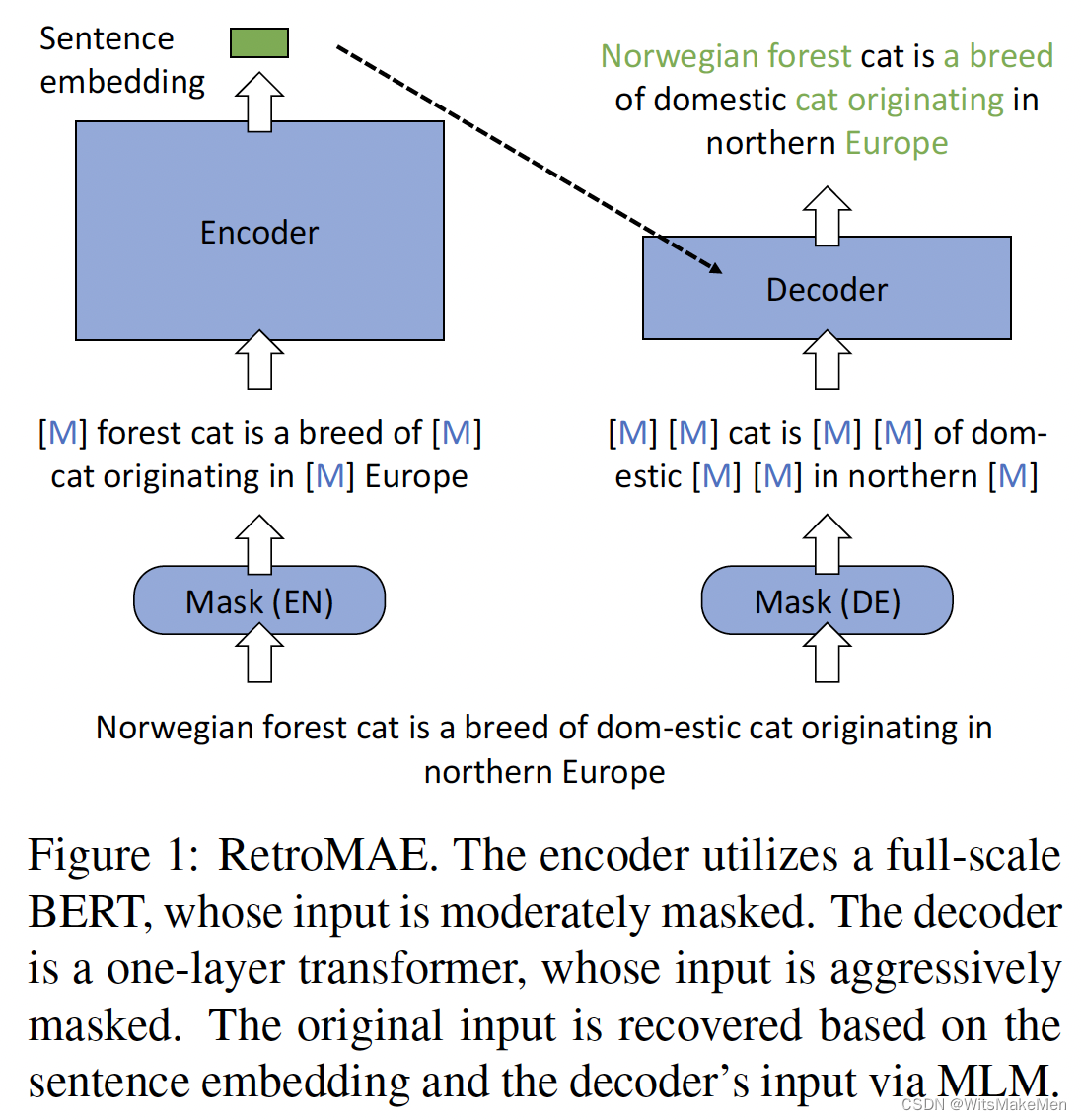

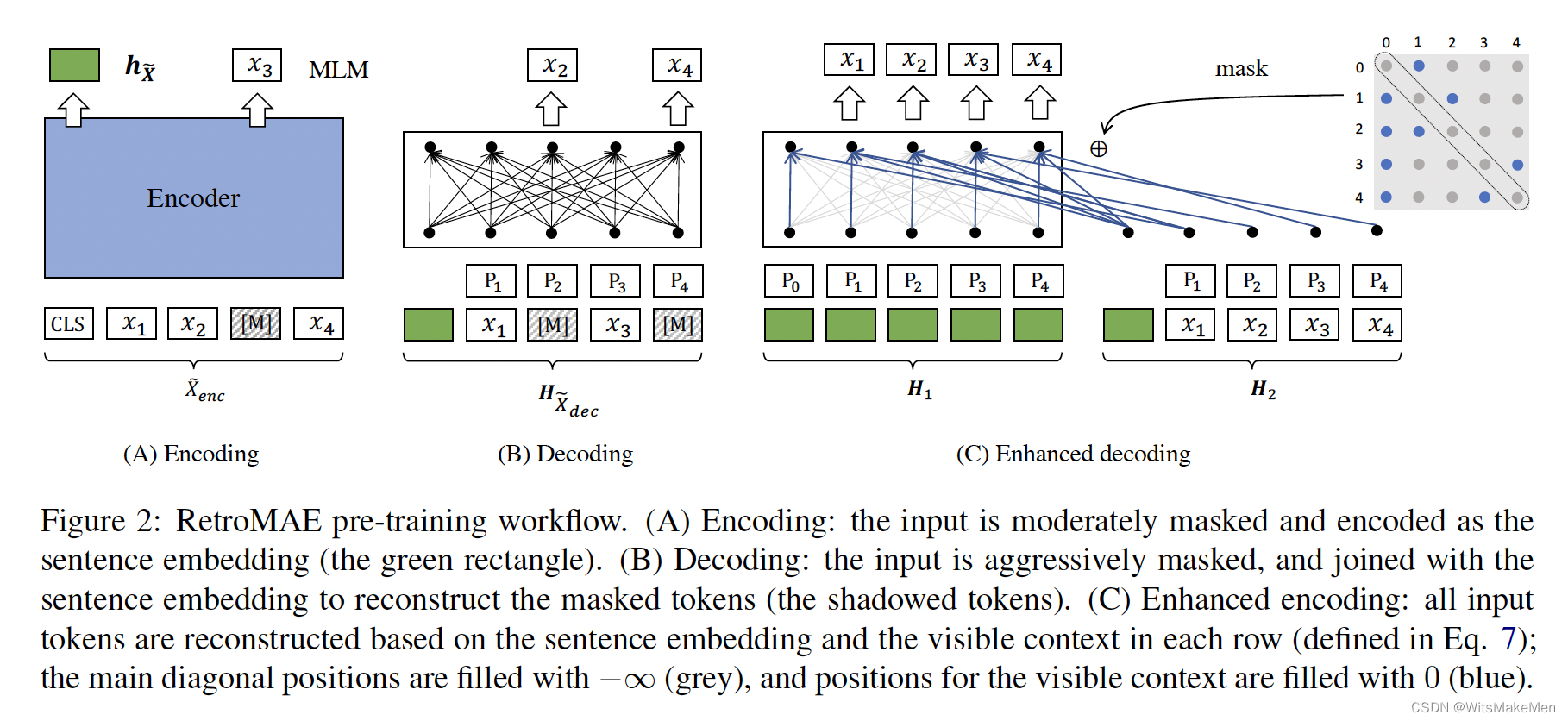

1.A novel MAE workflow一种全新的MAE预训练方法,输入数据会被masked处理两次,一个masked数据用于encoder,另一个会被用于decoder。encoder用来对sentence进行embedding编码,decoder根据编码后的句子隐向量和masked输入,还原句子。

2.Asymmetric structure一种非对称的模型结构,encoder是一个完全的bert结构,decoder是单层的transformer decoder结构,decoder用于还原原始句子。

3.Asymmetric masking ratios非对称的masked输入,encoder masked比例是15~30%,decoder masked比例是50 ~ 70%。

原理实现

整体采用encoder-decoder模型结构,encoder后的句子隐向量h是最终产出的结果,decoder部分功能是为了更好的还原句子,从而更好的学习句子隐向量h。

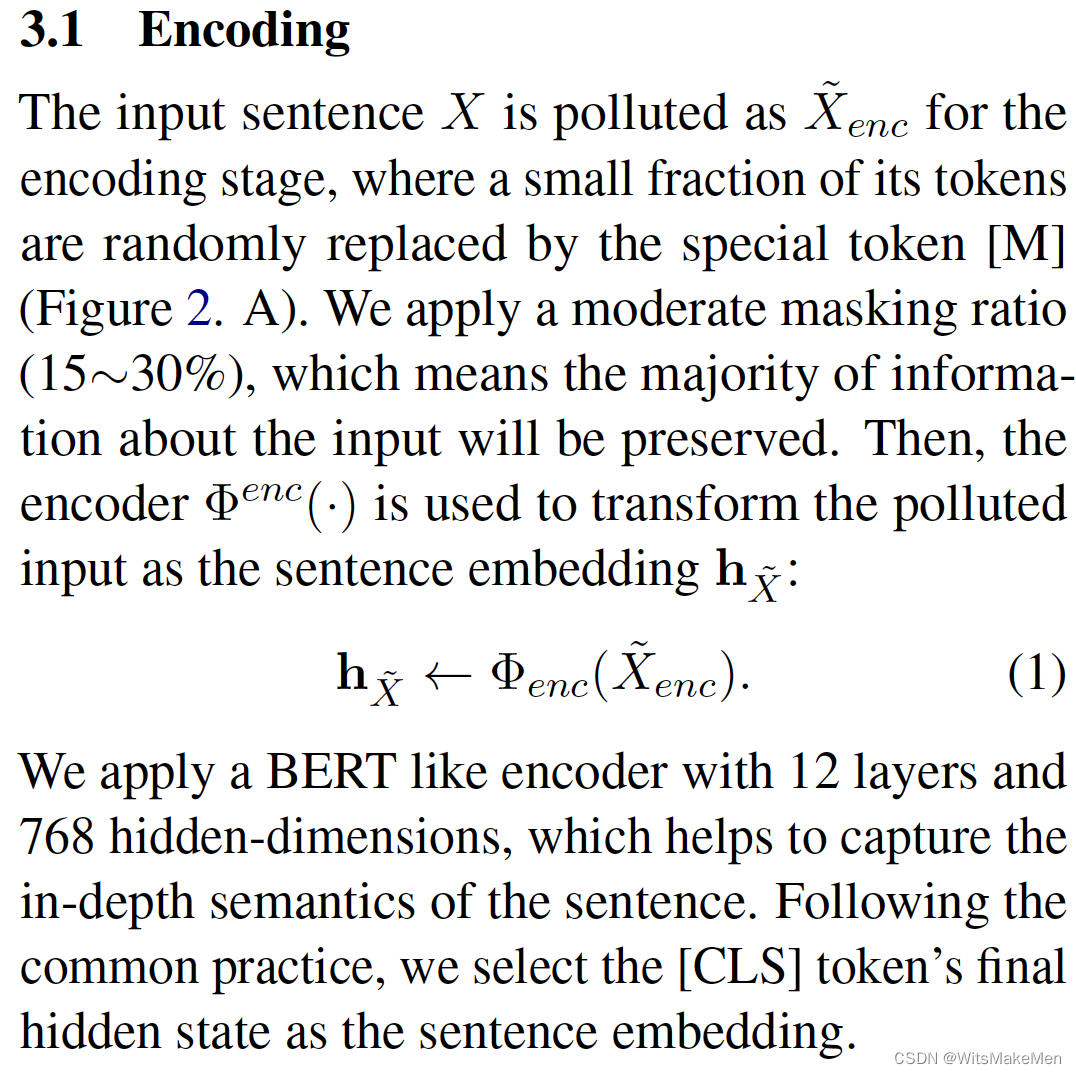

Encoding编码器

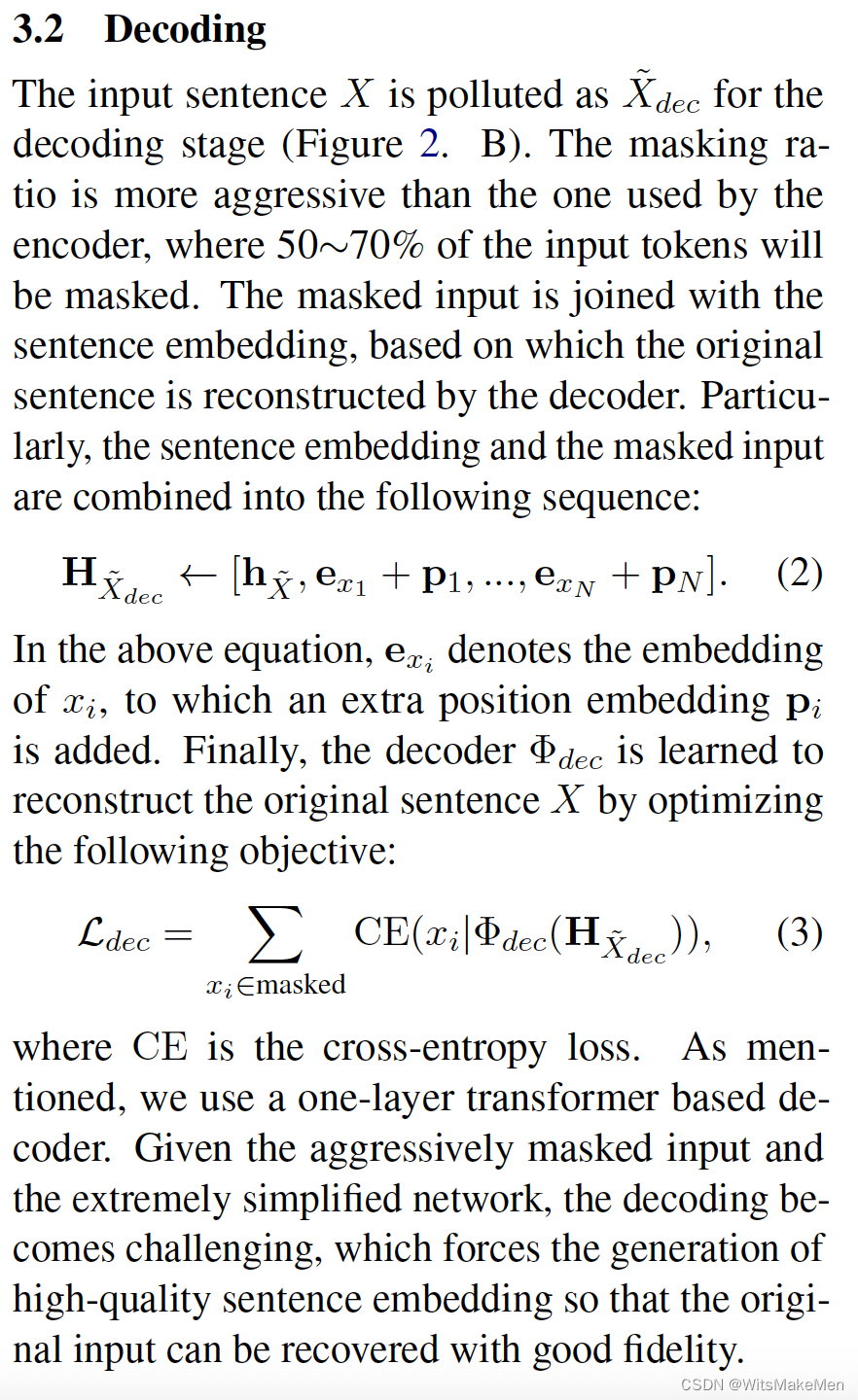

Decoding解码器

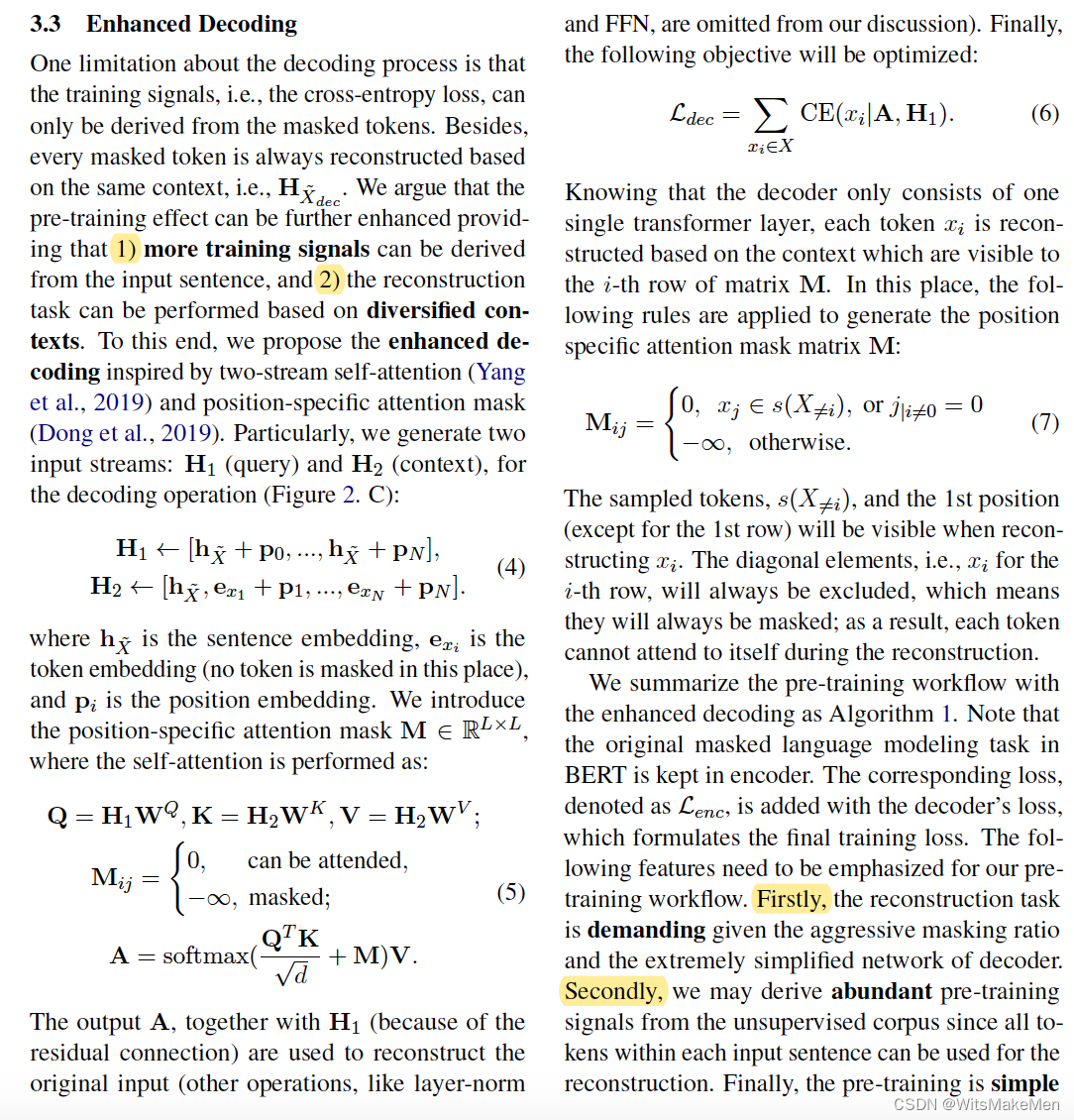

Enhanced Decoding

1280

1280

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?