目录

Tensorflow基本概念

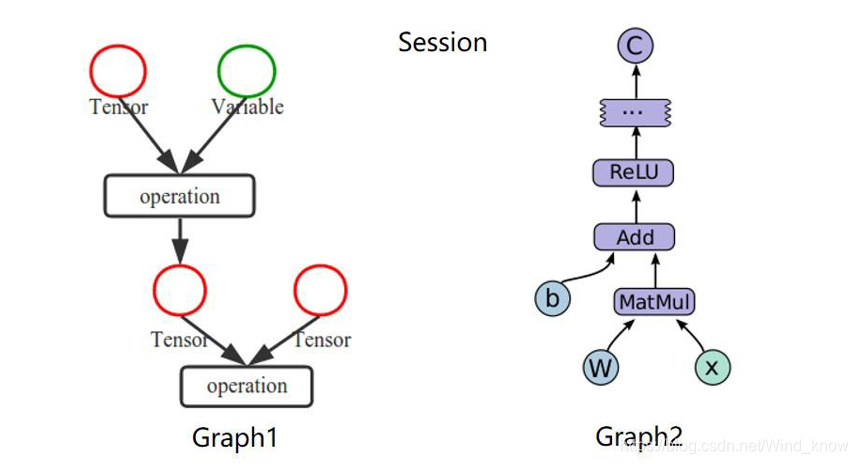

- 使用图(graphs)来表示计算任务

- 在被称之为会话(Session)的上下文(context)中执行图

- 使用tensor表示数据

- 通过变量(Variable)维护状态

- 使用feed和fetch可以为任意的操作赋值或者从其中获取数据

Tensorflow是一个编程系统,使用图(graphs)来表示计算任务,图(graphs)中的节点称之为op(operation),一个op获得0个或多个Tensor,执行计算,产生0个或多个Tensor。Tensor 看作是一个 n 维的数组或列表。图必须在会话(Session)里被启动。

导包

import tensorflow as tf创建常量

#创建一个常量op

m1=tf.constant([[3,3]])

#创建一个常量op

m2=tf.constant([[2],[3]])

m1

m2![]()

![]()

#创建一个矩阵乘法的op,把m1和m2

product=tf.matmul(m1,m2)

print(product)#这里可以看出 ,没有结果![]()

这里可以看出 ,没有输出结果,因为在TensorFlow中,op要在会话中执行。

创建会话

#定义一个会话,启动默认的图

sess=tf.Session()

#调用sess的run方法来执行矩阵乘法op run(product)触发了图中3个op

result=sess.run(product)

print(result)

sess.close()#关闭会话![]()

常用简单方法

#简单方法定义会话 不需要执行close()命令

with tf.Session() as sess:

#调用sess的run方法来执行矩阵乘法op run(product)触发了图中3个op

result=sess.run(product)

print(result)![]()

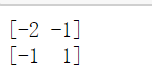

变量

x=tf.Variable([1,2])

a=tf.constant([3,3])

#增加一个减法op

sub=tf.subtract(x,a)

#增加一个加法op

add=tf.add(x,sub)

#变量需要初始化

init=tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

print(sess.run(sub))

print(sess.run(add))

state=tf.Variable(0,name='counter')

#创建一个op,作用是使state加1

new_value=tf.add(state,1)

#把后面的值赋值给前面的值

update=tf.assign(state,new_value)

#变量初始化

init=tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

print(sess.run(state))

for _ in range(5):

sess.run(update)

print(sess.run(state))

Fetch

#在会话里面执行多个op,然后得到它的结果

input1=tf.constant(3.0)

input2=tf.constant(2.0)

input3=tf.constant(5.0)

add=tf.add(input2,input3)

mul=tf.multiply(input1,add)

with tf.Session() as sess:

result=sess.run([mul,add])

print(result)

![]()

Feed

#Feed

#创建占位符

input1=tf.placeholder(tf.float32)

input2=tf.placeholder(tf.float32)

output=tf.multiply(input1,input2)

with tf.Session() as sess:

#feed的数据以字典的形式传入

print(sess.run(output,feed_dict={input1:[7.],input2:[2.]}))![]()

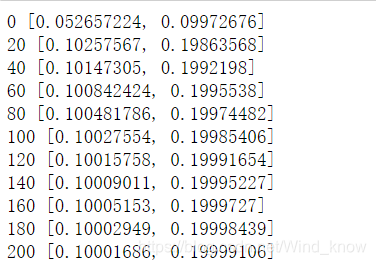

Tensorflow简单示例

#使用numpy生成100个随机点

x_data=np.random.rand(100)

y_data=x_data*0.1+0.2#真实值

#构造一个线性模型

b=tf.Variable(0.)

k=tf.Variable(0.)

y=k*x_data+b

#优化k,b,使得得到的直线接近上面的直线

#二次代价函数,y_data-y:误差=预测值-真实值,square:平方,tf.reduce_mean:求平均值

loss=tf.reduce_mean(tf.square(y_data-y))

#定义一个梯度下降法来进行训练的优化器

optimizer=tf.train.GradientDescentOptimizer(0.2)#0.2学习率

#最小化代价函数

train=optimizer.minimize(loss)

#初始化变量

init=tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

for step in range(201):

sess.run(train)

if step%20==0:

print(step,sess.run([k,b]))

本文详细介绍了TensorFlow的基本概念,包括图(graphs)、会话(Session)、tensor、变量(Variable)等,并通过实例演示了如何创建常量、变量、执行矩阵运算、使用feed和fetch。同时,还提供了一个简单的线性模型示例,展示了如何使用TensorFlow进行训练。

本文详细介绍了TensorFlow的基本概念,包括图(graphs)、会话(Session)、tensor、变量(Variable)等,并通过实例演示了如何创建常量、变量、执行矩阵运算、使用feed和fetch。同时,还提供了一个简单的线性模型示例,展示了如何使用TensorFlow进行训练。

1347

1347

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?