深度学习入门笔记手稿(十一)Momentum,RMS,Adam梯度下降法

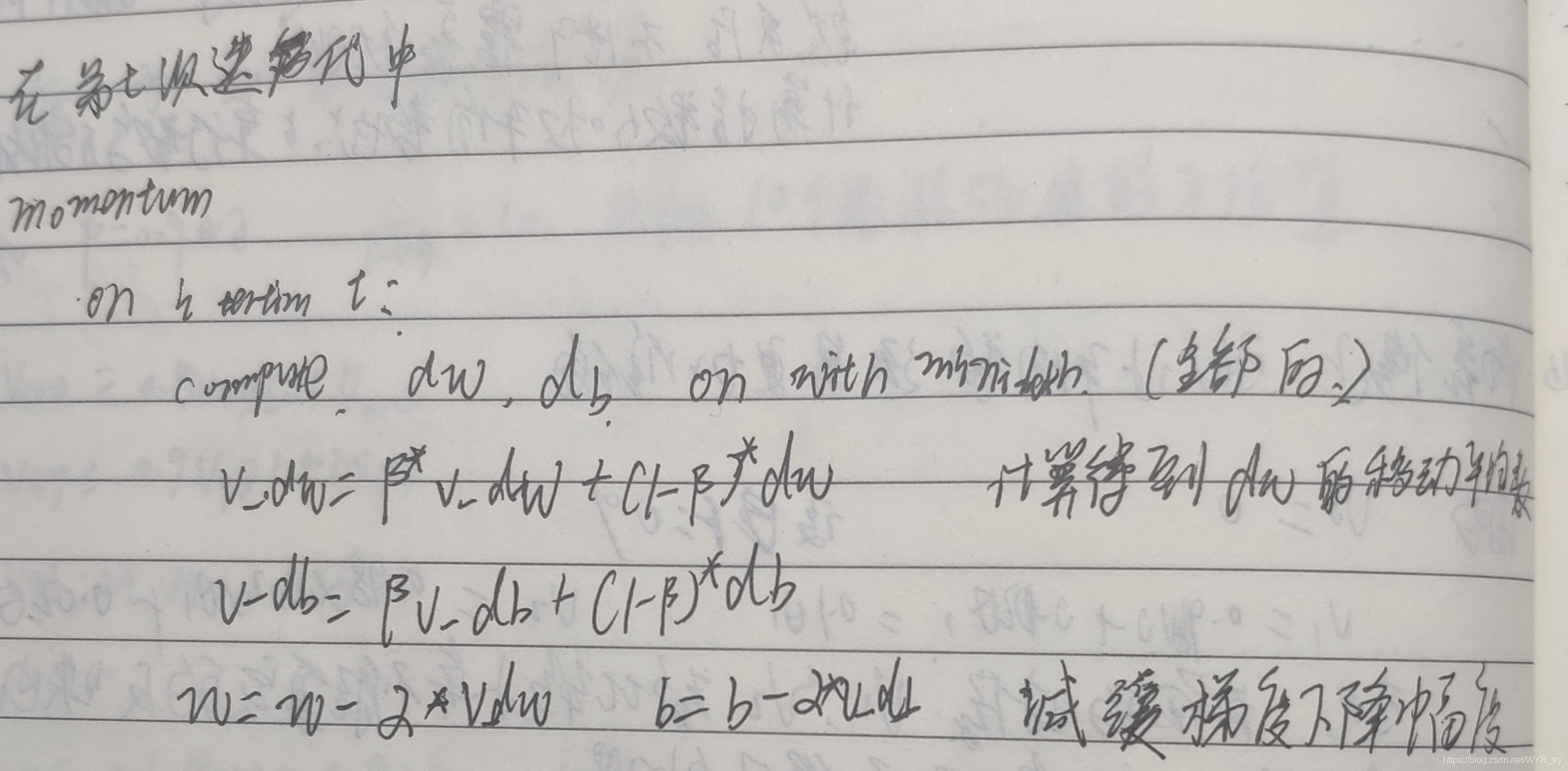

Momentum梯度下降法

运行速度快于标准梯度下降算法

基本思路: 计算梯度的指数加权平均数,利用该梯度更新你的权重

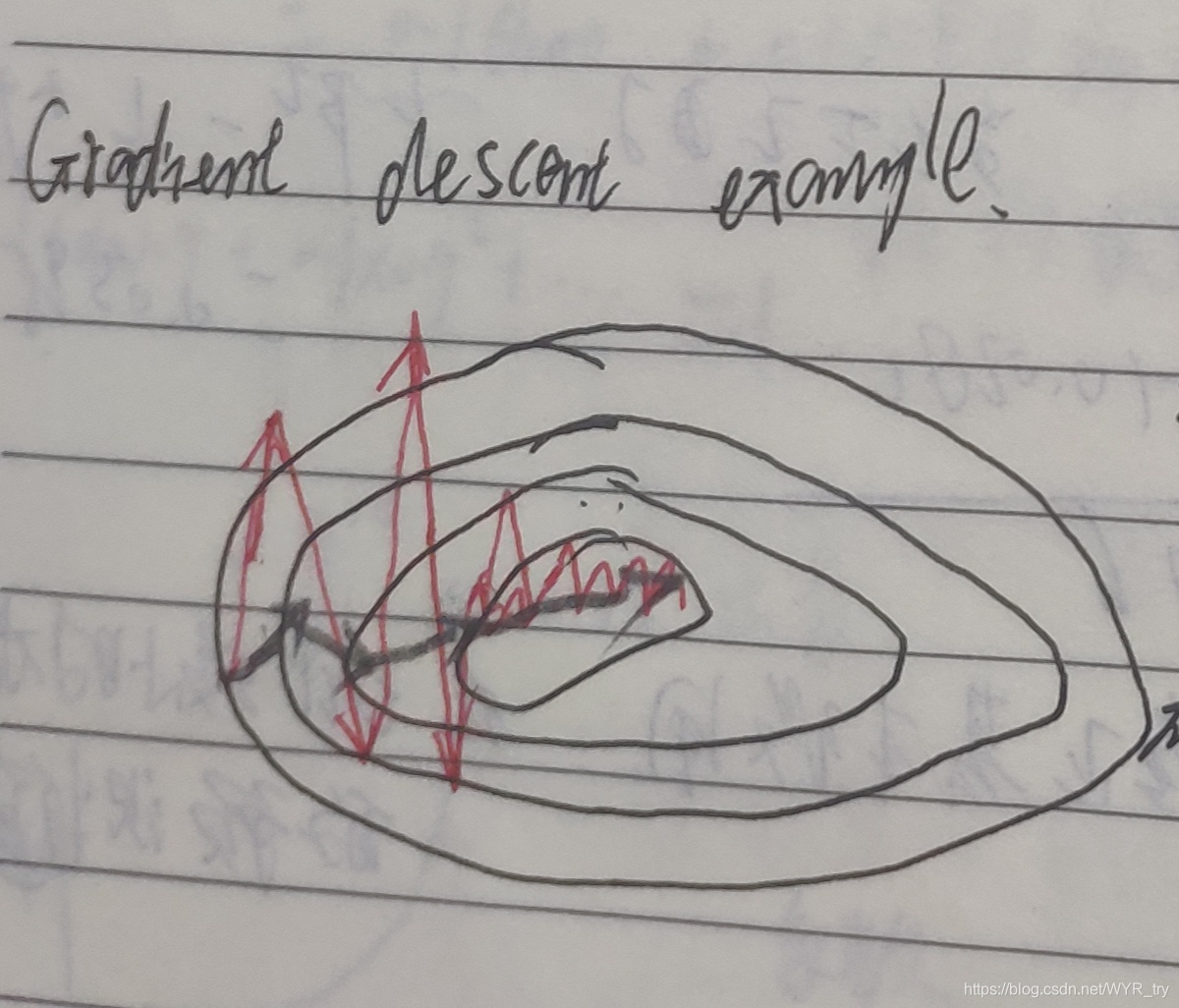

红线为batch梯度下降法的梯度下降情况,同momentum梯度下降法可以让梯度在纵向上更平缓,更直接,因为加权平均指数更平缓如铅笔图

上面再两个超参数学习率和加权指数平均的超参数B,后者最常用的值为0.9

B控制指数加权平均数,关于偏差修正 Vdw/1-Bt 一般不这么做。因为10次迭代过后,就过了初始阶段。

实际中使用梯度下降或momentum时,不糊受到偏差修正的困扰。

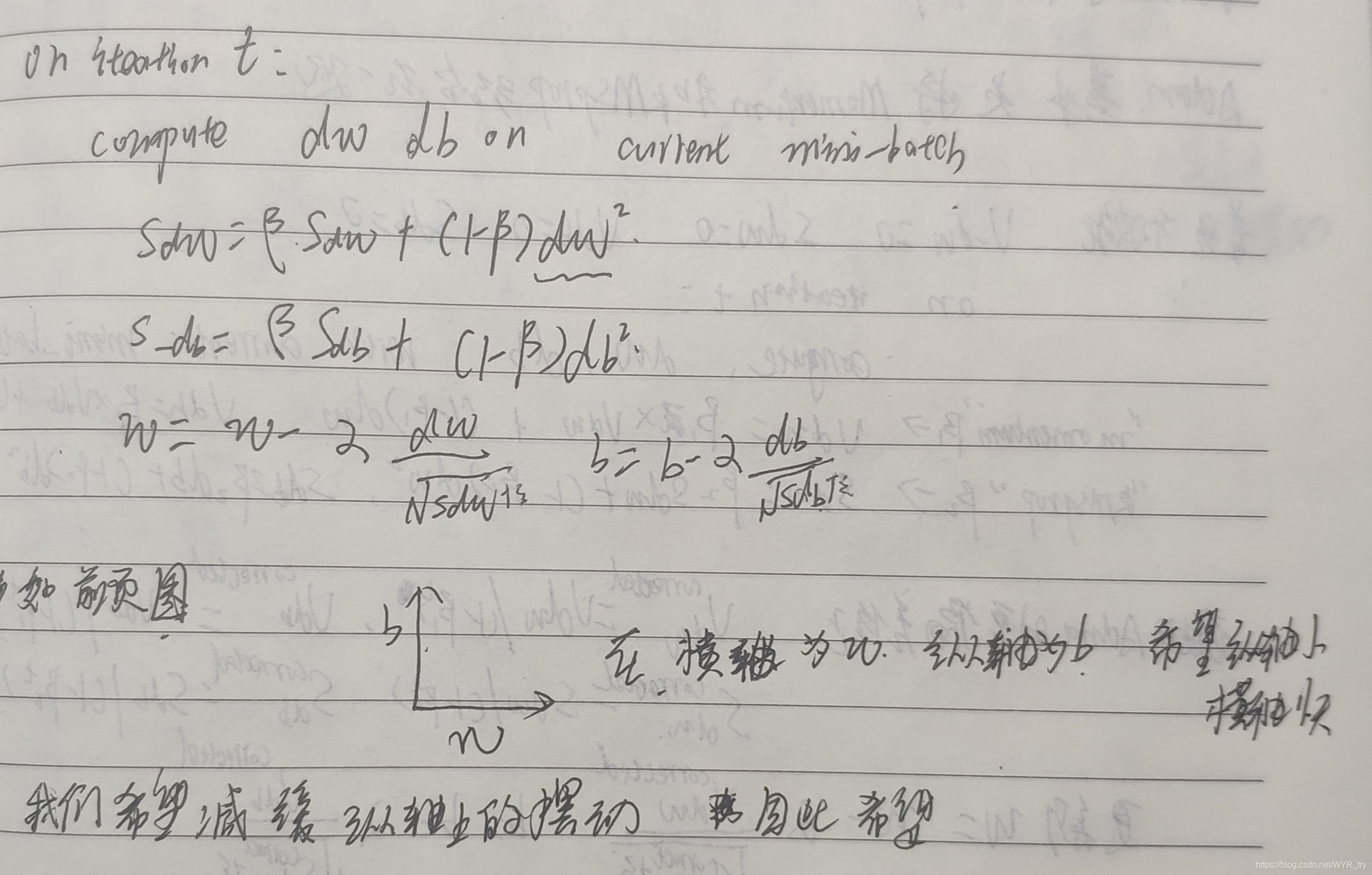

RMSprop

全称为 root mean square prop算法

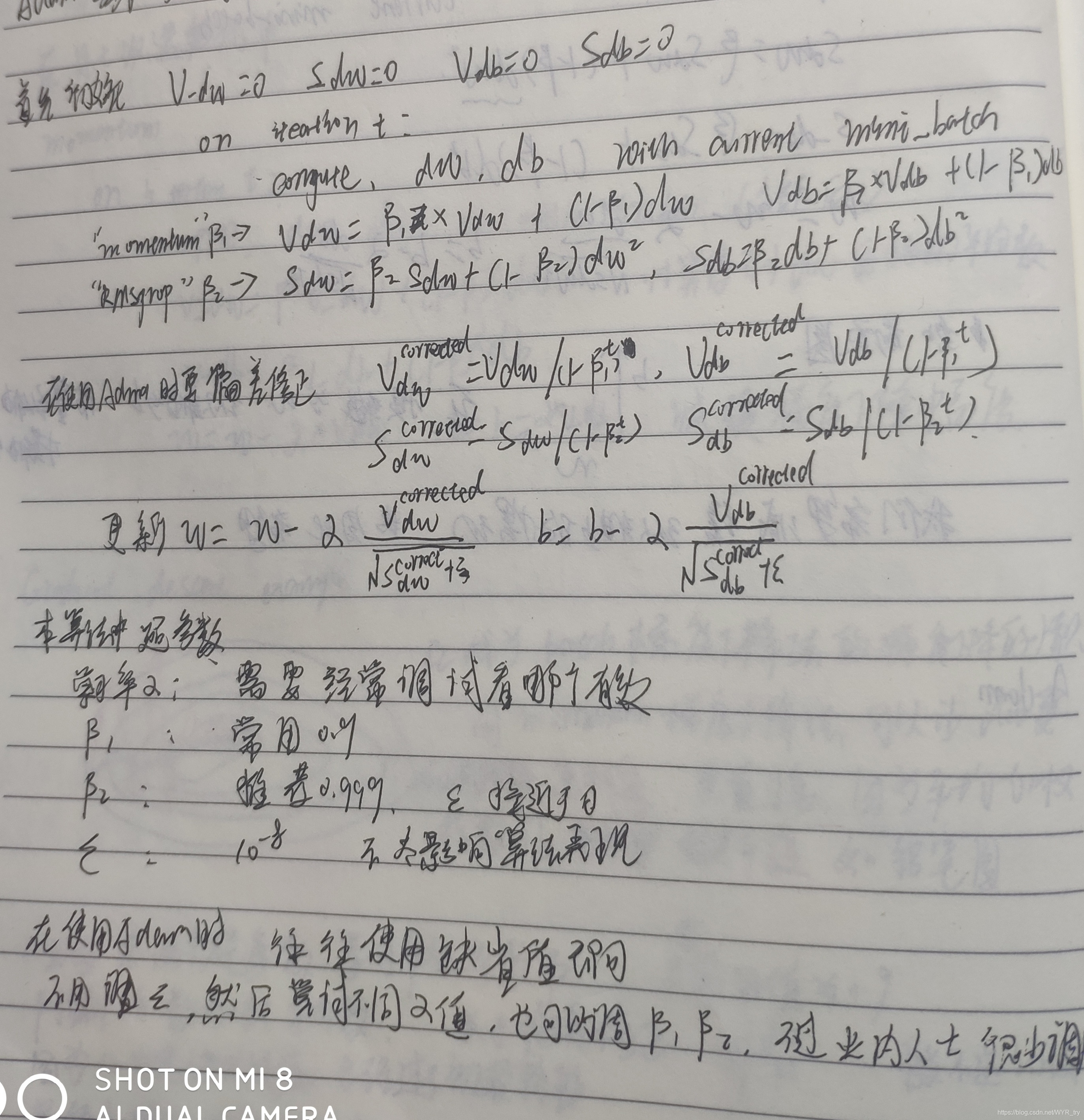

Adam

事实证明RMSprop以及Adam优化算法适用于不同的深度学习结构

Adam基本是将Momentum和RMSprop结合在一起

在使用Adam时要偏差修正

本文深入探讨了深度学习中的优化算法,包括Momentum梯度下降法、RMSprop及Adam算法。介绍了Momentum如何通过计算梯度的指数加权平均数来提升训练速度,RMSprop如何解决梯度消失问题,以及Adam如何结合两者优势进行高效优化。

本文深入探讨了深度学习中的优化算法,包括Momentum梯度下降法、RMSprop及Adam算法。介绍了Momentum如何通过计算梯度的指数加权平均数来提升训练速度,RMSprop如何解决梯度消失问题,以及Adam如何结合两者优势进行高效优化。

668

668

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?