目前只是了解了一个结构框架,争取明天用自己的语言描述一下RNN的算法框架......

理解RNN算法框架

理解RNN算法框架

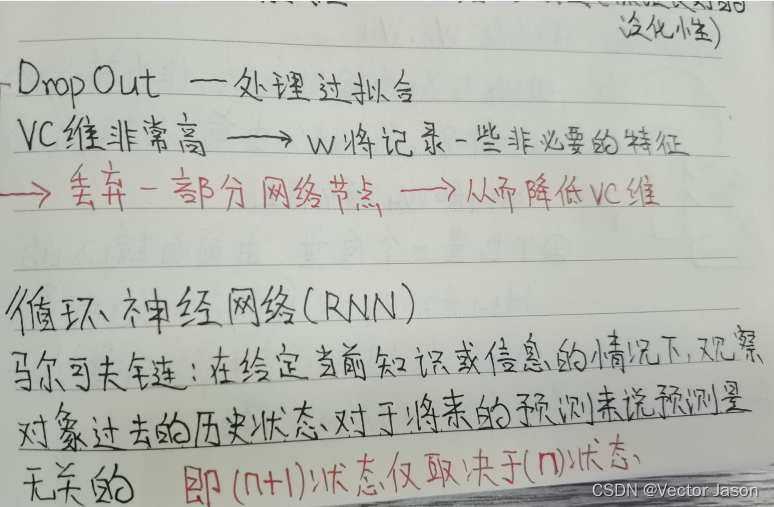

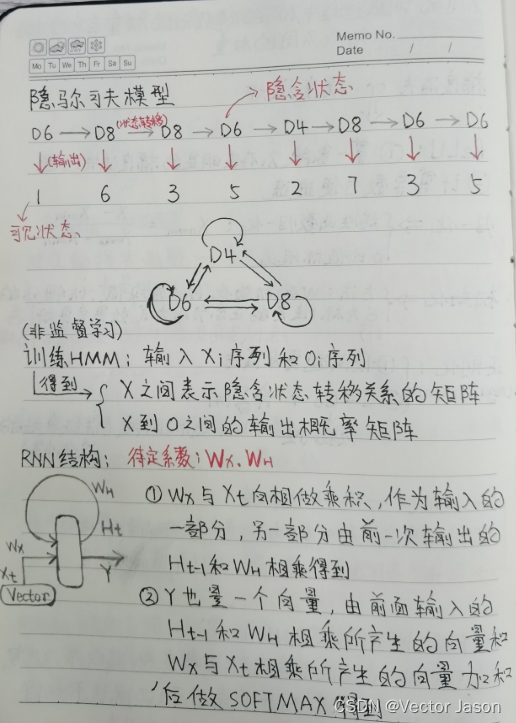

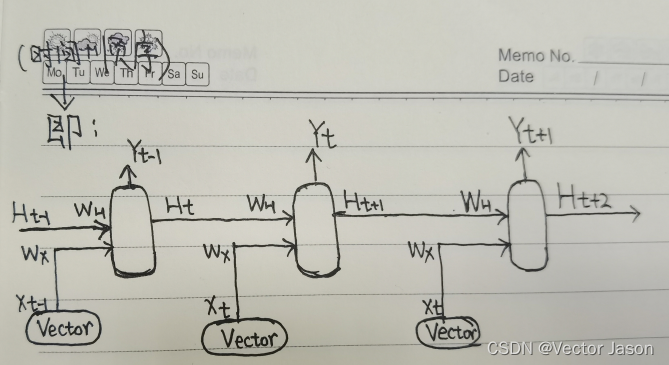

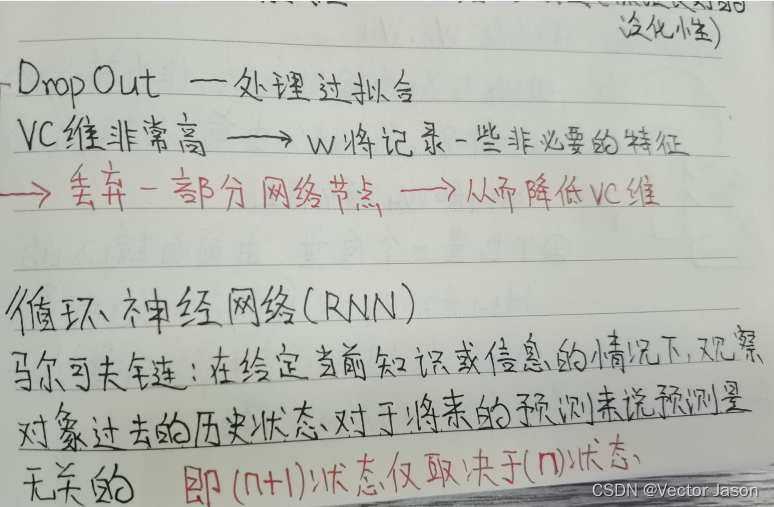

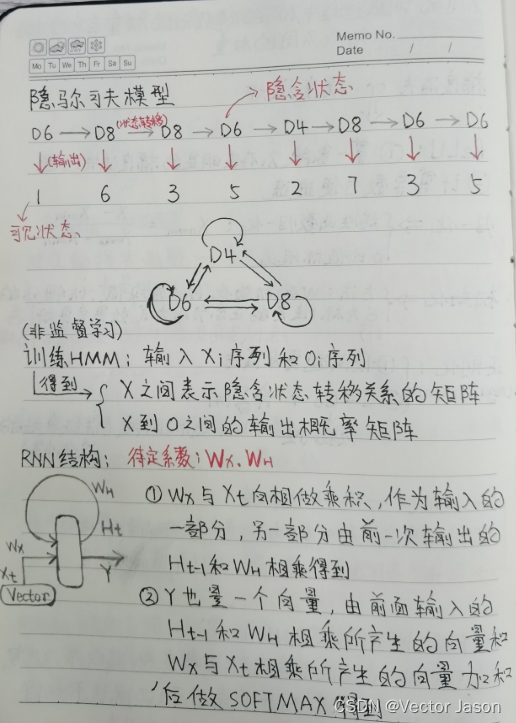

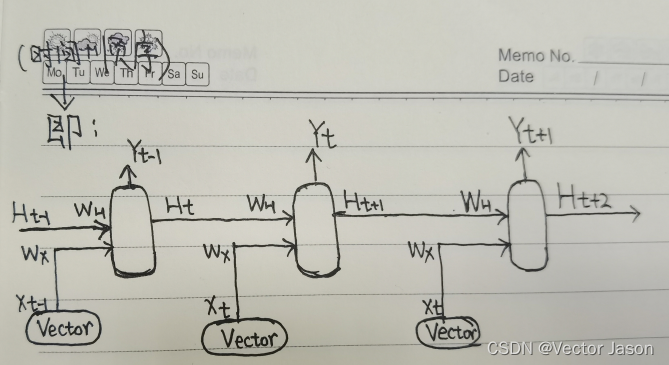

博主计划明日详细阐述RNN(循环神经网络)的算法结构,目前仅掌握了基本框架。此博主要探讨RNN如何处理序列数据及其在自然语言处理中的应用。

博主计划明日详细阐述RNN(循环神经网络)的算法结构,目前仅掌握了基本框架。此博主要探讨RNN如何处理序列数据及其在自然语言处理中的应用。

目前只是了解了一个结构框架,争取明天用自己的语言描述一下RNN的算法框架......

455

455

860

860

173

173

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?