还在为不会画画却想拥有二次元形象而烦恼?本文为你带来Stable Diffusion真人转动漫的保姆级教程,从参数设置到ControlNet配置,一步步教你生成完美的二次元形象。无需复杂操作,跟着做就能出效果!本教程适合想要快速将真人照片转为动漫风格的小白用户,所有参数均已经过验证与优化,直接复制即可使用!废话不多说,我们直接开始!

大模型选择这里我用的是“niji-动漫二次元加强版_2.0”,大家也可以尝试其他热门动漫模型如CamelliaMix_2.5D或GhostMix。首先打开图生图页面,如下图所示

上传需要转换的真人照片,这里我选择的是下面这张图片作为演示使用。

接下来是参数设置:

- 采样器: DPM ++ SDE Karras

- 采样步数: 30

- 提示词引导系数: 7

- 重绘幅度: 0.45(这个是测试出来比较平衡的数据,如果想要更接近原图可以调小,如果希望更加的动漫化可以增加)

编写提示词:

- 正向提示词: (masterpiece:1.2),best quality,1girl,solo,vibrant colors,anime style

- 负页提示词: ng_deepnegative_v1_75t,(badhandv4:1.2),EasyNegative,(worst quality:2),(low quality:1.4),realistic,photo,deformed hands,(Greasy skin:1.5)

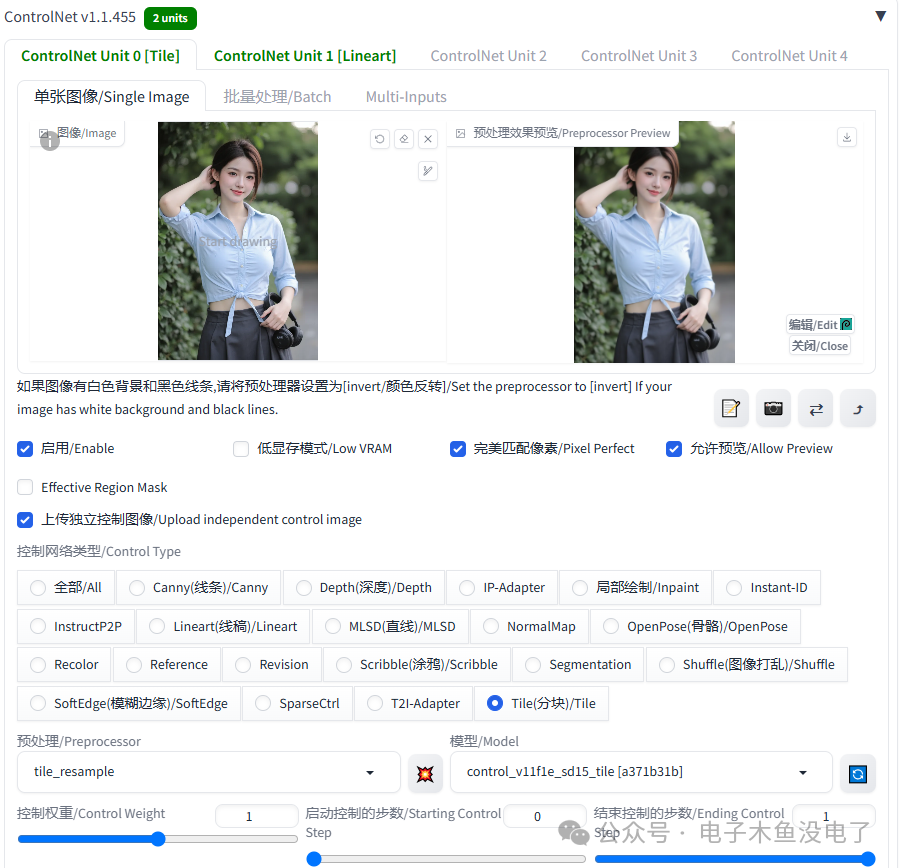

在这里我们需要使用到两个ControlNet控制单元,设置如下

ControlNet Unit0:

- 启用、允许预览、完美像素

- 预处理器:tile_resample

- 模型:control_v11f1e_sd15_tile

- 控制权重:1

- 起始步数:0

- 完结步数:1

- 控制模式:均衡

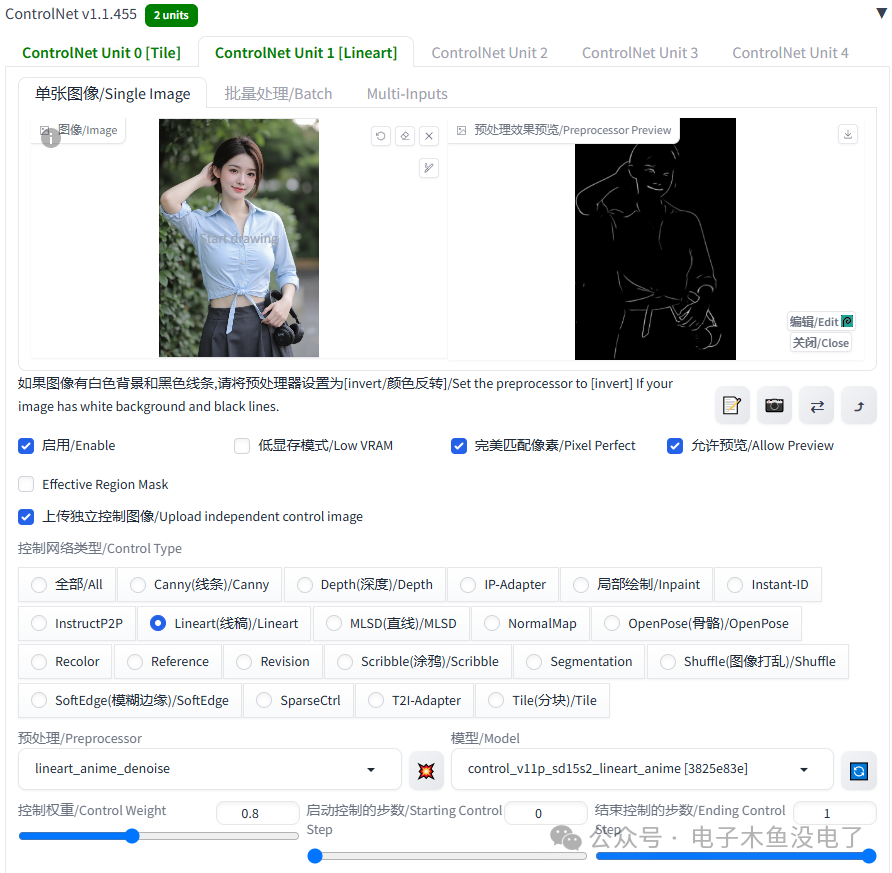

ControlNet Unit1

- 启用、允许预览、完美像素

- 预处理器:lineart_anime_denoise/lineart_anime两个都可以

- 模型:control_v11p_sd15s2_lineart_anime

- 控制权重:0.8(lineart_anime用于提取动漫线条,权重0.8避免过度影响色彩)

- 起始步数:0

- 完结步数:1

- 控制模式:均衡

设置完成后点击生图,即可得到下面的效果。

这里直接将该软件分享出来给大家吧~

1.stable diffusion安装包

随着技术的迭代,目前 Stable Diffusion 已经能够生成非常艺术化的图片了,完全有赶超人类的架势,已经有不少工作被这类服务替代,比如制作一个 logo 图片,画一张虚拟老婆照片,画质堪比相机。

最新 Stable Diffusion 除了有win多个版本,就算说底端的显卡也能玩了哦!此外还带来了Mac版本,仅支持macOS 12.3或更高版本。

2.stable diffusion视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,一步步带你入坑stable diffusion,科学有趣才能更方便的学习下去。

3.stable diffusion模型下载

stable diffusion往往一开始使用时图片等无法达到理想的生成效果,这时则需要通过使用大量训练数据,调整模型的超参数(如学习率、训练轮数、模型大小等),可以使得模型更好地适应数据集,并生成更加真实、准确、高质量的图像。

4.stable diffusion提示词

提示词是构建由文本到图像模型解释和理解的单词的过程。可以把它理解为你告诉 AI 模型要画什么而需要说的语言,整个SD学习过程中都离不开这本提示词手册。

5.SD从0到落地实战演练

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名SD大神的正确特征了。

这份完整版的stable diffusion资料我已经打包好,需要的点击下方插件,即可前往免费领取!

6万+

6万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?