在日常生活中,水泥基建类建筑无处不在,从脚下的路面到庞大的地铁系统、复杂的隧道网络,它们构成了现代城市的基础框架。然而,这些建筑设施并非一旦建成便一劳永逸,而是需要持续的维护与检修,以确保其安全、高效地运行。水泥基建设施作为现代城市运转的重要支撑,其安全稳定运行至关重要。传统的人工巡检模式已难以满足日益增长的基建设施运维需求,暴露出效率低下、成本高昂、安全隐患等诸多问题。随着人工智能技术的快速发展,AI赋能的智能化巡检模式正在重塑传统基建运维体系,开启基建安全管理的新篇章。

一、传统巡检模式面临严峻挑战

传统的巡检作业高度依赖人工,经验丰富的工程师需要亲自前往现场,利用专业设备进行细致的检查。这种模式虽然在一定程度上保证了巡检的质量,但其局限性也日益凸显。一方面,人工巡检存在漏检的风险,尤其是在面对庞大且复杂的基建网络时,难以做到百分之百的覆盖。另一方面,人工成本高昂,且难以维持24小时全天候的作业强度,这在一定程度上限制了巡检的效率和频率,在复杂的基建设施环境中,人眼识别存在视觉疲劳、注意力分散等问题,极易造成安全隐患的漏检误判。特别是在高海拔、海底隧道等危险作业环境中,人工巡检不仅效率低下,更对巡检人员的人身安全构成严重威胁。

此外,传统巡检还受到气象天气等因素的限制。恶劣的天气条件,如暴雨、大风、严寒等,往往导致巡检作业无法进行,从而延误了安全隐患的及时发现和处理。气象条件对人工巡检的影响尤为显著。恶劣天气下,巡检工作往往被迫中断,难以及时发现和处理突发问题。这种被动式的巡检模式,无法满足现代城市对基建设施安全运行的高标准要求。更为严重的是,一些基建设施位于高海拔、塔吊、海底、隧道等危险位置,这些场所的巡检作业对人员的安全构成了极大威胁。

人工巡检的高成本问题日益凸显。培养一名合格的巡检工程师需要投入大量时间和资源,而要实现24小时全天候巡检,则需要投入更多的人力成本。这种高成本、低效率的运维模式,已成为制约基建设施安全管理水平提升的主要瓶颈。

二、AI技术赋能智能化巡检

计算机视觉技术的突破为智能化巡检提供了技术支撑。通过深度学习算法,AI模型能够准确识别基建设施表面的裂缝、腐蚀、变形等缺陷,其识别精度已超越人眼极限。基于海量标注数据训练的AI模型,具备强大的特征提取和模式识别能力。

智能化巡检系统采用"云-边-端"协同架构,在边缘端部署AI算力设备,实现实时视频流分析。系统能够自动识别异常情况,即时推送预警信息,大幅提升隐患发现的及时性。这种架构既保证了实时性,又降低了数据传输成本。借助于海量铺设安装的摄像头,我们可以源源不断地采集作业场景下的图像数据。这些摄像头充当了“人眼”的角色,实时捕捉基建设施的运行状态。随后,由具有专业背景的师傅进行数据标注,以开发构建智能化的检测模型。这一模型能够识别各种潜在的安全隐患,如裂缝、变形、脱落等,从而实现对基建设施的智能化监测。更为先进的是,借助于边缘端的算力设备,我们可以将智能检测模型装载进去,实现对摄像头端采集到的画面进行实时智能检测识别。当发现问题或疑似问题时,系统能够及时将警报推送到中央平台端,由专门的巡检团队负责处理。这种AI赋能的作业模式极大地降低了人工成本,同时实现了全天候的工作方式,让巡检更加精准化、高效化。

三、智能化巡检带来的变革

AI智能化巡检模式相较于传统巡检具有诸多优势。首先,它降低了人工成本,提高了巡检效率。通过智能化的检测模型,系统能够自动识别和处理潜在的安全隐患,减少了人工巡检的需求。其次,AI巡检实现了全天候的工作方式,不受气象天气等因素的限制。这意味着无论天气如何恶劣,系统都能够持续地进行监测和警报,确保基建设施的安全运行。智能化巡检系统实现了7×24小时不间断工作,彻底改变了传统巡检的时间限制。系统能够同时监控多个点位,巡检效率呈指数级提升。这种变革使得基建设施的安全管理从被动应对转向主动预防。智能化巡检显著降低了人力成本和管理成本。AI系统一次性投入后,主要成本在于系统维护和升级,远低于持续的人工成本支出。这种成本优势使得大规模推广应用成为可能。

此外,AI巡检还能够提高巡检的精准度和覆盖率。智能检测模型能够识别各种细微的安全隐患,从而避免了人工巡检中可能存在的漏检问题。同时,通过摄像头的广泛铺设和实时监测,系统能够实现对基建设施的全面覆盖,确保每一个角落都在监控之下。

本文就是在这样的思考背景下想要尝试从实验的角度开发构建水泥基建场景诸如:路面、墙体类裂缝缺陷智能化检测系统,在前面的系列博文中我们已经进行了相关的开发实践,感兴趣的话可以自行移步阅读即可:

《AI赋能传统基建巡检开启智能化运维新时代,基于YOLOv5全系列【n/s/m/l/x】参数模型开发构建水泥基建场景下道路、墙体裂缝缺陷智能检测识别系统》

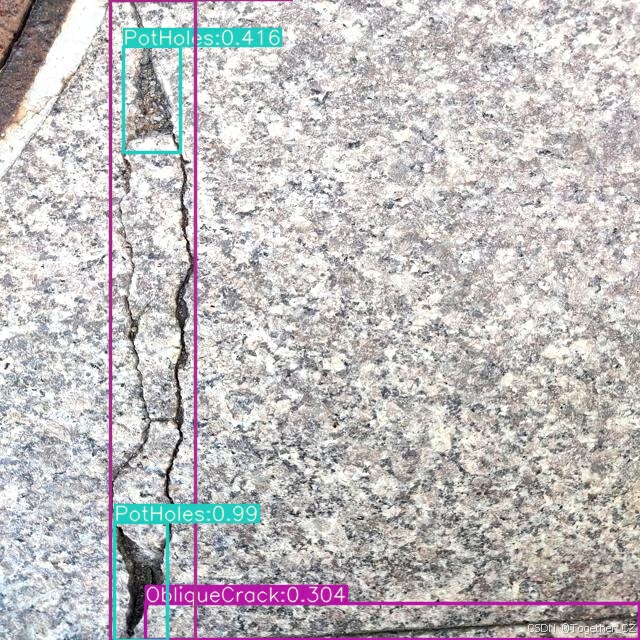

本文主要是想要基于YOLOv7系列的模型来进行相应的开发实践,首先看下实例效果:

接下来看下实例数据:

YOLOv7是 YOLO 系列最新推出的YOLO 结构,在 5 帧/秒到 160 帧/秒范围内,其速度和精度都超过了大部分已知的目标检测器,在 GPU V100 已知的 30 帧/秒以上的实时目标检测器中,YOLOv7 的准确率最高。根据代码运行环境的不同(边缘 GPU、普通 GPU 和云 GPU),YOLOv7 设置了三种基本模型,分别称为 YOLOv7-tiny、YOLOv7和 YOLOv7-W6。相比于 YOLO 系列其他网络 模 型 ,YOLOv7 的 检 测 思 路 与YOLOv4、YOLOv5相似,YOLOv7 网络主要包含了 Input(输入)、Backbone(骨干网络)、Neck(颈部)、Head(头部)这四个部分。首先,图片经过输入部分数据增强等一系列操作进行预处理后,被送入主干网,主干网部分对处理后的图片提取特征;随后,提取到的特征经过 Neck 模块特征融合处理得到大、中、小三种尺寸的特征;最终,融合后的特征被送入检测头,经过检测之后输出得到结果。

YOLOv7 网络模型的主干网部分主要由卷积、E-ELAN 模块、MPConv 模块以及SPPCSPC 模块构建而成 。在 Neck 模块,YOLOv7 与 YOLOv5 网络相同,也采用了传统的 PAFPN 结构。FPN是YoloV7的加强特征提取网络,在主干部分获得的三个有效特征层会在这一部分进行特征融合,特征融合的目的是结合不同尺度的特征信息。在FPN部分,已经获得的有效特征层被用于继续提取特征。在YoloV7里依然使用到了Panet的结构,我们不仅会对特征进行上采样实现特征融合,还会对特征再次进行下采样实现特征融合。Head检测头部分,YOLOv7 选用了表示大、中、小三种目标尺寸的 IDetect 检测头,RepConv模块在训练和推理时结构具有一定的区别。

这里主要是选择了yolov7-tiny、yolov7和yolov7x这三款不同参数量级的模型来进行开发训练,最终线上选取的是yolov7模型作为推理模型,这里给出来yolov7的模型文件:

# parameters

nc: 2 # number of classes

depth_multiple: 1.0 # model depth multiple

width_multiple: 1.0 # layer channel multiple

# anchors

anchors:

- [12,16, 19,36, 40,28] # P3/8

- [36,75, 76,55, 72,146] # P4/16

- [142,110, 192,243, 459,401] # P5/32

# yolov7 backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [32, 3, 1]], # 0

[-1, 1, Conv, [64, 3, 2]], # 1-P1/2

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [128, 3, 2]], # 3-P2/4

[-1, 1, Conv, [64, 1, 1]],

[-2, 1, Conv, [64, 1, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[[-1, -3, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]], # 11

[-1, 1, MP, []],

[-1, 1, Conv, [128, 1, 1]],

[-3, 1, Conv, [128, 1, 1]],

[-1, 1, Conv, [128, 3, 2]],

[[-1, -3], 1, Concat, [1]], # 16-P3/8

[-1, 1, Conv, [128, 1, 1]],

[-2, 1, Conv, [128, 1, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[[-1, -3, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [512, 1, 1]], # 24

[-1, 1, MP, []],

[-1, 1, Conv, [256, 1, 1]],

[-3, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 2]],

[[-1, -3], 1, Concat, [1]], # 29-P4/16

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -3, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [1024, 1, 1]], # 37

[-1, 1, MP, []],

[-1, 1, Conv, [512, 1, 1]],

[-3, 1, Conv, [512, 1, 1]],

[-1, 1, Conv, [512, 3, 2]],

[[-1, -3], 1, Concat, [1]], # 42-P5/32

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -3, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [1024, 1, 1]], # 50

]

# yolov7 head

head:

[[-1, 1, SPPCSPC, [512]], # 51

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[37, 1, Conv, [256, 1, 1]], # route backbone P4

[[-1, -2], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[[-1, -2, -3, -4, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]], # 63

[-1, 1, Conv, [128, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[24, 1, Conv, [128, 1, 1]], # route backbone P3

[[-1, -2], 1, Concat, [1]],

[-1, 1, Conv, [128, 1, 1]],

[-2, 1, Conv, [128, 1, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[[-1, -2, -3, -4, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [128, 1, 1]], # 75

[-1, 1, MP, []],

[-1, 1, Conv, [128, 1, 1]],

[-3, 1, Conv, [128, 1, 1]],

[-1, 1, Conv, [128, 3, 2]],

[[-1, -3, 63], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[[-1, -2, -3, -4, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]], # 88

[-1, 1, MP, []],

[-1, 1, Conv, [256, 1, 1]],

[-3, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 2]],

[[-1, -3, 51], 1, Concat, [1]],

[-1, 1, Conv, [512, 1, 1]],

[-2, 1, Conv, [512, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -2, -3, -4, -5, -6], 1, Concat, [1]],

[-1, 1, Conv, [512, 1, 1]], # 101

[75, 1, RepConv, [256, 3, 1]],

[88, 1, RepConv, [512, 3, 1]],

[101, 1, RepConv, [1024, 3, 1]],

[[102,103,104], 1, IDetect, [nc, anchors]], # Detect(P3, P4, P5)

]如果对YOLOv7开发构建自己的个性化目标检测系统有疑问的可以参考前文的超详细教程:

《YOLOv7基于自己的数据集从零构建模型完整训练、推理计算超详细教程》

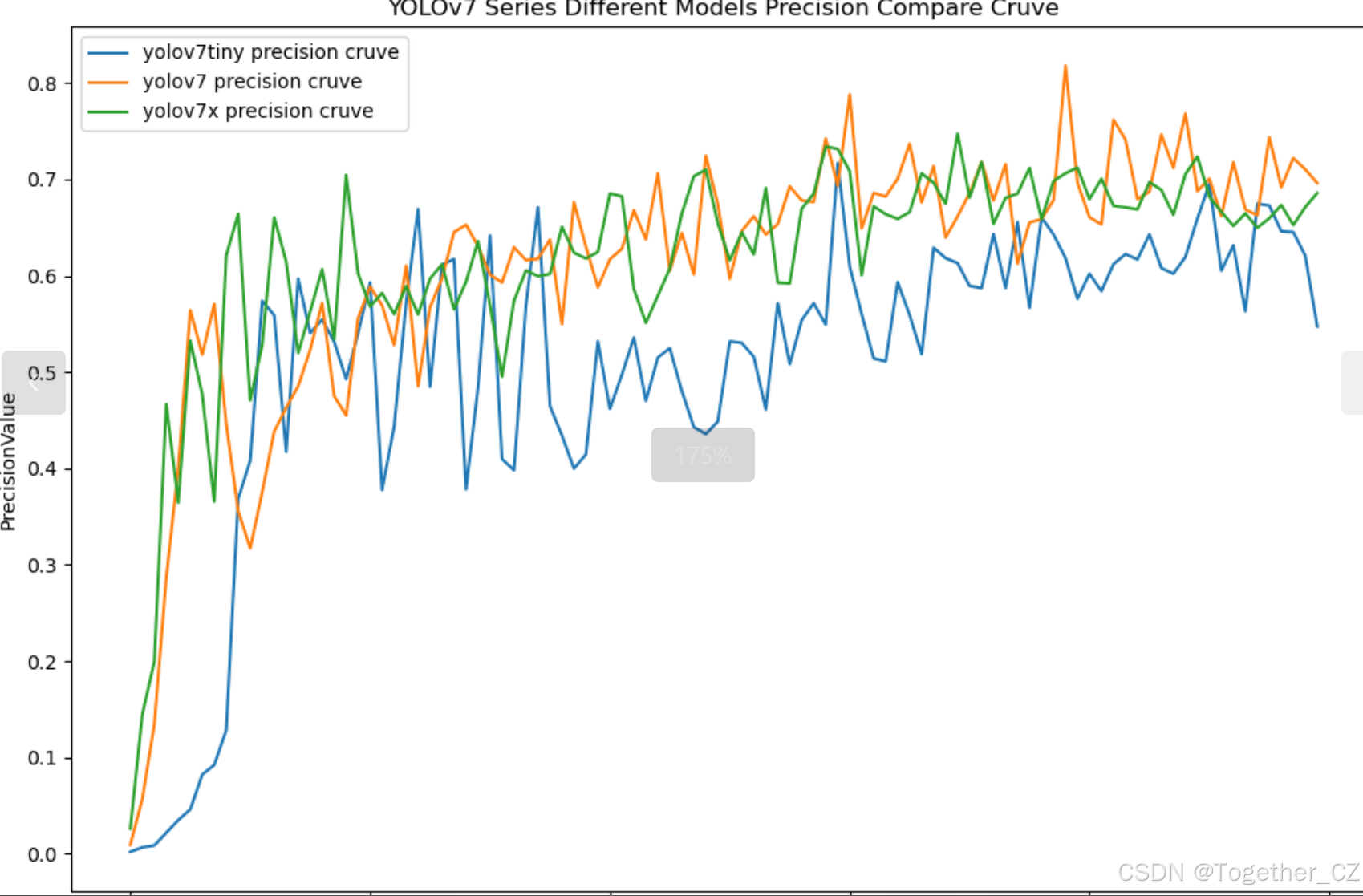

在实验阶段保持完全相同的参数设置,等待全部训练完成之后来从多个指标的维度来进行综合的对比分析。

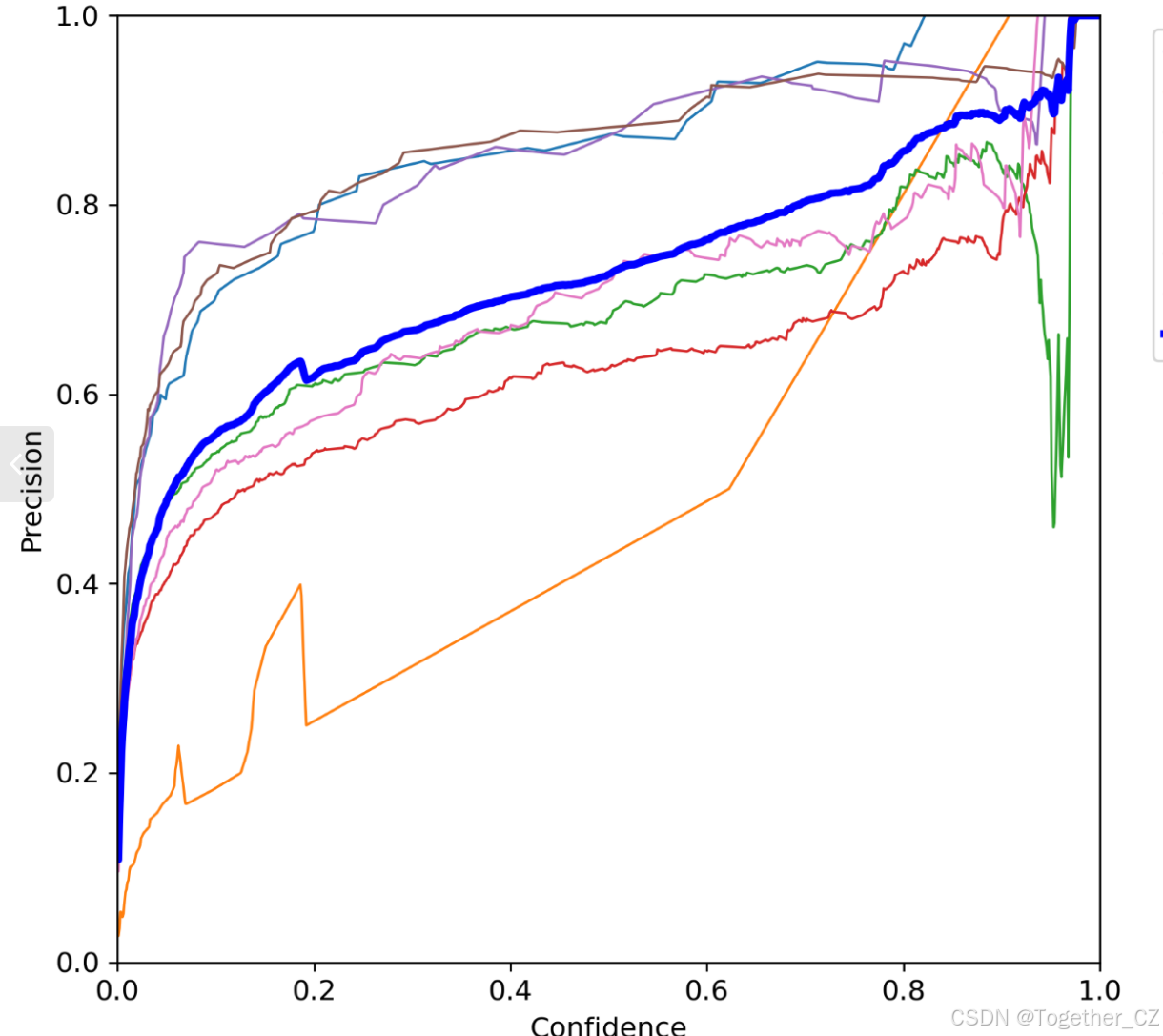

【Precision曲线】

精确率曲线(Precision Curve)是一种用于评估二分类模型在不同阈值下的精确率性能的可视化工具。它通过绘制不同阈值下的精确率和召回率之间的关系图来帮助我们了解模型在不同阈值下的表现。

精确率(Precision)是指被正确预测为正例的样本数占所有预测为正例的样本数的比例。召回率(Recall)是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。

绘制精确率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率和召回率。

将每个阈值下的精确率和召回率绘制在同一个图表上,形成精确率曲线。

根据精确率曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

通过观察精确率曲线,我们可以根据需求确定最佳的阈值,以平衡精确率和召回率。较高的精确率意味着较少的误报,而较高的召回率则表示较少的漏报。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

精确率曲线通常与召回率曲线(Recall Curve)一起使用,以提供更全面的分类器性能分析,并帮助评估和比较不同模型的性能。

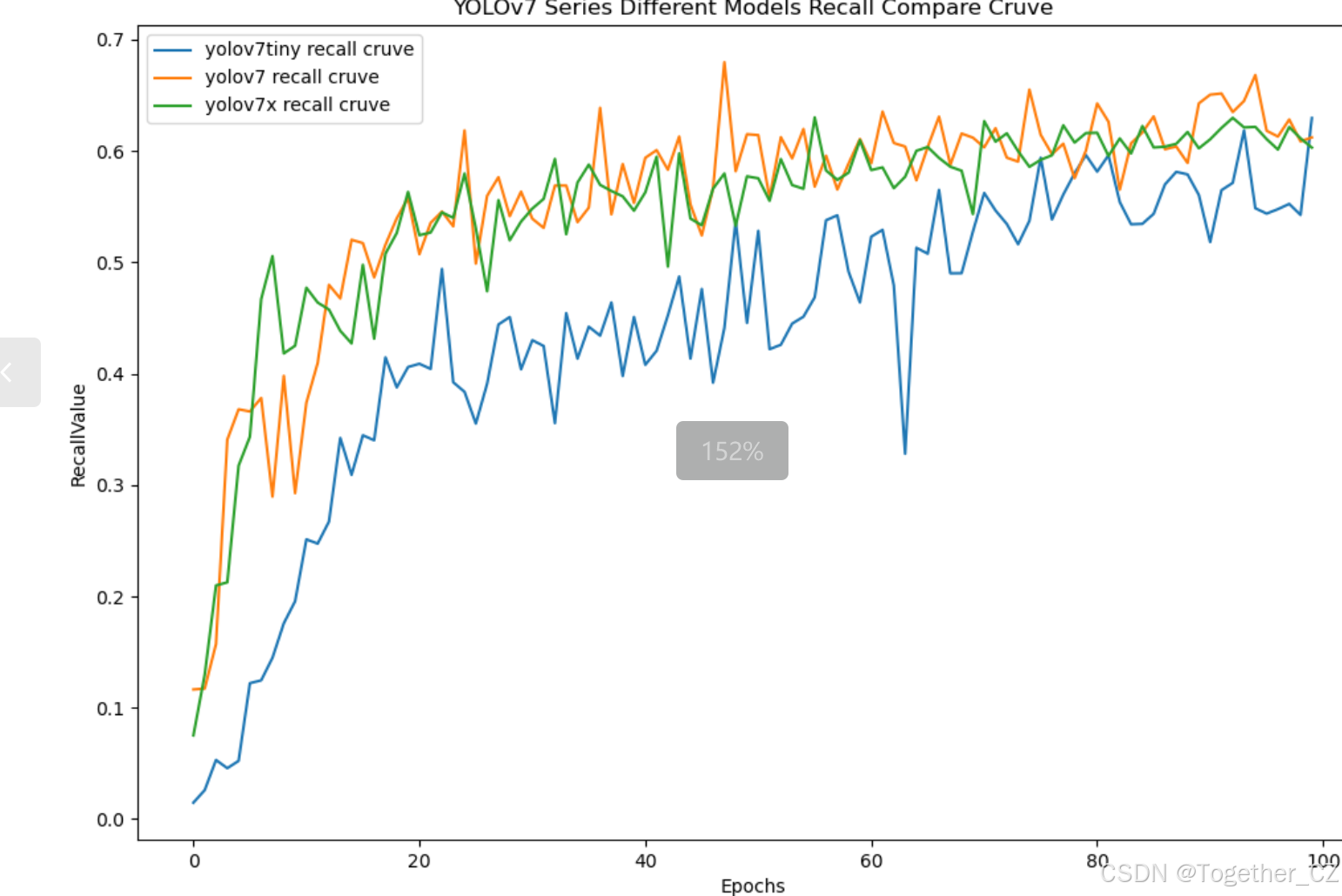

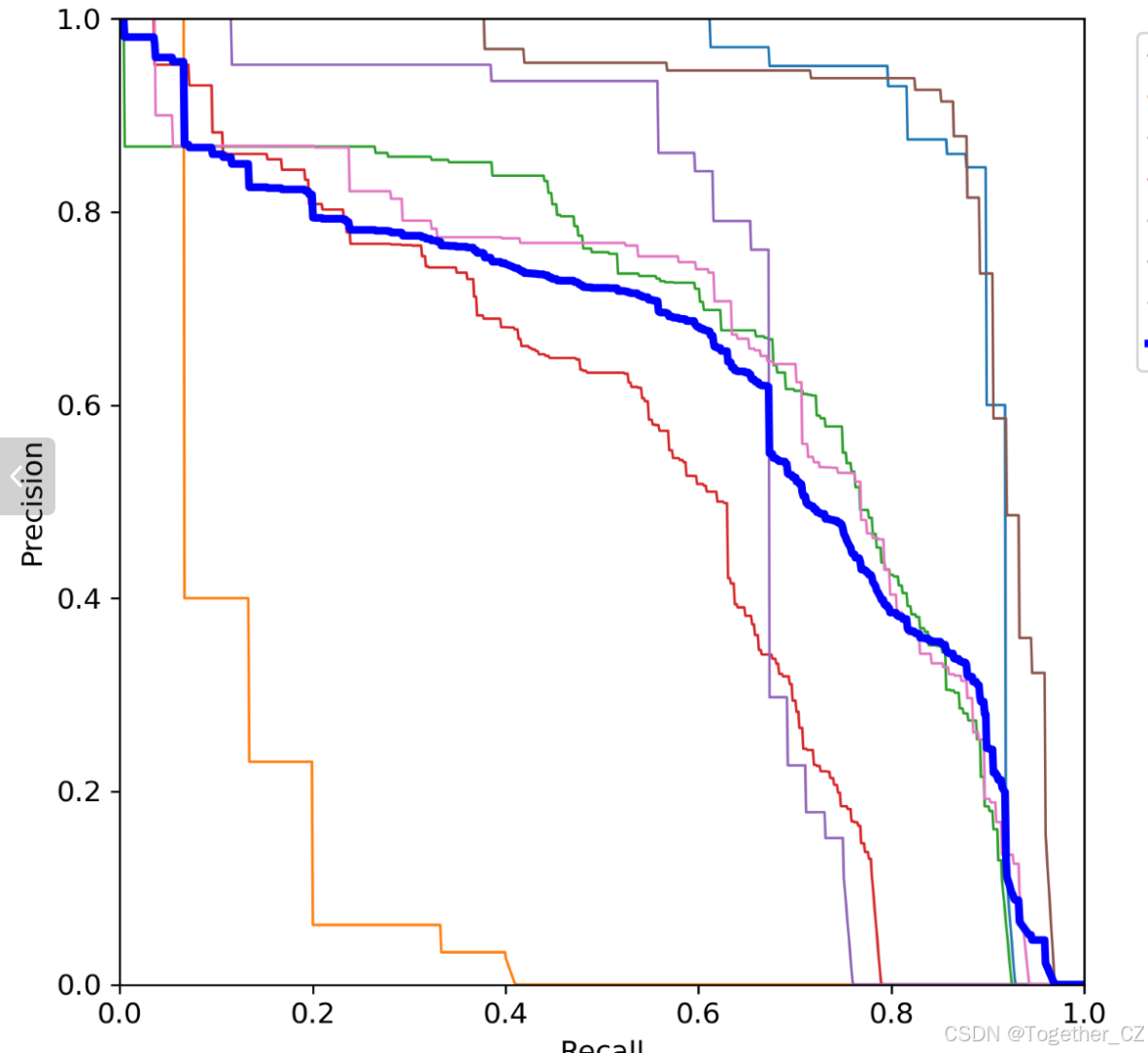

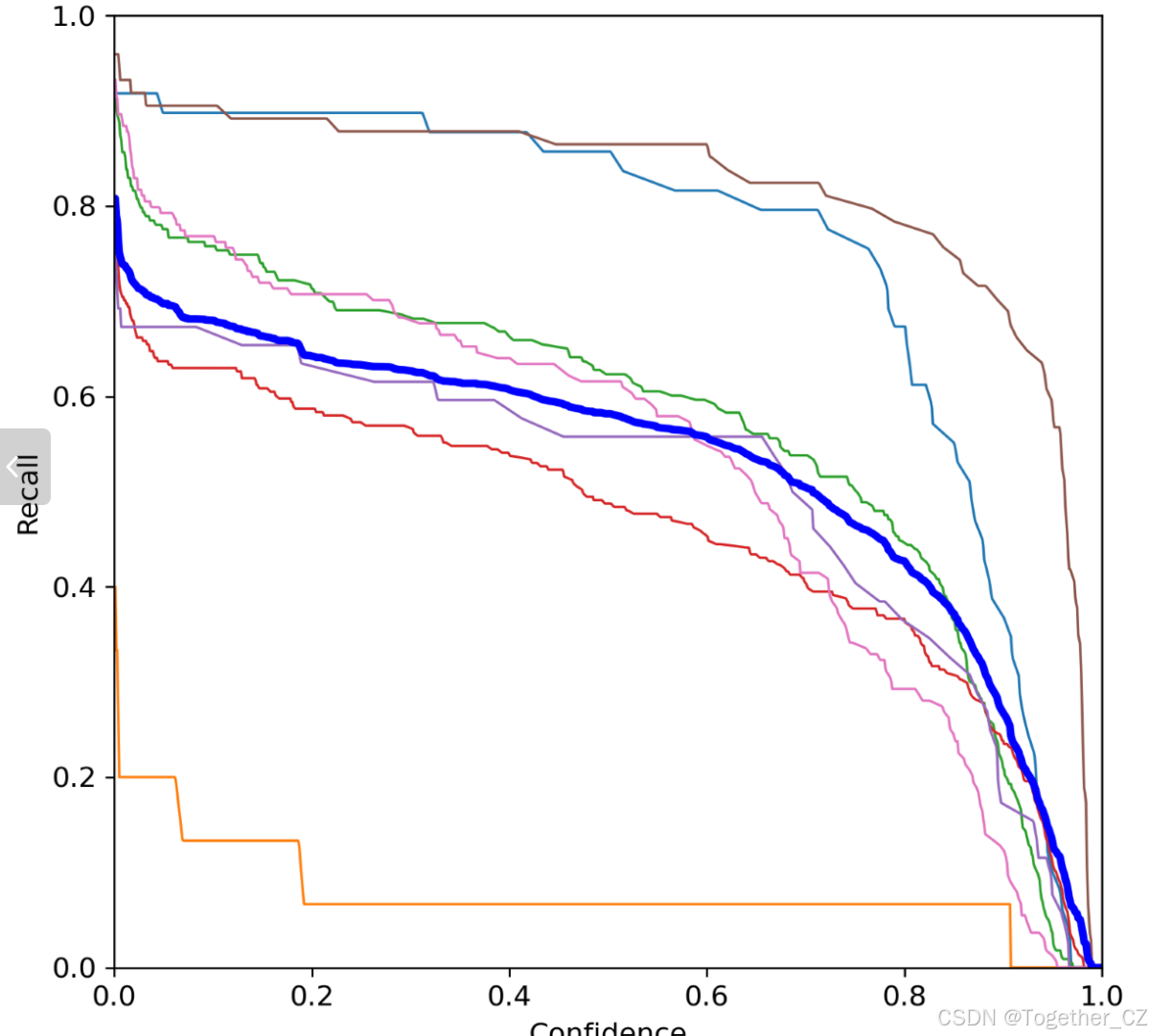

【Recall曲线】

召回率曲线(Recall Curve)是一种用于评估二分类模型在不同阈值下的召回率性能的可视化工具。它通过绘制不同阈值下的召回率和对应的精确率之间的关系图来帮助我们了解模型在不同阈值下的表现。

召回率(Recall)是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。召回率也被称为灵敏度(Sensitivity)或真正例率(True Positive Rate)。

绘制召回率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的召回率和对应的精确率。

将每个阈值下的召回率和精确率绘制在同一个图表上,形成召回率曲线。

根据召回率曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

通过观察召回率曲线,我们可以根据需求确定最佳的阈值,以平衡召回率和精确率。较高的召回率表示较少的漏报,而较高的精确率意味着较少的误报。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

召回率曲线通常与精确率曲线(Precision Curve)一起使用,以提供更全面的分类器性能分析,并帮助评估和比较不同模型的性能。

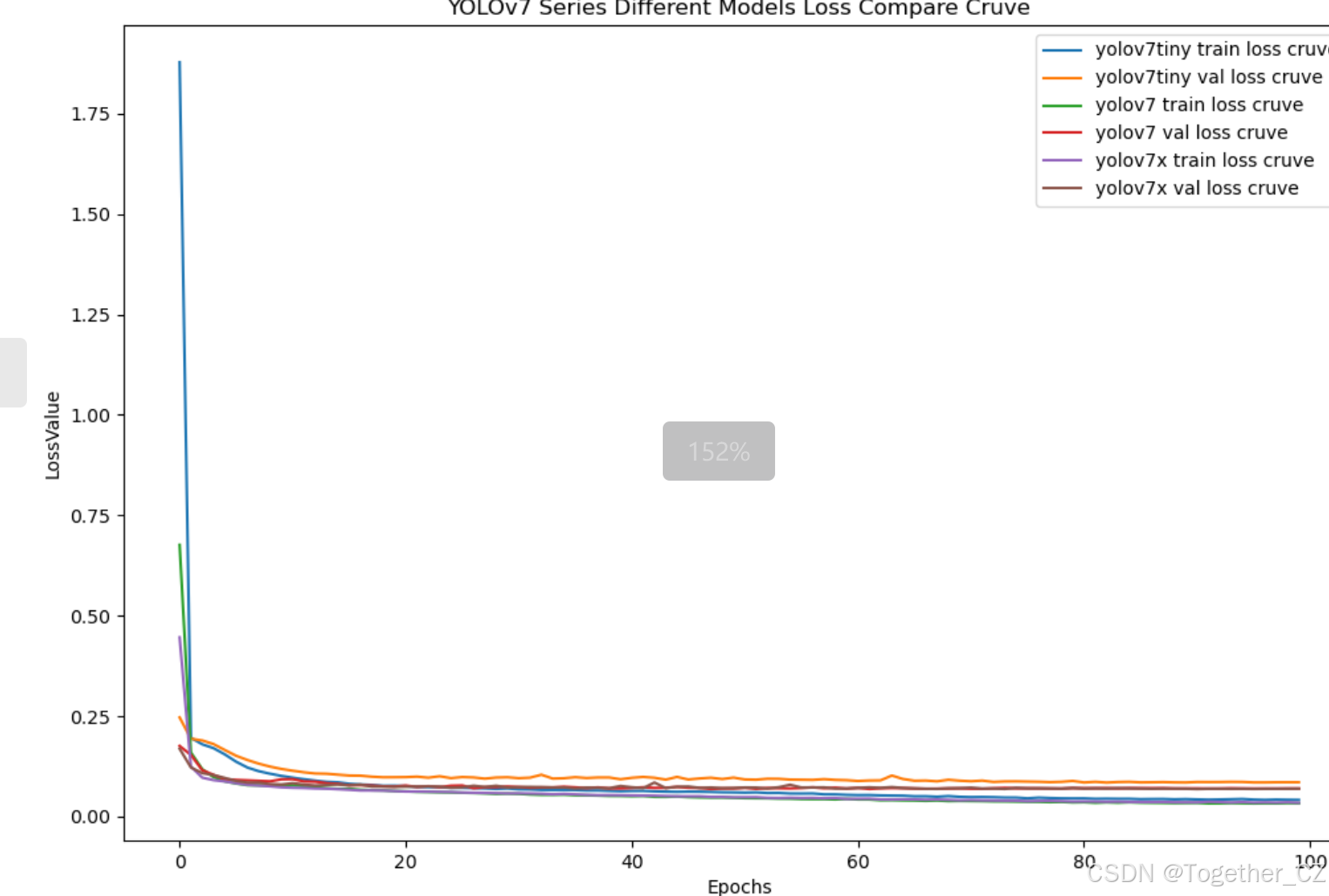

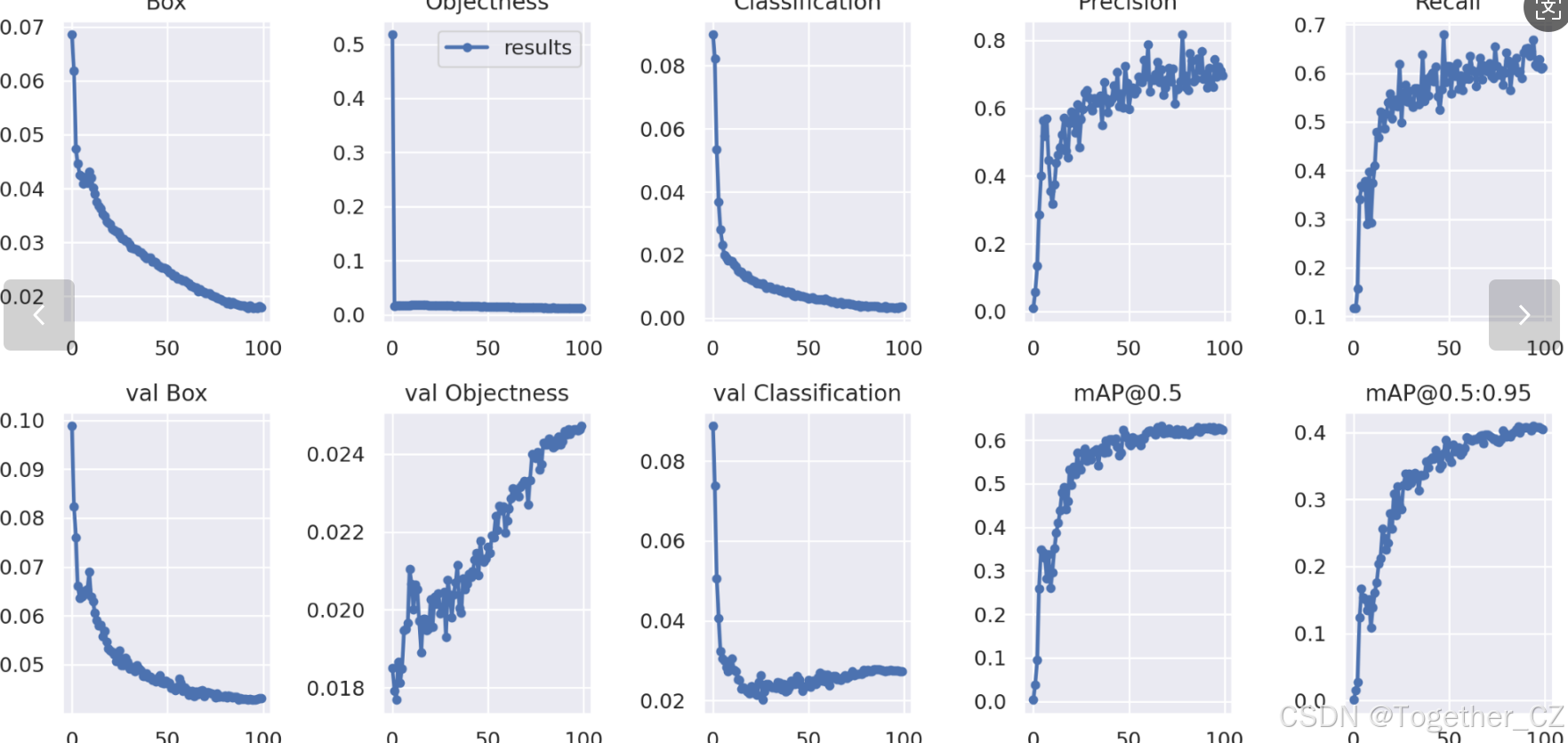

【loss曲线】

在深度学习的训练过程中,loss函数用于衡量模型预测结果与实际标签之间的差异。loss曲线则是通过记录每个epoch(或者迭代步数)的loss值,并将其以图形化的方式展现出来,以便我们更好地理解和分析模型的训练过程。

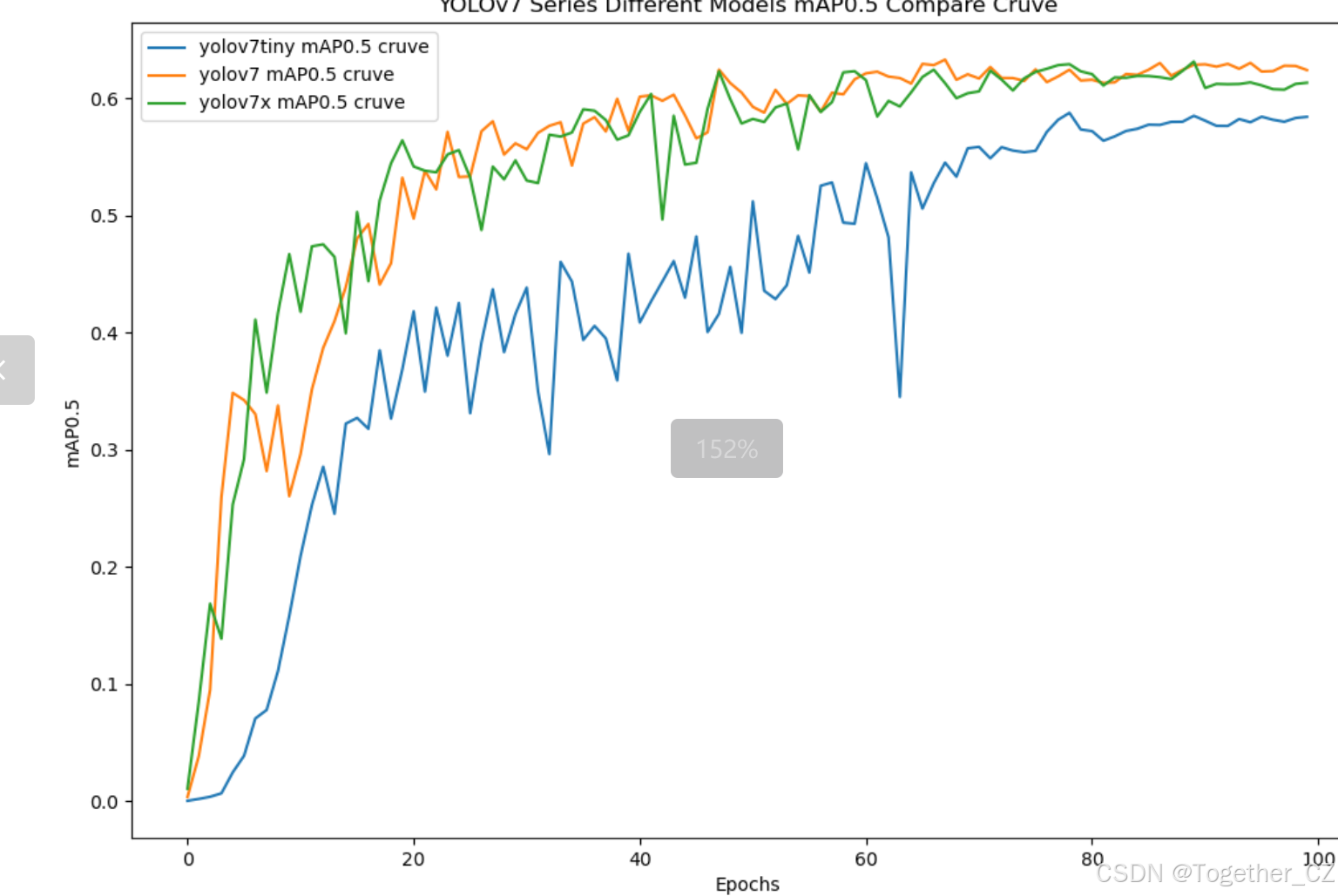

【mAP0.5】

mAP0.5,也被称为mAP@0.5或AP50,指的是当Intersection over Union(IoU)阈值为0.5时的平均精度(mean Average Precision)。IoU是一个用于衡量预测边界框与真实边界框之间重叠程度的指标,其值范围在0到1之间。当IoU值为0.5时,意味着预测框与真实框至少有50%的重叠部分。

在计算mAP0.5时,首先会为每个类别计算所有图片的AP(Average Precision),然后将所有类别的AP值求平均,得到mAP0.5。AP是Precision-Recall Curve曲线下面的面积,这个面积越大,说明AP的值越大,类别的检测精度就越高。

mAP0.5主要关注模型在IoU阈值为0.5时的性能,当mAP0.5的值很高时,说明算法能够准确检测到物体的位置,并且将其与真实标注框的IoU值超过了阈值0.5。

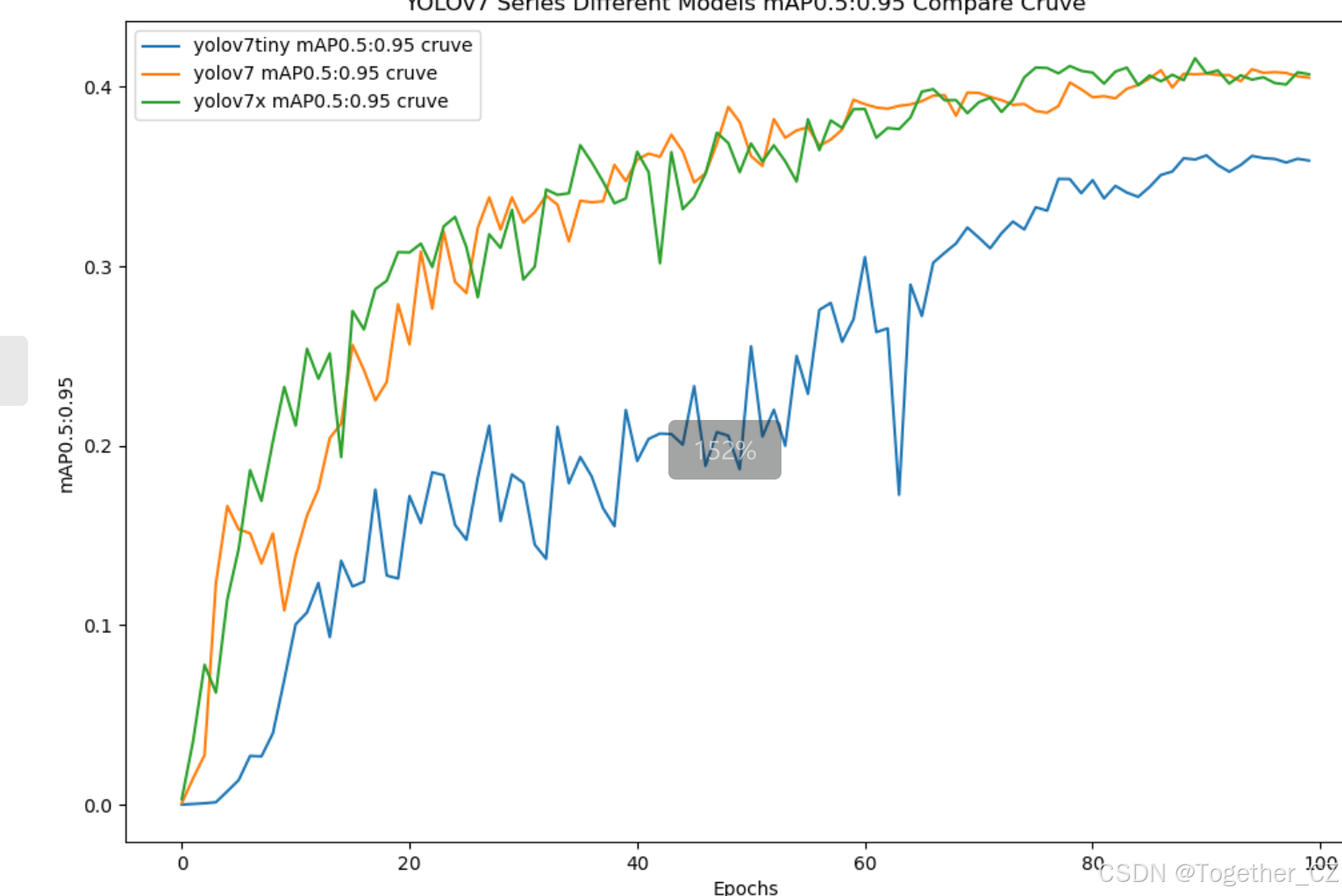

【mAP0.5:0.95】

mAP0.5:0.95,也被称为mAP@[0.5:0.95]或AP@[0.5:0.95],表示在IoU阈值从0.5到0.95变化时,取各个阈值对应的mAP的平均值。具体来说,它会在IoU阈值从0.5开始,以0.05为步长,逐步增加到0.95,并在每个阈值下计算mAP,然后将这些mAP值求平均。

这个指标考虑了多个IoU阈值下的平均精度,从而更全面、更准确地评估模型性能。当mAP0.5:0.95的值很高时,说明算法在不同阈值下的检测结果均非常准确,覆盖面广,可以适应不同的场景和应用需求。

对于一些需求比较高的场合,比如安全监控等领域,需要保证高的准确率和召回率,这时mAP0.5:0.95可能更适合作为模型的评价标准。

综上所述,mAP0.5和mAP0.5:0.95都是用于评估目标检测模型性能的重要指标,但它们的关注点有所不同。mAP0.5主要关注模型在IoU阈值为0.5时的性能,而mAP0.5:0.95则考虑了多个IoU阈值下的平均精度,从而更全面、更准确地评估模型性能。

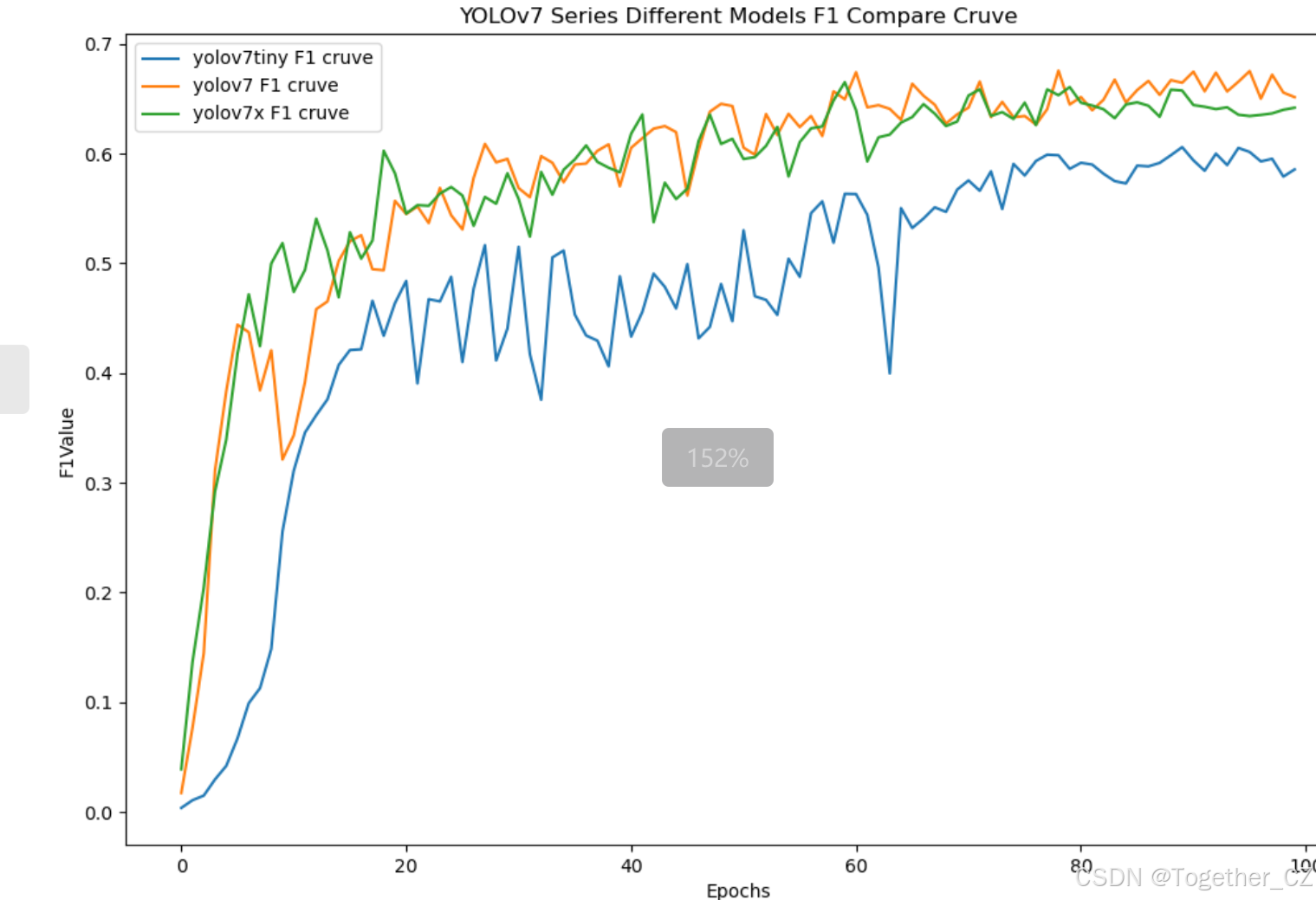

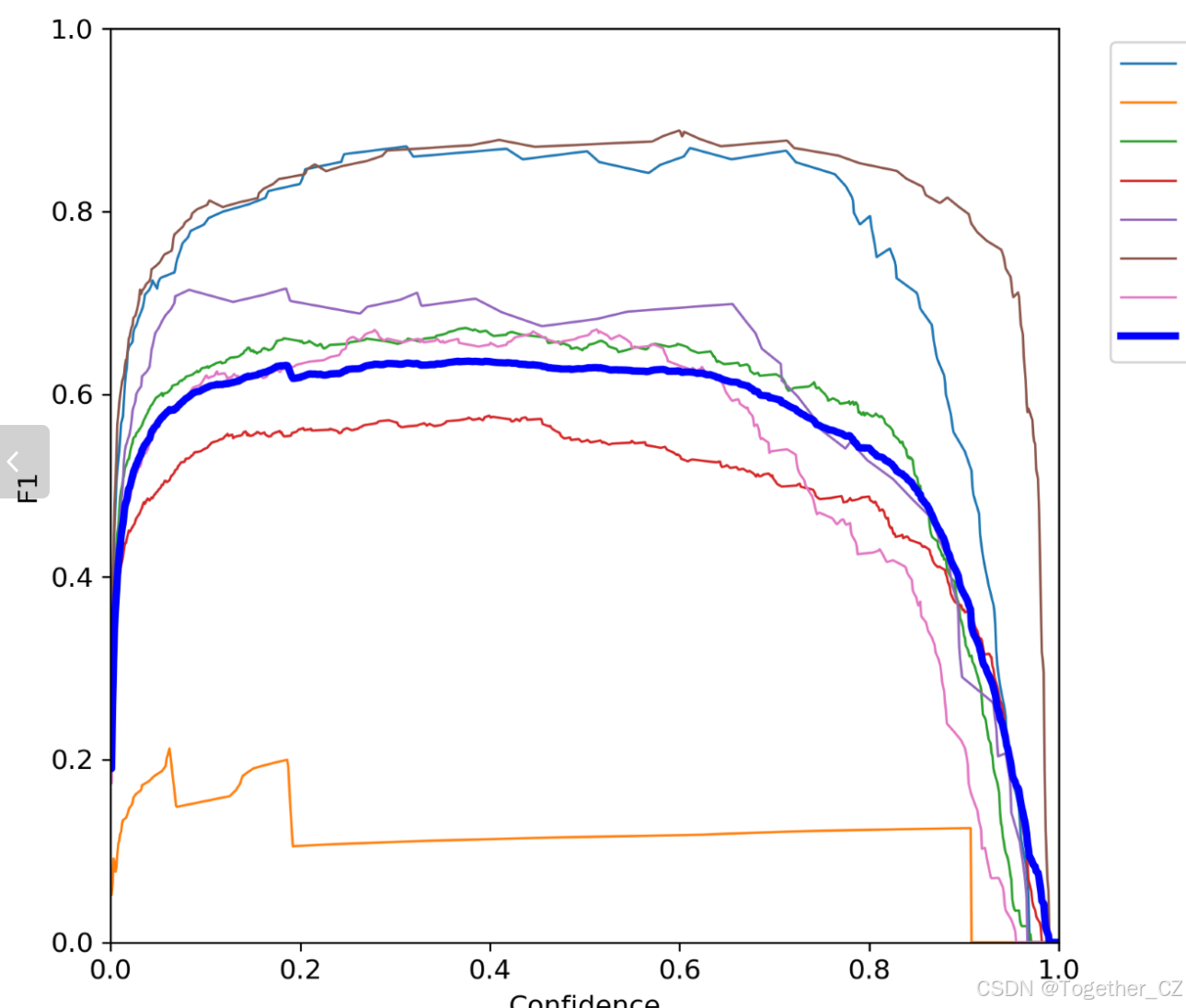

【F1值曲线】

F1值曲线是一种用于评估二分类模型在不同阈值下的性能的可视化工具。它通过绘制不同阈值下的精确率(Precision)、召回率(Recall)和F1分数的关系图来帮助我们理解模型的整体性能。

F1分数是精确率和召回率的调和平均值,它综合考虑了两者的性能指标。F1值曲线可以帮助我们确定在不同精确率和召回率之间找到一个平衡点,以选择最佳的阈值。

绘制F1值曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率、召回率和F1分数。

将每个阈值下的精确率、召回率和F1分数绘制在同一个图表上,形成F1值曲线。

根据F1值曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

F1值曲线通常与接收者操作特征曲线(ROC曲线)一起使用,以帮助评估和比较不同模型的性能。它们提供了更全面的分类器性能分析,可以根据具体应用场景来选择合适的模型和阈值设置。

综合实验对比分析结果来看:随着实验训练迭代次数的增加,三款不同参数量级的模型都不断提升精度,yolov7tiny效果低一点,其余两款模型最终达到了十分相近的效果,这里综合考虑最终选择使用yolov7模型来作为最终的推理模型。

接下来我们详细看下yolov7模型的结果详情。

【离线推理实例】

【Batch实例】

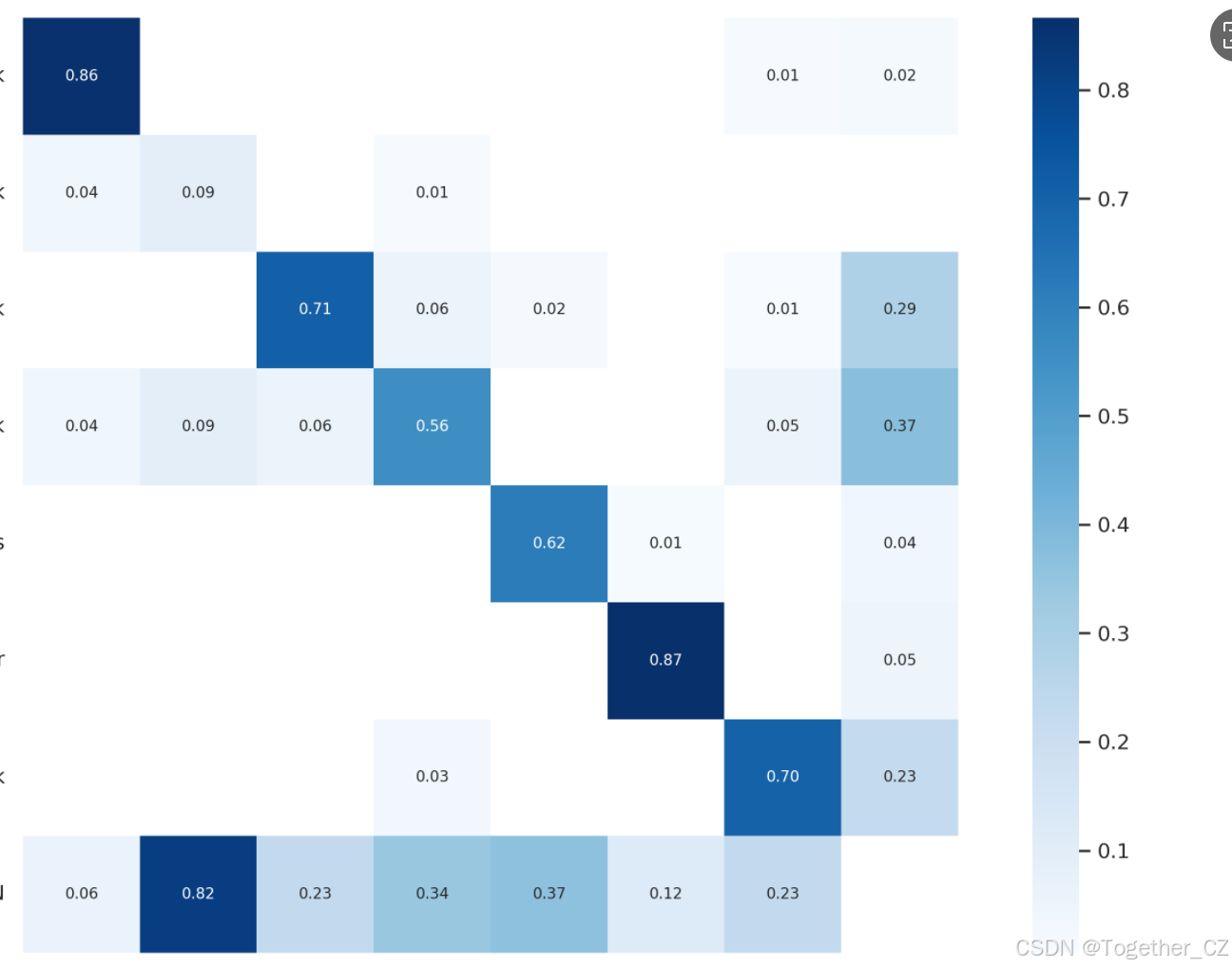

【混淆矩阵】

【F1值曲线】

【Precision曲线】

【PR曲线】

【Recall曲线】

【训练可视化】

智能化巡检推动了基建运维体系的数字化转型。通过积累海量巡检数据,建立设施健康档案,为预防性维护提供数据支撑。这种数据驱动的运维模式,正在重塑整个基建安全管理体系。智能化巡检技术的应用,标志着基建安全管理进入AI时代。随着技术的不断进步和应用场景的拓展,智能化巡检将在更广阔的领域发挥作用。未来,随着5G、物联网等新技术的融合应用,智能化巡检系统将实现更精准的缺陷识别、更智能的决策支持,为城市基建设施的安全运行提供坚实保障。这场由AI技术驱动的基建运维革命,正在重新定义城市安全管理的新标准。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?