(参考:深度学习经典网络(4)ResNet深度残差网络结构详解)

1.resnet意义

随着网络的加深,出现了训练集准确率下降的现象,即“网络退化”。

深度残差网络,它允许网络尽可能的加深。

2.resnet结构

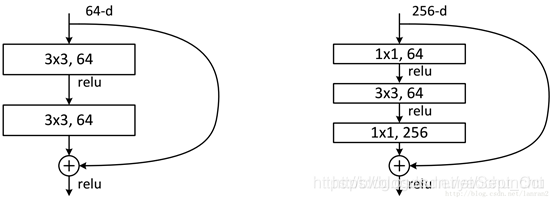

这两种结构分别针对resnet34(左图)和resnet50/101/152(右图),一般称整个结构为一个”building block“。其中右图又称为”bottleneck design”,目的一目了然,就是为了降低参数的数目。

看右图,输入是一个3×3×256的特征,第一个步骤用64个1x1的卷积把256维channel降到64维,然后在最后通过1x1卷积恢复到256个channel,整体上用的参数数目:1x1x256x64 + 3x3x64x64 + 1x1x64x256 = 69632,而不使用bottleneck的话参考左图,输入假设是3x3x256,第一步经过256个卷积核3×3×256,第二部再经过256个卷积核3×3×256。所以参数数目: 3x3x256x256x2 = 1179648,差了16.94倍。

对于常规resnet,可以用于34层或者更少的网络中,对于bottleneck design的resnet通常用于更深的如101这样的网络中,目的是减少计算和参数量(实用目的)。

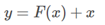

resnet提出了两种mapping:

- 一种是identity mapping,指的就是上图中”弯弯的曲线”

- 另一种residual mapping,指的就是除了”弯弯的曲线“那部分,所以最后的输出是

identity mapping顾名思义,就是指本身,也就是公式中的x,而residual mapping指的是“差”,也就是y−x,所以残差指的就是F(x)部分。

为什么ResNet可以解决“随着网络加深,准确率不下降”的问题?

理论上,对于“随着网络加深,准确率下降”的问题,resnet提供了两种选择方式,也就是identity mapping和residual mapping,如果网络已经到达最优,继续加深网络,residual mapping将被push为0,只剩下identity mapping,这样理论上网络一直处于最优状态了,网络的性能也就不会随着深度增加而降低了。

如果F(x)和x的channel个数不同怎么办,因为F(x)和x是按照channel维度相加的,channel不同怎么相加呢?

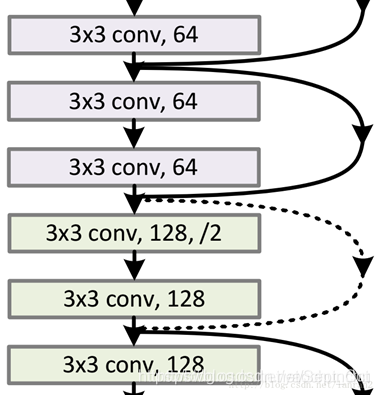

针对channel个数是否相同,要分成两种情况考虑,如下图:

如上图所示,我们可以清楚的”实线“和”虚线“两种连接方式,实线的的Connection部分(”第一个粉色矩形和第三个粉色矩形“)都是执行3x3x64的卷积,他们的channel个数一致,所以采用计算方式:

y=F(x)+x

虚线的的Connection部分(”第一个绿色矩形和第三个绿色矩形“)分别是3x3x64和3x3x128的卷积操作,他们的channel个数不同(64和128),所以采用计算方式:

y=F(x)+W·x

其中W是卷积操作,用来调整x的channel维度的。

3.resnet50和resnet101

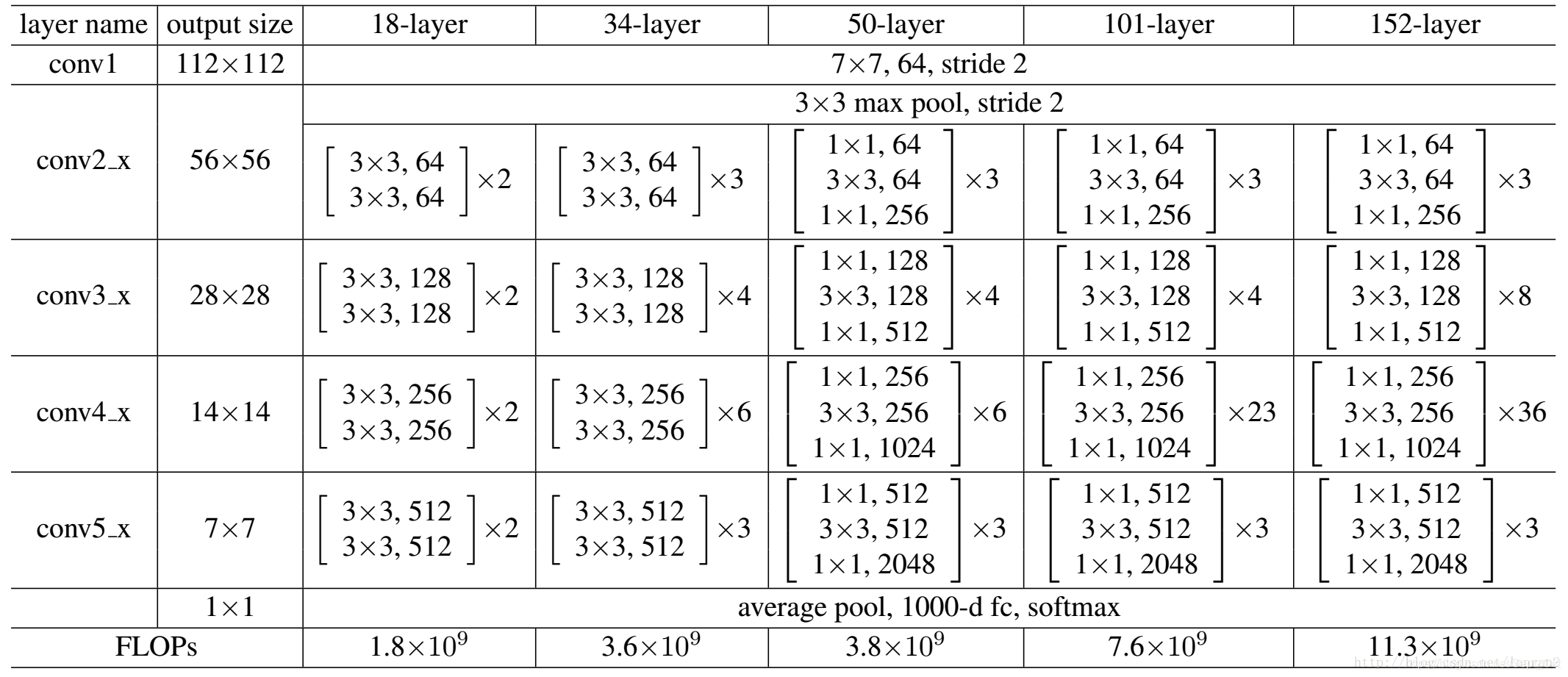

这里把ResNet50和ResNet101特别提出,主要因为它们的出镜率很高,所以需要做特别的说明。给出了它们具体的结构:

首先我们看一下上表。上面一共提出了5种深度的resnet,分别是18,34,50,101和152,首先看表最左侧,我们发现所有的网络都分成5部分,分别是:conv1,conv2_x,conv3_x,conv4_x,conv5_x,之后的其他论文也会专门用这个称呼指代resnet50或者101的每部分。

拿101-layer那列,我们先看看101-layer是不是真的是101层网络,首先有个输入7x7x64的卷积,然后经过3 + 4 + 23 + 3 = 33个building block,每个block为3层,所以有33 x 3 = 99层,最后有个fc层(用于分类),所以1 + 99 + 1 = 101层,确实有101层网络;

注:101层网络仅仅指卷积或者全连接层,而激活层或者Pooling层并没有计算在内; 这里我们关注50-layer和101-layer这两列,可以发现,它们唯一的不同在于conv4_x,ResNet50有6个block,而ResNet101有23个block,查了17个block,也就是17 x 3 = 51层。

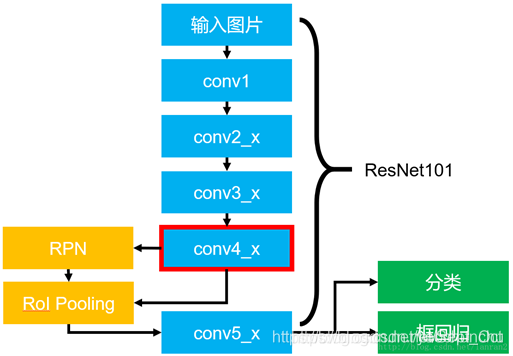

4.基于resnet101的faster rcnn

Faster RCNN中RPN和Fast RCNN的共享特征图用的是conv5_x的输出么?

上图展示了整个faster rcnn的架构,其中蓝色的部分为resnet101,可以发现conv4_x的最后的输出为rpn和roi pooling共享的部分,而conv5_x(共9层网络)都作用于roi pooling之后的一堆特征图(14 x 14 x 1024),特征图的大小维度也刚好符合原本的resnet101中conv5_x的输入;

最后一定要记得最后要接一个average pooling,得到2048维特征,分别用于分类和框回归。

5.到底哪种是resnet的结构?

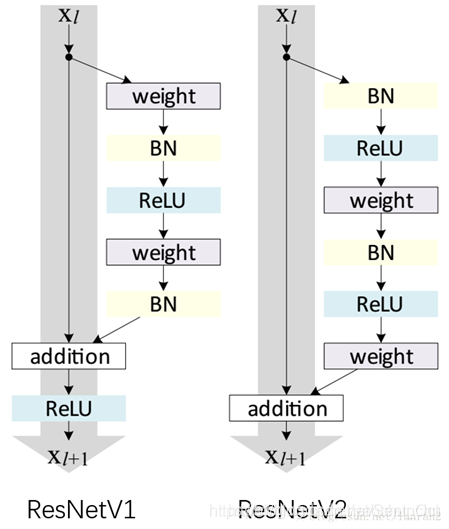

下面(1)-(5)的结构哪个是我们常用的ResNet结构?

其中weight指conv层,bn指batch normalization层,relu指激活层,addition指相加;根据resnet的描述,似乎以上五组都符合,那么2016年resnet原文是哪一个结构呢?以及其他四组结构也都work么?我们不禁有了这两个疑问,伴随着疑问我们一一揭开谜题;

针对第一个问题,resnet原文中使用的结构是(1)。(1)的特点有两个:

- 1)bn和relu在weight的后面;

- 2)最后的relu在addition的后面;

对于特点1),属于常规范畴,我们平时也都这个顺序:conv->bn->relu;

对于特点2),为什么relu放在addition后面呢?按照常规,不是应该是图(3)这种么,那么我们接下来引出的问题就是:

图(3)的结构work么?

对于每个图右侧部分我们称作“residual”分支,左侧部分我们称作“identity”分支,如果relu作为“residual”分支的结尾,我们不难发现“residual”分支的结果永远非负,这样前向的时候输入会单调递增,从而会影响特征的表达能力,所以我们希望“residual”分支的结果应该在(-∞, +∞);这点也是我们以后设计网络时所要注意的。

对于图(3)不OK的情况,那如果把bn也挪到addition后面呢?如图(2),同时也保证了“residual”分支的取值范围?

这里bn改变了“identity”分支的分布,影响了信息的传递,在训练的时候会阻碍loss的下降;这里大家肯定又有个问题:

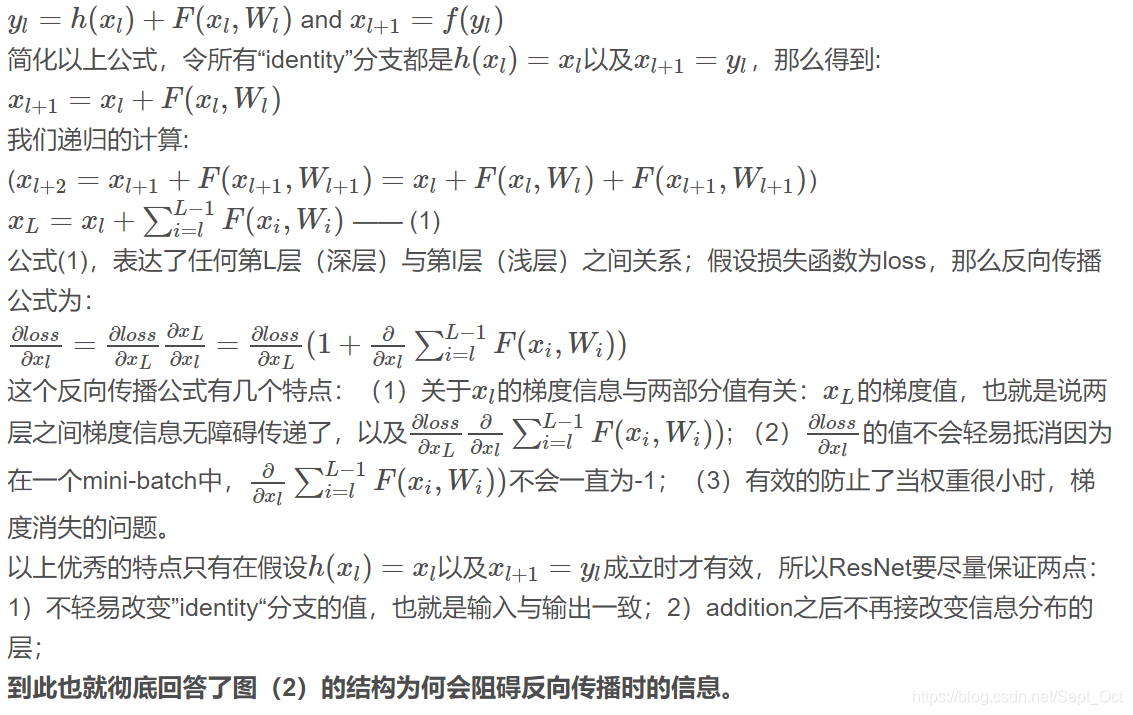

为什么“identity”分支发生变化,会影响信息传递,从而影响训练呢?

这里简单回顾resnet的公式:

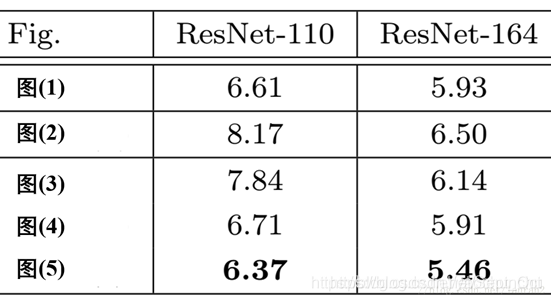

在分析图(4)和图(5)之前,我们引出一个概念:”post-activation”激活之后和”pre-activation”激活之前,其中post和pre的概念是相对于weight(conv)层来说的,那么我们不难发现,图(1), (2), (3)都是”post-activation”,图(4), (5)都是”pre-activation”,那么两种模式哪一个更好呢?这里我们就用实验结果说话。

上图是5种结构在Cifar10上的实验结果,一共实验了两种网络ResNet110和ResNet164。

从实验结果上,我们可以发现图(4)的结构与ResNet原结构伯仲之间,稍稍逊色,然而图(5)的结构却好于ResNet原结构。图5的结构好的原因在于两点:1)反向传播基本符合假设,信息传递无阻碍;2)BN层作为pre-activation,起到了正则化的作用;

最后我们通常把图5的结构称作ResNetV2,这里我们给出ResNetV1和ResNetV2结构:

本文详细介绍了ResNet深度残差网络,包括其解决网络退化问题的意义、两种结构及作用,对比了ResNet50和ResNet101的差异,阐述了基于ResNet101的Faster RCNN架构,还探讨了不同ResNet结构的特点和实验结果,如ResNetV2结构表现较好。

本文详细介绍了ResNet深度残差网络,包括其解决网络退化问题的意义、两种结构及作用,对比了ResNet50和ResNet101的差异,阐述了基于ResNet101的Faster RCNN架构,还探讨了不同ResNet结构的特点和实验结果,如ResNetV2结构表现较好。

3万+

3万+