MLP

以多层感知机为例,概述多层神经网络

隐藏层

此图为多层感知机的神经网络图,它含有一个隐藏层,该层中有5个隐藏单元。

表达公式

具体来说,给定一个小批量样本X∈Rn×d\boldsymbol{X} \in \mathbb{R}^{n \times d}X∈Rn×d,其批量大小为nnn,输入个数为ddd。假设多层感知机只有一个隐藏层【其中隐藏单元个数为hhh】记隐藏层的输出(也称为隐藏层变量或隐藏变量)为H\boldsymbol{H}H,有H∈Rn×h\boldsymbol{H} \in \mathbb{R}^{n \times h}H∈Rn×h。

因为隐藏层和输出层均是全连接层,可以设隐藏层的权重参数和偏差参数分别为Wh∈Rd×h\boldsymbol{W}_h \in \mathbb{R}^{d \times h}Wh∈Rd×h和 bh∈R1×h\boldsymbol{b}_h \in \mathbb{R}^{1 \times h}bh∈R1×h,输出层的权重和偏差参数分别为Wo∈Rh×q\boldsymbol{W}_o \in \mathbb{R}^{h \times q}Wo∈Rh×q和bo∈R1×q\boldsymbol{b}_o \in \mathbb{R}^{1 \times q}bo∈R1×q。

含单隐藏层的多层感知机的设计。其输出O∈Rn×q\boldsymbol{O} \in \mathbb{R}^{n \times q}O∈Rn×q的计算为

H=XWh+bh,O=HWo+bo, \begin{aligned} \boldsymbol{H} &= \boldsymbol{X} \boldsymbol{W}_h + \boldsymbol{b}_h,\\ \boldsymbol{O} &= \boldsymbol{H} \boldsymbol{W}_o + \boldsymbol{b}_o, \end{aligned} HO=XWh+bh,=HWo+bo,

也就是将隐藏层的输出直接作为输出层的输入。如果将以上两个式子联立起来,可以得到

O=(XWh+bh)Wo+bo=XWhWo+bhWo+bo. \boldsymbol{O} = (\boldsymbol{X} \boldsymbol{W}_h + \boldsymbol{b}_h)\boldsymbol{W}_o + \boldsymbol{b}_o = \boldsymbol{X} \boldsymbol{W}_h\boldsymbol{W}_o + \boldsymbol{b}_h \boldsymbol{W}_o + \boldsymbol{b}_o. O=(XWh+bh)Wo+bo=XWhWo+bhWo+bo.

存在的问题

- 虽然神经网络引入了隐藏层,却依然等价于一个单层神经网络

- 其中输出层权重参数为WhWo\boldsymbol{W}_h\boldsymbol{W}_oWhWo,偏差参数为bhWo+bo\boldsymbol{b}_h \boldsymbol{W}_o + \boldsymbol{b}_obhWo+bo、

结论:隐藏层未起到作用

激活函数

问题解释

全连接层只是对数据做仿射变换(affine transformation),而多个仿射变换的叠加仍然是一个仿射变换。

解决方法

引入非线性变换

Example:对隐藏变量使用按元素运算的非线性函数进行变换,然后再作为下一个全连接层的输入。

这个非线性函数被称为激活函数(activation function)。

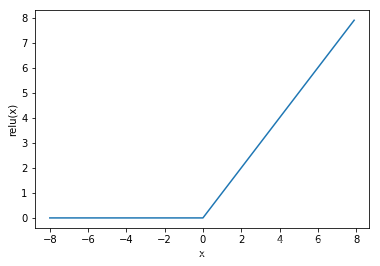

ReLU(rectified linear unit)函数提供了一个很简单的非线性变换。给定元素xxx,该函数定义为

ReLU(x)=max(x,0). \text{ReLU}(x) = \max(x, 0). ReLU(x)=max(x,0).

可以看出,ReLU函数只保留正数元素,并将负数元素清零。

sigmoid函数可以将元素的值变换到0和1之间:

sigmoid(x)=11+exp(−x). \text{sigmoid}(x) = \frac{1}{1 + \exp(-x)}. sigmoid(x)=1+exp(−x)1.

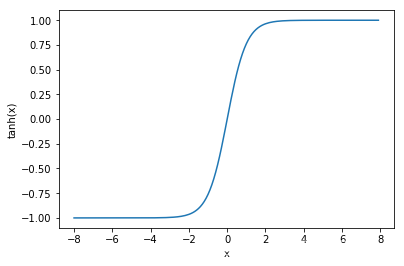

tanh(双曲正切)函数可以将元素的值变换到-1和1之间:

tanh(x)=1−exp(−2x)1+exp(−2x). \text{tanh}(x) = \frac{1 - \exp(-2x)}{1 + \exp(-2x)}. tanh(x)=1+exp(−2x)1−exp(−2x).

我们接着绘制tanh函数。当输入接近0时,tanh函数接近线性变换。虽然该函数的形状和sigmoid函数的形状很像,但tanh函数在坐标系的原点上对称。

激活函数的选择

ReLu函数是一个通用的激活函数,目前在大多数情况下使用。但是,ReLU函数只能在隐藏层中使用。

用于分类器时,sigmoid函数及其组合通常效果更好。由于梯度消失问题,有时要避免使用sigmoid和tanh函数。

在神经网络层数较多的时候,最好使用ReLu函数,ReLu函数比较简单计算量少,而sigmoid和tanh函数计算量大很多。

在选择激活函数的时候可以先选用ReLu函数如果效果不理想可以尝试其他激活函数。

那么之前表达式中输出O∈Rn×q\boldsymbol{O} \in \mathbb{R}^{n \times q}O∈Rn×q的计算变为:

H=ϕ(XWh+bh),O=HWo+bo, \begin{aligned} \boldsymbol{H} &= \phi(\boldsymbol{X} \boldsymbol{W}_h + \boldsymbol{b}_h),\\ \boldsymbol{O} &= \boldsymbol{H} \boldsymbol{W}_o + \boldsymbol{b}_o, \end{aligned} HO=ϕ(XWh+bh),=HWo+bo,

其中ϕ\phiϕ表示激活函数。

多层感知机实现

# import package and module

import torch

import numpy as np

import sys

sys.path.append("path to file storge d2lzh1981")

import d2lzh1981 as d2l

print(torch.__version__)

获取数据集

batch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size,

root='path to FashionMNIST.zip')

定义模型参数

num_inputs, num_outputs, num_hiddens = 784, 10, 256

W1 = torch.tensor(np.random.normal(0, 0.01, (num_inputs, num_hiddens)), dtype=torch.float)

b1 = torch.zeros(num_hiddens, dtype=torch.float)

W2 = torch.tensor(np.random.normal(0, 0.01, (num_hiddens, num_outputs)), dtype=torch.float)

b2 = torch.zeros(num_outputs, dtype=torch.float)

params = [W1, b1, W2, b2]

for param in params:

param.requires_grad_(requires_grad=True)

定义激活函数

def relu(X):

return torch.max(input=X, other=torch.tensor(0.0))

#进行0和X的大小比较

定义网络

def net(X):

X = X.view((-1, num_inputs))

H = relu(torch.matmul(X, W1) + b1)

return torch.matmul(H, W2) + b2

定义损失函数

loss = torch.nn.CrossEntropyLoss()

训练

num_epochs, lr = 5, 100.0

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, batch_size, params, lr)

多层感知机Pytorch简化

import torch

from torch import nn

from torch.nn import init

import numpy as np

import sys

sys.path.append("path to file storge d2lzh1981")

import d2lzh1981 as d2l

初始化模型参数

# init model and param

num_inputs, num_outputs, num_hiddens = 784, 10, 256

net = nn.Sequential(

d2l.FlattenLayer(),

nn.Linear(num_inputs, num_hiddens),

nn.ReLU(),

nn.Linear(num_hiddens, num_outputs),

)

for params in net.parameters():

init.normal_(params, mean=0, std=0.01)

训练

batch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size,root='path to FashionMNIST.zip')

loss = torch.nn.CrossEntropyLoss()

optimizer = torch.optim.SGD(net.parameters(), lr=0.5)

num_epochs = 5

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, batch_size, None, None, optimizer)

本文深入探讨了多层感知机(MLP)的工作原理,详细介绍了隐藏层的作用、激活函数的选择及其对神经网络性能的影响。通过对比不同的激活函数,如ReLU、Sigmoid和tanh,阐述了它们的特点和适用场景,特别强调了ReLU在深层网络中的优势。

本文深入探讨了多层感知机(MLP)的工作原理,详细介绍了隐藏层的作用、激活函数的选择及其对神经网络性能的影响。通过对比不同的激活函数,如ReLU、Sigmoid和tanh,阐述了它们的特点和适用场景,特别强调了ReLU在深层网络中的优势。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?