论文作者:Nan Jiang,Hongjie Li,Ziye Yuan,Zimo He,Yixin Chen,Tengyu Liu,Yixin Zhu,Siyuan Huang

作者单位:Peking University ;State Key Laboratory of General Artificial Intelligence, BIGAI

论文链接:http://arxiv.org/abs/2503.20724v1

内容简介:

1)方向:文本引导的运动编辑

2)应用:动画制作、虚拟角色控制、人机交互等

3)背景:现有的方法依赖于有限的预先收集的训练三元组,这在多样化的编辑任务中严重限制了其适用性,难以满足复杂的运动编辑需求。

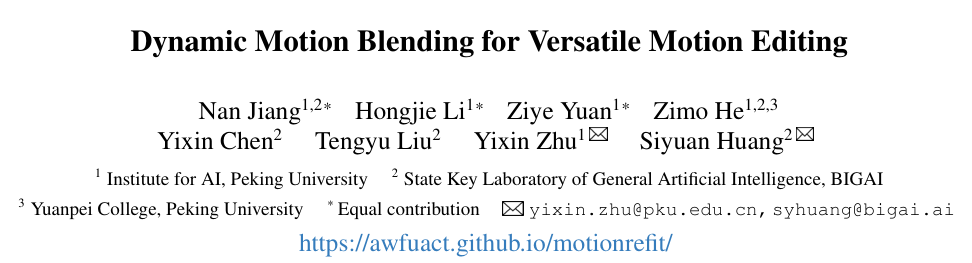

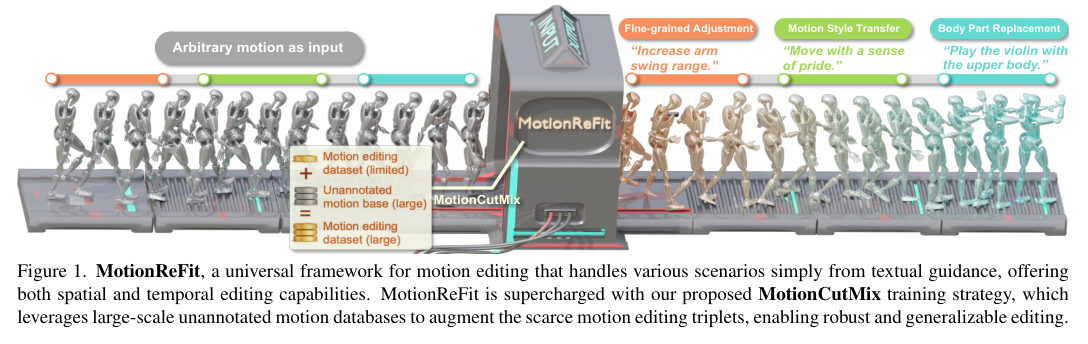

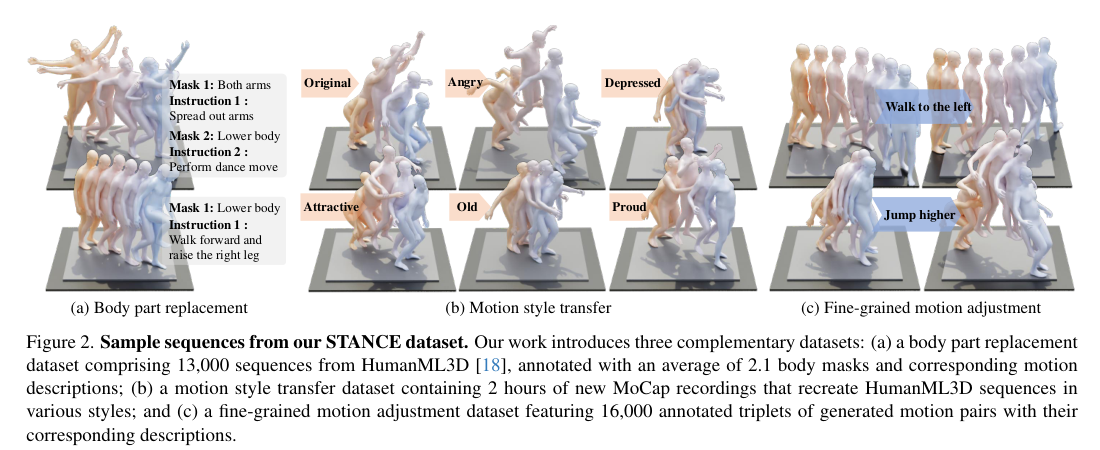

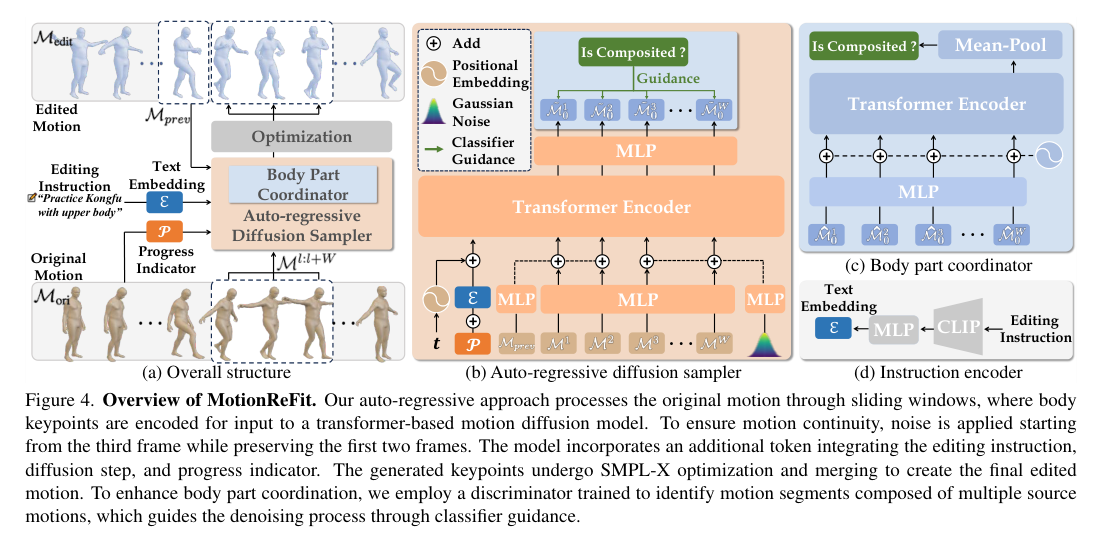

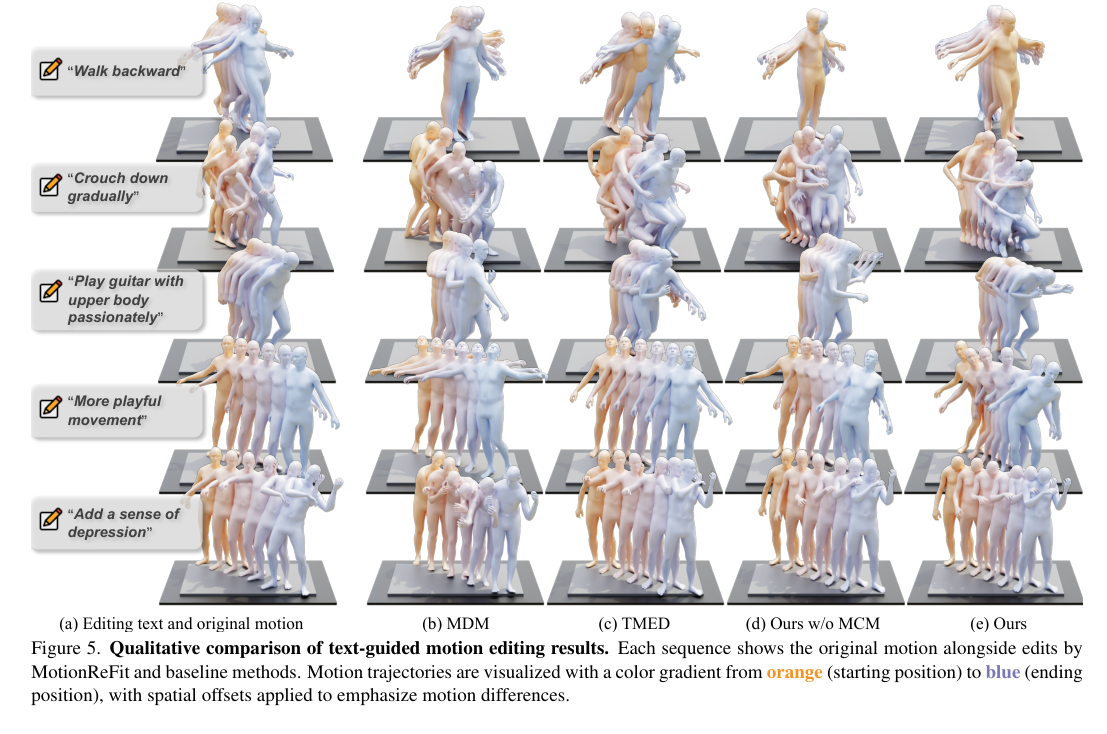

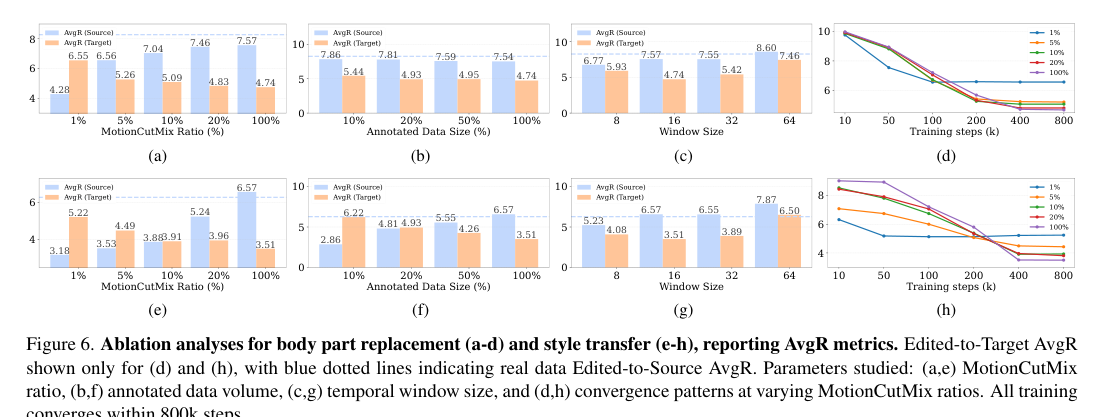

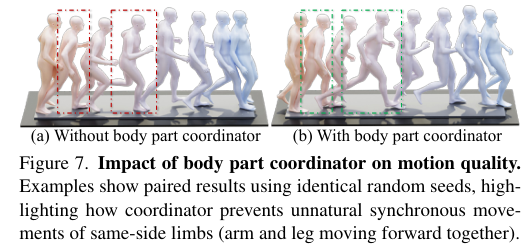

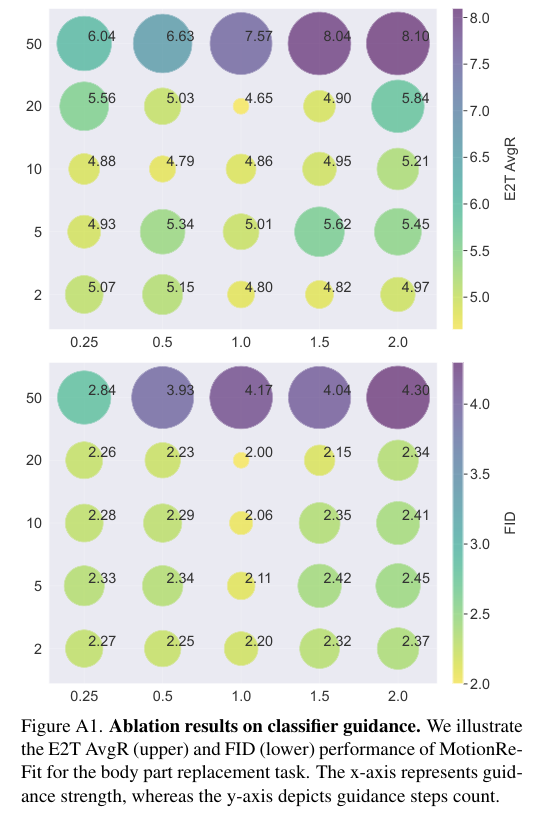

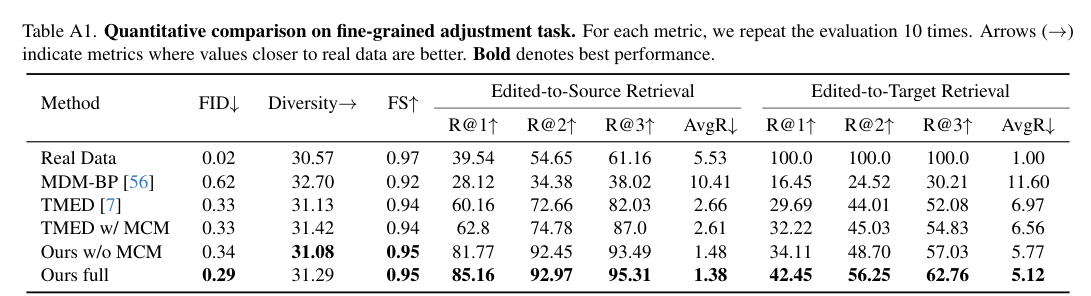

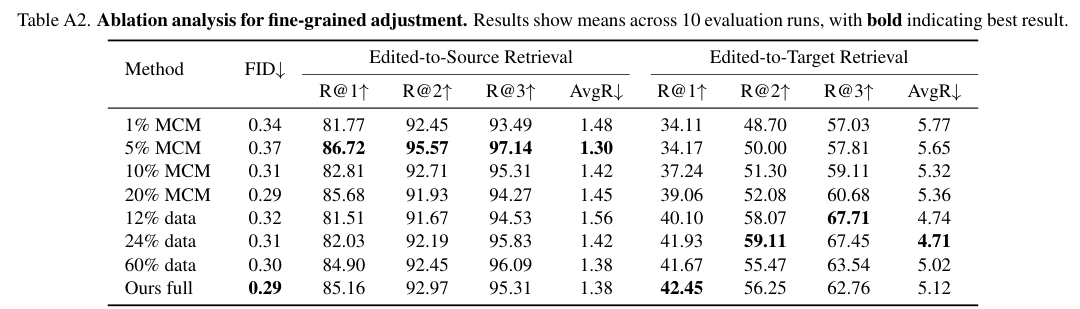

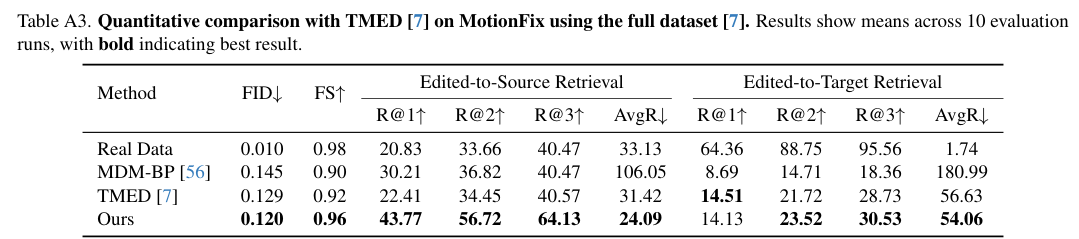

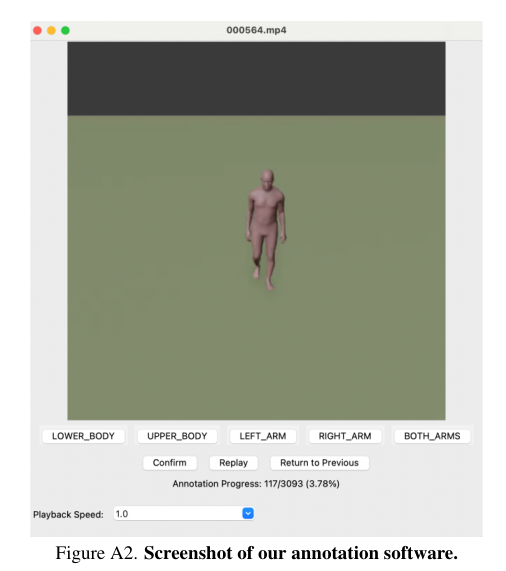

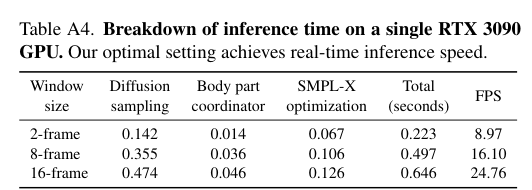

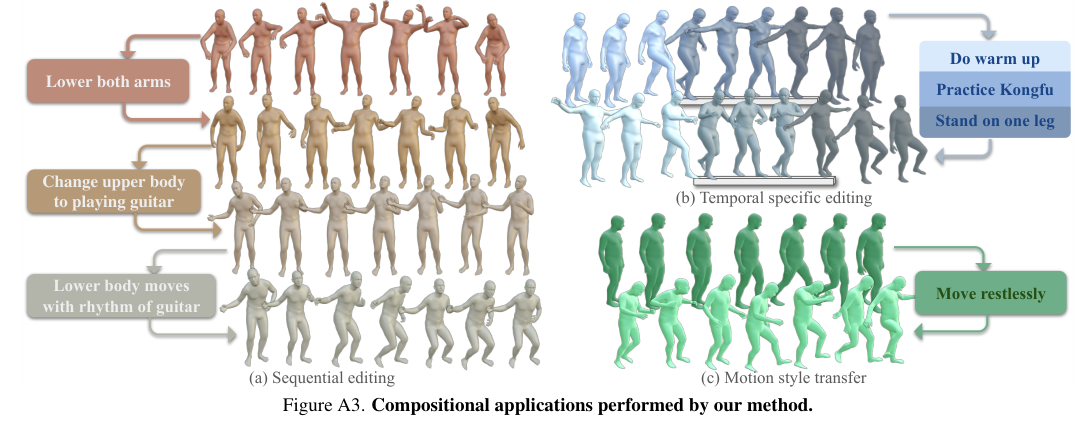

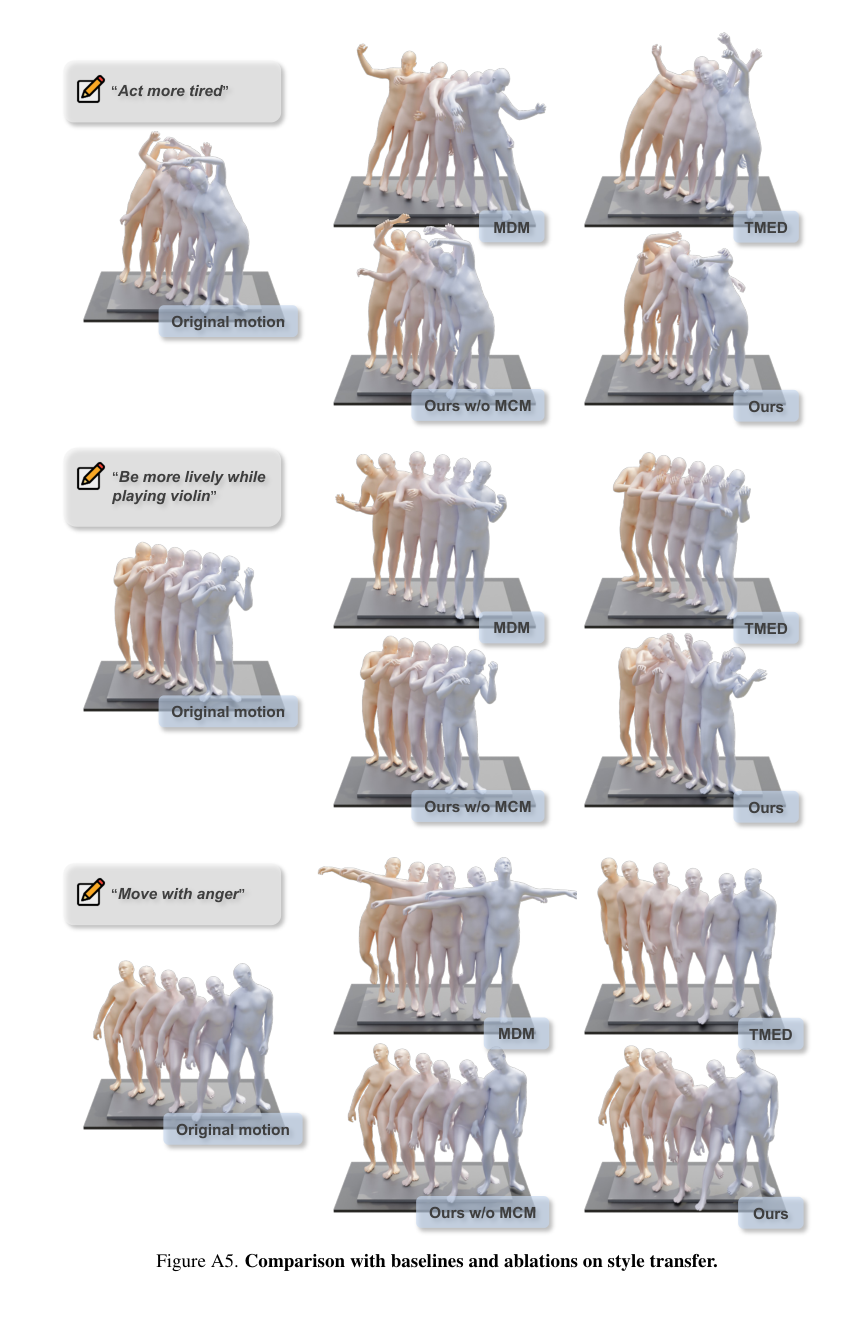

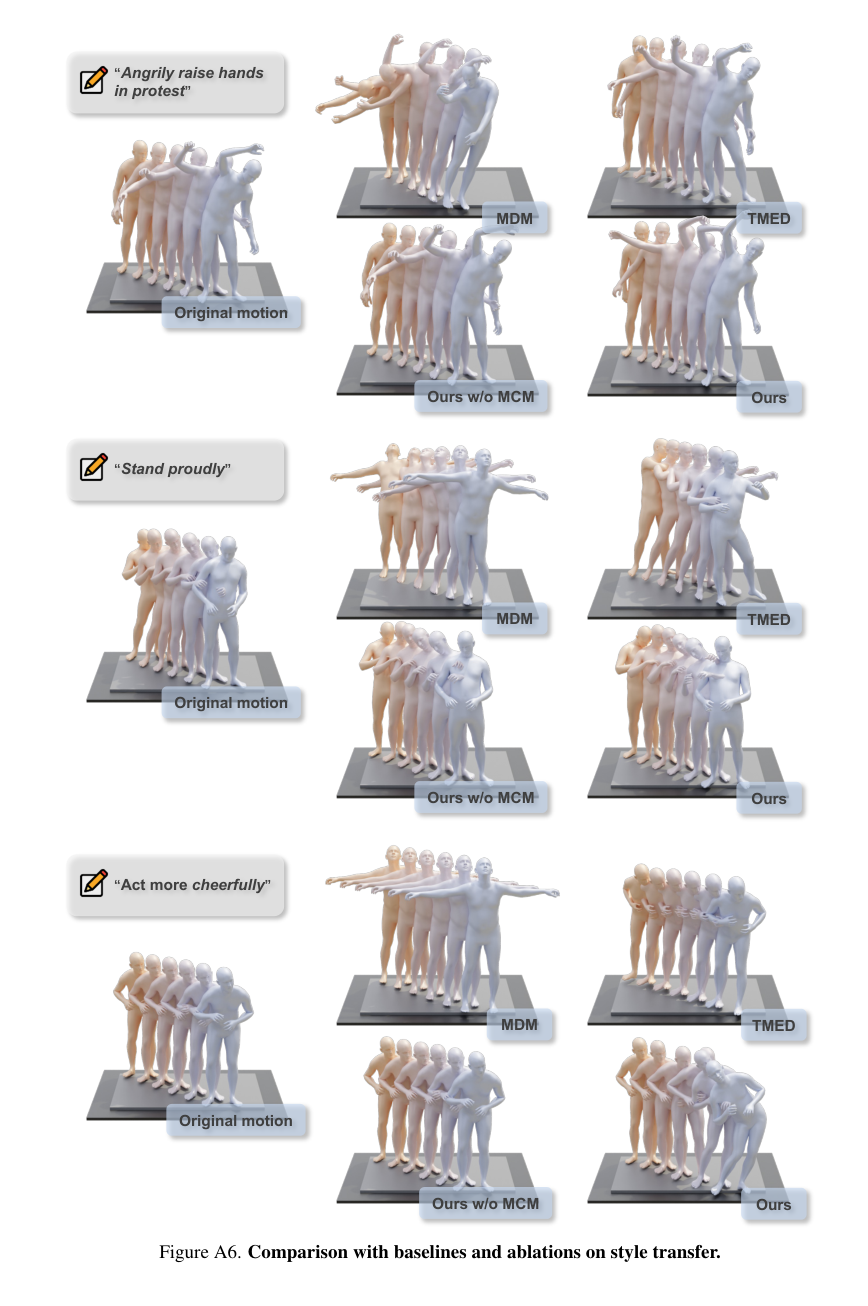

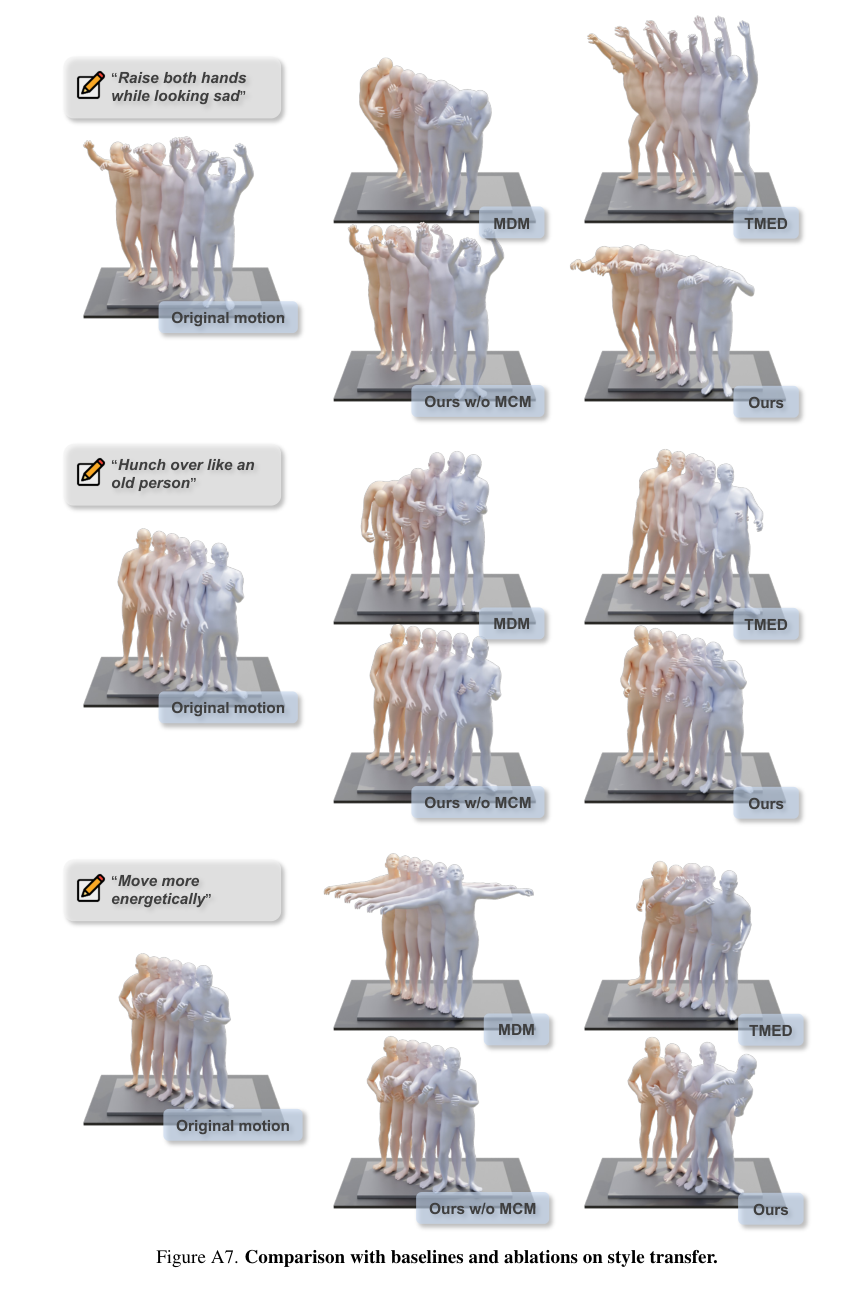

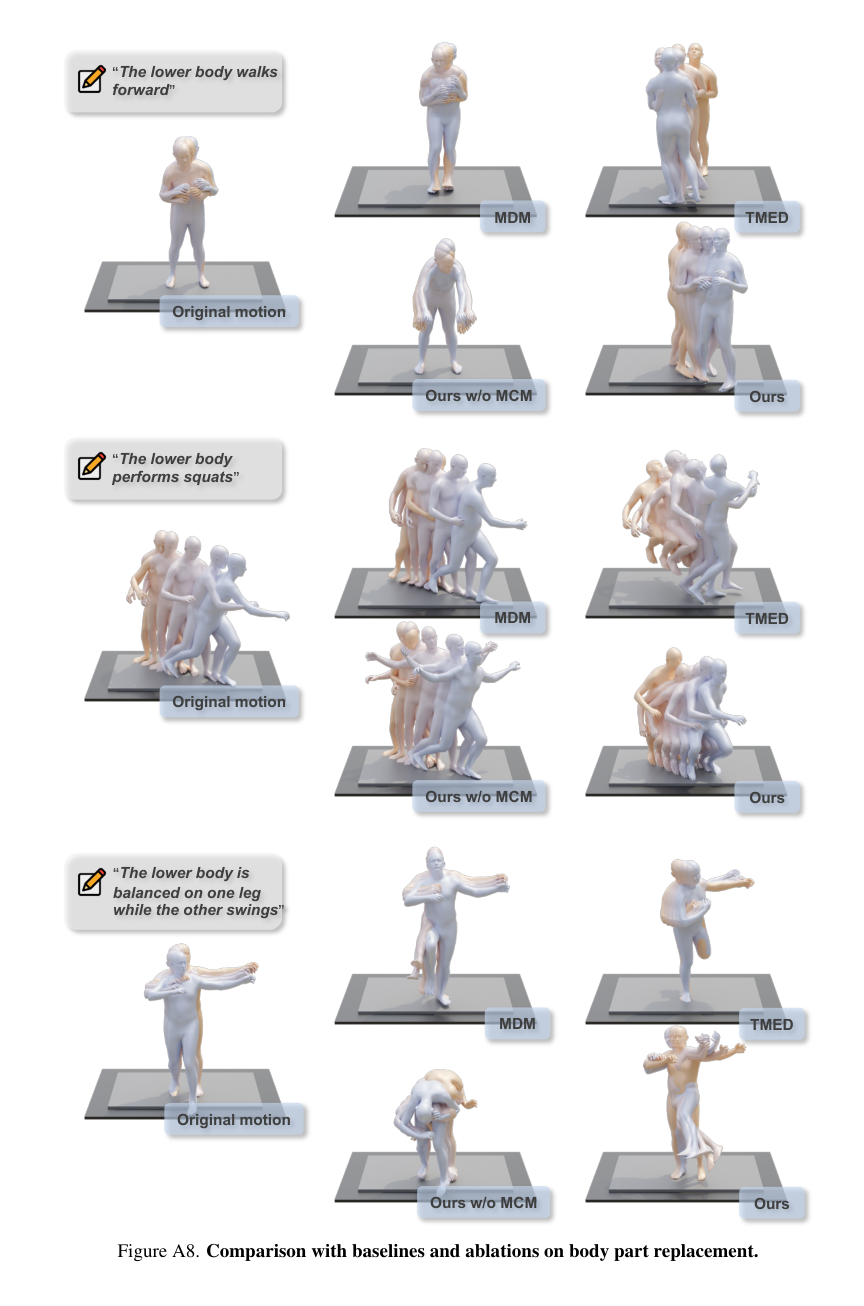

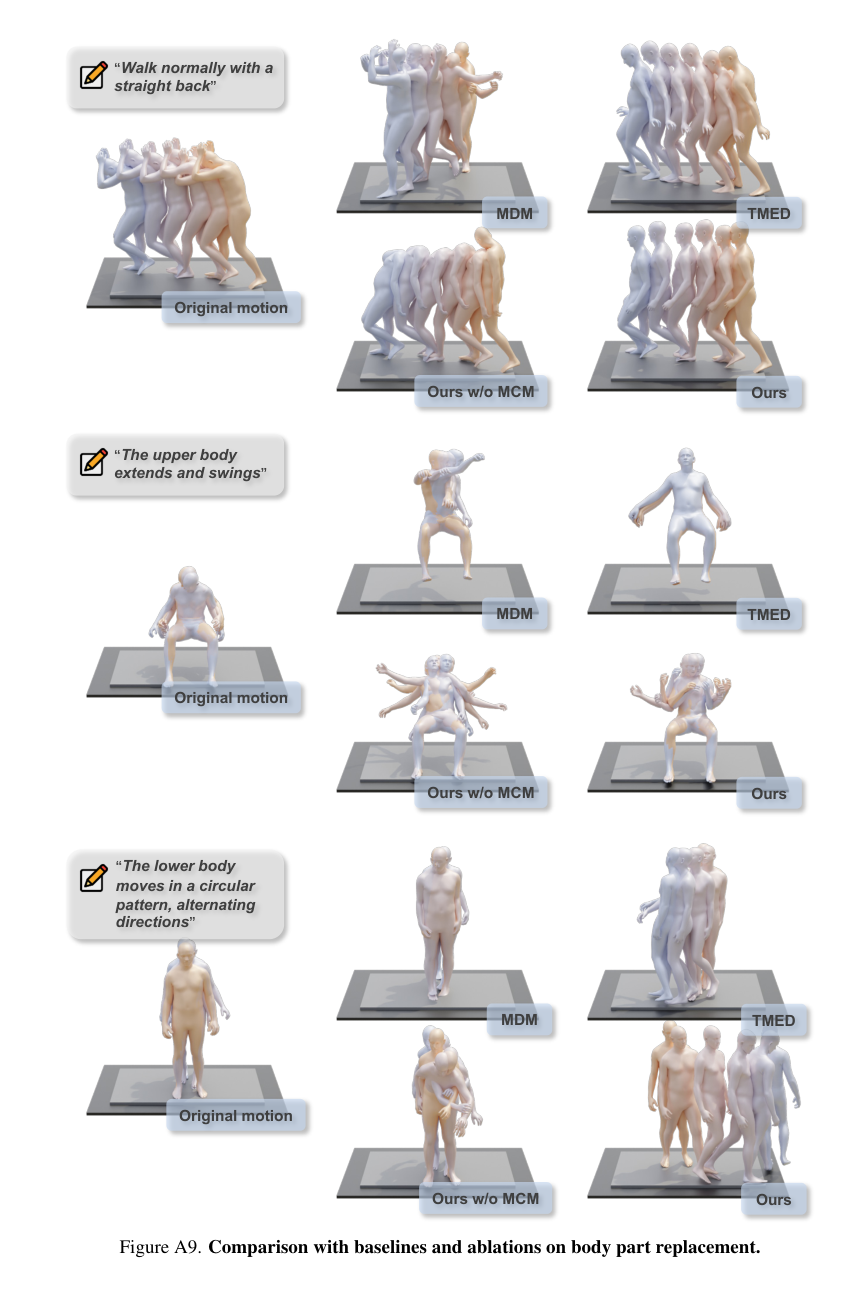

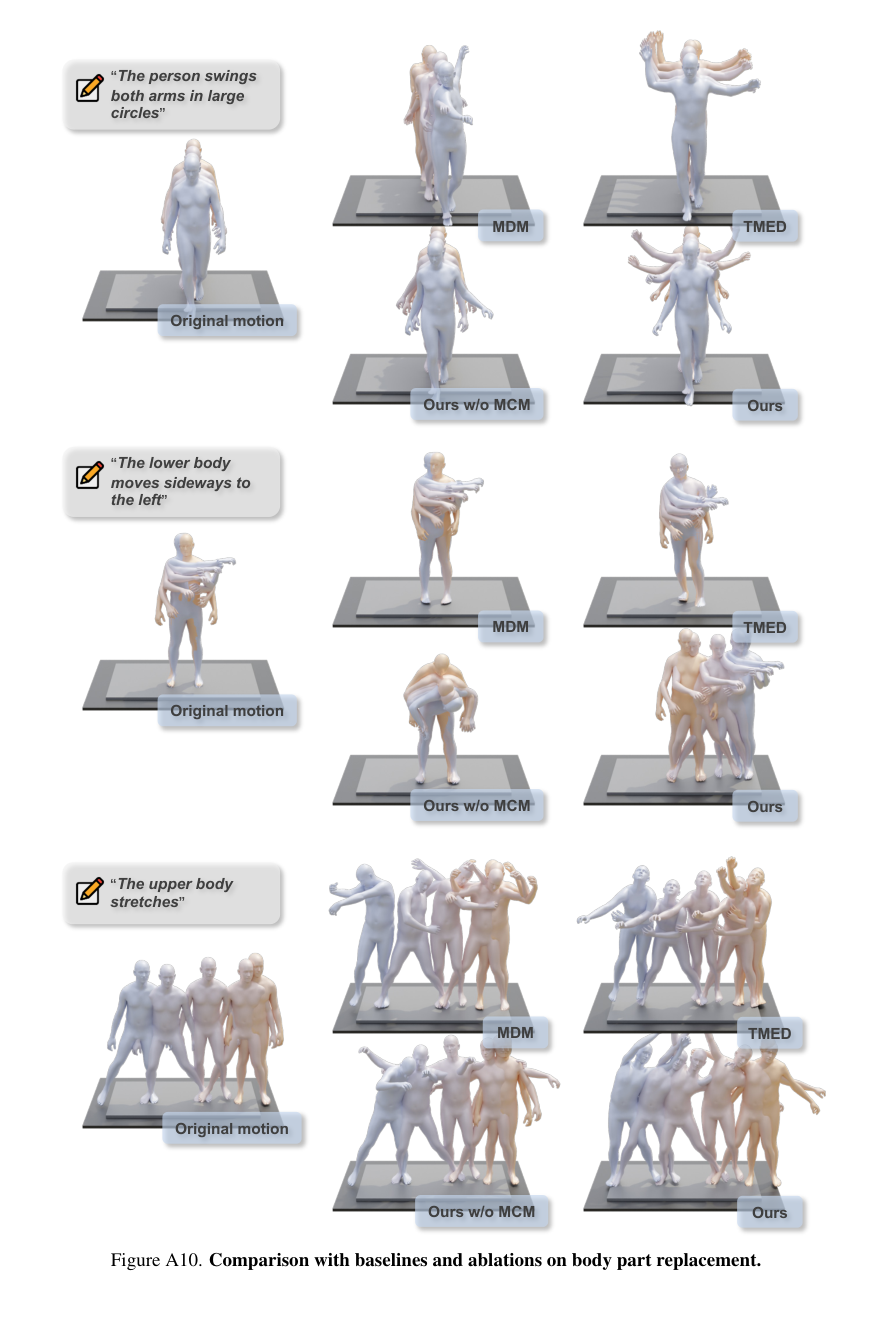

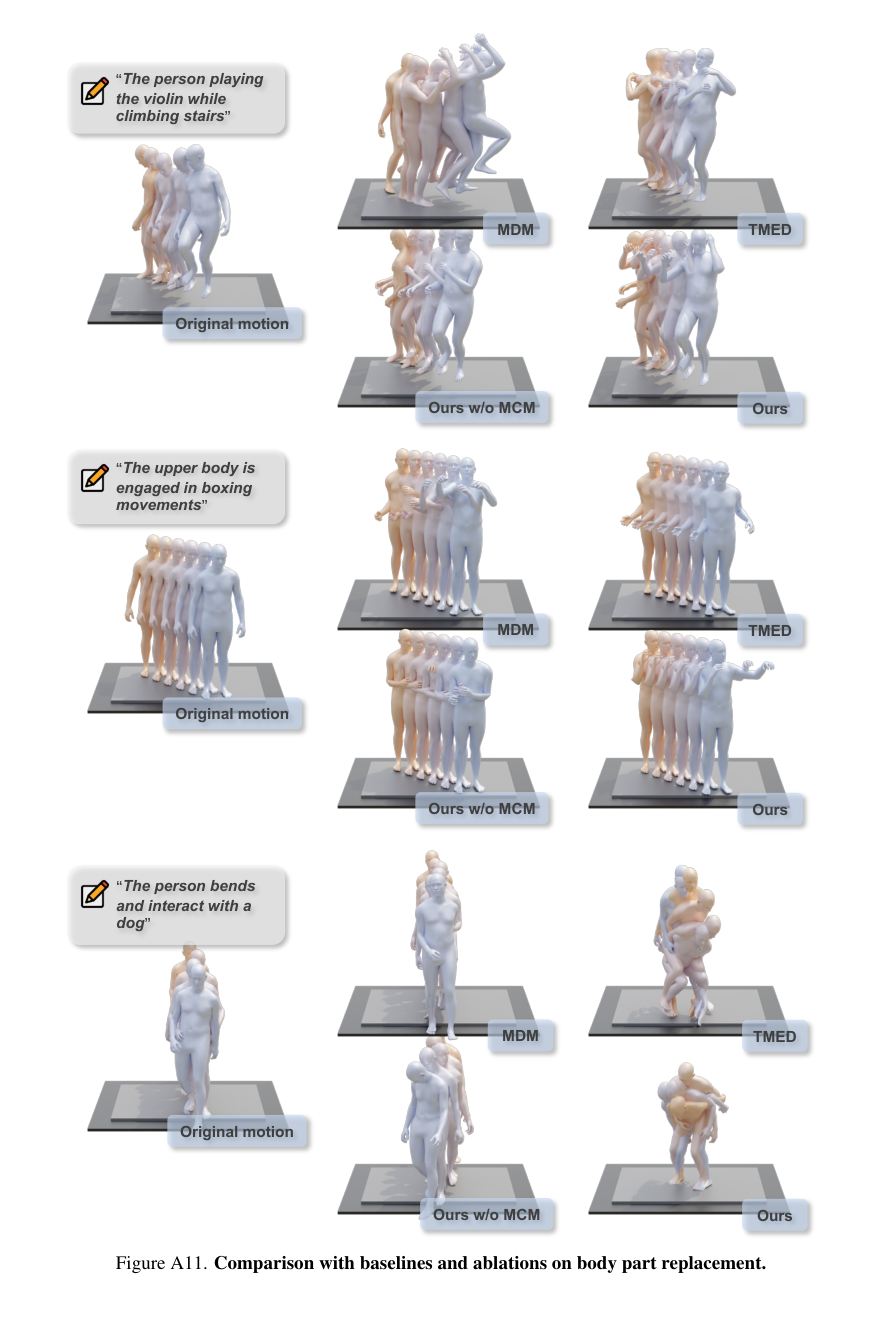

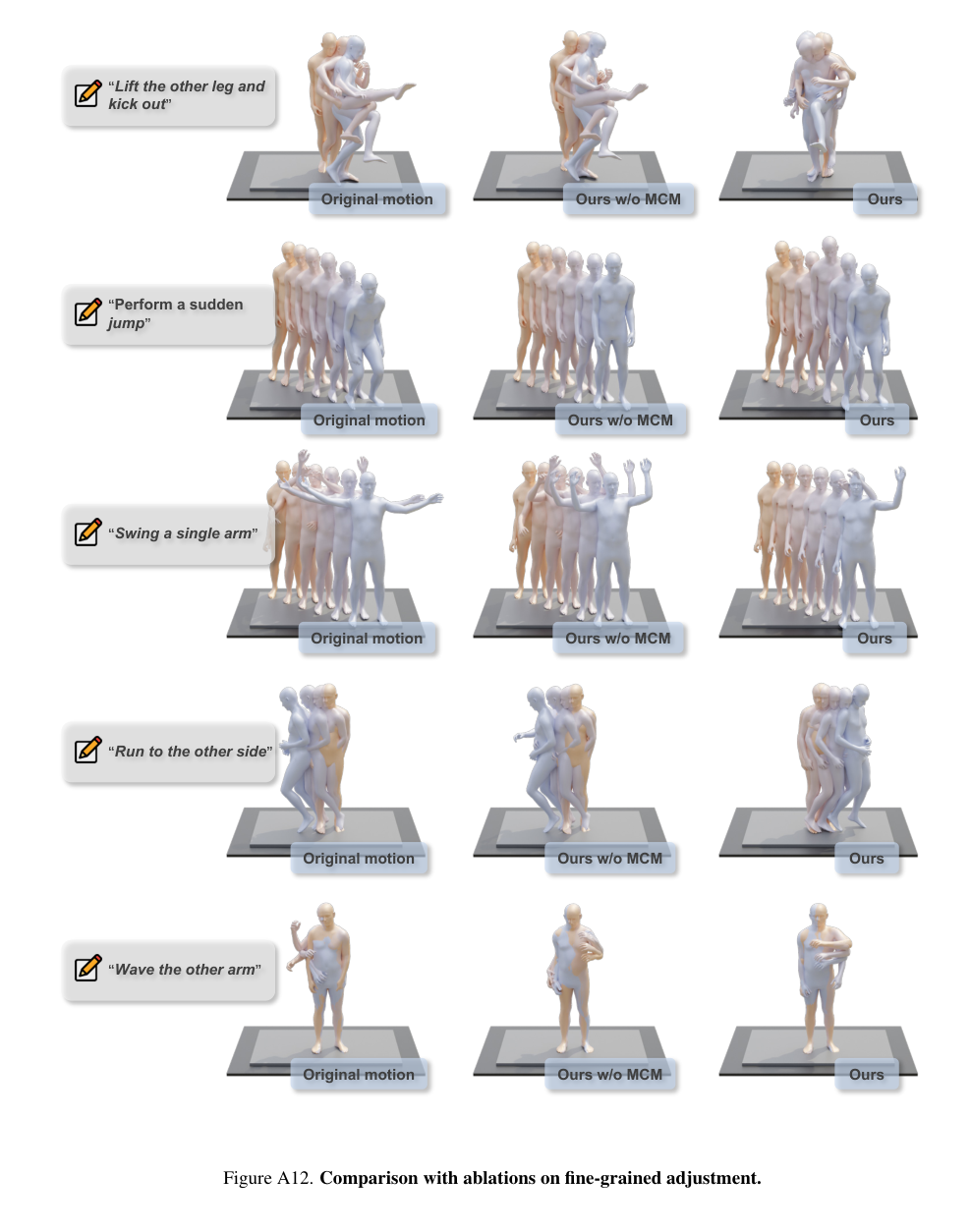

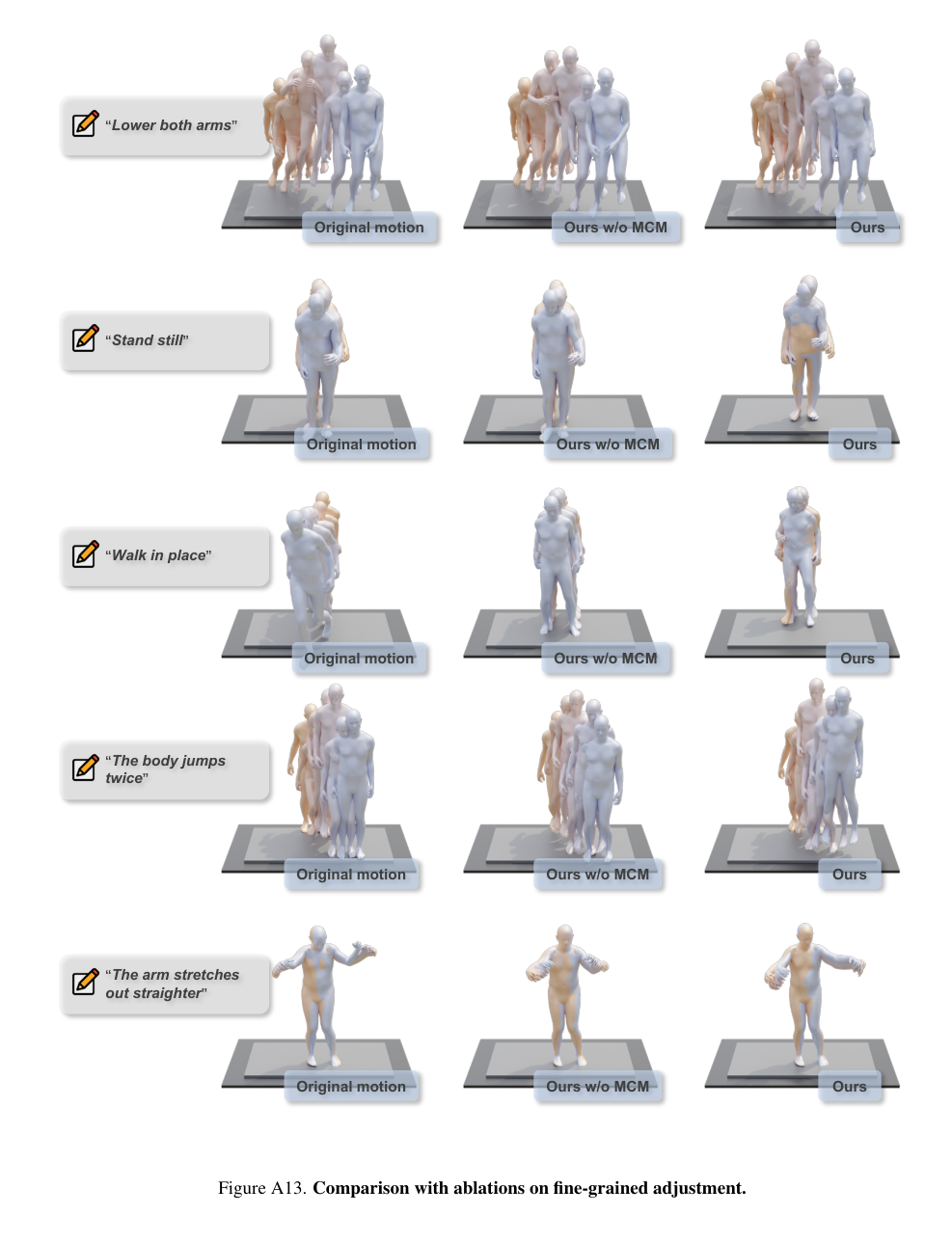

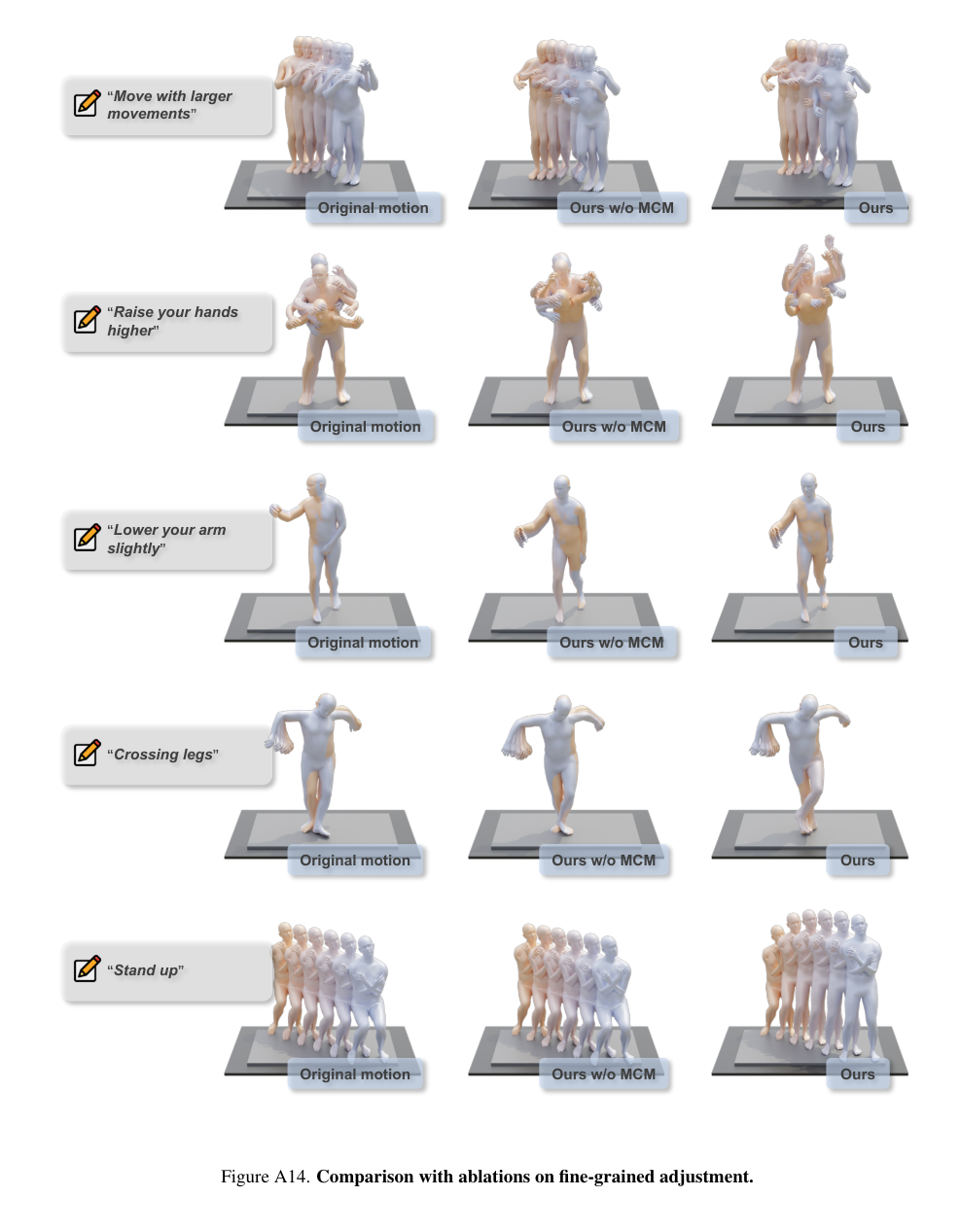

4)方法:本文提出 MotionCutMix 在线数据增强技术,通过基于输入文本动态组合不同身体部位的运动,扩展训练数据分布。此外,提出 MotionReFit,一个自回归扩散模型(auto-regressive diffusion model),并结合运动协调器(motion coordinator)以缓解运动组合带来的随机性和身体部位不协调问题。该方法可直接基于高级人类指令进行空间和时间上的运动编辑,而无需额外的详细规格或大型语言模型(LLM)的辅助。

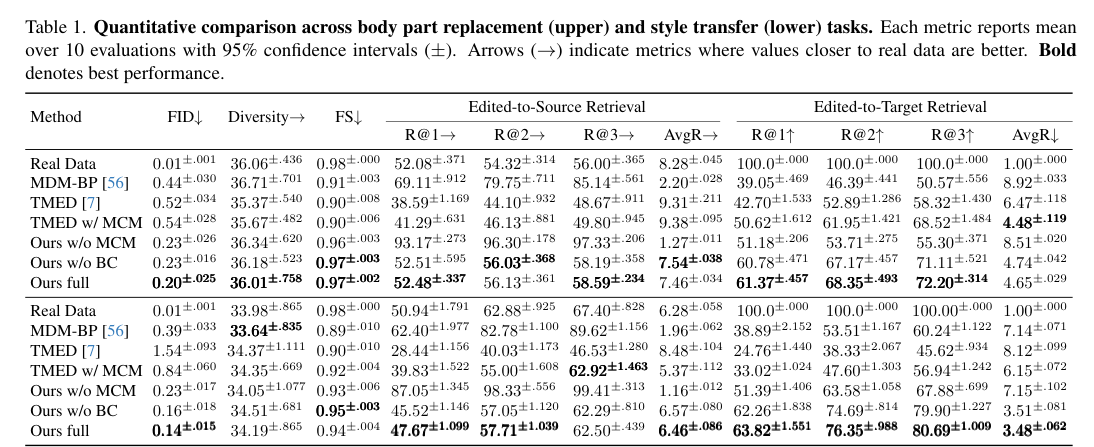

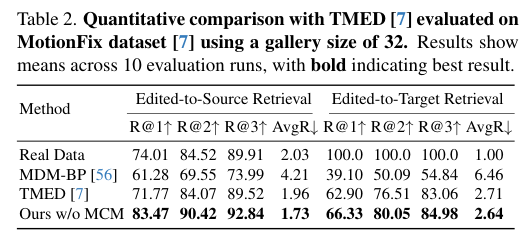

5)结果:实验表明,MotionReFit 在文本引导的运动编辑任务上达到了最先进的性能(state-of-the-art),展现出更优的编辑能力和运动协调性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?