青稞Talk:http://qingkeai.online/

原文:https://mp.weixin.qq.com/s/y2v8nIRVn4HEluLJgARcKg

Satori-SWE,一个旨在解决小尺寸语言模型(<70B)在复杂软件工程任务中性能瓶颈的系列工作。当前,这类模型相较于大型模型(>70B)表现不佳,且传统的 Test-Time Scaling 策略往往因需要生成大量样本而导致效率低下、成本高昂。

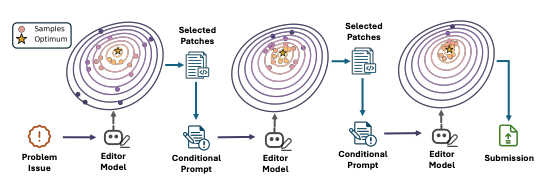

为应对这一挑战,我们提出了一种名为 “Evolutionary Test-Time Scaling” (EvoScale) 的新方法。EvoScale 的核心思想是将代码补丁(patch)的生成过程,从一次性的、低效的采样,转变为一个迭代式的“进化”过程。这种方法能以更少的样本数量,持续优化并生成高质量的解决方案。

Paper:Satori-SWE: Evolutionary Test-Time Scaling for Sample-Efficient Software Engineering

Abs:https://arxiv.org/abs/2505.23604

HuggingFace:https://huggingface.co/Satori-reasoning

Github:https://github.com/satori-reasoning/Satori-SWE

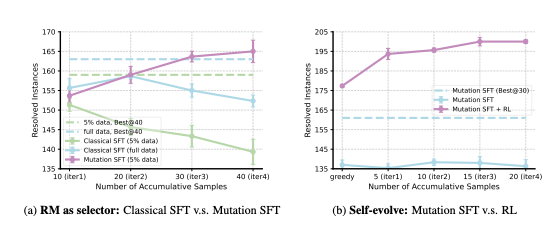

实现 EvoScale 的关键在于我们设计的两阶段SFT流程(classical SFT 和 mutation SFT),以及后续的针对性RL流程。其中,mutation SFT和RL 专门训练模型学习如何根据先前生成的不完美答案,进行自我修正与改进,从而有效地引导模型在测试时进行“进化”。

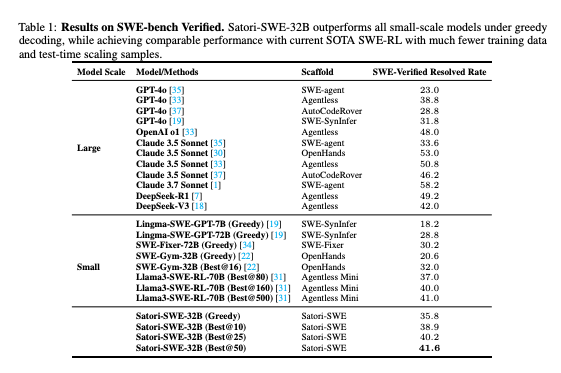

实验结果证明了该方法的有效性:我们的 Satori-SWE-32B 模型,在极具挑战性的 SWE-Bench-Verified 基准上,以显著更低的样本复杂度,取得了与70B+ 级别模型相媲美的性能。

7月5日(周六)上午10:00,青稞Talk 第60期,新加坡科技设计大学博士生曾广韬,将直播分享《Satori-SWE:用 Evolutionary Test-Time Scaling 让小语言模型解决复杂软件工程》。

分享嘉宾

曾广韬,新加坡科技设计大学的四年级博士生,研究方向为 Large Language Model 以及 Reasoning;在ACL、EMNLP等顶级会议和期刊上,以第一作者或共同第一作者的身份发表了5+ 篇论文,其谷歌学术引用量超过1000次 。

主题提纲

Satori-SWE:用 Evolutionary Test-Time Scaling 让小语言模型解决复杂软件工程

1、小语言模型的性能瓶颈

2、EvoScale:从 patch 生成转变为迭代式“进化”过程

3、classical SFT、mutation SFT 和针对性 RL 流程解析

4、Satori-SWE-32B 模型性能验证

直播时间

7月5日(周六)上午10:00 - 11:00

850

850

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?