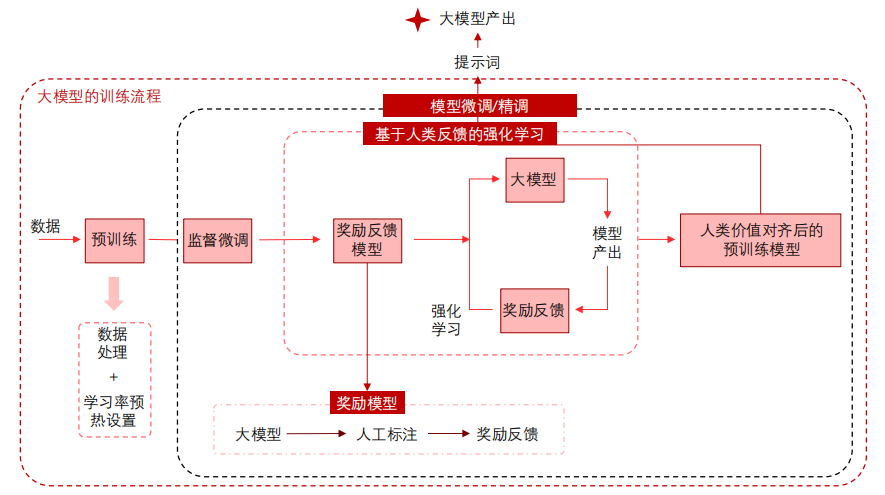

预训练大模型的价值在于利用海量、多样化语料提取深度通用知识与语义表示,从而大幅提升微调效率与模型泛化能力,显著降低算力与开发成本,后训练流程包括监督微调、奖励模型训练与PPO强化学习。目的是通过融合人工偏好反馈与强化学习优化生成策略,以提升模型的对话质量、安全性和人类意图对齐度。

大模型训练层——大模型训练全流程框架

大模型训练的全流程框架,是一个先通过预训练和监督微调构建模型的基础能力,再通过人类反馈强化学习完成关键价值对齐的系统性工程。

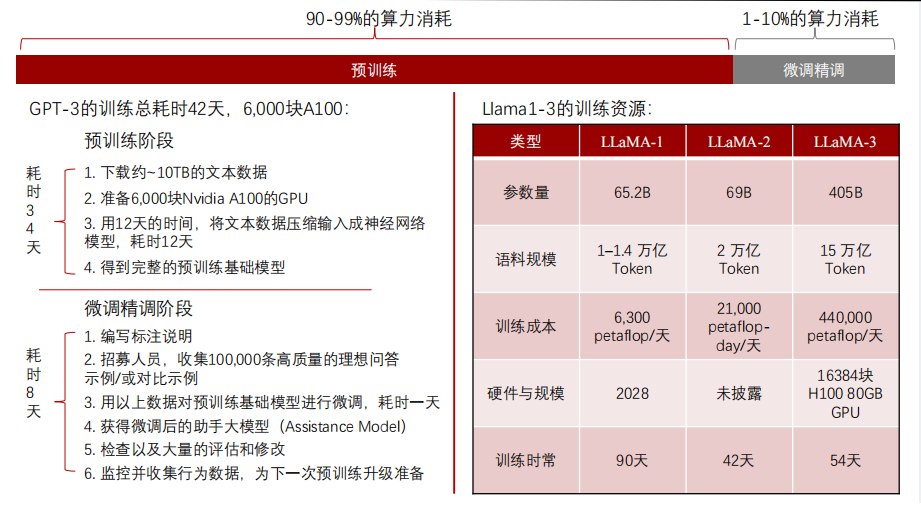

大模型训练层——大模型训练阶段的资源消耗

大模型训练阶段消耗的资源主要集中在预训练阶段,需要数千至上万块GPU并行运算、处理千亿级至万亿级Token数据、耗时数周至数月,占总算力消耗的90-99%。

大模型训练需要海量算力、存储和数据资源,其中预训练阶段往往消耗了总算力的90-99%及绝大部分时间:要下载并处理数TB级文本语料,调度数千乃至上万块GPU持续数周至数月完成基础参数学习;而微调阶段因仅需在已有模型上进行少量梯度更新与标注评估,其算力消耗仅占1-10%,典型周期也缩短至几日或一周左右。

以GPT-3为例,其在6,000块A100 GPU上投入约34天完成预训练,后续微调阶段又耗时8天,总计42天;LLaMA系列则更具代表性:LLaMA-1在约2,028块GPU上用90天训练1-1.4万亿Token,LLaMA-2则在42天内完成2万亿Token的预训练,LLaMA-3动用约16,384块H100 GPU在54天内训练15万亿Token。

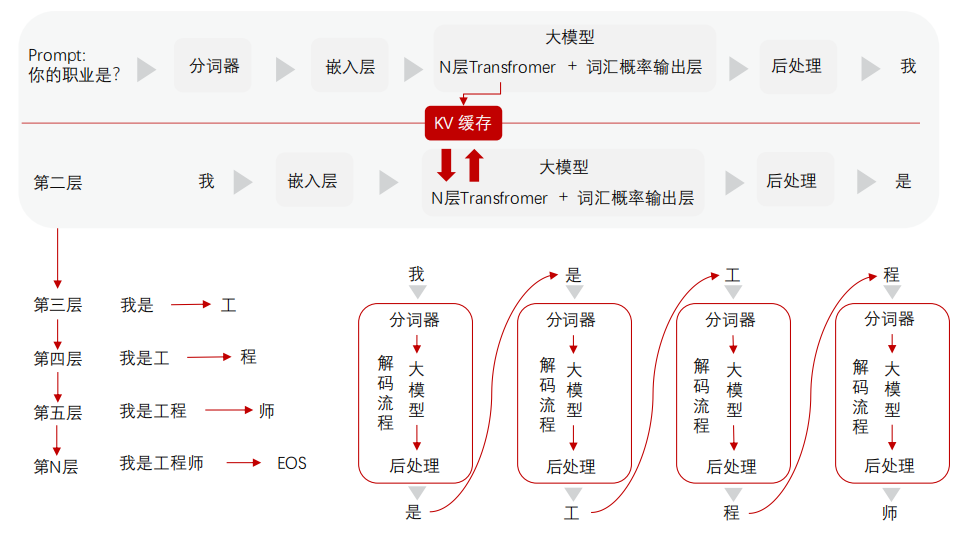

大模型推理层——大模型推理阶段流程框架

大模型推理的流程为输入文本先经分词和嵌入层映射为向量,通过多层Transformer的自注意力计算并结合KV缓存提升性能,再在词汇概率输出层生成并通过后处理拼接成完整文本。

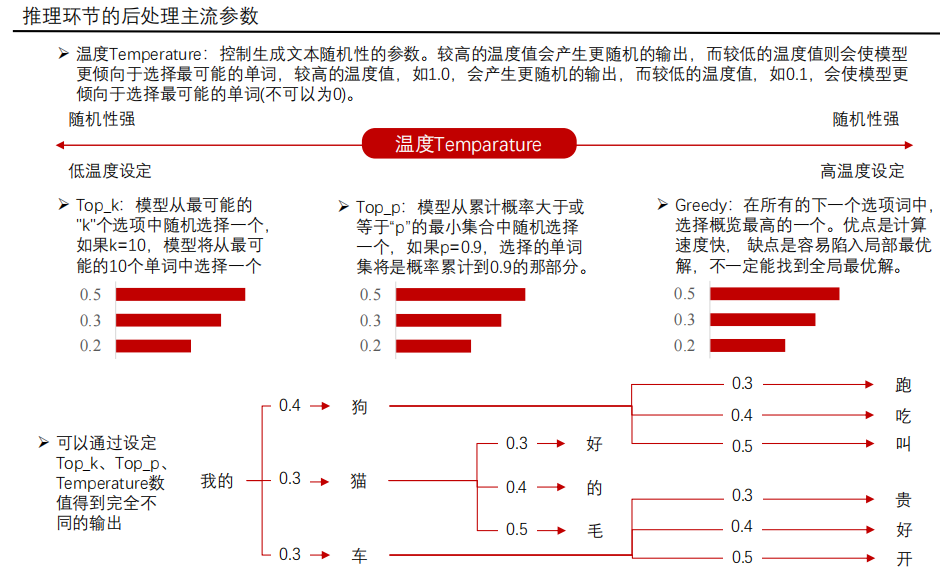

大模型推理层——大模型推理阶段主流参数

大模型推理后处理技术是通过温度采样、Top-k/Top-p裁剪与贪心选择对输出概率分布进行调控,为了在生成多样性、语义连贯性与输出稳定性之间实现最佳平衡。

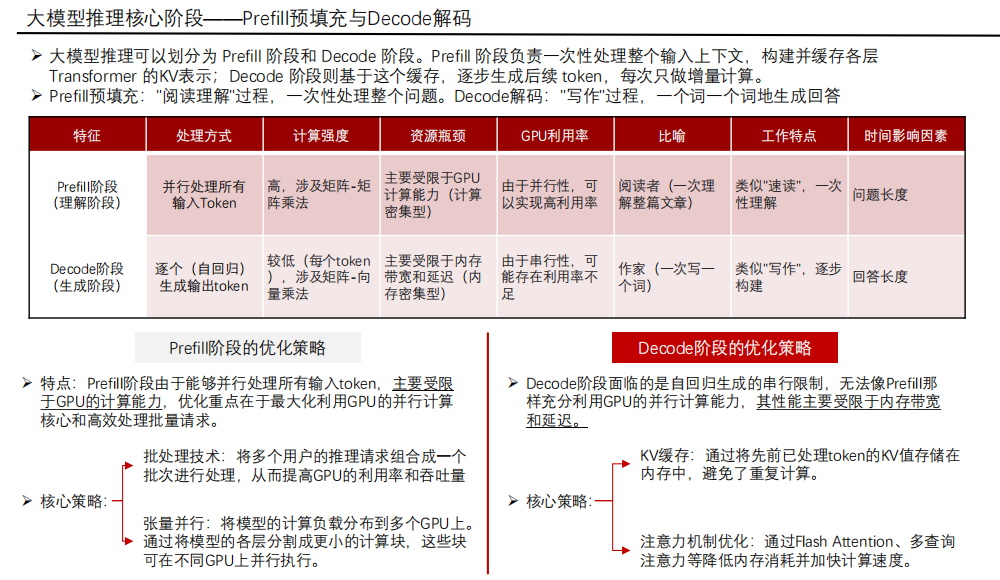

大模型推理层——大模型推理核心阶段

大模型推理分为并行Prefill与增量Decode两阶段,分别依托模型并行与批量吞吐、以及KV缓存与注意力优化,实现了高效低延迟的推理流水线。

大模型推理阶段Prefill和Decode是两大核心阶段,Prefill阶段负责一次性并行处理所有输入token,通过多层Transformer计算并构建KV缓存,以“速读”形式完整理解上下文;Decode阶段则采用自回归方式逐token生成输出,每次仅做增量推理并依托前序缓存,类似“逐字成文”地写出答案。

根据两阶段的资源与计算特性,需分别制定优化策略:对Prefill阶段,应强化GPU计算吞吐——通过批量合并多个请求提升并行度,并运用模型并行将Transformer层切分至多块GPU;对Decode阶段,则侧重内存与延迟优化——利用KV缓存避免重复计算,并引入Flash Attention、多查询注意力等技术以降低内存带宽占用和加速串行推理。

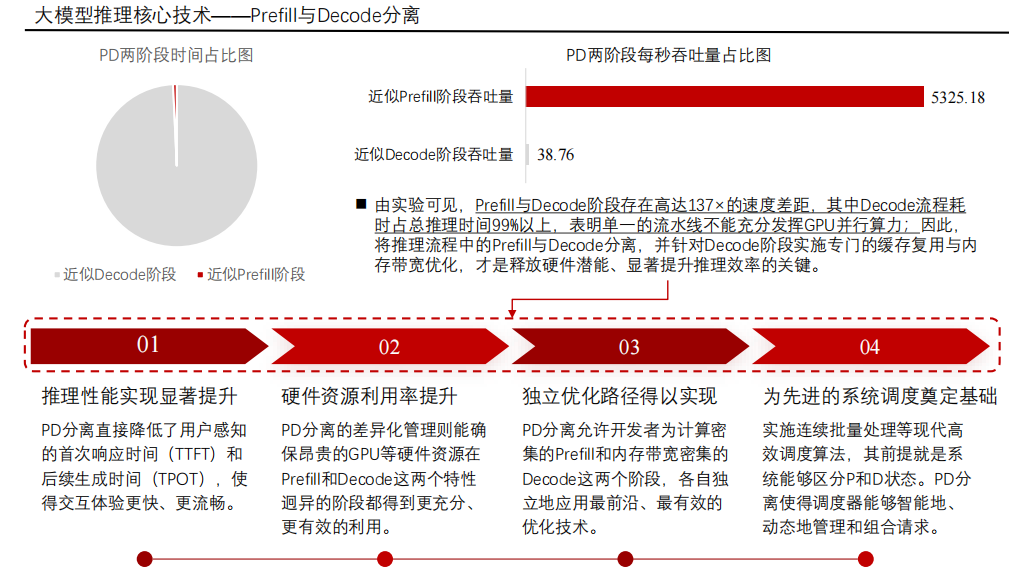

大模型推理层——大模型推理PD分离技术

PD分离是将一次性上下文预填充与逐token串行解码解耦的策略,实现了GPU算力的精准调度与高效利用,显著降低了响应延迟并提升了整体推理吞吐率。

传统推理流程将Prefill阶段与Decode阶段一体化处理,导致Decode无法发挥GPU的并行计算能力,其耗时占总推理时间超过99%,既造成响应延迟极高,也让海量算力资源在生成过程中严重浪费。

而PD分离策略将Prefill与Decode解耦后,能够为两阶段分别应用最优调度:Prefill可批量合并请求、最大化GPU并行吞吐,显著缩短首次响应时间(TTFT);Decode则依托KV缓存、内存带宽优化及专用流水线,大幅提升后续生成速率(TPOT)。这一分离不仅显著提升整体推理性能和资源利用率,还为独立的分阶段优化与系统级智能调度奠定了坚实基础。

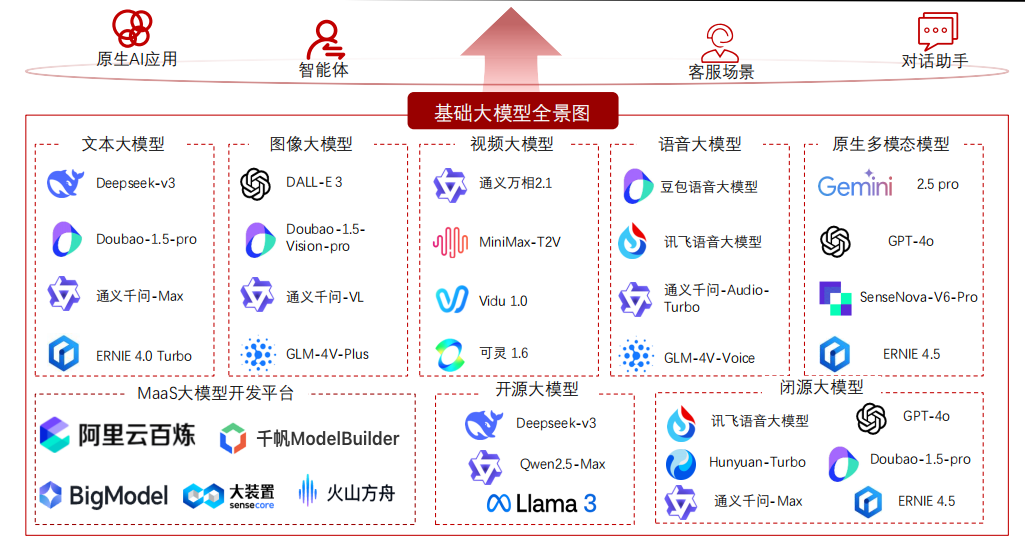

基础大模型市场洞察——基础大模型全景图谱

全球大模型产业呈现出“技术终局趋同,商业路径分化”的核心格局 所有厂商均以原生多模态为统一演进目标,但在实现路径上则分裂为闭源平台与开源生态两大阵营。

无论是中国还是海外的头部厂商,其技术演进路线均明确指向原生多模态,即从处理单一信息类型向融合处理文本、视觉、听觉的统一智能体演进,以GPT-4o和Gemini为代表的模型已成为业界共同追逐的技术标杆。

市场正沿着两条不同的商业化道路分野,一是以闭源模型和MaaS平台为核心的“平台生态化”路径,旨在构建高价值、高粘性的商业闭环;二是以Llama、Qwen、Deepseek为代表的“开源普惠化”路径,旨在通过开放技术、构建广泛的开发者社区来赢得市场,这两种路径的博弈与共存定义了当前的市场竞争格局。

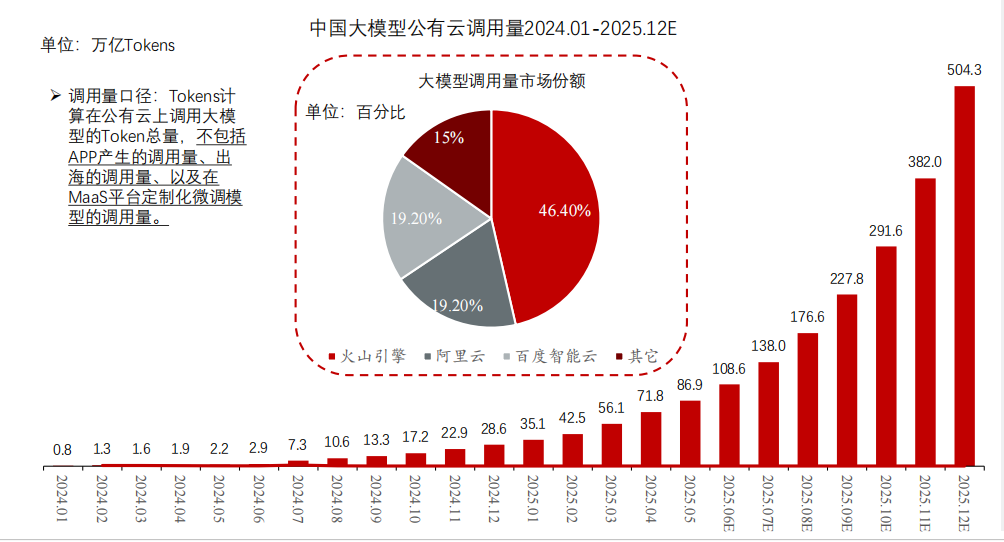

随着大模型进入指数级增长的产业应用期,市场调用量正迅速向具备云基础设施与海量应用场景双重优势的头部厂商归拢

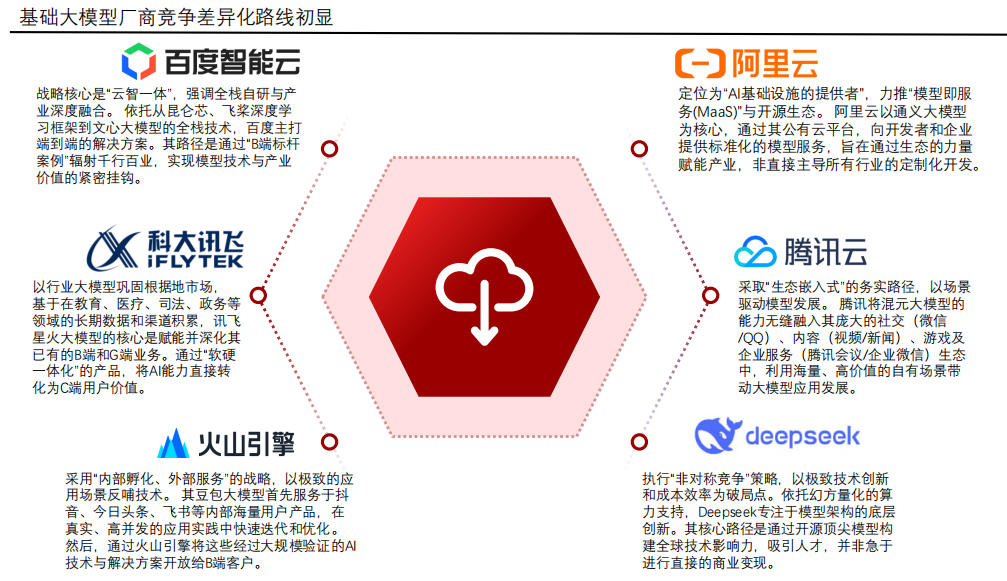

基础大模型市场洞察——基础大模型厂商竞争差异化路线初显

大模型厂商正告别技术参数与价格的同质化内卷,全面转向一个依托各自核心禀赋、展开差异化战略竞争的新阶段

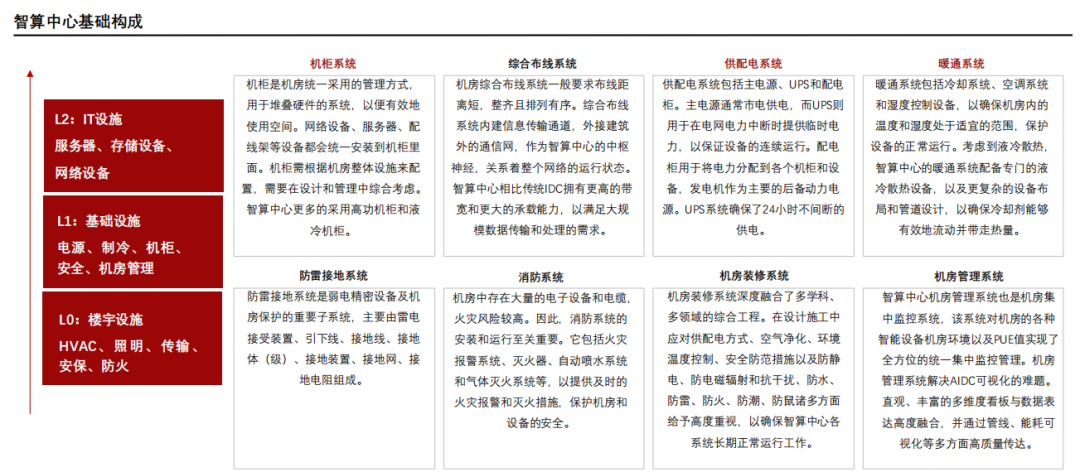

大模型基础设施层——智算中心基础构成

智算中心的底层基础设施体系高度复杂,涵盖供配电、制冷、机柜、布线、防雷、防火等多系统协同,核心在于保障算力设备的高可用性与稳定运行。

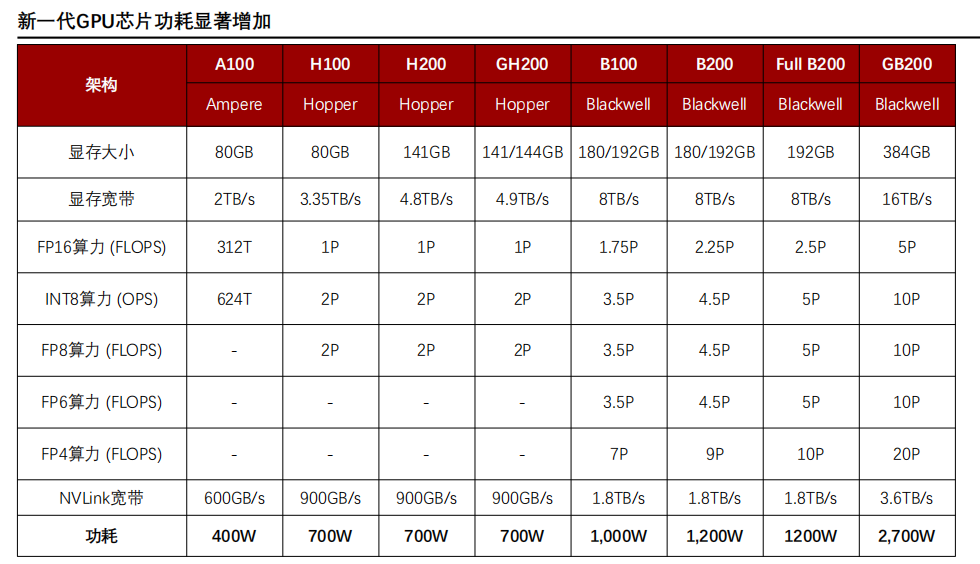

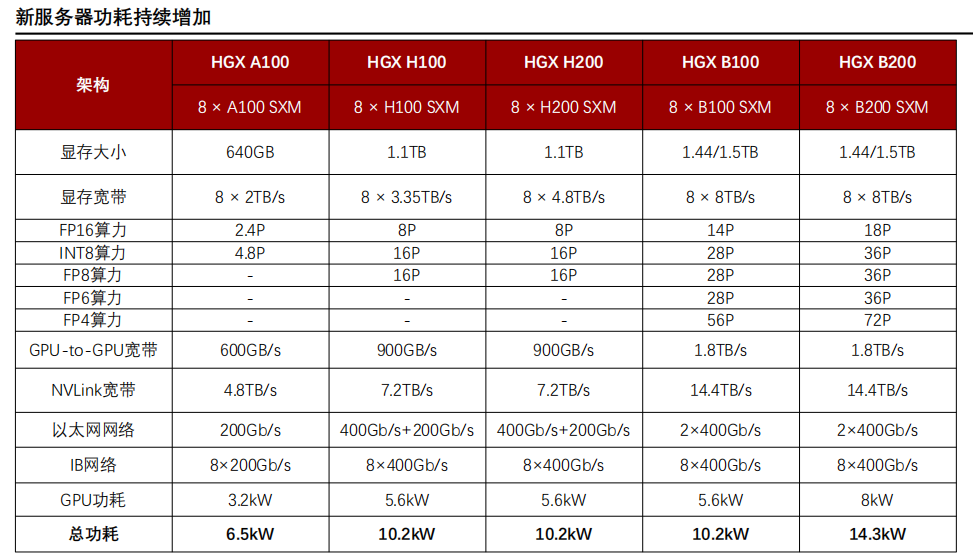

大模型基础设施层——GPU芯片功耗增加

新一代GPU芯片以精度可调、互联增强与极限功耗为特征,在大幅释放Al算力的同时,对智算基础设施提出结构性重构要求。

NVIDIA新一代GPU芯片从Ampere(A100)到Hopper(H100、H200、GH200)再到Blackwell(B100、B200、GB200)架构的跨代演进路径,突显出其在AI时代对大模型训练与推理需求的系统性回应。

核心算力指标如FP16、INT8、FP8等在Blackwell架构下呈现倍数级增长,尤其在FP4/FP6低精度计算能力上显著提升,反映出面向AI大模型推理与训练的新架构已全面向极致性能和高能效比优化。此外,显存带宽从A100的2TB/s提升至GB200的16TB/s,NVLink也翻倍扩展至3.6TB/s,旨在支撑大模型分布式并行训练需求。而功耗亦同步激增至2700W,表明下一代GPU将显著推高智算中心在电力、散热和系统设计方面的基础设施门槛,对系统集成商提出更高挑战,也加速数据中心向液冷与高密度部署形态演进。

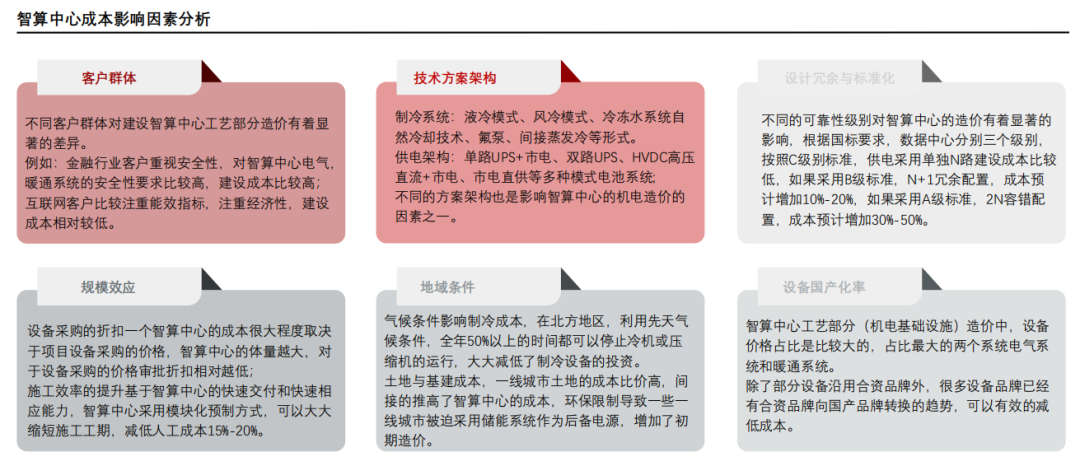

大模型基础设施层——成本影响因素分析

智算中心造价由客户需求、技术方案、冗余设计、规模、区位与设备选型等多因素共同决定,呈现高度定制化与系统性成本差异。

大模型基础设施层——新服务器功耗增加

AI服务器正向“高精度异构算力+极限带宽互联+超线性能耗密度”演进,重构数据中心的供电、散热与系统架构边界。

随着HGX服务器从A100迭代至B100/B200,算力系统已不再仅追求单精度性能提升,而是呈现出以精度可变、带宽扩展和功耗堆叠为核心特征的结构性跃迁趋势。

具体表现为:FP8/FP6/FP4等低精度算力指数级上升,标志AI推理需求正主导算力体系设计重心;NVLink互联和GPU-to-GPU通信能力翻倍增长,有效缓解大模型并行训练中的通信瓶颈;而单节点总功耗从6.5kW跃升至14.3kW,意味着智算服务器已成为数据中心能耗与散热规划的核心负载单元,传统散热、电力系统将面临系统性重构压力。

整体而言,AI基础设施正从“资源堆叠”走向“能效协同”,HGX架构的升级已不再是GPU性能提升的简单累加,而是数据中心级技术协同的高度集成体现。

如何学习大模型 AI ?

我国在AI大模型领域面临人才短缺,数量与质量均落后于发达国家。2023年,人才缺口已超百万,凸显培养不足。随着Al技术飞速发展,预计到2025年,这一缺口将急剧扩大至400万,严重制约我国Al产业的创新步伐。加强人才培养,优化教育体系,国际合作并进,是破解困局、推动AI发展的关键。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

2025最新大模型学习路线

明确的学习路线至关重要。它能指引新人起点、规划学习顺序、明确核心知识点。大模型领域涉及的知识点非常广泛,没有明确的学习路线可能会导致新人感到迷茫,不知道应该专注于哪些内容。

对于从来没有接触过AI大模型的同学,我帮大家准备了从零基础到精通学习成长路线图以及学习规划。可以说是最科学最系统的学习路线。

针对以上大模型的学习路线我们也整理了对应的学习视频教程,和配套的学习资料。

大模型经典PDF书籍

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路!

配套大模型项目实战

所有视频教程所涉及的实战项目和项目源码等

博主介绍+AI项目案例集锦

MoPaaS专注于Al技术能力建设与应用场景开发,与智学优课联合孵化,培养适合未来发展需求的技术性人才和应用型领袖。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

为什么要学习大模型?

2025人工智能大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

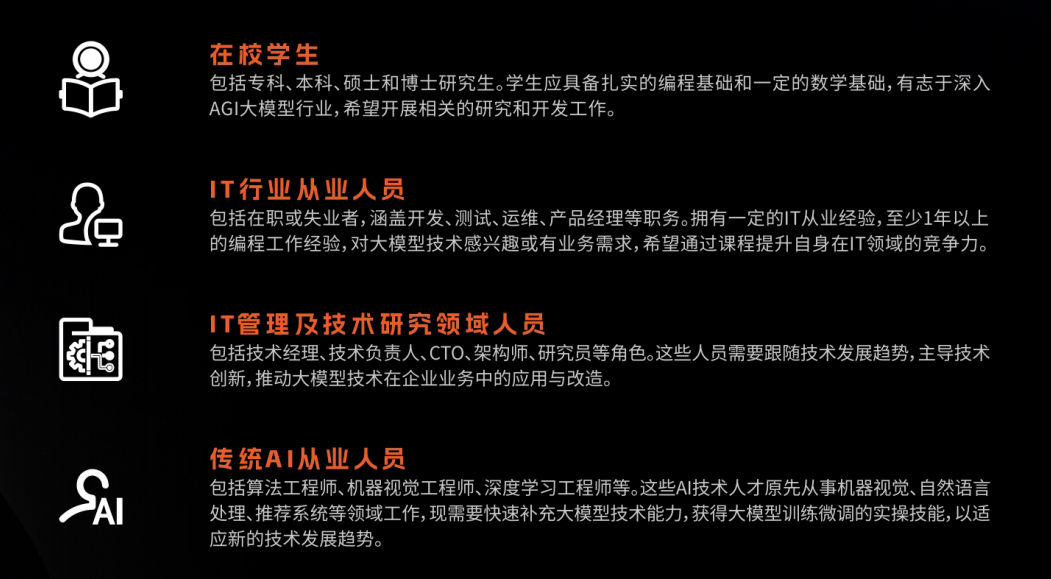

适合人群

- 在校学生:包括专科、本科、硕士和博士研究生。学生应具备扎实的编程基础和一定的数学基础,有志于深入AGI大模型行业,希望开展相关的研究和开发工作。

- IT行业从业人员:包括在职或失业者,涵盖开发、测试、运维、产品经理等职务。拥有一定的IT从业经验,至少1年以上的编程工作经验,对大模型技术感兴趣或有业务需求,希望通过课程提升自身在IT领域的竞争力。

- IT管理及技术研究领域人员:包括技术经理、技术负责人、CTO、架构师、研究员等角色。这些人员需要跟随技术发展趋势,主导技术创新,推动大模型技术在企业业务中的应用与改造。

- 传统AI从业人员:包括算法工程师、机器视觉工程师、深度学习工程师等。这些AI技术人才原先从事机器视觉、自然语言处理、推荐系统等领域工作,现需要快速补充大模型技术能力,获得大模型训练微调的实操技能,以适应新的技术发展趋势。

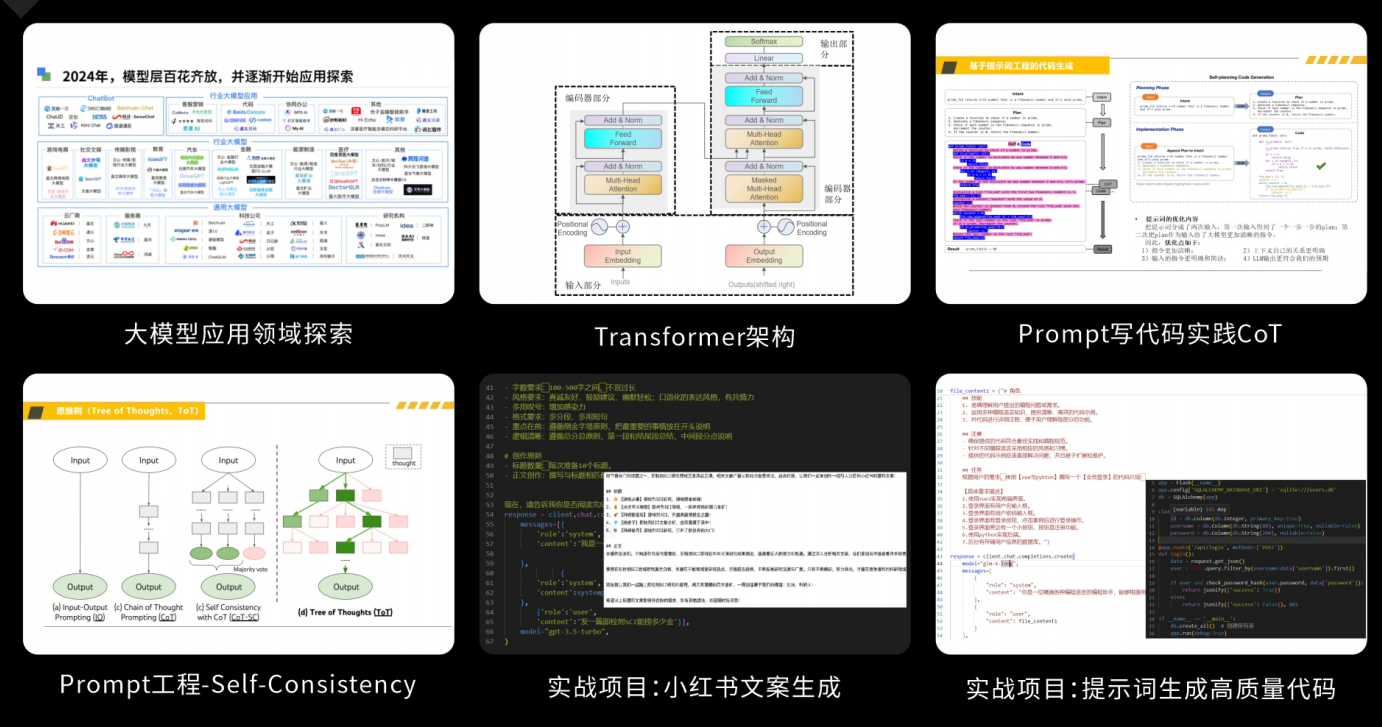

课程精彩瞬间

大模型核心原理与Prompt:掌握大语言模型的核心知识,了解行业应用与趋势;熟练Python编程,提升提示工程技能,为Al应用开发打下坚实基础。

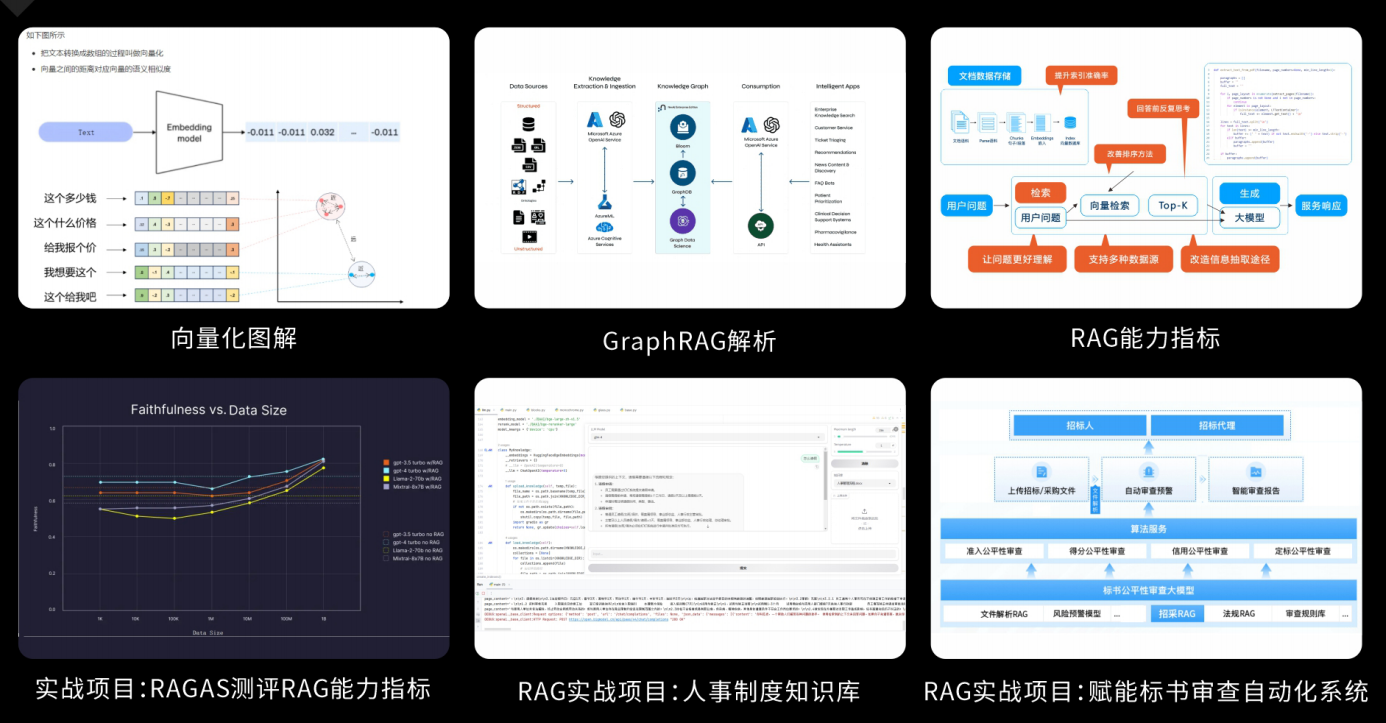

RAG应用开发工程:掌握RAG应用开发全流程,理解前沿技术,提升商业化分析与优化能力,通过实战项目加深理解与应用。

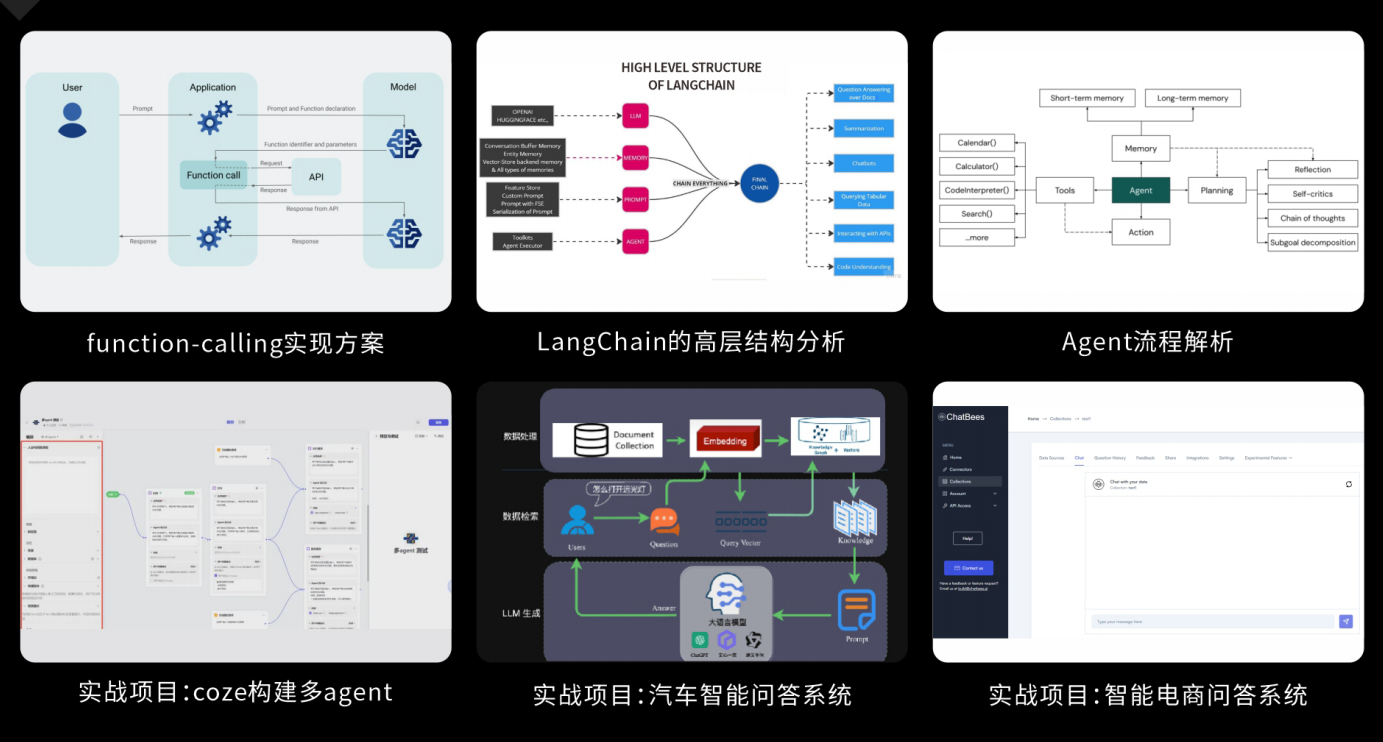

Agent应用架构进阶实践:掌握大模型Agent技术的核心原理与实践应用,能够独立完成Agent系统的设计与开发,提升多智能体协同与复杂任务处理的能力,为AI产品的创新与优化提供有力支持。

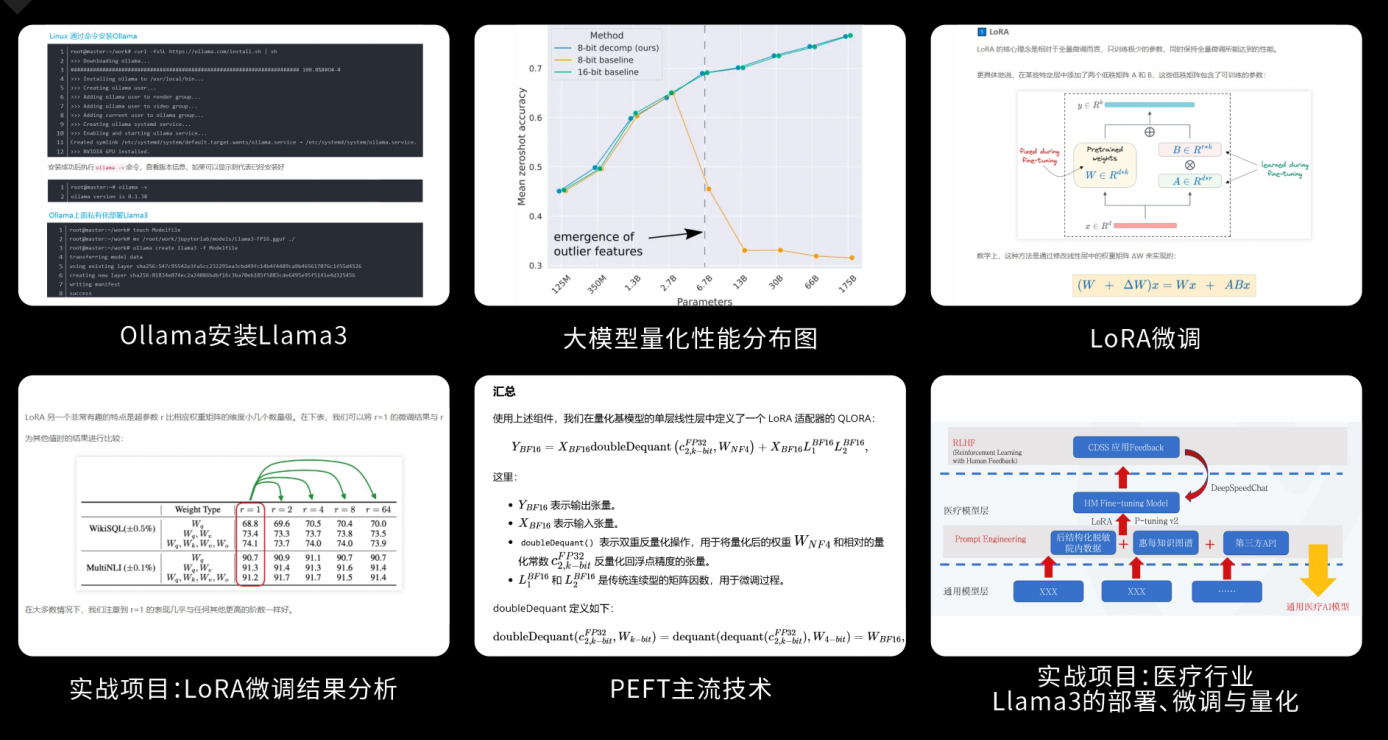

模型微调与私有化大模型:掌握大模型微调与私有化部署技能,提升模型优化与部署能力,为大模型项目落地打下坚实基础。

顶尖师资,深耕AI大模型前沿技术

实战专家亲授,让你少走弯路

一对一学习规划,职业生涯指导

- 真实商业项目实训

- 大厂绿色直通车

人才库优秀学员参与真实商业项目实训

以商业交付标准作为学习标准,具备真实大模型项目实践操作经验可写入简历,支持项目背调

大厂绿色直通车,冲击行业高薪岗位

文中涉及到的完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

437

437

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?