自然语言处理(NLP)是让计算机理解、分析和生成我们日常使用的语言的技术。它连接了人类语言和机器智能,是人工智能领域的重要分支。NLP的目标是实现人与机器之间的自然沟通,让机器能“听懂”、“读懂”甚至“写出”人类语言。

语言的数字化与预处理

计算机无法直接理解文字和语音,首先需要将语言转化为数字形式。文本通常经过分词、词性标注和句法分析等步骤,把复杂的句子拆解成结构化的信息。语音则需要通过语音识别技术,转换成文字,再进行后续处理。

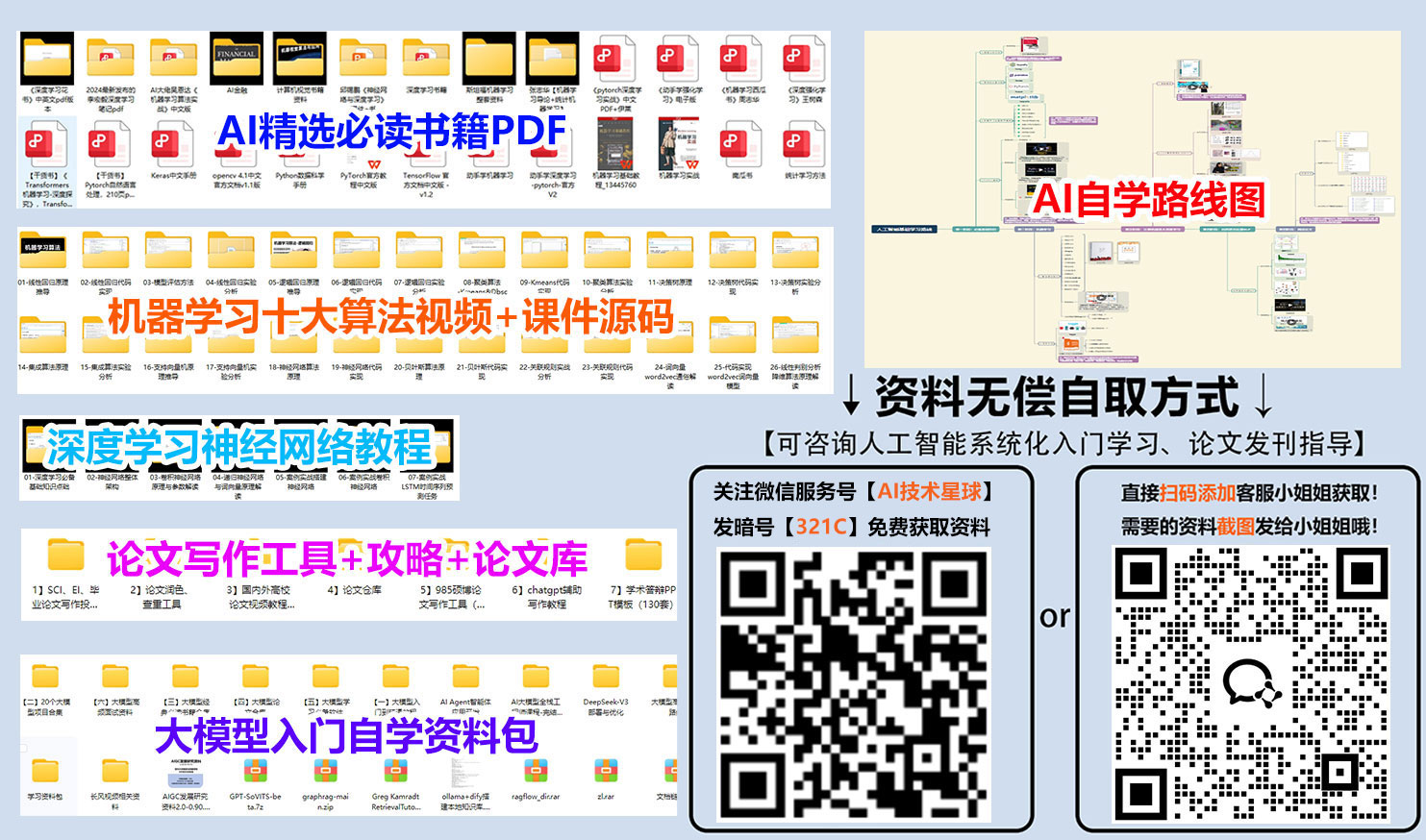

免费分享一套人工智能+大模型入门学习资料给大家,如果想自学,这套资料很全面!

关注公众号【AI技术星球】发暗号【321C】即可获取!

【人工智能自学路线图(图内推荐资源可点击内附链接直达学习)】

【AI入门必读书籍-花书、西瓜书、动手学深度学习等等...】

【机器学习经典算法视频教程+课件源码、机器学习实战项目】

【深度学习与神经网络入门教程】

【计算机视觉+NLP经典项目实战源码】

【大模型入门自学资料包】

【学术论文写作攻略工具】

语义理解与表示

理解语言的含义是NLP的核心难题。机器通过构建词向量或语义嵌入,将文字转换成数字向量,捕捉词与词之间的关系和语义相似度。例如,“猫”和“狗”在向量空间中距离较近,表示它们有相似的语义属性。

语言模型与上下文捕捉

语言模型是NLP的重要工具,用于预测下一个词或理解上下文。传统模型如n-gram只能利用有限的上下文信息,而现代的深度学习模型(如Transformer架构)能够捕捉长距离依赖,理解复杂句子结构和上下文关系,这使机器翻译、文本生成等任务效果显著提升。

任务应用举例

自然语言处理涵盖广泛任务,包括文本分类(垃圾邮件识别)、命名实体识别(识别人名、地点)、机器翻译(中英互译)、情感分析(判定评论情绪)、问答系统(智能客服)等。每个任务都依赖不同的算法和模型,结合语言特点进行优化。

训练数据与模型优化

高质量的语料库和大量训练数据是NLP模型性能提升的关键。训练过程中,模型不断调整参数以减少预测错误。同时,预训练模型(如BERT、GPT)通过大规模文本数据学习语言规律,支持多种下游任务的快速适配和应用。

自然语言处理让机器能够真正理解和生成自然语言,实现人机智能交互的桥梁。它广泛应用于智能助手、机器翻译、内容推荐、语音识别等领域,正在改变我们与技术沟通的方式。随着技术的不断进步,NLP将在更多复杂语言场景中展现强大能力,助力数字时代的信息智能化。

849

849

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?