我们在生活中经常遇到一类“跟顺序有关”的信息,比如:

-

一段语音是按时间顺序说出来的

-

一句话的意思要靠前后词语的关系来理解

-

一段音乐是按节奏依次展开的

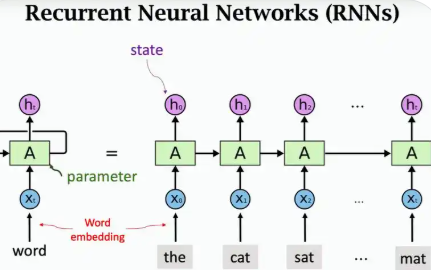

这时候,普通的人工神经网络(ANN)就有点“记不住前面讲了啥”了。那怎么办?这就需要一种能“记住上下文”的神经网络模型——循环神经网络(RNN)。

打个比方:

你读一句话:“我今天很高兴,因为……”

你会等后面那部分出来,才能理解整句话对吧?而且你也不会忘了“我今天很高兴”这件事。

RNN的思路就是这样:它每读进来一个词(或一个时间点的数据),都会“带着记忆”去理解下一个。

也就是说,RNN不像普通神经网络那样“一次看完就做判断”,而是一步一步读,一边读一边记,一边思考。这特别适合处理那些时间顺序特别重要的任务。

免费分享一套人工智能+大模型入门学习资料给大家,如果想自学,这套资料很全面!

关注公众号【AI技术星球】发暗号【321C】即可获取!

【人工智能自学路线图(图内推荐资源可点击内附链接直达学习)】

【AI入门必读书籍-花书、西瓜书、动手学深度学习等等...】

【机器学习经典算法视频教程+课件源码、机器学习实战项目】

【深度学习与神经网络入门教程】

【计算机视觉+NLP经典项目实战源码】

【大模型入门自学资料包】

【学术论文写作攻略工具】

RNN常被用在哪些场景?

-

语音识别:一句完整的话,得按顺序理解,不能打乱。

-

语言翻译:翻译整句而不是单个词,需要记住上下文。

-

情感分析:判断一段文字是开心还是生气,不能只看一个词。

-

音乐生成:让AI自己“谱曲”,节奏感不能乱。

-

时间序列预测:比如预测股市、天气、电力负荷等,要考虑之前的趋势。

RNN的特别之处是什么?

-

有“记忆”能力:能把前面接收到的信息“带到后面用”。

-

适合处理“时间序列”问题:任何跟时间顺序有关的数据,它都能派上用场。

-

可以一段一段地处理数据:不像其他模型一次处理所有输入,它是一个一个地“读”。

不过,RNN也有它的“短板”——比如记性不太好,前面的内容过长可能会“忘记”。后来科学家就发明了改进版,比如 LSTM(长短期记忆网络) 和 GRU(门控循环单元),它们就是让RNN“记性更好”的升级版。

小结一下:

RNN就像是AI的“记忆专家”,专门处理那些“顺序不能乱”“前后有关联”的数据。

它让机器不只是看见数据,而是能“理解时间的流动”。

25万+

25万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?