1.多模态GPT-4正式发布:支持图像和文本输入,效果超越ChatGPT

OpenAI的里程碑之作GPT-4终于发布,这是一个多模态大模型(接受图像和文本输入,生成文本)。主要能力有:

-

GPT-4可以更准确地解决难题,具有更广泛的常识和解决问题的能力:更具创造性和协作性;可以接受图像作为输入并生成说明文字、分类和分析;能够处理超过 25,000 个单词的文本,允许长文内容创建、扩展对话以及文档搜索和分析等用例。

-

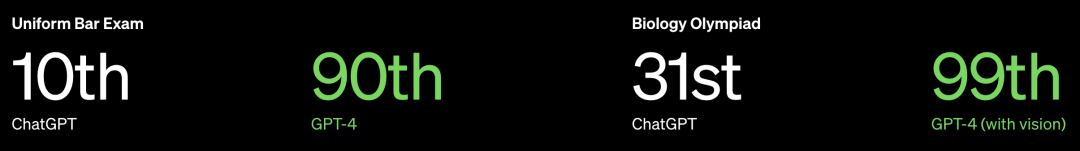

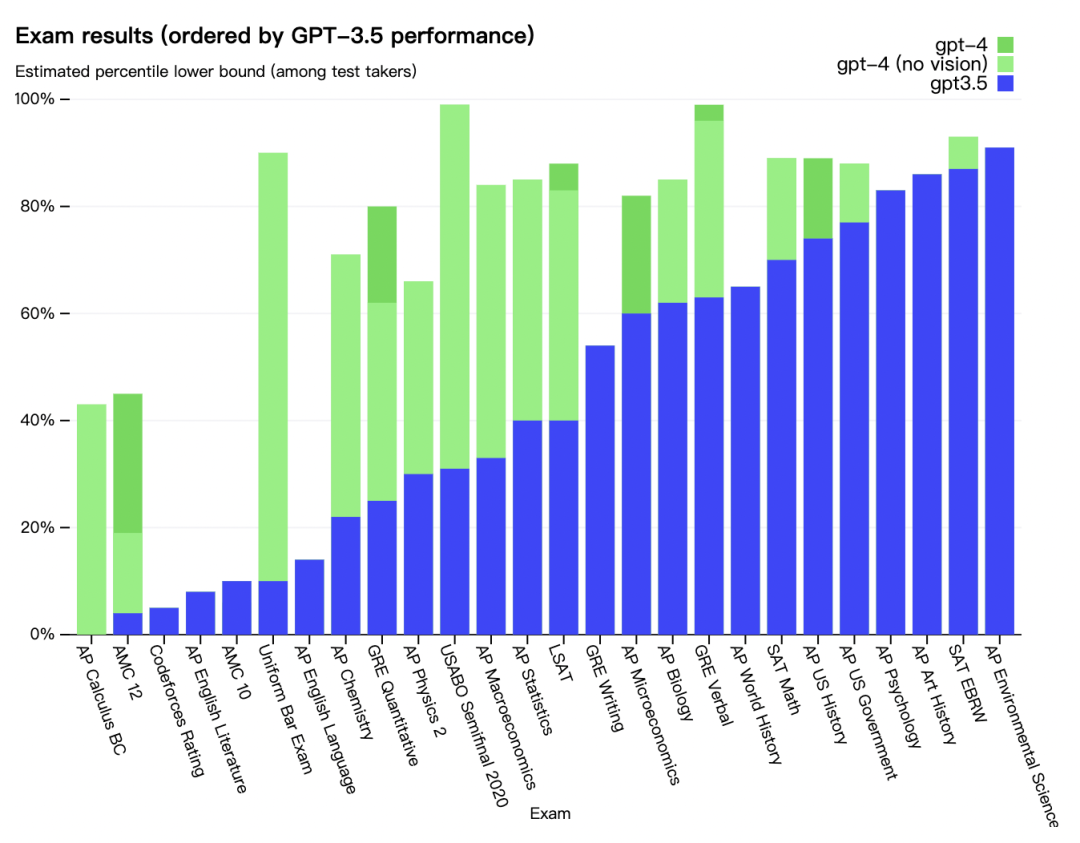

GPT-4的高级推理能力超越了ChatGPT。

-

在SAT等绝大多数专业测试以及相关学术基准评测中,GPT-4的分数高于ChatGPT。

-

GPT-4遵循GPT、GPT-2和GPT-3的研究路径,利用更多数据和更多计算来创建越来越复杂和强大的语言模型(数据量和模型参数并未公布)。

-

OpenAI花了6个月时间使GPT-4更安全、更具一致性。在内部评估中,与GPT-3.5相比,GPT-4对不允许内容做出回应的可能性降低82%,给出事实性回应的可能性高40%。

-

安全与对齐:引入了更多人类反馈数据进行训练,以改进GPT-4的行为;不断吸取现实世界使用的经验教训进行改进;GPT-4的高级推理和指令遵循能力加快的安全性研究工作。

OpenAI还开源了Evals框架(https://github.com/openai/evals),以自动评估AI模型性能,允许用户报告模型中的缺点,以帮助其改进。

OpenAI表示,GPT-4仍然有许多正在努力解决的已知局限性,例如社会偏见、幻觉和对抗性prompt。目前,OpenAI正在ChatGPT Plus上提供GPT-4,并为开发人员提供API以构建应用和服务。值得一提的是,微软的New Bing早就用上了GPT-4。

链接:

API申请:https://openai.com/waitlist/gpt-4-api;

https://openai.com/product/gpt-4;

GPT-4,OpenAI的最新多模态模型,超越了ChatGPT,支持图像和长文本处理,展现出更强的推理和安全性能。OpenAI还开源了Evals框架以评估模型性能。此外,文章探讨了大模型的智能极限、训练指南以及在浏览器中运行Stable Diffusion的突破。

GPT-4,OpenAI的最新多模态模型,超越了ChatGPT,支持图像和长文本处理,展现出更强的推理和安全性能。OpenAI还开源了Evals框架以评估模型性能。此外,文章探讨了大模型的智能极限、训练指南以及在浏览器中运行Stable Diffusion的突破。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

549

549

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?