引言/导读

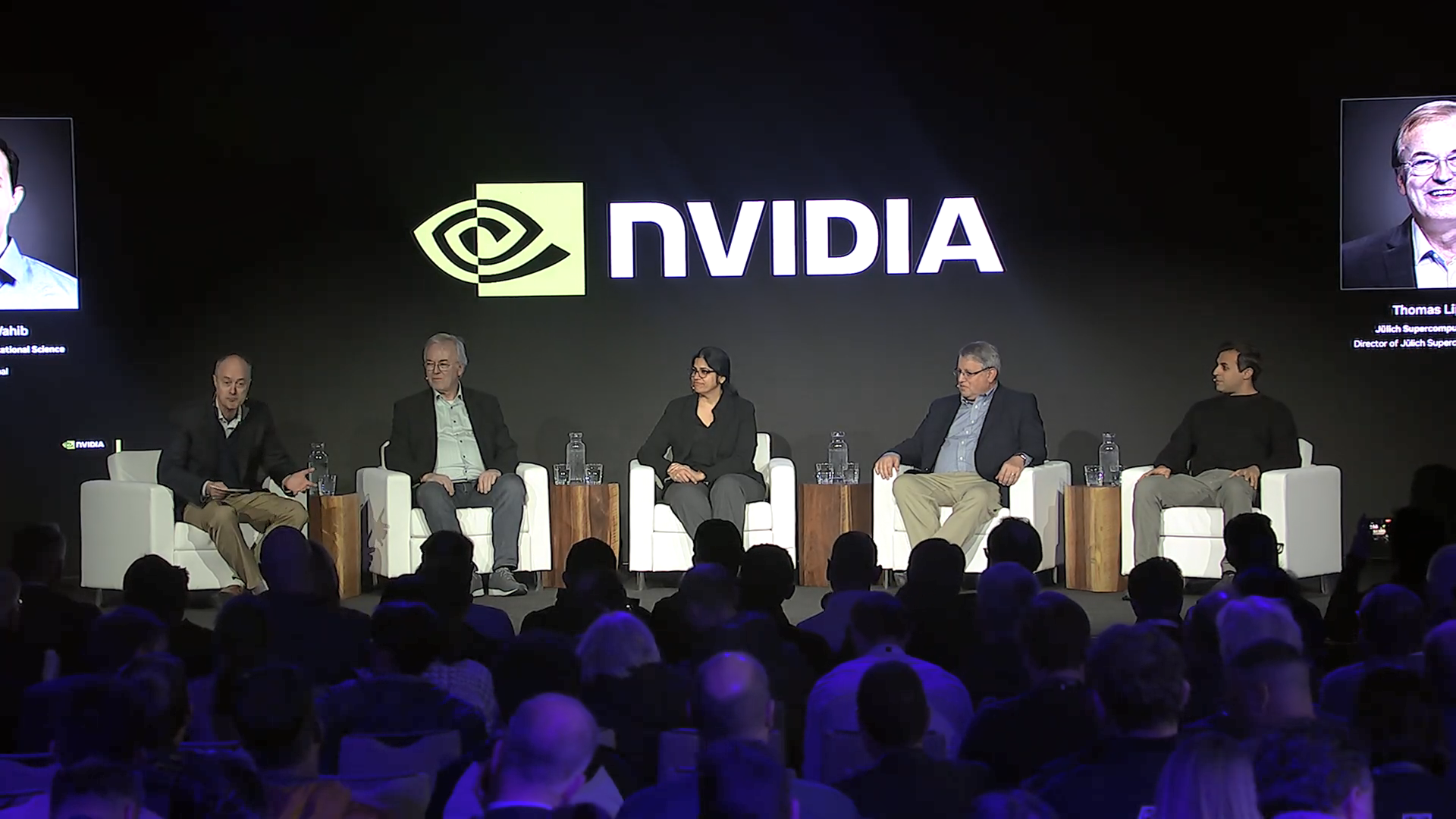

在计算的黄金时代,超级计算(HPC)已不再是象牙塔内专注于纯粹物理模拟的孤立领域。NVIDIA副总裁兼HPC/超大规模计算总经理Ian Buck在SC25大会上的炉边谈话,联同全球顶尖超算中心的领导者们(来自TACC、阿贡国家实验室、于利希研究中心和理化学研究所),共同揭示了高性能计算正在经历一场由模拟(Simulation)、科学AI(AI for Science)和量子计算(Quantum Computing)三大支柱驱动的革命性融合。

这场对话不仅回顾了CUDA从2006年首次亮相超级计算大会的青涩起点,更描绘了一幅通往Zettaflops(泽塔级浮点运算)计算工厂的宏伟蓝图。本文将深入梳理这场行业顶级对话的核心内容,分析其对全球科技格局,特别是对中国AI与科研领域的深刻启示。

超级计算的演进:从CUDA到Zettaflops的加速史诗

Ian Buck首先回顾了加速计算的历史轨迹,强调了超级计算社区一直是推动NVIDIA技术路线图前进的核心力量。

历史起点与关键技术突破

NVIDIA的超级计算征程始于2006年首次展示CUDA(统一计算架构)。最初,GPU以PCIe卡的形式存在,但超算社区的需求推动了硬件的根本性变革。

- 物理形态的演变:为了连接多个GPU并增强I/O能力,NVIDIA在2010年为Sububame超级计算机设计了新的GPU外形,首次将GPU侧立放置。

- CPU-GPU的紧密耦合:2016年,NVIDIA与IBM合作,在OpenPOWER系统上开发了定制的NVLink互联,用于Summit和Sierra系统,实现了CPU和GPU的深度集成。

- Grace Hopper架构的诞生:在ChatGPT爆炸性增长之前,Grace Hopper系统(首次将NVIDIA的CPU与GPU连接)已于2022年宣布,被洛斯阿拉莫斯国家实验室选中,不仅用于模拟,也用于机器学习和AI探索。

规模与性能的爆炸性增长

加速计算已成为主流。目前,Top 100超级计算机中,有88台采用了加速技术,这一比例持续增长。

- 生态系统与普及度:CUDA-X生态系统拥有超过6亿次下载量,覆盖约700万开发者,并包含近1000个SDK和AI模型。

- Zettaflops时代的来临:全球已宣布的AI Exaflops(百亿亿次)累积总量正在快速增长。NVIDIA宣布,目前已宣布的累计AI计算能力已超过4.5 Zettaflops,涉及超过30万块GPU。

- 巨型系统的涌现:例如,阿贡国家实验室的Solstice系统将包含10万块Blackwell GPU,其AI计算能力将是目前全球Top 500总和的1.6倍。

新三驾马车:模拟、科学AI与量子计算的融合

现代超级计算机不再只有一个主要支柱,而是必须在模拟、AI for Science和量子计算三个领域同时加速。

模拟的极限加速

超级计算机最初为模拟而生,旨在创造“科学仪器”,模拟自然界无法在时间尺度或宏微观上观测到的现象。如今,AI正在帮助模拟突破速度和复杂度的限制。

- 气候模拟的世界纪录

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

241

241

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?