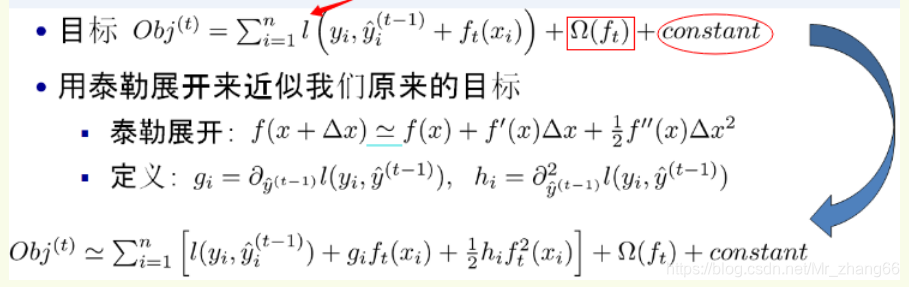

XGBoost的目标函数如下图所示:

红色箭头所指向的L 即为损失函数(比如平方损失函数:l(yi,yi)=(yi−yi)2l(yi,yi)=(yi−yi)2)

红色方框所框起来的是正则项(包括L1正则、L2正则)

红色圆圈所圈起来的为常数项

对于f(x),XGBoost利用泰勒展开三项,做一个近似。f(x)表示的是其中一颗回归树。

XGBoost的核心算法思想不难,基本就是:

不断地添加树,不断地进行特征分裂来生长一棵树,每次添加一个树,其实是学习一个新函数f(x),去拟合上次预测的残差。

当我们训练完成得到k棵树,我们要预测一个样本的分数,其实就是根据这个样本的特征,在每棵树中会落到对应的一个叶子节点,每个叶子节点就对应一个分数

最后只需要将每棵树对应的分数加起来就是该样本的预测值。

正则化项∑kΩ(ft)是则表示树的复杂度的函数,值越小复杂度越低,泛化能力越强。正则项是用来控制模型的复杂度,以防止过拟合(overfitting)

XGBoost使用了一阶和二阶偏导, 二阶导数有利于梯度下降的更快更准. 使用泰勒展开取得函数做自变量的二阶导数形式, 可以在不选定损失函数具体形式的情况下, 仅仅依靠输入数据的值就可以进行叶子分裂优化计算, 本质上也就把损失函数的选取和模型算法优化/参数选择分开了. 这种去耦合增加了XGBoost的适用性, 使得它按需选取损失函数, 可以用于分类, 也可以用于回归。

本文深入解析XGBoost的损失函数、正则项与泰勒展开在模型优化中的应用。通过不断添加简单树并调整,XGBoost控制过拟合,适用于分类和回归。核心在于一阶和二阶导数的利用,提高模型精度和泛化能力。

本文深入解析XGBoost的损失函数、正则项与泰勒展开在模型优化中的应用。通过不断添加简单树并调整,XGBoost控制过拟合,适用于分类和回归。核心在于一阶和二阶导数的利用,提高模型精度和泛化能力。

804

804

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?