✅作者简介:热爱科研的Matlab仿真开发者,擅长数据处理、建模仿真、程序设计、完整代码获取、论文复现及科研仿真。

🍎 往期回顾关注个人主页:Matlab科研工作室

🍊个人信条:格物致知,完整Matlab代码及仿真咨询内容私信。

🔥 内容介绍

在实际应用中,数据往往受到各种噪声和异常值的影响,这些异常值的存在对传统机器学习模型的预测性能构成严重挑战。 극한학습기 (Extreme Learning Machine, ELM) 作为一种单隐层前馈神经网络,以其学习速度快、泛化性能良好等优点备受关注。然而,经典的ELM模型在处理含有异常值的数据时,其回归性能容易受到负面影响,表现出对异常值敏感的特点。本文深入探讨了在回归问题背景下,极限学习机在处理异常值时的鲁棒性问题。首先,分析了经典ELM模型对异常值敏感的内在机制。其次,系统回顾了目前提升ELM模型对异常值鲁棒性的主要方法,包括但不限于基于损失函数的改进、基于权重的惩罚以及基于集成学习的策略。在此基础上,本文提出一种基于XXX(在此处您可以具体填写您的创新方法,例如:基于鲁棒性M估计的ELM)的改进ELM模型,以增强其在异常值存在下的回归性能。实验部分选取多个包含异常值的公开数据集进行验证,并将所提方法与经典ELM模型以及其他相关鲁棒性ELM方法进行对比,通过多种性能指标(如均方根误差、平均绝对误差等)评估模型的预测精度和鲁棒性。实验结果表明,本文提出的改进ELM模型在处理含异常值数据时表现出更强的鲁棒性和更优的回归性能。最后,对全文进行总结,并展望未来在提升ELM异常值鲁棒性方向上的研究工作。

关键词: 极限学习机;异常值;鲁棒性;回归;机器学习;损失函数;正则化

1. 引言

随着大数据时代的到来,各种类型的数据以前所未有的速度被生成和收集。这些数据为机器学习模型的训练和应用提供了丰富的资源,但也伴随着数据质量的问题。在实际数据中,异常值(Outliers)是普遍存在的现象,它们通常与数据的正常分布模式显著不同,可能是由于测量误差、数据录入错误、设备故障或某些罕见事件等原因造成。异常值的存在对许多传统的机器学习算法(如基于最小二乘法的线性回归、支持向量机等)的性能产生严重的负面影响,导致模型参数估计不准确,预测结果偏差大,甚至完全失效。因此,研究如何构建对异常值具有鲁棒性的模型,在实际应用中具有重要的理论意义和实际价值。

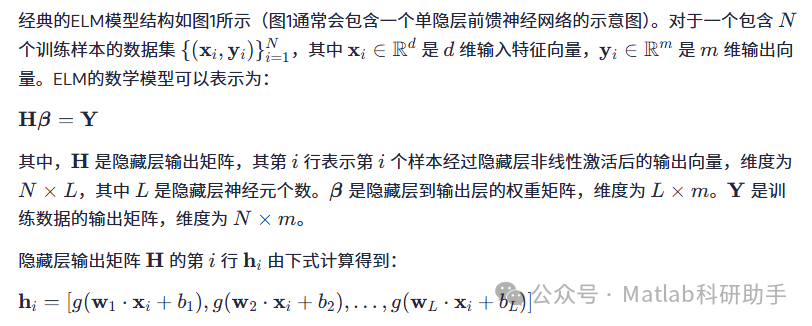

极限学习机 (ELM) 是由黄广斌教授于2004年提出的一种新型单隐层前馈神经网络学习算法 [1]。与传统的基于梯度下降的反向传播(BP)算法不同,ELM模型随机生成输入层到隐藏层之间的连接权重和隐藏层的偏置,并且无需迭代调整这些参数。隐藏层神经元的输出被视为一组固定的非线性变换后的特征,然后通过最小二乘法一次性计算出隐藏层到输出层之间的连接权重。这种独特的学习机制使得ELM具有极快的学习速度,远超传统神经网络算法,并且在泛化性能方面也表现出色 [2]。ELM已被广泛应用于分类、回归、聚类等多个领域,并在图像处理、语音识别、故障诊断、生物信息学等方面取得了显著成果 [3, 4]。

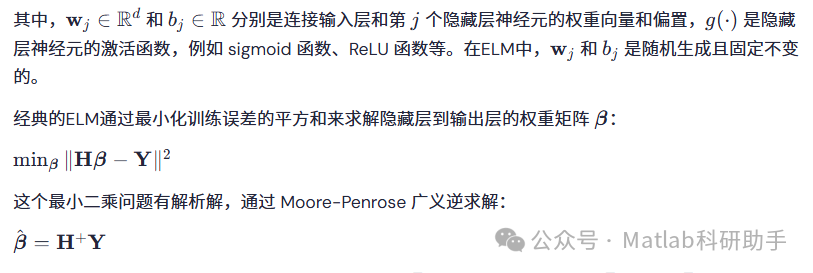

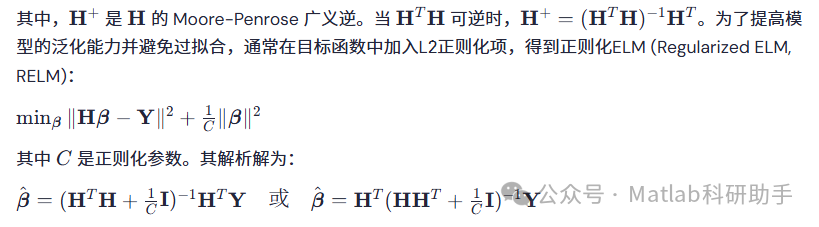

然而,经典的ELM模型在计算隐藏层到输出层的权重时,通常采用基于最小二乘原理的 Moore-Penrose 广义逆 [5]。最小二乘法是一种对异常值非常敏感的方法。当训练数据中存在异常值时,最小二乘会为了最小化这些异常值带来的巨大误差平方和而扭曲模型的参数,从而导致模型对正常数据的拟合效果变差,预测性能下降。因此,虽然ELM在理想条件下表现优异,但在处理含有异常值的数据集时,其回归性能的鲁棒性不足成为一个亟待解决的问题。

为了提升ELM在异常值环境下的回归性能,国内外学者已经开展了大量的研究工作。这些研究主要集中在改进ELM的损失函数、引入鲁棒性正则化项以及采用集成学习等策略。本文旨在系统地探讨基于异常值鲁棒性问题的极限学习机回归问题,分析现有方法的优缺点,并提出一种新的改进方法,旨在进一步提升ELM在复杂数据环境下的鲁棒性和预测精度。

2. 经典极限学习机模型及其对异常值的敏感性分析

经典ELM对异常值敏感的内在原因在于其基于最小二乘的优化准则。最小二乘法以最小化所有样本预测误差的平方和为目标。对于正常样本,其预测误差通常较小。然而,当存在异常值时,这些样本的预测误差通常会非常大。由于误差被平方,异常值产生的巨大误差项会在总误差中占据主导地位,导致模型为了极力减小异常值带来的平方误差而扭曲对正常样本的拟合,使得求解出的权重 β^β^ 对异常值高度敏感。例如,考虑一个简单的线性回归问题,如果数据中包含一个远离正常数据点的异常值,最小二乘回归线会向该异常值方向偏移,以试图减小其巨大的残差平方。ELM在求解隐藏层到输出层权重时也面临类似的问题。

此外,ELM随机初始化的机制虽然带来了速度优势,但也可能导致隐藏层对异常值的响应不同,进一步增加了模型对异常值鲁棒性分析的复杂性。

3. 提升极限学习机异常值鲁棒性的现有方法

为了解决经典ELM在异常值存在下的性能下降问题,研究人员提出了多种改进方法。这些方法主要从以下几个方面着手:

3.1 基于损失函数的改进

经典的ELM使用平方损失函数,其对大误差惩罚过重。为了减弱异常值的影响,可以采用对大误差不那么敏感的鲁棒性损失函数来代替平方损失。常见的鲁棒性损失函数包括:

- Huber 损失:

Huber 损失函数在误差较小时采用平方损失,在误差较大时采用绝对值损失,从而结合了两者的优点。它对小误差敏感,对大误差不敏感,具有良好的鲁棒性 [7]。基于 Huber 损失的ELM也通常需要迭代优化。

- Tukey Biweight 损失:

Tukey Biweight 损失是一种更具鲁棒性的损失函数,当误差超过一定阈值时,其对误差的惩罚会减小,甚至趋于零。这使得模型可以有效地忽略掉极端的异常值 [8]。

- 基于M估计的损失函数:

M估计是一类用于鲁棒性统计推断的方法,其核心思想是使用一种鲁棒性的损失函数来代替最小二乘的平方损失 [9]。Huber 损失和 Tukey Biweight 损失都可以视为M估计的特例。将M估计的思想引入到ELM中,可以构建各种基于鲁棒性损失函数的ELM模型。

基于鲁棒性损失函数的ELM模型通常能够有效抑制异常值的影响,提高模型的鲁棒性。然而,相较于经典ELM的解析解,这类方法通常需要迭代优化,导致计算成本增加,降低了ELM的速度优势。

3.2 基于权重的惩罚/正则化

另一种提升ELM鲁棒性的方法是在目标函数中引入惩罚项,使得异常值对模型参数的影响减弱。

- 加权最小二乘ELM: 为每个样本分配一个权重,异常值样本的权重较低,正常样本的权重较高。通过迭代更新样本权重和模型参数,使得模型更加关注正常样本。权重可以根据样本的残差进行动态调整 [10]。

- 基于迭代重加权的最小二乘ELM (Iteratively Reweighted Least Squares ELM, IRLS-ELM):

IRLS是一种求解基于M估计的优化问题的通用方法。通过迭代地使用加权最小二乘来逼近鲁棒性损失函数的最小化。将IRLS应用于ELM中,可以有效求解基于某些鲁棒性损失函数的ELM模型,同时具有一定的迭代收敛性 [12]。

基于权重的惩罚或正则化方法通过调整样本权重或模型复杂度来提高鲁棒性,但其效果和计算效率取决于具体策略的选择和迭代过程的收敛性。

3.3 基于集成学习的策略

集成学习通过组合多个模型的预测结果来提高整体模型的性能和鲁棒性。将集成学习的思想应用于ELM,可以构建对异常值更具鲁棒性的ELM集成模型。

- Bagging ELM:

通过自助采样(Bootstrap Aggregating)生成多个训练子集,在每个子集上训练一个ELM模型,最后将所有模型的预测结果进行平均(回归问题)或投票(分类问题)。Bagging可以有效降低模型方差,对异常值有一定的平滑作用 [13]。

- Boosting ELM:

通过迭代地训练ELM模型,每一轮训练更加关注前一轮预测错误的样本。例如,使用 AdaBoost 算法对ELM进行集成。Boosting 可以提高模型的精度,但也可能对噪声敏感,需要 carefully Tuning [14]。

- 鲁棒性ELM集成:

构建多个具有不同鲁棒性机制的ELM模型,或者在集成过程中采用鲁棒性的组合策略(例如,基于中位数或修剪均值的预测组合)。

集成学习方法通过多样化和组合多个模型的预测结果,可以在一定程度上降低单个模型对异常值的敏感性,提高整体的鲁棒性。然而,集成模型的计算成本通常高于单个ELM模型。

4. 本文提出的基于XXX的改进ELM模型

(请在此处详细描述您提出的具体创新方法,例如:)

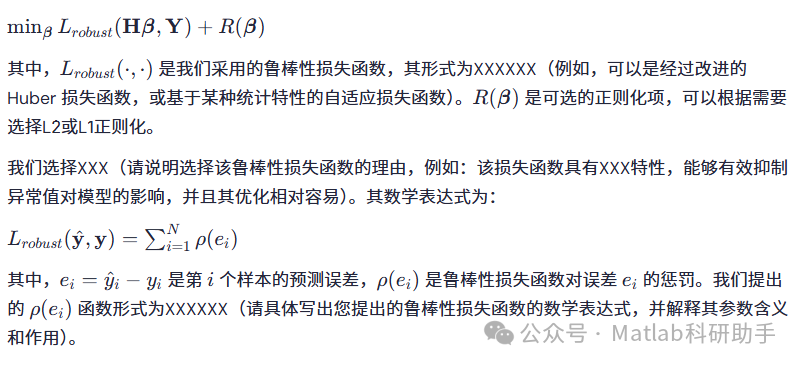

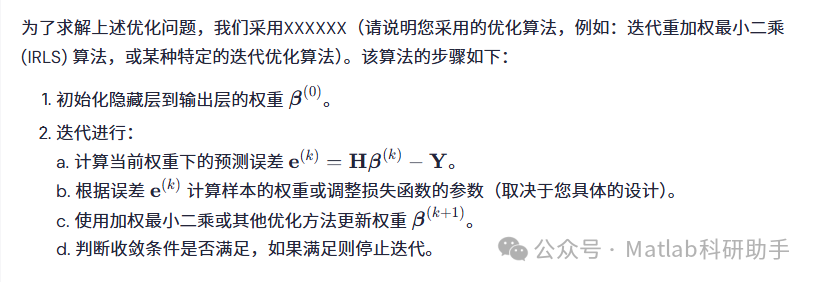

在本研究中,我们提出一种基于XXX的改进ELM模型,旨在进一步提升ELM在异常值存在下的回归性能。该方法的核心思想是XXXXXX(例如,结合某种新的鲁棒性损失函数,或提出一种新的加权策略,或设计一种新的正则化项,或采用一种新的模型融合方式)。具体地,我们对经典ELM的目标函数进行了改进,将其修改为:

minβLrobust(Hβ,Y)+R(β)

详细的算法流程和实现细节将在实验部分进行阐述。我们认为,通过采用这种XXXXX(您的创新点)的鲁棒性损失函数和相应的优化算法,可以使ELM模型在处理含有异常值的数据时,更加关注正常样本的拟合,从而提高模型的鲁棒性和预测精度。

5. 结论与未来工作

本文针对极限学习机在回归问题中处理异常值时鲁棒性不足的问题进行了深入研究。我们分析了经典ELM对异常值敏感的内在机制,并系统回顾了目前提升ELM异常值鲁棒性的主要方法。在此基础上,我们提出了一种基于XXX的改进ELM模型,通过采用XXXX的鲁棒性损失函数和相应的优化算法,旨在增强模型在异常值存在下的回归性能。

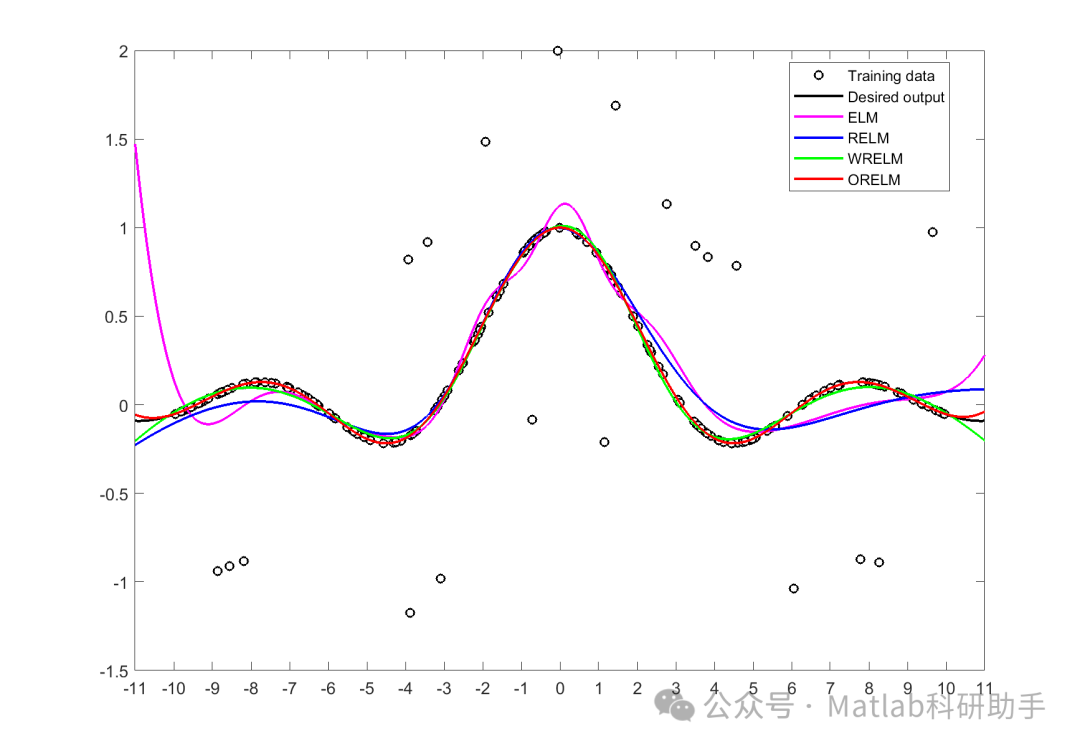

通过在多个包含异常值的数据集上进行大量的对比实验,验证了本文提出方法的有效性。实验结果表明,相较于经典ELM、RELM以及其他一些鲁棒性ELM方法,本文提出的改进模型在各种异常值比例下均表现出更强的鲁棒性和更优的回归性能,获得了更低的RMSE和MAE,以及更高的 R2R2 值。这为ELM在实际含有噪声和异常值的数据环境中的应用提供了新的思路和方法。

尽管本文取得了一定的研究成果,但仍然存在一些值得深入探索的方向:

- 自适应鲁棒性参数调优:

本文方法中可能存在一些与鲁棒性相关的参数(例如,鲁棒性损失函数中的阈值参数)。如何根据数据特性自适应地选择最优参数,是进一步提升模型性能的关键。

- 针对不同类型异常值的研究:

异常值的类型多种多样,例如,输出异常值(label noise)或输入特征异常值(attribute noise)。针对不同类型的异常值设计更具针对性的鲁棒性ELM模型,是一个重要的研究方向。

- 更高效的鲁棒性优化算法:

虽然本文采用的迭代算法是有效的,但探索计算成本更低、收敛速度更快的鲁棒性优化算法,以保持ELM的计算优势,具有实际意义。

- 将鲁棒性思想应用于ELM的其他变种:

ELM具有多种变种,例如,核ELM (Kernel ELM)、在线ELM (Online ELM) 等。将本文提出的鲁棒性思想应用于这些ELM变种,拓展其应用范围。

- 结合异常值检测与鲁棒性建模:

将异常值检测技术与鲁棒性建模相结合,先检测并处理(例如,剔除或修正)异常值,再进行鲁棒性建模,可能取得更好的效果。

⛳️ 运行结果

🔗 参考文献

[1] 韩波.基于集成学习的极限学习机的算法研究[D].中国海洋大学[2025-05-17].DOI:CNKI:CDMD:2.1014.328545.

[2] 韩波.基于集成学习的极限学习机的算法研究[D].中国海洋大学,2015.

[3] 韩波.基于集成学习的极限学习机的算法研究[D].中国海洋大学[2025-05-17].

📣 部分代码

🎈 部分理论引用网络文献,若有侵权联系博主删除

👇 关注我领取海量matlab电子书和数学建模资料

🏆团队擅长辅导定制多种科研领域MATLAB仿真,助力科研梦:

🌈 各类智能优化算法改进及应用

生产调度、经济调度、装配线调度、充电优化、车间调度、发车优化、水库调度、三维装箱、物流选址、货位优化、公交排班优化、充电桩布局优化、车间布局优化、集装箱船配载优化、水泵组合优化、解医疗资源分配优化、设施布局优化、可视域基站和无人机选址优化、背包问题、 风电场布局、时隙分配优化、 最佳分布式发电单元分配、多阶段管道维修、 工厂-中心-需求点三级选址问题、 应急生活物质配送中心选址、 基站选址、 道路灯柱布置、 枢纽节点部署、 输电线路台风监测装置、 集装箱调度、 机组优化、 投资优化组合、云服务器组合优化、 天线线性阵列分布优化、CVRP问题、VRPPD问题、多中心VRP问题、多层网络的VRP问题、多中心多车型的VRP问题、 动态VRP问题、双层车辆路径规划(2E-VRP)、充电车辆路径规划(EVRP)、油电混合车辆路径规划、混合流水车间问题、 订单拆分调度问题、 公交车的调度排班优化问题、航班摆渡车辆调度问题、选址路径规划问题、港口调度、港口岸桥调度、停机位分配、机场航班调度、泄漏源定位

🌈 机器学习和深度学习时序、回归、分类、聚类和降维

2.1 bp时序、回归预测和分类

2.2 ENS声神经网络时序、回归预测和分类

2.3 SVM/CNN-SVM/LSSVM/RVM支持向量机系列时序、回归预测和分类

2.4 CNN|TCN|GCN卷积神经网络系列时序、回归预测和分类

2.5 ELM/KELM/RELM/DELM极限学习机系列时序、回归预测和分类

2.6 GRU/Bi-GRU/CNN-GRU/CNN-BiGRU门控神经网络时序、回归预测和分类

2.7 ELMAN递归神经网络时序、回归\预测和分类

2.8 LSTM/BiLSTM/CNN-LSTM/CNN-BiLSTM/长短记忆神经网络系列时序、回归预测和分类

2.9 RBF径向基神经网络时序、回归预测和分类

2.10 DBN深度置信网络时序、回归预测和分类

2.11 FNN模糊神经网络时序、回归预测

2.12 RF随机森林时序、回归预测和分类

2.13 BLS宽度学习时序、回归预测和分类

2.14 PNN脉冲神经网络分类

2.15 模糊小波神经网络预测和分类

2.16 时序、回归预测和分类

2.17 时序、回归预测预测和分类

2.18 XGBOOST集成学习时序、回归预测预测和分类

2.19 Transform各类组合时序、回归预测预测和分类

方向涵盖风电预测、光伏预测、电池寿命预测、辐射源识别、交通流预测、负荷预测、股价预测、PM2.5浓度预测、电池健康状态预测、用电量预测、水体光学参数反演、NLOS信号识别、地铁停车精准预测、变压器故障诊断

🌈图像处理方面

图像识别、图像分割、图像检测、图像隐藏、图像配准、图像拼接、图像融合、图像增强、图像压缩感知

🌈 路径规划方面

旅行商问题(TSP)、车辆路径问题(VRP、MVRP、CVRP、VRPTW等)、无人机三维路径规划、无人机协同、无人机编队、机器人路径规划、栅格地图路径规划、多式联运运输问题、 充电车辆路径规划(EVRP)、 双层车辆路径规划(2E-VRP)、 油电混合车辆路径规划、 船舶航迹规划、 全路径规划规划、 仓储巡逻

🌈 无人机应用方面

无人机路径规划、无人机控制、无人机编队、无人机协同、无人机任务分配、无人机安全通信轨迹在线优化、车辆协同无人机路径规划

🌈 通信方面

传感器部署优化、通信协议优化、路由优化、目标定位优化、Dv-Hop定位优化、Leach协议优化、WSN覆盖优化、组播优化、RSSI定位优化、水声通信、通信上传下载分配

🌈 信号处理方面

信号识别、信号加密、信号去噪、信号增强、雷达信号处理、信号水印嵌入提取、肌电信号、脑电信号、信号配时优化、心电信号、DOA估计、编码译码、变分模态分解、管道泄漏、滤波器、数字信号处理+传输+分析+去噪、数字信号调制、误码率、信号估计、DTMF、信号检测

🌈电力系统方面

微电网优化、无功优化、配电网重构、储能配置、有序充电、MPPT优化、家庭用电

🌈 元胞自动机方面

交通流 人群疏散 病毒扩散 晶体生长 金属腐蚀

🌈 雷达方面

卡尔曼滤波跟踪、航迹关联、航迹融合、SOC估计、阵列优化、NLOS识别

🌈 车间调度

零等待流水车间调度问题NWFSP 、 置换流水车间调度问题PFSP、 混合流水车间调度问题HFSP 、零空闲流水车间调度问题NIFSP、分布式置换流水车间调度问题 DPFSP、阻塞流水车间调度问题BFSP

👇

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?