Adversarial Machine Learning

这一篇是斯坦福大学的课程讲义:Lecture 16 | Adversarial Examples and Adversarial Training

比较粗糙,自用,想了解可以直接看视频。

Overview

What are adversarial examples?

Why do they happen?

How can they be used to compromise machine learning systems?

What are the defenses?

How to use adversarial examples to improve machine learning, even when there is no adversary?

首先讲了很多机器学习的应用,其强大的功能已经能够媲美人类。于是诞生了一个方向,专门研究机器什么时候会出现问题。

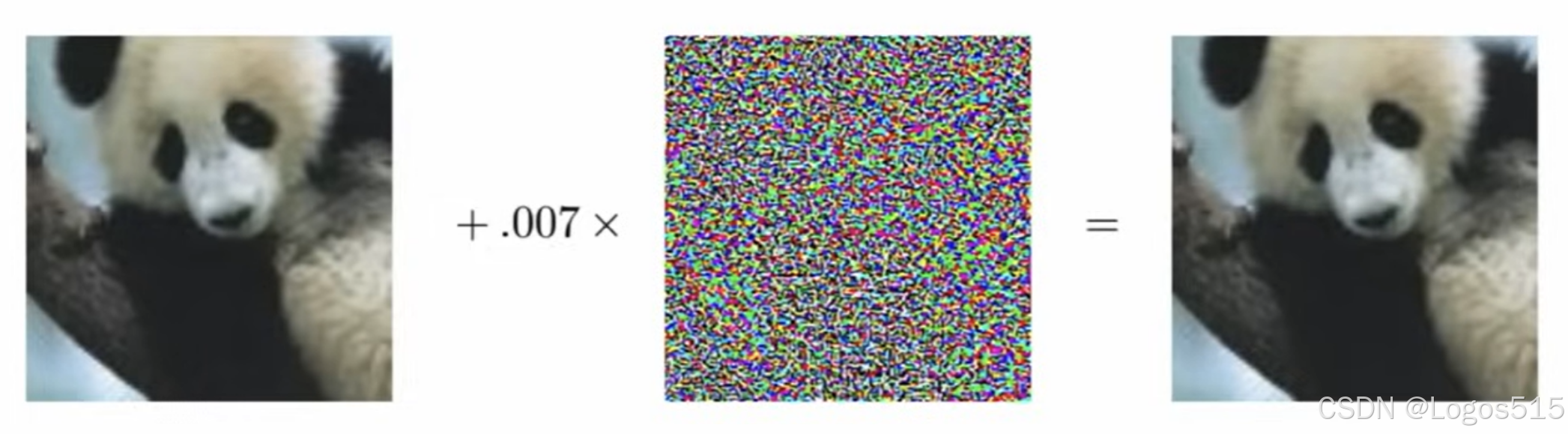

下面是一个对抗攻击的例子,给大熊猫加了“噪声干扰”后,导致机器误判为长臂猿,并且概率高达99.9%

这很有意思,因为我们肉眼观察两张图片几乎不存在任何区别,加了“干扰”之后的图片里的大熊猫并没有变得与长臂猿更像,但是机器却认为这就是一只长臂猿。

下面是一个针对线性模型的攻击的例子

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1129

1129