官方代码给的解释两种mask看的太绕,这里记录一下

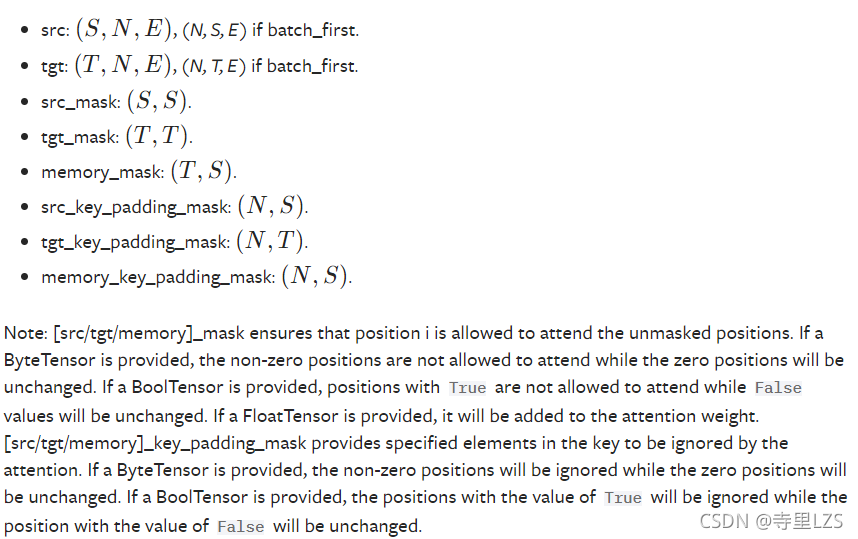

先贴出原文解释

先理解mask是要将某位置忽略(ignore),不参与计算,而unmask反之。

第一种mask是用于masked attention模块,对于byteTensor,0代表unmask,非0代表mask,对于boolTensor,True代表mask,False代表unmask。

第二种mask是用于padding过程,True代表mask,False代表unmask。

参考:

官方代码给的解释两种mask看的太绕,这里记录一下

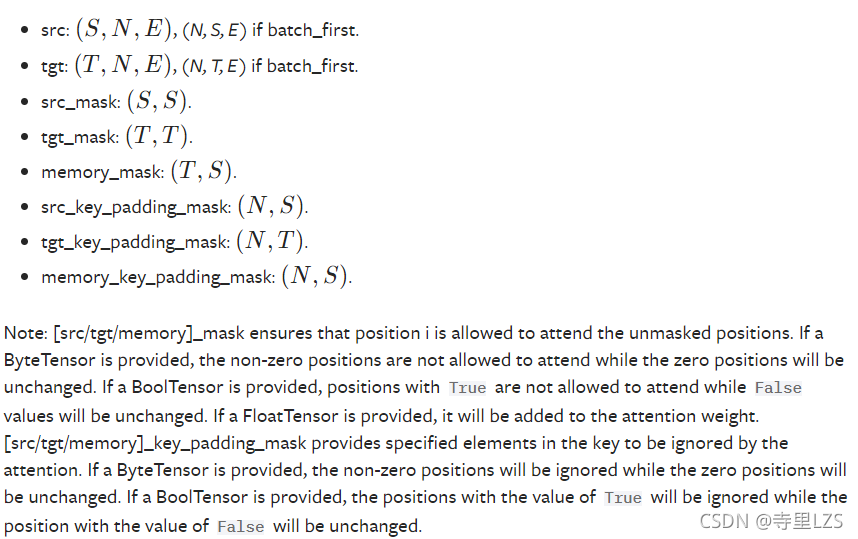

先贴出原文解释

先理解mask是要将某位置忽略(ignore),不参与计算,而unmask反之。

第一种mask是用于masked attention模块,对于byteTensor,0代表unmask,非0代表mask,对于boolTensor,True代表mask,False代表unmask。

第二种mask是用于padding过程,True代表mask,False代表unmask。

参考:

445

445

767

767

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?