核心思想:1、MapReduce的核心思想是“分而治之”。所谓“分而治之”就是把一个复杂的问题,按照一定的“分解”方法分为等价的规模较小的若干部分,然后逐个解决,分别找出各部分的结果,把各部分的结果组成整个问题的结果,这种思想来源于日常生活与工作时的经验,同样也完全适合技术领域。

2、MapReduce作为一种分布式计算模型,它主要用于解决海量数据的计算问题。使用MapReduce操作海量数据时,每个MapReduce程序被初始化为一个工作任务,每个工作任务可以分为Map和Reduce两个阶段。

一、MapReduce编程实例——词频统计实现

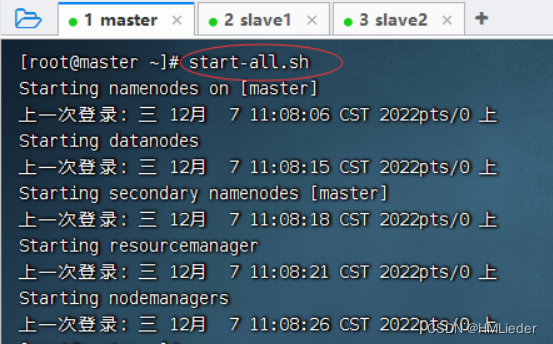

1、启动Hadoop

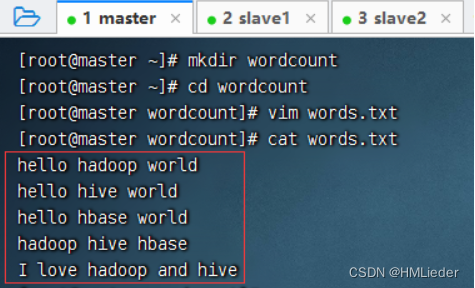

2、准备数据文件

在虚拟机上创建文本文件,创建wordcount目录,在里面创建words.txt文件。

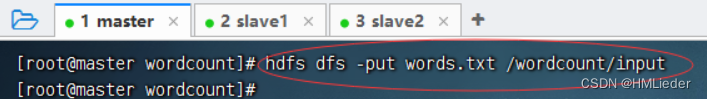

上传文件到HDFS指定目录

创建/wordcount/input目录,执行命令:hdfs dfs -mkdir -p /wordcount/input

将文本文件words.txt,上传到HDFS的/wordcount/input目录

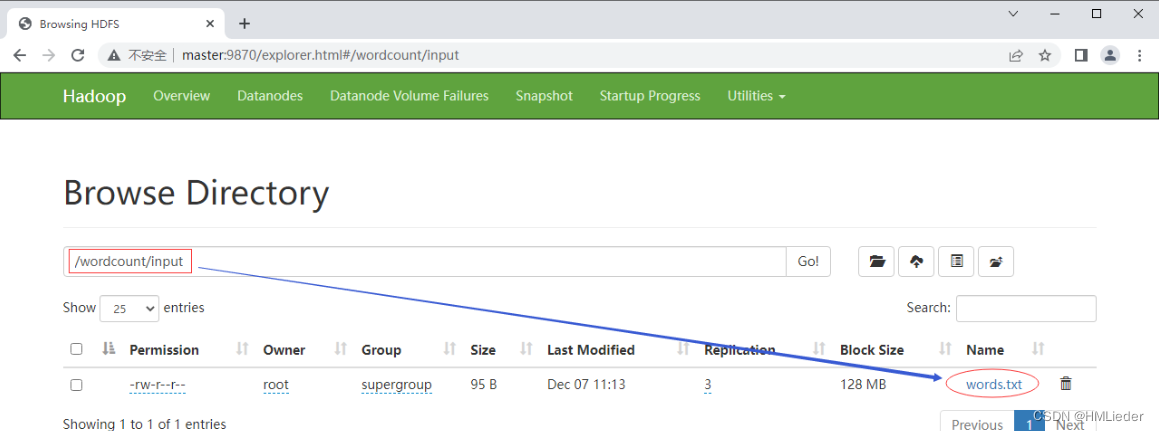

在Hadoop WebUI界面上查看上传的文件

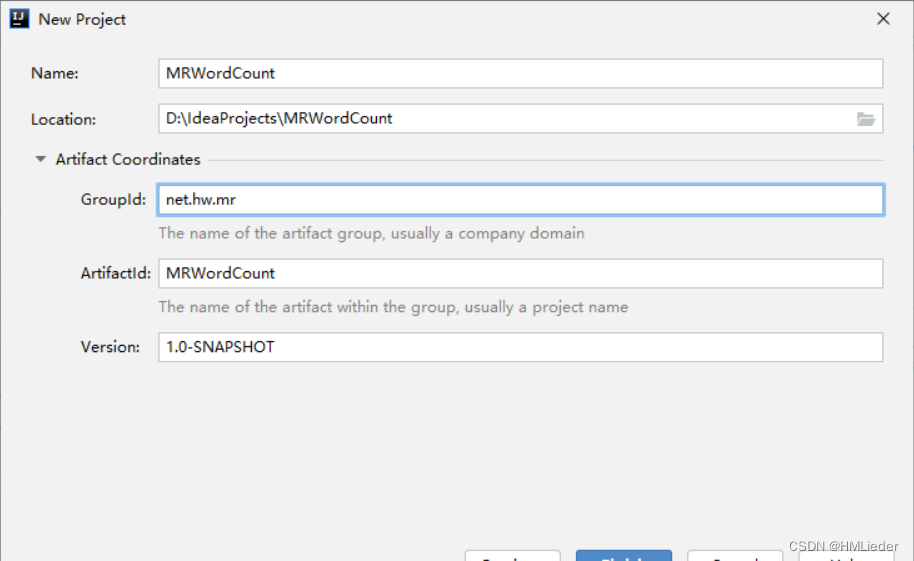

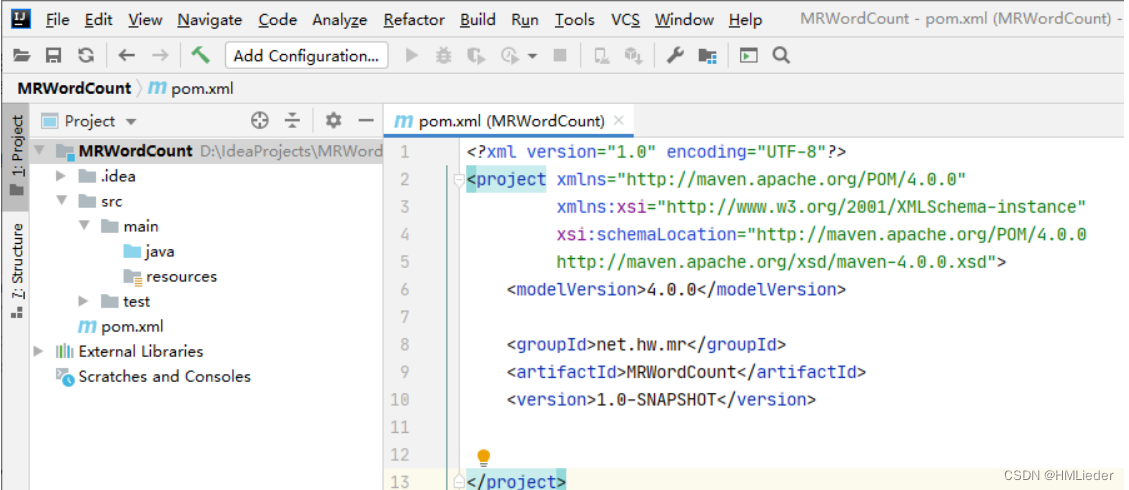

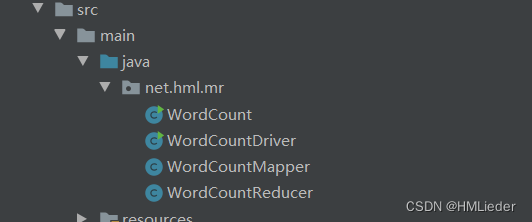

二、创建Maven项目

创建Maven项目 - MRWordCount

注:该截图来自授课老师。

单击【Finish】按钮

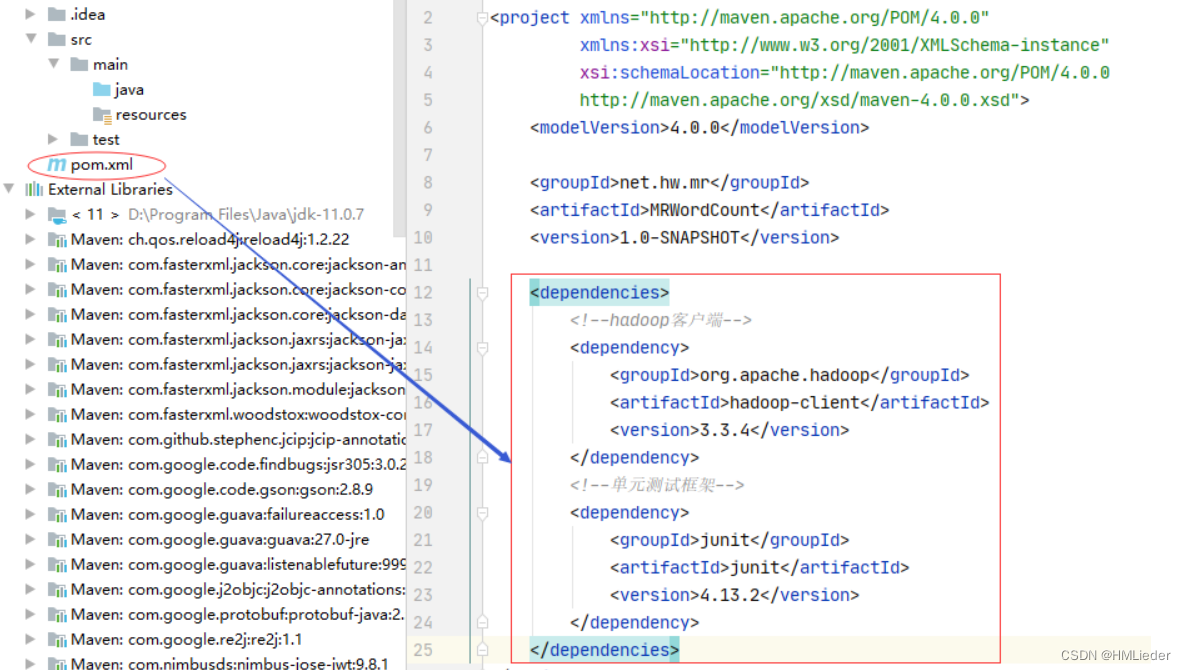

添加相关依赖

在pom.xml文件里添加hadoop和junit依赖

代码:<dependencies>

<!--hadoop客户端-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>3.3.4</version>

</dependency>

<!--单元测试框架-->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.13.2</version>

</dependency>

</dependencies>

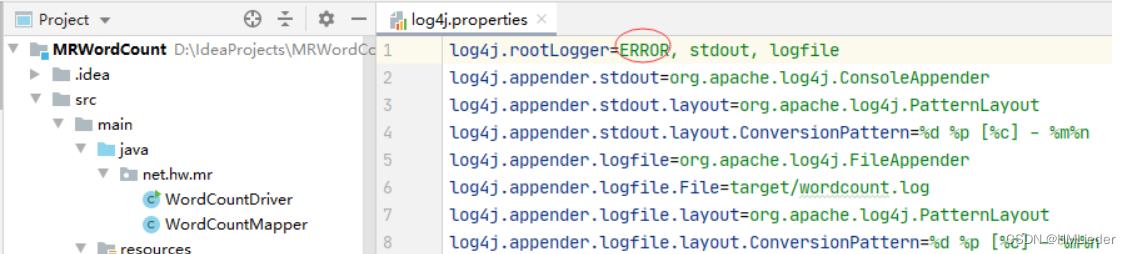

三、创建日志属性文件

在resources目录里创建log4j.properties文件

代码:log4j.rootLogger=INFO, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/wordcount.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

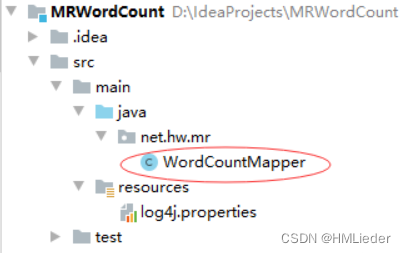

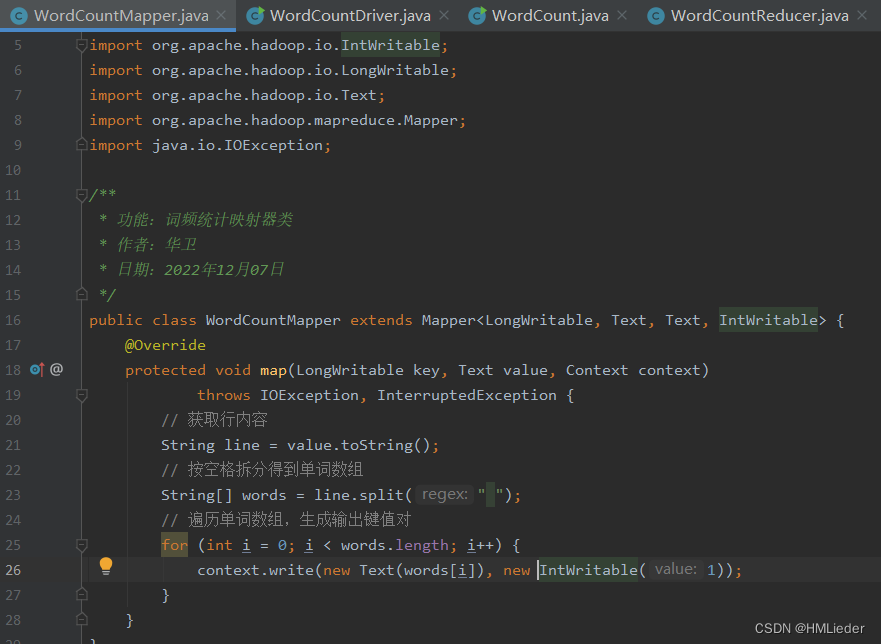

四、创建词频统计映射器类

创建net.hw.mr包,在包里创建WordCountMapper类

注:该图来自授课老师

-

为了更好理解

Mapper类的作用,在map()函数里暂时不进行每行文本分词处理,直接利用context输出key和value。

代码:

package net.hw.mr;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

/**

* 功能:词频统计映射器类

* 作者:华卫

* 日期:2022年12月07日

*/

public class WordCountMapper extends Mapper<LongWritable, Text, LongWritable, Text> {

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 直接将键值对数据传到下一个阶段

context.write(key, value);

}

}

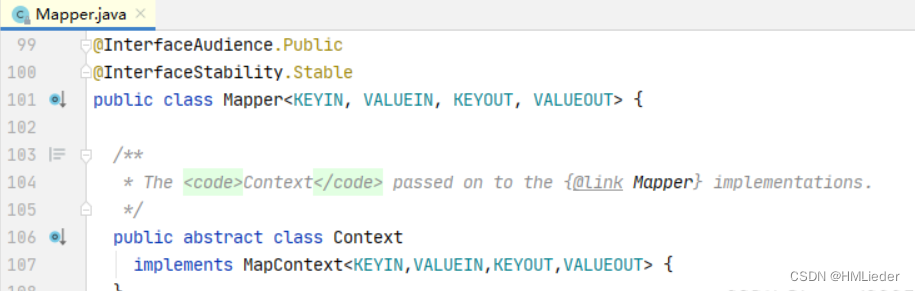

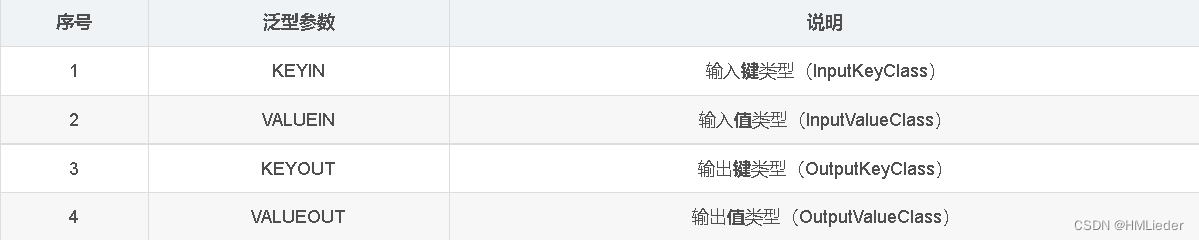

Mapper<泛型参数1, 泛型参数2, 泛型参数3, 泛型参数4>参数说明

注意:MR应用,必须有映射器(Mapper),但是归并器(Reducer)可有可无

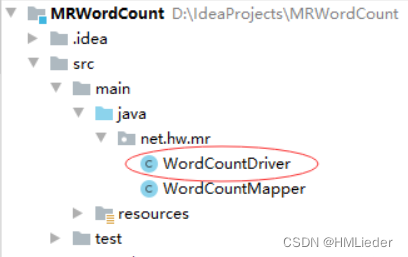

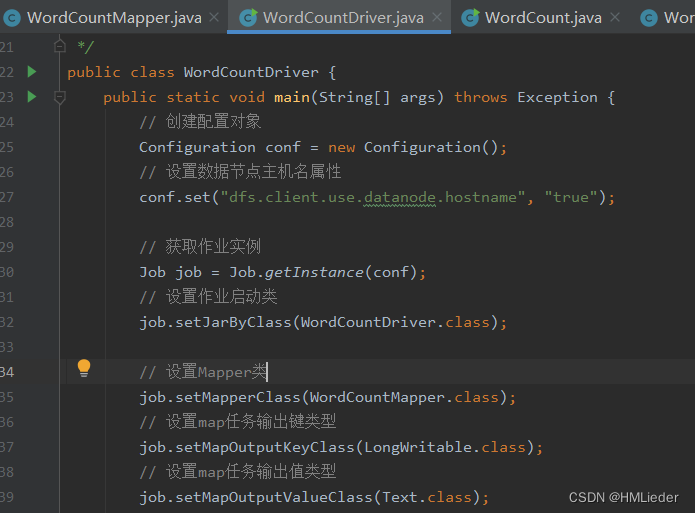

五、创建词频统计驱动器类

在net.hw.mr包里创建WordCountDriver类

注:该图来自授课老师

代码:

package net.hw.mr;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.net.URI;

/**

* 功能:词频统计驱动器类

* 作者:华卫

* 日期:2022年12月07日

*/

public class WordCountDriver {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 获取作业实例

Job job = Job.getInstance(conf);

// 设置作业启动类

job.setJarByClass(WordCountDriver.class);

// 设置Mapper类

job.setMapperClass(WordCountMapper.class);

// 设置map任务输出键类型

job.setMapOutputKeyClass(LongWritable.class);

// 设置map任务输出值类型

job.setMapOutputValueClass(Text.class);

// 定义uri字符串

String uri = "hdfs://master:9000";

// 创建输入目录

Path inputPath = new Path(uri + "/wordcount/input");

// 创建输出目录

Path outputPath = new Path(uri + "/wordcount/output");

// 获取文件系统

FileSystem fs = FileSystem.get(new URI(uri), conf);

// 删除输出目录(第二个参数设置是否递归)

fs.delete(outputPath, true);

// 给作业添加输入目录(允许多个)

FileInputFormat.addInputPath(job, inputPath);

// 给作业设置输出目录(只能一个)

FileOutputFormat.setOutputPath(job, outputPath);

// 等待作业完成

job.waitForCompletion(true);

// 输出统计结果

System.out.println("======统计结果======");

FileStatus[] fileStatuses = fs.listStatus(outputPath);

for (int i = 1; i < fileStatuses.length; i++) {

// 输出结果文件路径

System.out.println(fileStatuses[i].getPath());

// 获取文件系统数据字节输入流

FSDataInputStream in = fs.open(fileStatuses[i].getPath());

// 将结果文件显示在控制台

IOUtils.copyBytes(in, System.out, 4096, false);

}

}

}

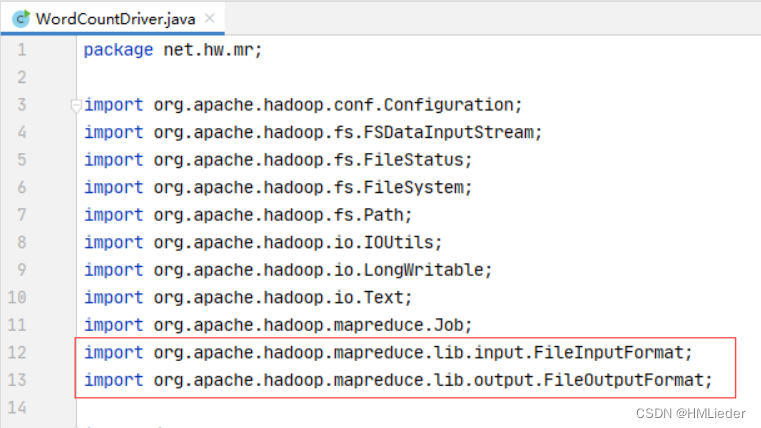

注意导包问题:不要导成org.apache.hadoop.mapred包下的FileInputFormat与FileOutputFormat.

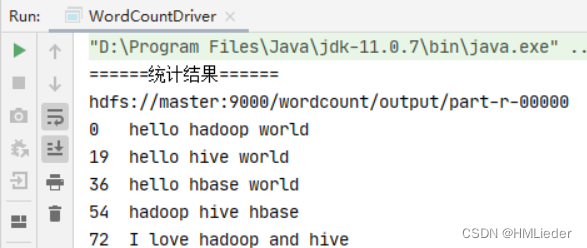

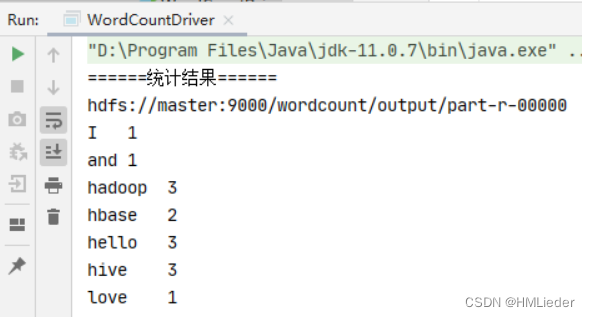

六、运行词频统计驱动器类,查看结果

统计结果之前会显示大量信息

注:该动图源自授课老师

如果不想看到统计结果之前的大堆信息,可以修改log4j.properties文件,将INFO改为ERROR

再运行程序,查看结果

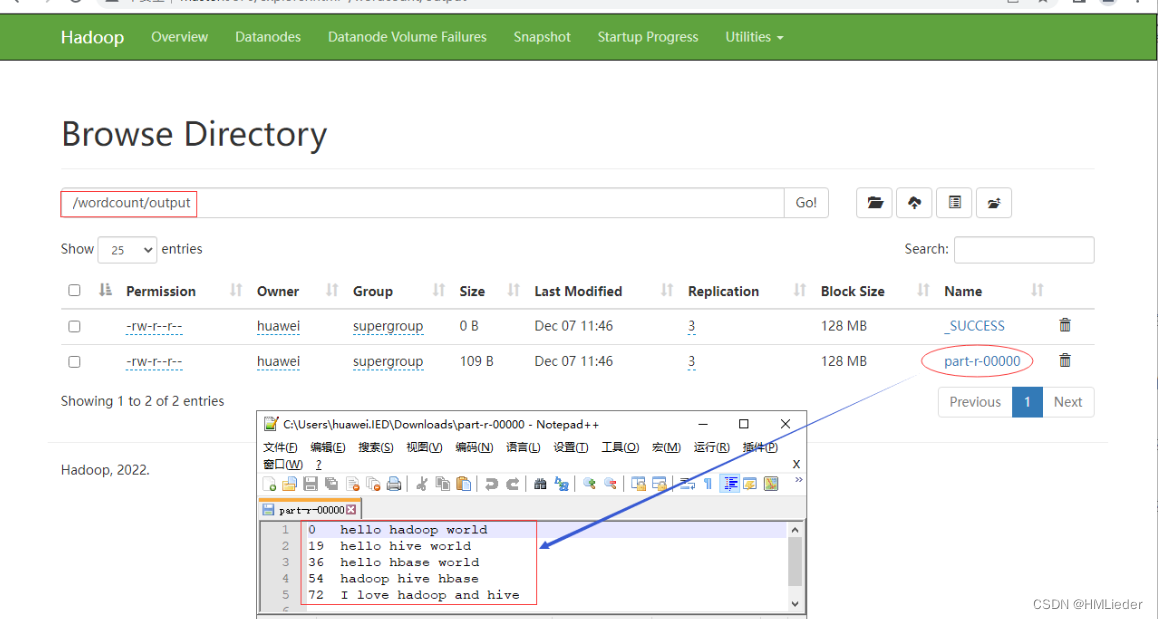

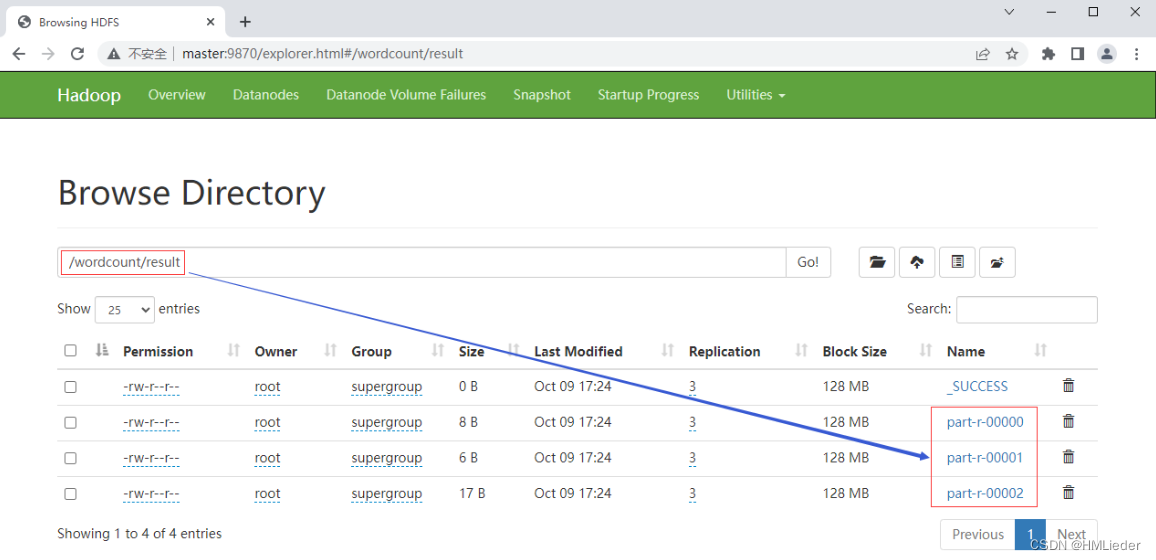

利用Hadoop WebUI界面查看结果文件

7、修改词频统计映射器类

代码:public class WordCountMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 获取行内容

String line = value.toString();

// 按空格拆分得到单词数组

String[] words = line.split(" ");

// 遍历单词数组,生成输出键值对

for (int i = 0; i < words.length; i++) {

context.write(new Text(words[i]), new IntWritable(1));

}

}

}

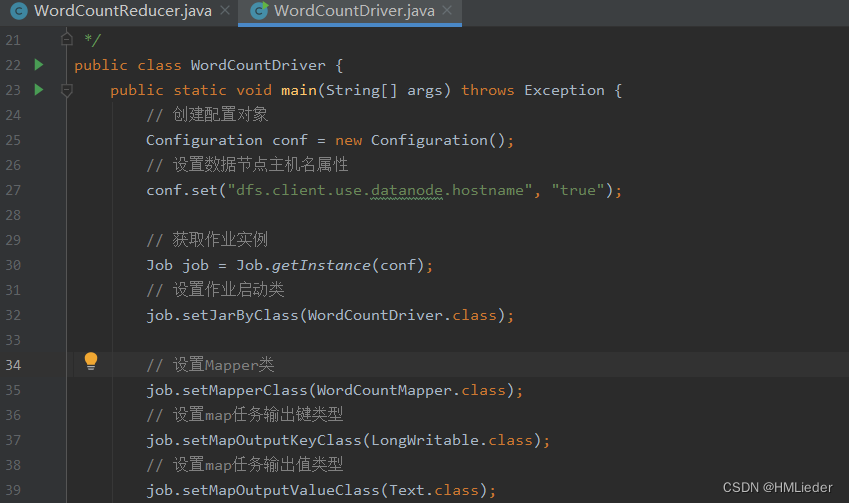

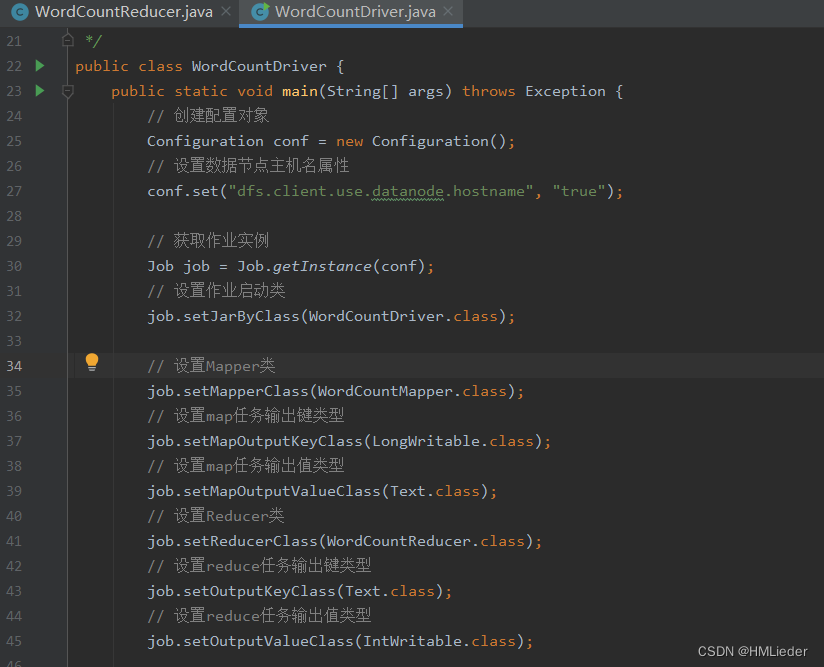

8、修改词频统计驱动器类

修改map任务输出键值类型

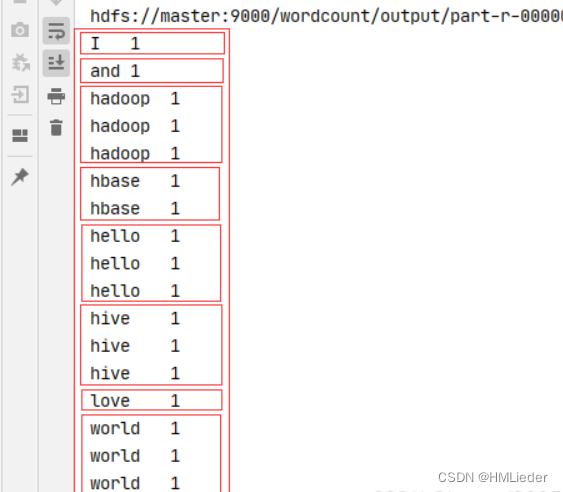

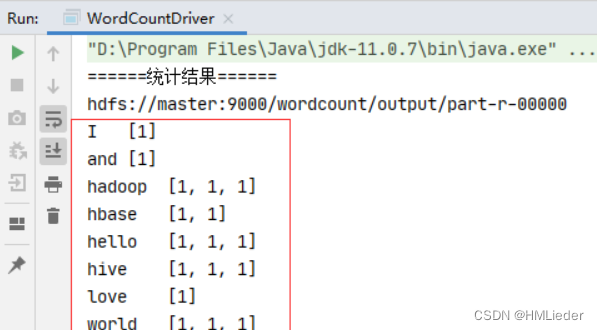

9、启动词频统计驱动器类,查看结果

对于这样一组键值对,我们需要Reducer组件来进行归并处理,结果如下所示

10、了解map阶段的输出值(reduce阶段的输入值)是一个迭代器

WordCountReducer类和WordCountDriver类

运行程序,查看结果

运行程序,查看结果

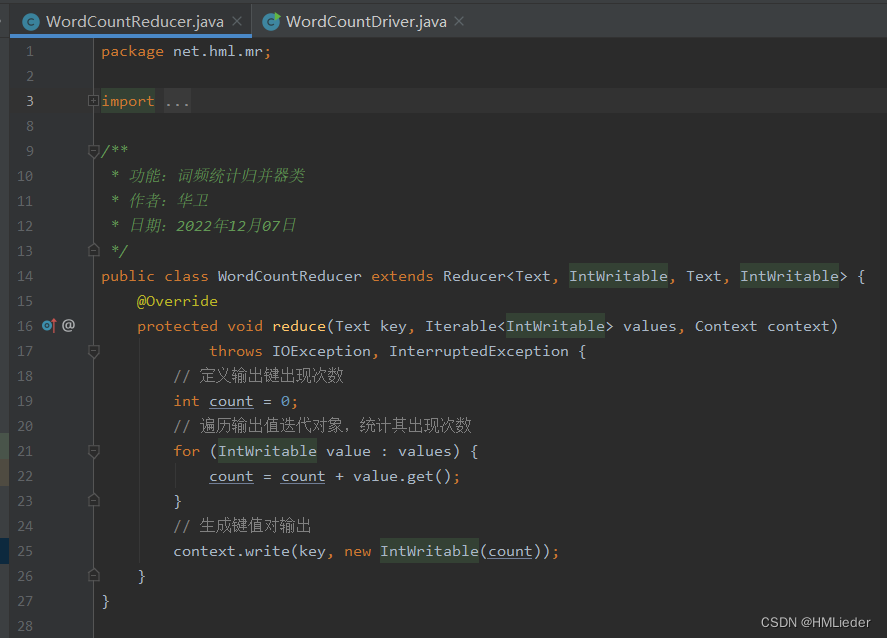

11、创建词频统计归并器类

一个类继承Reducer,变成一个Reducer组件类

Reducer组件会接收Mapper组件的输出结果

第一个泛型对应的是Mapper输出key类型

第二个泛型对应的是Mapper输出value类型

第三个泛型和第四个泛型是Reducer的输出key类型和输出value类型

Reducer组件不能单独存在,但是Mapper组件可以单独存在

当引入Reducer组件后,输出结果文件内容就是Reducer的输出key和输出value

在net.hml.mr包里创建WordCountReducer类

package net.hml.mr;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

/**

* 功能:词频统计归并器类

* 作者:华卫

* 日期:2022年12月07日

*/

public class WordCountReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

// 定义输出键出现次数

int count = 0;

// 遍历输出值迭代对象,统计其出现次数

for (IntWritable value : values) {

count = count + value.get();

}

// 生成键值对输出

context.write(key, new IntWritable(count));

}

}

12、修改词频统计驱动器类

设置WordCountReducer,并且设置归并任务的输出键值类型

// 设置Reducer类

job.setReducerClass(WordCountReducer.class);

// 设置reduce任务输出键类型

job.setOutputKeyClass(Text.class);

// 设置reduce任务输出值类型

job.setOutputValueClass(IntWritable.class);

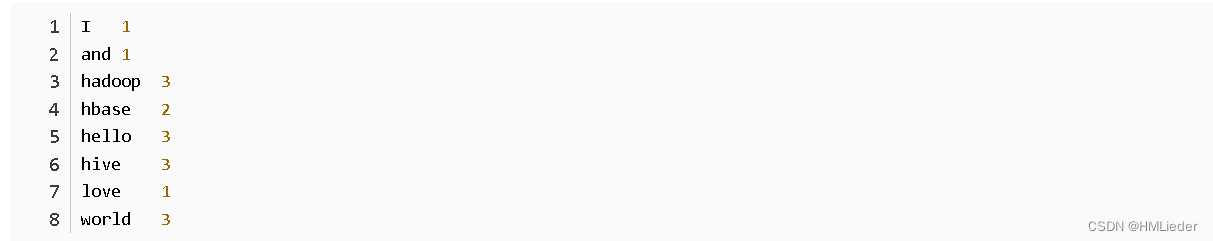

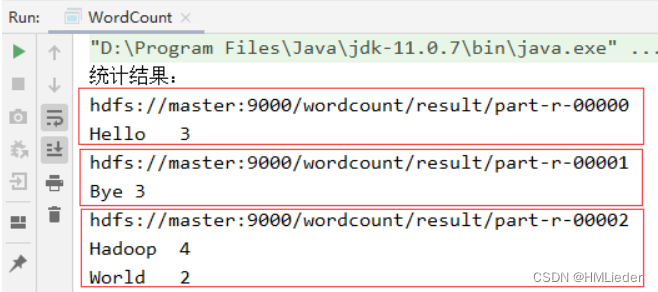

13、启动词频统计驱动器类,查看结果

统计出每个单词出现的次数

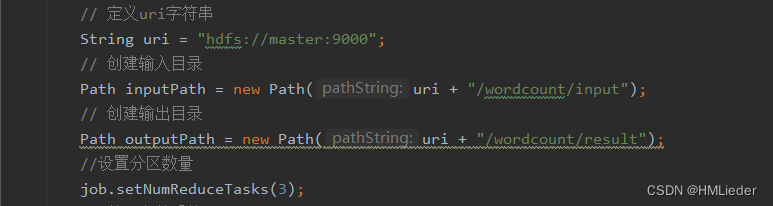

14、采用多个Reduce做合并

(1)修改词频统计驱动器类,设置分区数量

设置分区数量:3

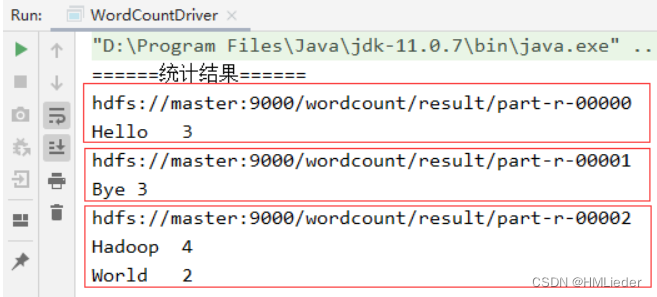

此时,运行程序,查看结果

可以看到,产生了三个结果文件

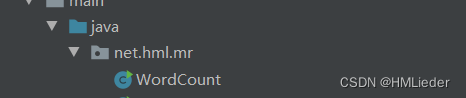

15、将三个类合并成一个类完成词频统计

在net.hml.mr包里创建WordCount类

package net.hw.mr;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner;

import java.io.IOException;

import java.net.URI;

/**

* 功能:词频统计

* 作者:华卫

* 日期:2022年10月09日

*/

public class WordCount extends Configured implements Tool {

public static class Map extends Mapper<LongWritable, Text, Text, IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 获取行内容

String line = value.toString();

// 按空格拆分得到单词数组

String[] words = line.split(" ");

// 遍历单词数组,生成输出键值对

for (int i = 0; i < words.length; i++) {

// 清洗所有英文标点符号(\p——属性[property],P——标点符号[Punctuation])

String word = words[i].replaceAll("[\\pP]", "");

context.write(new Text(word), new IntWritable(1));

}

}

}

public static class Reduce extends Reducer<Text, IntWritable, Text, IntWritable> {

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

// 定义输出键出现次数

int count = 0;

// 历输出值迭代对象,统计其出现次数

for (IntWritable value : values) {

count = count + value.get();

}

// 生成键值对输出

context.write(key, new IntWritable(count));

}

}

@Override

public int run(String[] strings) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 获取作业实例

Job job = Job.getInstance(conf);

// 设置作业启动类

job.setJarByClass(WordCount.class);

// 设置Mapper类

job.setMapperClass(Map.class);

// 设置map任务输出键类型

job.setMapOutputKeyClass(Text.class);

// 设置map任务输出值类型

job.setMapOutputValueClass(IntWritable.class);

// 设置Reducer类

job.setReducerClass(Reduce.class);

// 设置reduce任务输出键类型

job.setOutputKeyClass(Text.class);

// 设置reduce任务输出值类型

job.setOutputValueClass(IntWritable.class);

// 定义uri字符串

String uri = "hdfs://master:9000";

// 创建输入目录

Path inputPath = new Path(uri + "/wordcount");

// 创建输出目录

Path outputPath = new Path(uri + "/wordcount/result");

// 设置分区数量(reduce任务数量)

job.setNumReduceTasks(3);

// 获取文件系统

FileSystem fs = FileSystem.get(new URI(uri), conf);

// 删除输出目录

fs.delete(outputPath, true);

// 给作业添加输入目录

FileInputFormat.addInputPath(job, inputPath);

// 给作业设置输出目录

FileOutputFormat.setOutputPath(job, outputPath);

// 等待作业完成

boolean res = job.waitForCompletion(true);

// 输出统计结果

System.out.println("统计结果:");

FileStatus[] fileStatuses = fs.listStatus(outputPath);

for (int i = 1; i < fileStatuses.length; i++) {

// 输出结果文件路径

System.out.println(fileStatuses[i].getPath());

// 获取文件输入流

FSDataInputStream in = fs.open(fileStatuses[i].getPath());

// 将结果文件显示在控制台

IOUtils.copyBytes(in, System.out, 4096, false);

}

if (res) {

return 0;

} else {

return -1;

}

}

public static void main(String[] args) throws Exception {

int res = ToolRunner.run(new WordCount(), args);

System.exit(res);

}

}

运行程序,查看结果

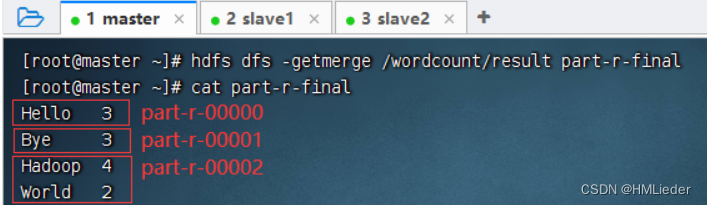

16、合并分区导致的多个结果文件

采用分区来处理,确实提高了效率,但是现在有多个结果文件,怎么合并它们成为一个最终的一个结果文件呢?

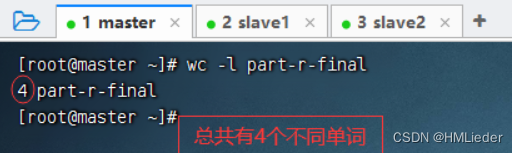

利用hadoop的-getmerge命令来完成:hdfs dfs -getmerge /wordcount/result part-r-final

17、统计不同单词数

利用MR对多个文件进行词频统计,得到的一个或多个结果文件,多个结果文件可以合并成一个最终结果文件,比如part-r-final,然后利用Linux命令统计行数即可。利用cat -nu命令。

本文介绍了MapReduce编程模型,通过一个词频统计的实例详细讲解了MapReduce的工作流程,包括创建Maven项目、配置日志属性、编写映射器类、驱动器类,以及如何运行和查看结果。同时,文章还讨论了如何处理多个结果文件的合并问题。

本文介绍了MapReduce编程模型,通过一个词频统计的实例详细讲解了MapReduce的工作流程,包括创建Maven项目、配置日志属性、编写映射器类、驱动器类,以及如何运行和查看结果。同时,文章还讨论了如何处理多个结果文件的合并问题。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?