一、注意力机制介绍

注意力机制来源于上个世纪90年代,认知领域的学者发现,人类在处理信息时,天然会过滤掉不太关注的信息,着重于感兴趣信息,于是将这种处理信息的机制称为注意力机制。注意力机制的灵感来源可以归结到人对环境的生理感知上来。比方说,我们的视觉系统更倾向于去挑选影像中的部分信息进行集中分析而忽略掉图像中的无关信息。

什么是注意力机制?

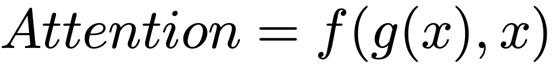

注意力机制可以理解为,计算机视觉系统在模拟人类视觉系统中可以迅速高效地关注到重点区域的特性。对于人类来说,当面对复杂场景的时候,我们可以迅速关注到重点区域,并处理这些区域。对于视觉系统,上述过程可以抽象成下面的式子:

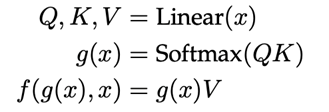

其中 g(x) 表示对输入特征进行处理并产生注意力的过程,f(g(x),x) 表示结合注意力对输入特征进行处理的过程。举两个具体的例子self-attention[2]和senet[3],对于 self-attention 来说,可以将上述公式具体化为:

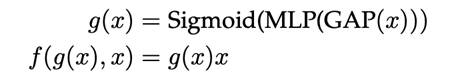

对于 senet 来说,可以将上述公式具体化为:

接下来,该综述尝试将不同的注意力机制进行具体化,即明确 g 过程和 f 过程。这是

注意力机制源自人类认知过程,通过赋予不同信息不同权重来关注重点。在计算机视觉中,它涉及软注意力、硬注意力和自注意力机制,常用于图像分类、目标检测等任务。自注意力在NLP和CV中广泛应用,如Non-local网络和VisualTransformers展示了其潜力。文章概述了注意力机制的发展历程和不同类型的注意力模型。

注意力机制源自人类认知过程,通过赋予不同信息不同权重来关注重点。在计算机视觉中,它涉及软注意力、硬注意力和自注意力机制,常用于图像分类、目标检测等任务。自注意力在NLP和CV中广泛应用,如Non-local网络和VisualTransformers展示了其潜力。文章概述了注意力机制的发展历程和不同类型的注意力模型。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章