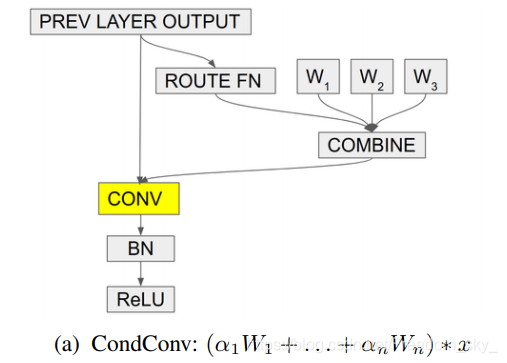

1、CondConv: Conditionally Parameterized Convolutions for Efficient Inference

根据每张图片自动生成与图片信息相关的卷积核,从而实现动态卷积的目的。(卷积核与每一张图片自动相关)

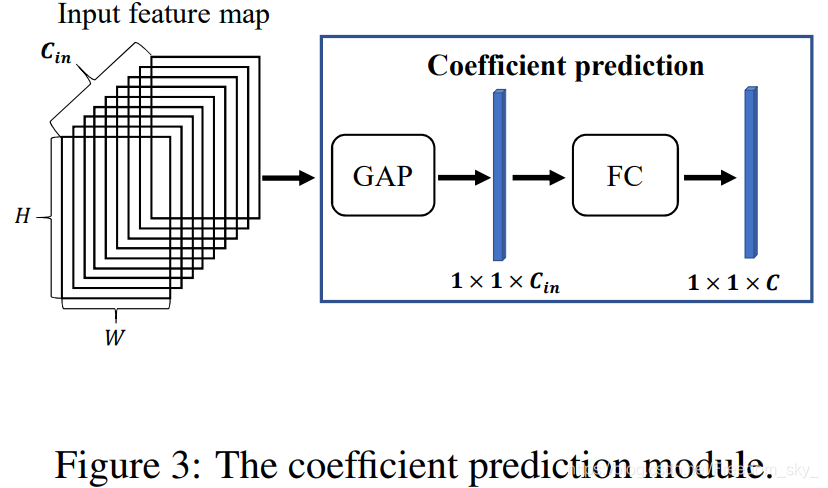

2、DYNET: DYNAMIC CONVOLUTION FOR ACCELERATING CONVOLUTIONAL NEURAL NETWORKS

Coefficient prediction 模块生成C个参数,再施加到gt个专家权重之上,即运用了通道注意力

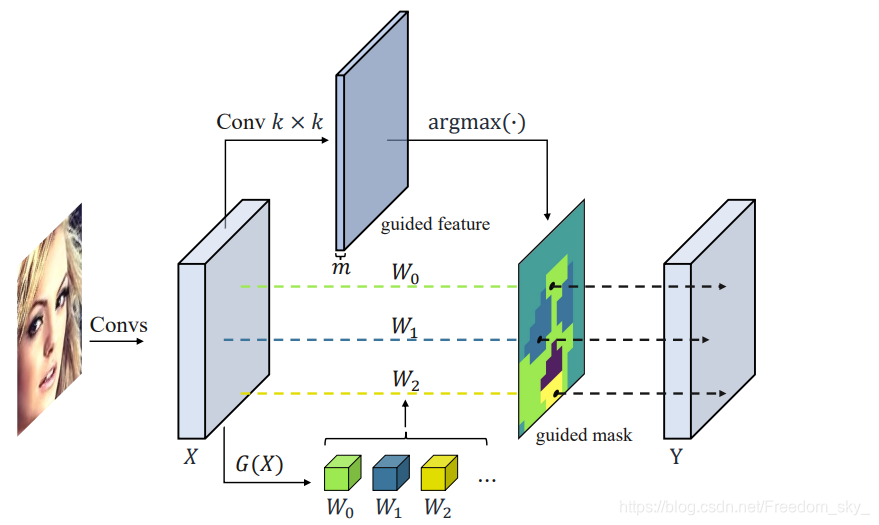

3、Dynamic Region-Aware Convolution

本文探讨了一系列用于提升卷积神经网络效率的技术,包括动态卷积(CondConv, DynamicConvolution)、动态区域感知卷积、多分支块(DiverseBranchBlock)、全连接层的重新参数化(RepMLP)以及动态组卷积。这些方法通过自适应地生成或选择卷积核,实现了针对不同输入的个性化处理,提高了模型的计算效率和性能。例如,WeightNet结合了条件卷积和通道注意力机制,而DynamicGroupConvolution则在分组卷积中自适应选择相关通道,以加速运算。

本文探讨了一系列用于提升卷积神经网络效率的技术,包括动态卷积(CondConv, DynamicConvolution)、动态区域感知卷积、多分支块(DiverseBranchBlock)、全连接层的重新参数化(RepMLP)以及动态组卷积。这些方法通过自适应地生成或选择卷积核,实现了针对不同输入的个性化处理,提高了模型的计算效率和性能。例如,WeightNet结合了条件卷积和通道注意力机制,而DynamicGroupConvolution则在分组卷积中自适应选择相关通道,以加速运算。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1489

1489

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?