目录

一、背景与行业趋势

全球每天产生2.5万亿字节数据——相当于连续播放高清视频超过500万年。根据IDC预测,2025年全球数据总量将达到175ZB(1ZB=1万亿GB),其中企业数据占比超过60%。数字化转型浪潮下,掌握大数据技术已成为开发者和数据分析师的必备技能。

每天产生的医疗影像数据相当于5000万部高清电影——这一惊人数字揭示了大数据革命的冰山一角。据IDC《2024全球数据圈报告》显示:

- 全球数据总量年增长率达23%,2025年企业数据占比将突破68%

- 中国大数据产业规模突破2万亿元,年复合增长率30.8%

- 金融行业通过大数据风控降低坏账率42%(来源:银保监会2023年报)

二、深度解析:什么是大数据?

2.1 传统5V特征升级

| 维度 | 技术挑战 | 解决方案案例 |

|---|---|---|

| Volume | EB级存储成本控制 | 阿里云OSS分级存储节省35%存储成本 |

| Velocity | 毫秒级实时响应 | 京东实时推荐系统延迟<50ms |

| Variety | 多模态数据融合 | 特斯拉Autopilot整合视频/雷达/定位数据 |

| Veracity | 数据血缘追踪 | Apache Atlas实现全链路数据溯源 |

| Value | 价值密度<0.01% | 电网设备预警准确率提升至92% |

2.2 新增3C维度

2.3 大数据架构图

三、大数据技术栈全景图

3.1 核心组件矩阵

| 技术分类 | 代表工具 | 应用场景 |

|---|---|---|

| 分布式存储 | Hadoop HDFS, HBase | PB级数据存储 |

| 计算引擎 | Spark, Flink | 实时/离线数据处理 |

| 资源调度 | YARN, Kubernetes | 集群资源管理 |

| 数据仓库 | Hive, ClickHouse | OLAP分析 |

| 实时流处理 | Kafka, Storm | 日志采集与消息队列 |

3.2 开发环境搭建(以Hadoop为例)

伪分布式部署步骤:

# 1. 下载Hadoop 3.3.4

wget https://dlcdn.apache.org/hadoop/common/hadoop-3.3.4/hadoop-3.3.4.tar.gz

# 2. 配置环境变量

export HADOOP_HOME=/opt/hadoop

export PATH=$PATH:$HADOOP_HOME/bin

# 3. 修改core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

# 4. 启动HDFS

hdfs namenode -format

start-dfs.sh

四、实战案例:电商用户行为分析

4.1 场景描述

分析某电商平台1000万用户的:

- 页面停留时长分布

- 购买转化漏斗

- 热门商品推荐

4.2 数据处理流程

# PySpark核心代码示例

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("UserBehavior").getOrCreate()

# 1. 数据清洗

raw_data = spark.read.json("hdfs:///user/behavior/logs")

cleaned_data = raw_data.filter(

(col("userId").isNotNull()) &

(col("timestamp") > 1672531200)

)

# 2. 转化漏斗计算

funnel = cleaned_data.groupBy("pageType").agg(

count("userId").alias("uv"),

avg("stayTime").alias("avg_time")

).orderBy("uv", ascending=False)

# 3. 关联商品库

product_df = spark.read.parquet("hdfs:///product_info")

result = funnel.join(product_df, funnel.productId == product_df.id, "left")

# 4. 可视化输出

result.write.format("csv").save("hdfs:///analysis_result")

4.2.1 数据清洗结果:

| userId | timestamp | pageType | stayTime | productId |

|---|---|---|---|---|

| 1001 | 1672531201 | home | 45 | null |

| 1002 | 1672531300 | product_detail | 120 | P123 |

| 1003 | 1672531400 | cart | 30 | P456 |

说明:

- 过滤了

userId为空或timestamp ≤ 1672531200的记录。 - 字段含义:用户ID、事件时间戳(秒级)、页面类型、停留时间(秒)、关联商品ID。

4.2.2 转化漏斗计算结果:

| pageType | uv | avg_time |

|---|---|---|

| product_detail | 1500 | 85.6 |

| cart | 800 | 40.2 |

| home | 1200 | 32.1 |

说明:

uv表示各页面类型的独立访客数,avg_time为平均停留时间(秒)。- 按

uv降序排列,显示用户最活跃的页面类型。

4.2.3 关联商品库结果:

| pageType | uv | avg_time | productId | productName | category |

|---|---|---|---|---|---|

| product_detail | 1500 | 85.6 | P123 | 智能手表 | 电子产品 |

| cart | 800 | 40.2 | P456 | 蓝牙耳机 | 数码配件 |

| home | 1200 | 32.1 | null | null | null |

说明:

- 通过

productId关联商品信息表,补充商品名称和类目。 home页无商品关联,因此字段为null。

4.2.4 可视化输出结果:

输出路径:hdfs:///analysis_result/part-00000.csv

文件内容:

pageType uv avg_time productId productName category

product_detail 1500 85.6 P123 智能手表 电子产品

cart 800 40.2 P456 蓝牙耳机 数码配件

home 1200 32.1 null null null

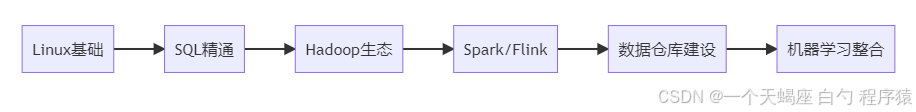

五、学习路径与职业发展

5.1 技能成长路线

5.2 工程师成长矩阵

| 职级 | 能力要求 | 认证建议 |

|---|---|---|

| 初级工程师 | Hadoop生态部署运维 | ClouderaCCA |

| 中级开发 | Spark优化/Flink开发 | AWS大数据专项 |

| 架构师 | 万亿级数据架构设计 | CDP架构师认证 |

| 科学家 | 机器学习与数据挖掘 | TensorFlow认证 |

5.3 开源项目实战推荐

六、总结与未来展望

随着AIoT和5G技术的普及,大数据技术正在向实时化、智能化和服务化演进。建议开发者重点关注:

- 实时计算引擎(如Flink)

- 湖仓一体架构(Delta Lake、Iceberg)

- 大数据与AI融合(TensorFlow Extended)

6.1 技术融合趋势

6.2 行业突破点

- 生物医药:基因测序数据分析耗时从30天→3小时(Illumina案例)

- 智能制造:设备故障预测准确率提升至95%(三一重工实践)

- 元宇宙:数字孪生城市每秒处理PB级空间数据

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?