摘要:随着人口老龄化程度的不断加深,老年人居家及机构看护过程中因摔倒、滑倒等意外事件引发的安全问题日益突出。传统人工监护方式存在实时性差、监控成本高等不足,亟需借助智能化技术实现高效、可靠的自动监测与预警。针对上述需求,本文研究并设计了一种基于深度学习的老人摔倒/滑倒智能检测与报警系统。

作者:Bob(原创)

项目概述

随着人口老龄化进程的不断加快,老年人因摔倒、滑倒等意外事件导致的伤害风险显著增加,已成为影响老年人生命安全与生活质量的重要问题。传统基于人工巡查或简单传感器的监护方式在实时性、准确性和适用范围等方面存在明显不足,难以满足复杂实际场景下的长期监测需求。因此,研究一种基于计算机视觉的老年人跌倒行为自动识别与智能报警方法,具有重要的理论意义和实际应用价值。

针对上述问题,本文提出并实现了一种基于深度学习目标检测模型 YOLOv11 的老人摔倒与滑倒检测系统。系统以视频流为输入,利用改进的目标检测网络对老年人关键行为进行实时识别,并结合置信度阈值和时间间隔约束对报警事件进行判定与控制,从而有效减少误检和重复报警。在系统实现方面,采用 PyQt5 构建桌面端可视化界面,实现视频监控、报警提示、图像存储与用户交互功能;同时引入 SQLite 数据库对检测事件与用户操作日志进行统一管理,并设计数据分析模块,对报警事件的类别分布、发生频率及时间趋势进行统计与可视化展示。

实验结果表明,所构建的系统在多种测试场景下能够较为准确地识别老年人摔倒与滑倒行为,具有良好的实时性与稳定性。通过引入事件合并机制,系统在保证报警有效性的同时显著降低了冗余报警次数。综合分析表明,本文所提出的基于深度学习的老人跌倒检测与报警系统在智能养老与居家安全监护领域具有较强的实用性和推广潜力,可为相关研究与工程应用提供参考。

算法概述

YOLO11是Ultralytics YOLO 系列实时目标检测模型的最新迭代版本,在检测精度、推理速度与计算效率等方面均取得了显著提升。该模型在继承以往 YOLO 系列优势的基础上,对网络架构设计与训练策略进行了系统性改进,从而在保证实时性的同时进一步增强了特征表达能力与检测鲁棒性。得益于上述改进,YOLO11 不仅在目标检测任务中表现出色,还能够有效扩展至图像分类、实例分割、目标跟踪及姿态估计等多种计算机视觉任务,展现出良好的通用性与应用潜力。

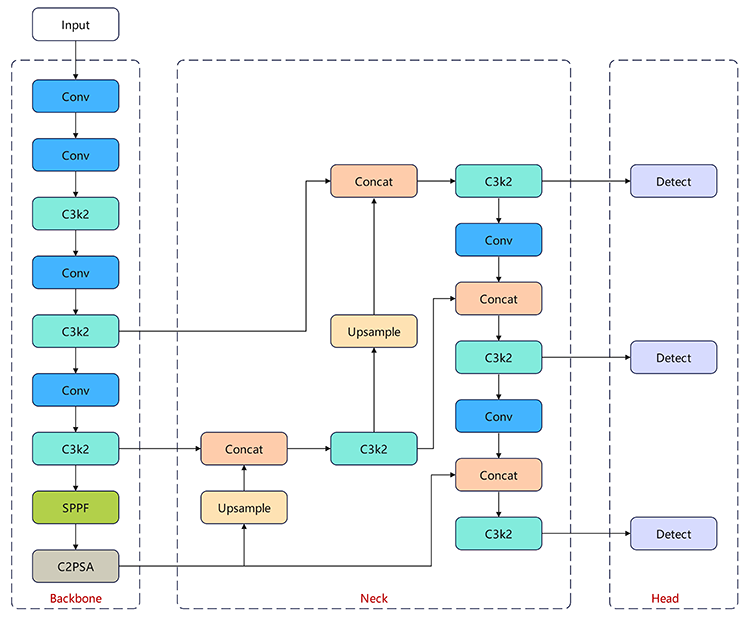

图1 YOLO11 网络结构示意图

图中给出了YOLO11的整体网络结构,模型采用Backbone–Neck–Head的分层设计框架。Backbone负责特征提取,Neck通过多尺度特征融合增强对不同尺寸目标的感知能力,Head在多尺度特征图上进行预测输出,从而提高目标检测的精度与稳定性。

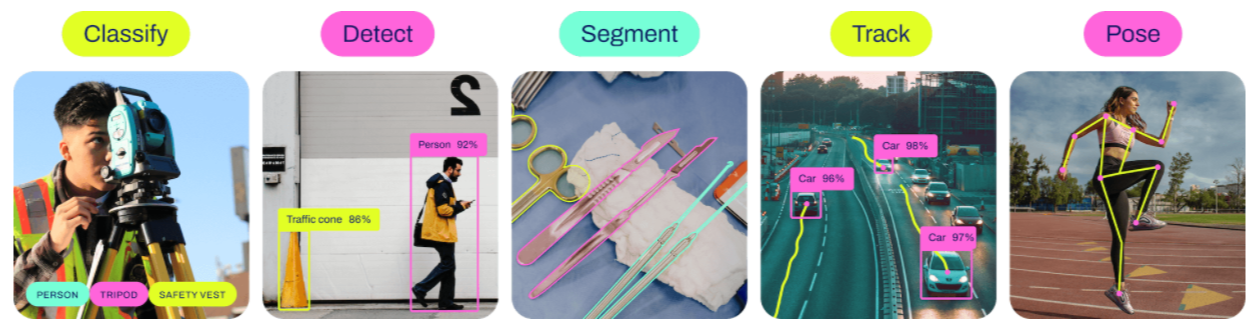

图2 YOLO11支持的多任务视觉能力示意图

图中展示了YOLO11在统一框架下支持的多种计算机视觉任务,包括图像分类、目标检测、实例分割、目标跟踪以及姿态估计。该统一建模方式有效提升了模型的通用性与扩展能力,使 YOLO11 能够适配多样化的计算机视觉应用场景。

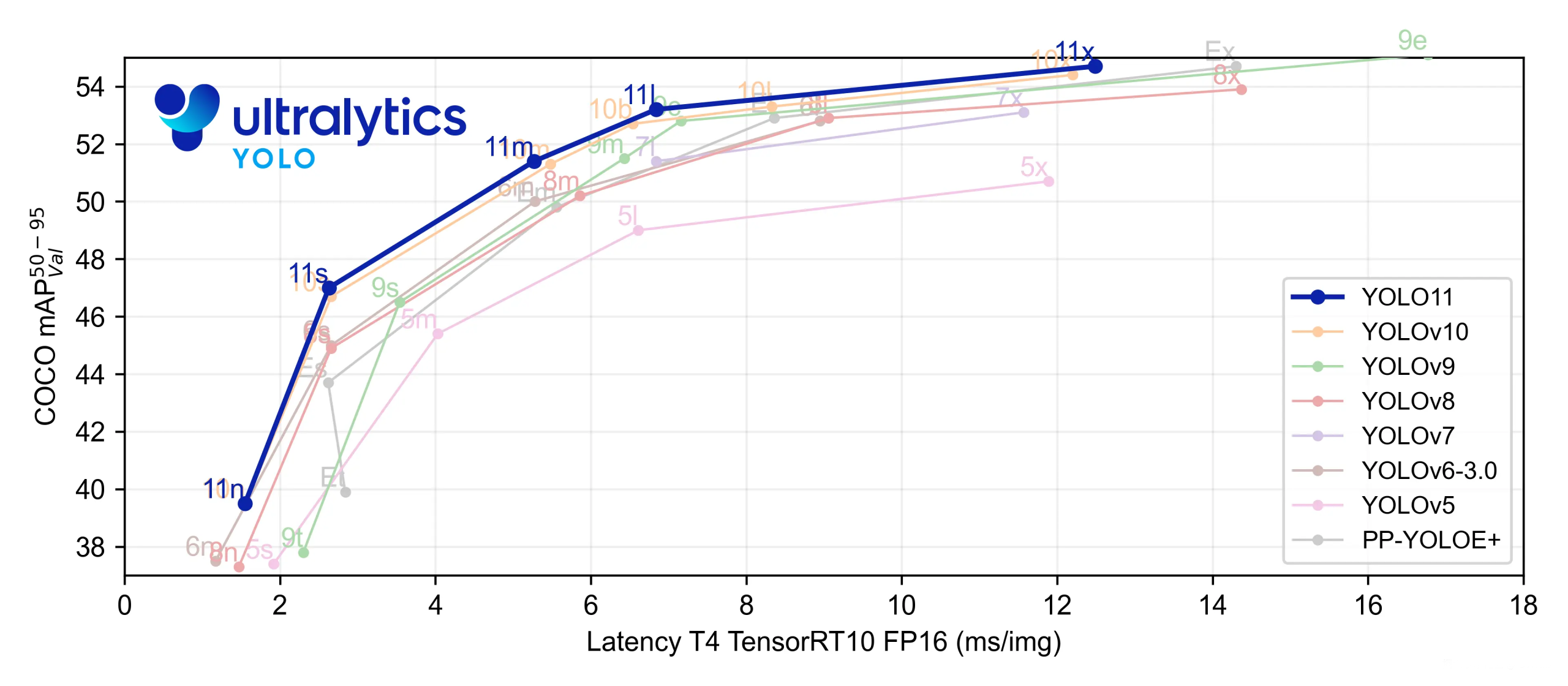

图3 YOLO11与历代YOLO模型的精度–延迟对比图

图中展示了在NVIDIA T4 + TensorRT 10 + FP16推理配置下,不同YOLO系列模型在 COCO val 数据集上的检测精度(mAP50–95)与推理延迟(ms/img)之间的性能权衡关系。实验结果表明,YOLO11在相同或更低推理延迟条件下取得了更高的检测精度,在速度与准确率之间实现了更优的权衡,体现了其在实时目标检测任务中的性能优势。

系统设计

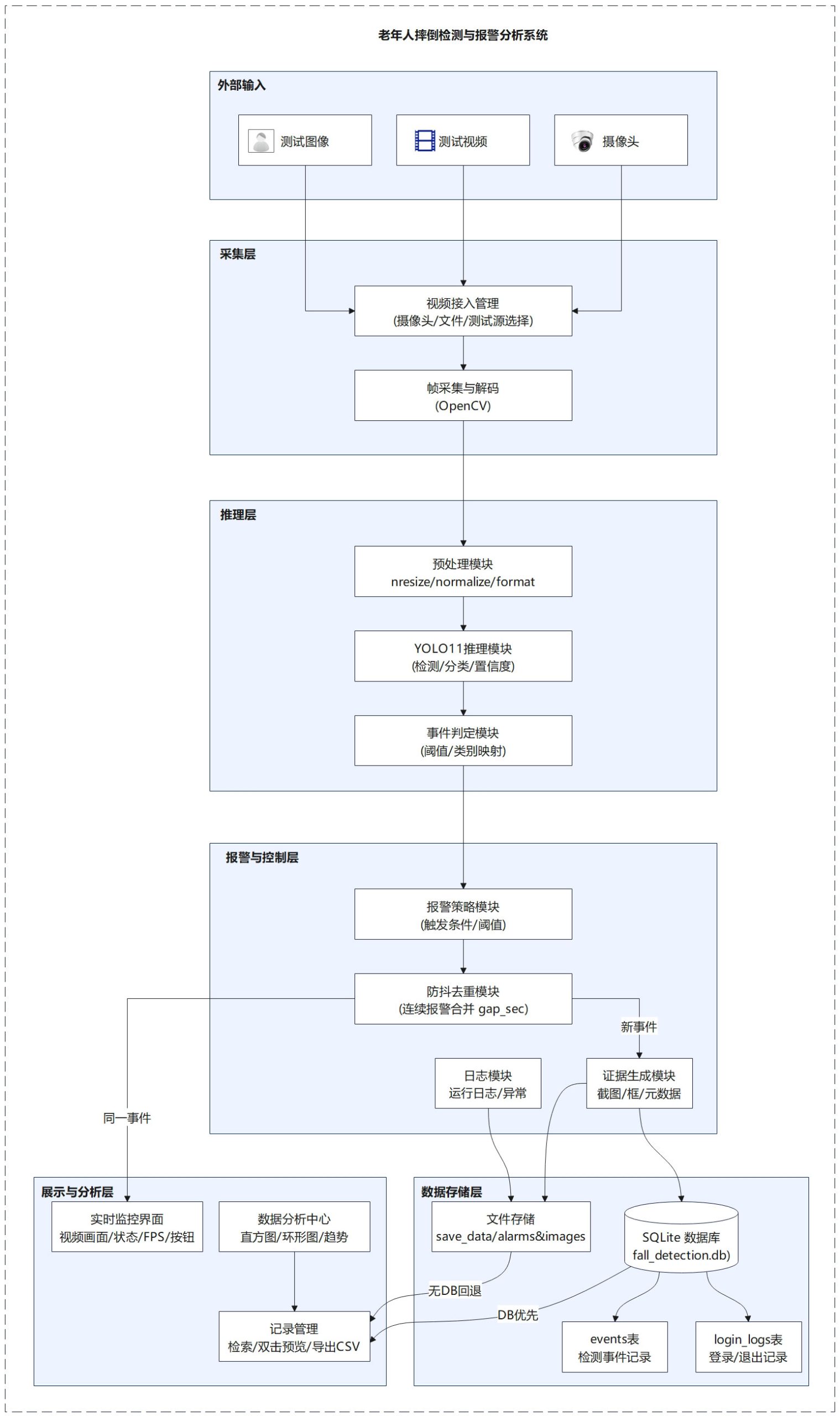

本系统采用基于 YOLOv11 的深度学习目标检测模型,对视频流中的老年人行为进行实时分析与识别,并结合桌面可视化界面、事件管理与数据分析模块,实现老年人摔倒与滑倒行为的自动检测、智能报警及统计分析功能。

图4 系统总体架构图

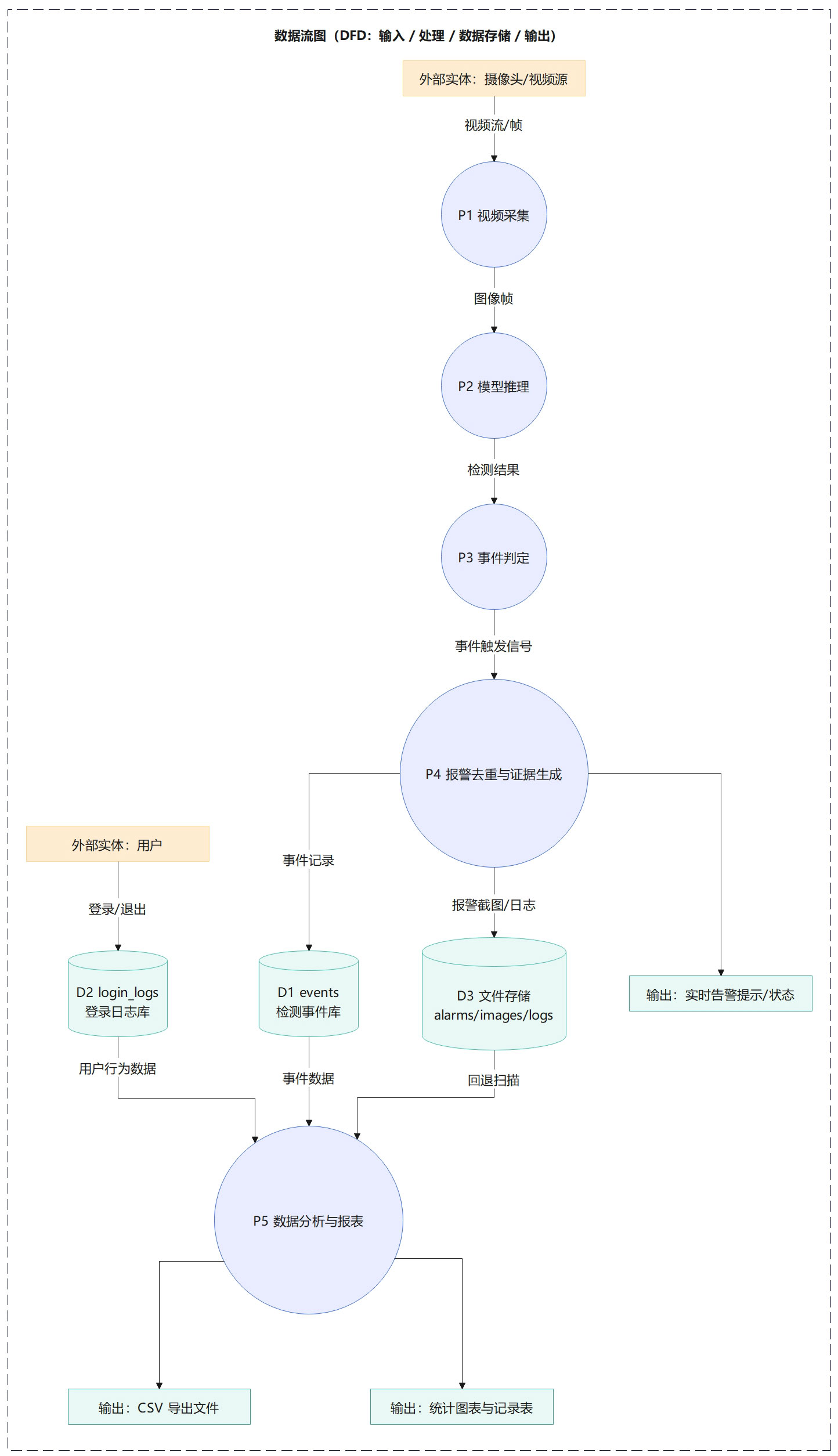

图5 数据流图

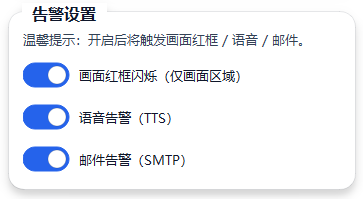

报警机制

为降低单帧检测误判所引起的误报风险,并进一步提升系统在实际应用场景中的稳定性与可靠性,本文在目标检测结果的基础上设计了一种融合多帧确认与冷却约束的跌倒报警机制。首先,基于训练完成的 YOLO 目标检测模型对输入视频流进行逐帧分析,当检测结果中出现“摔倒”或“滑倒”等高风险行为类别时,将对应帧标记为疑似跌倒状态。

在此基础上,引入连续帧确认策略,通过对疑似跌倒状态在时间维度上的连续性进行约束,仅当该状态在连续若干帧内持续出现并达到预设阈值时,系统才判定跌倒事件成立并触发报警。该策略能够有效抑制由于人体姿态瞬时变化、局部遮挡或检测噪声所导致的偶发误报问题,从而提高跌倒识别结果的可靠性。

当跌倒事件被确认并触发报警后,为防止同一事件在短时间内被多次重复触发,系统进一步引入报警冷却机制。在冷却时间窗口内,即使检测结果仍持续为跌倒状态,系统也不会再次生成新的报警事件,从而避免报警信息的冗余输出。同时,考虑到实际监控环境中跌倒后人体姿态可能在短时间内出现一定程度的恢复或波动,本文设计了报警保持与延迟解除机制,使报警状态在触发后保持一段预设时间,仅在连续多帧检测结果恢复为正常状态后才解除报警显示。通过上述机制的协同作用,系统在保证报警响应及时性的同时,显著增强了报警决策的鲁棒性与稳定性,为后续的语音提示、邮件通知以及事件记录等功能模块提供了可靠的触发依据。

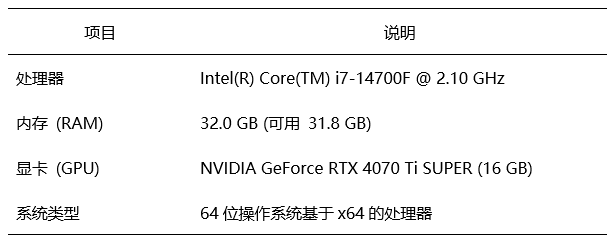

硬件配置

该系统硬件配置如上,如果您的电脑配置低于下述规格,运行速度可能会与本系统的存在差异,请注意。

表1 惠普(HP)暗影精灵10台式整机配置(系统硬件配置)

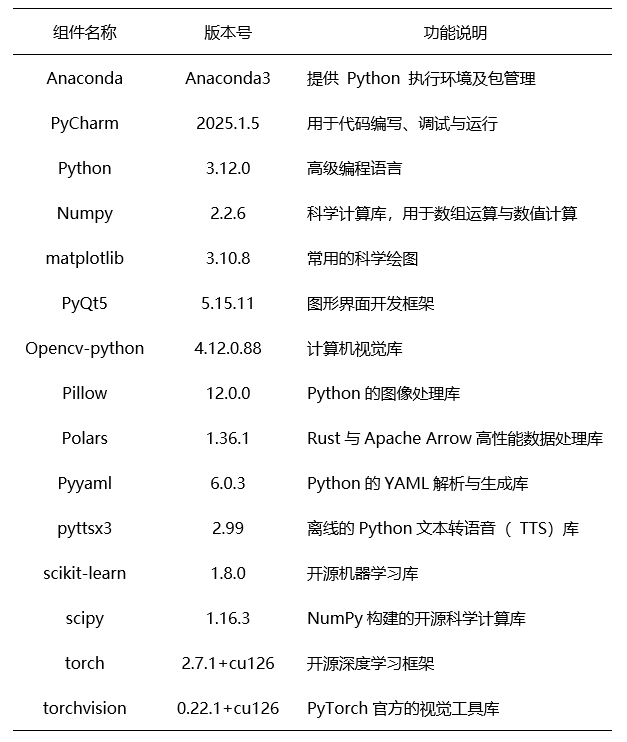

软件环境

对本实验所需的各类软件及工具的基本信息进行了清晰汇总。

表2 系统软件配置(真实运行环境)

数据集构建

1.数据来源

本系统采用猿创(2zocde)团队自建的、具有自主知识产权的行为识别数据集,该数据集围绕老年人日常行为与异常行为场景构建,主要包含老人弯腰(bend)、老人坐立(sit)、老人摔倒(fall)以及老人滑倒(slip_fall)等典型行为类别。数据集共包含数千张高质量影像样本,覆盖不同性别、不同年龄段及多样化监控场景,能够较为真实地反映实际应用环境中老年人行为的变化特征,确保了数据的多样性与代表性。上述数据被用于 YOLO 系列目标检测模型的训练、验证与测试过程,为提升模型对老年人摔倒及滑倒等异常行为的识别准确率和系统整体检测性能提供了可靠的数据支撑。

图6 数据集图片

2.数据增强

为提高老年人行为识别模型在复杂监控环境下的泛化能力与鲁棒性,本文在原始数据集的基础上引入多种图像数据增强策略,对训练样本进行扩展与扰动处理。通过对样本实施多样化的数据增强操作,可以有效缓解由于样本数量有限及场景单一所导致的模型过拟合问题,从而提升模型在实际应用场景中的检测稳定性与识别准确性。

图7 数据集图像增强方法示例

具体而言,本文综合采用几何变换与图像质量扰动相结合的数据增强方法。在几何变换方面,对原始图像进行水平翻转、垂直翻转以及水平与垂直组合翻转处理,以模拟不同摄像机安装角度和人物姿态变化对检测结果的影响;在图像质量扰动方面,引入高斯模糊、随机噪声、雾化处理、随机颜色偏移及亮度调整等增强方式,用于模拟复杂监控环境中常见的光照变化、成像模糊及环境干扰等情况。

通过上述数据增强策略的引入,训练样本的多样性与覆盖范围得到了有效扩展,使模型能够学习到更加稳健且具有判别性的特征表示。实验结果表明,采用数据增强策略后,YOLO 系列目标检测模型在老年人摔倒与滑倒等异常行为识别任务中的整体检测性能均有所提升,为系统的实际部署与应用提供了可靠的数据支撑。

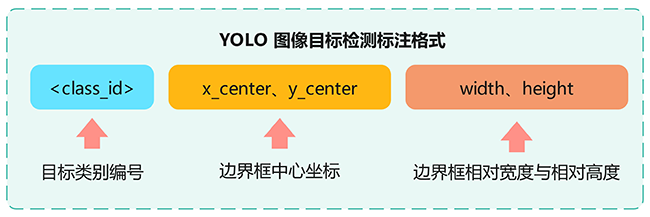

3.标注格式

本研究采用YOLO系列目标检测算法通用的标注格式对数据集进行标注。如图所示,YOLO标注文件以文本形式存储,每行对应一个目标实例,主要包含目标类别编号、边界框中心点的相对坐标以及边界框的相对宽度和高度。所有坐标信息均采用相对于原始图像尺寸的归一化表示,取值范围为0至1,从而减少不同分辨率图像对模型训练的影响,并提高模型在多尺度目标检测任务中的适应性。

图8 YOLO 图像目标检测标注格式示意图

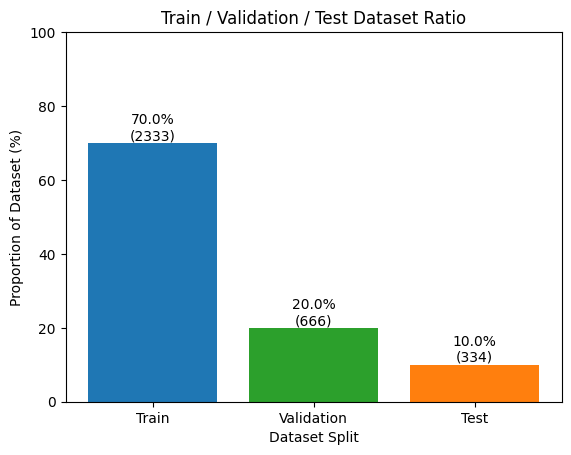

4.数据集划分

为保证模型训练与性能评估的客观性与可靠性,本文将所构建的数据集划分为训练集、验证集和测试集三部分。数据集按照 70% / 20% / 10% 的比例进行划分,其中训练集包含 2,333 张图像,用于模型参数的学习;验证集包含 666 张图像,用于模型超参数的调整与中间性能评估;测试集包含 334 张图像,用于对模型最终检测性能进行客观评估。该数据划分策略有助于系统性地分析模型的泛化性能。

图9 数据集在训练、验证和测试集上的分布

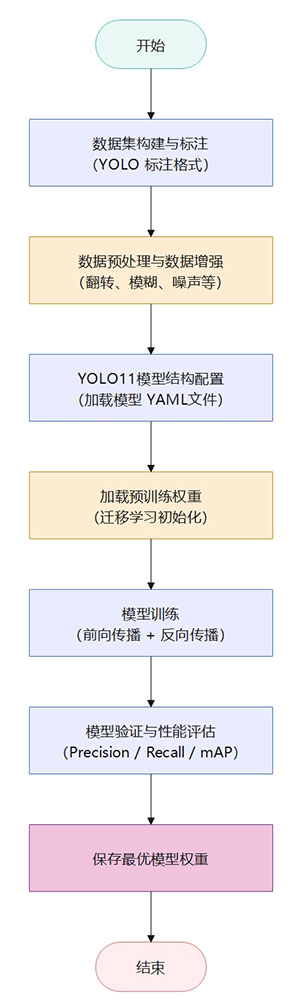

模型训练

模型训练流程如图所示。首先,对自建老年人行为识别数据集进行规范标注,并采用 YOLO 标准格式生成标签文件;随后对样本进行尺寸归一化与数据增强处理,以提升模型对复杂场景的鲁棒性。在此基础上,构建 YOLOv11 目标检测模型并加载官方预训练权重,引入迁移学习机制以加快模型收敛。训练过程中,通过前向传播与反向传播不断优化网络参数,并在验证集上评估模型性能,最终保存性能最优的模型权重用于系统部署。

图10 模型训练流程图

运行:train_v11.py

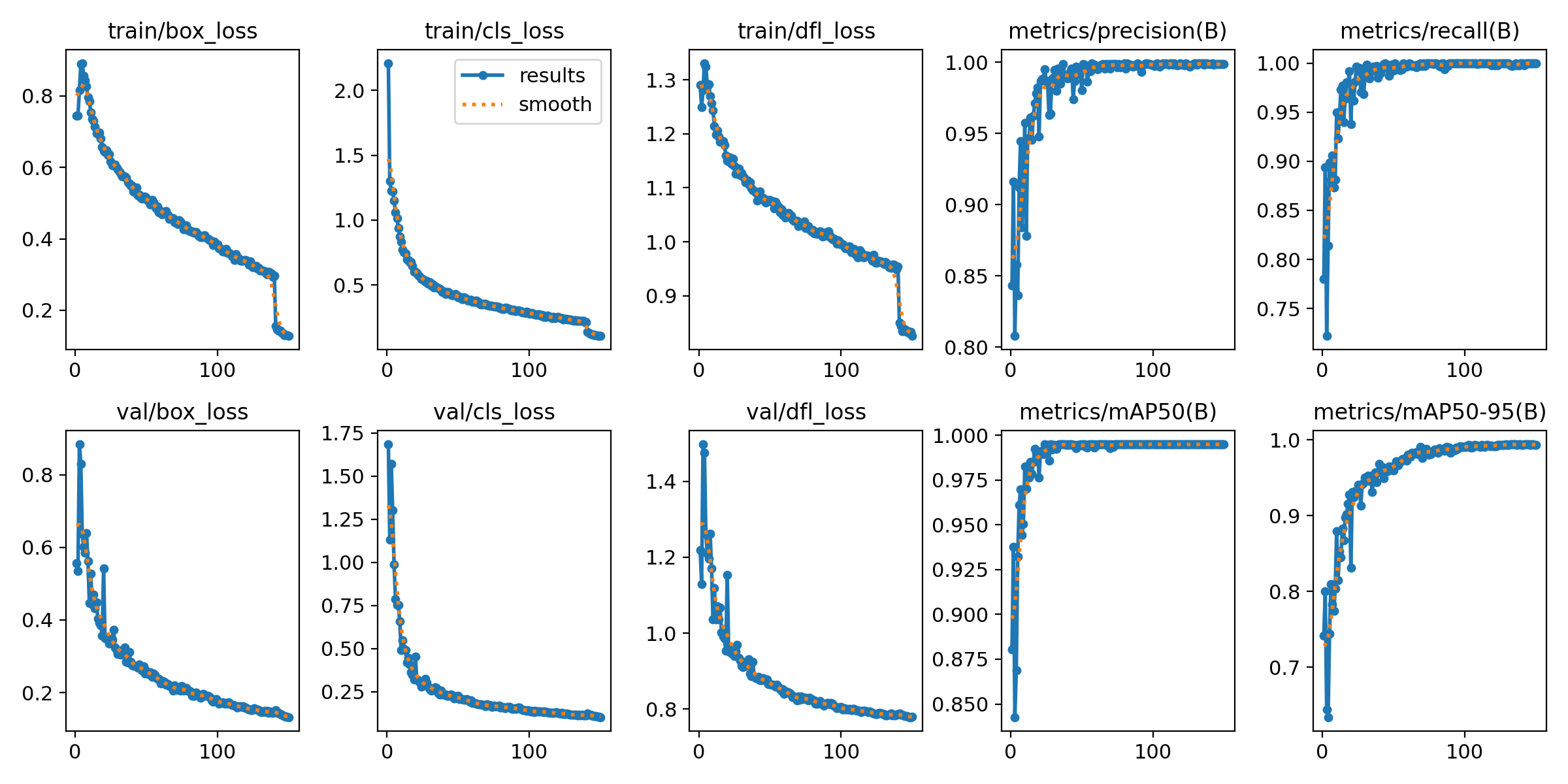

1.模型训练过程分析

图11 YOLOv11 模型训练与验证损失函数变化曲线

该图表明,随着训练轮次的增加,YOLOv11 模型在训练集与验证集上的各项损失函数均呈现出稳定下降并逐渐收敛的趋势,同时 Precision、Recall 及 mAP 指标持续提升并趋于稳定,说明模型训练过程收敛良好,未出现明显过拟合现象,整体检测性能稳定可靠。

2.检测性能曲线分析

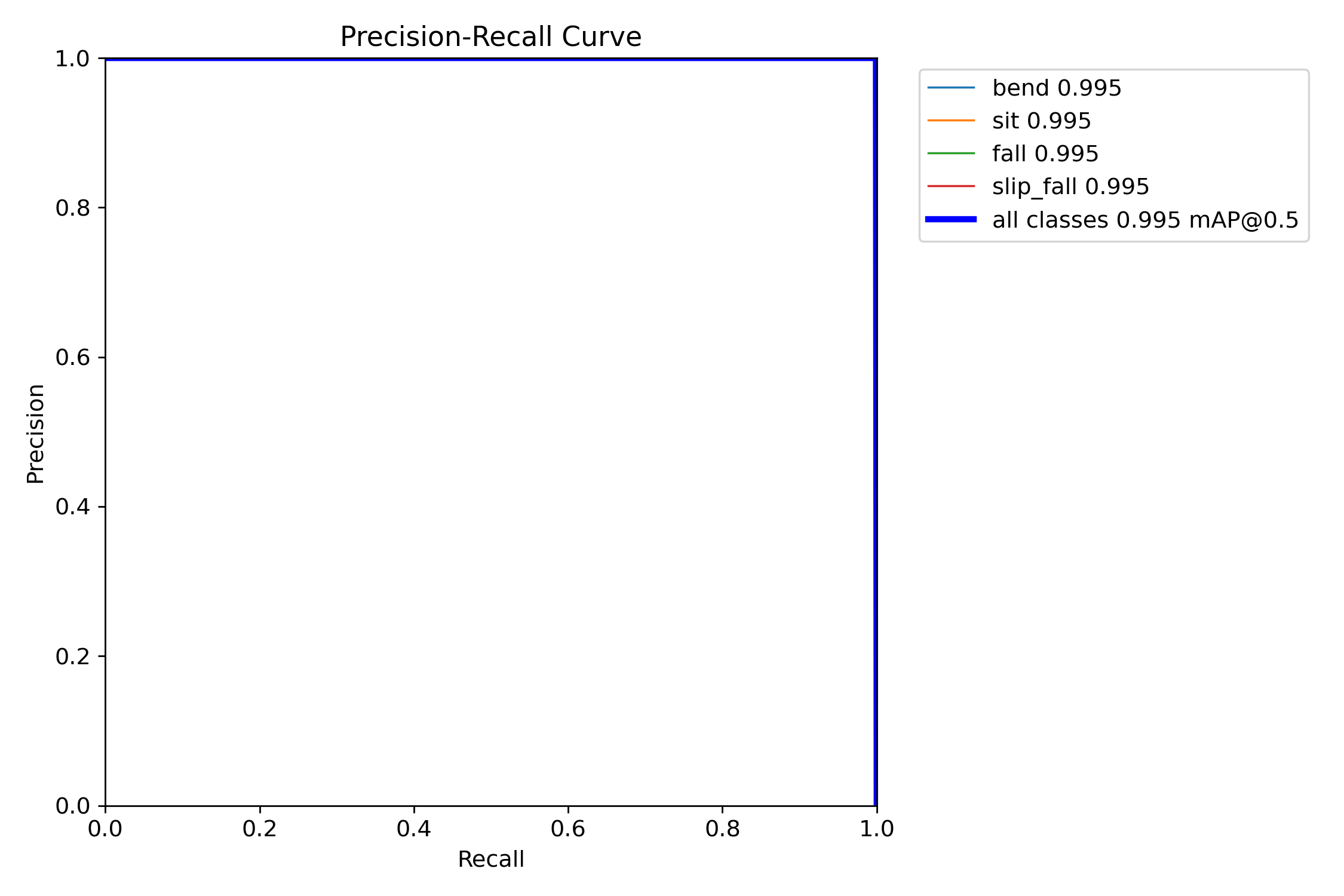

图12 Precision–Recall 曲线(PR 曲线)

该 PR 曲线显示各类别及整体曲线均紧贴右上角,Precision 与 Recall 同时保持在较高水平,且 mAP@0.5 达到 0.995,表明模型在老年人行为识别任务中具有极高的检测准确性与稳定的综合性能。

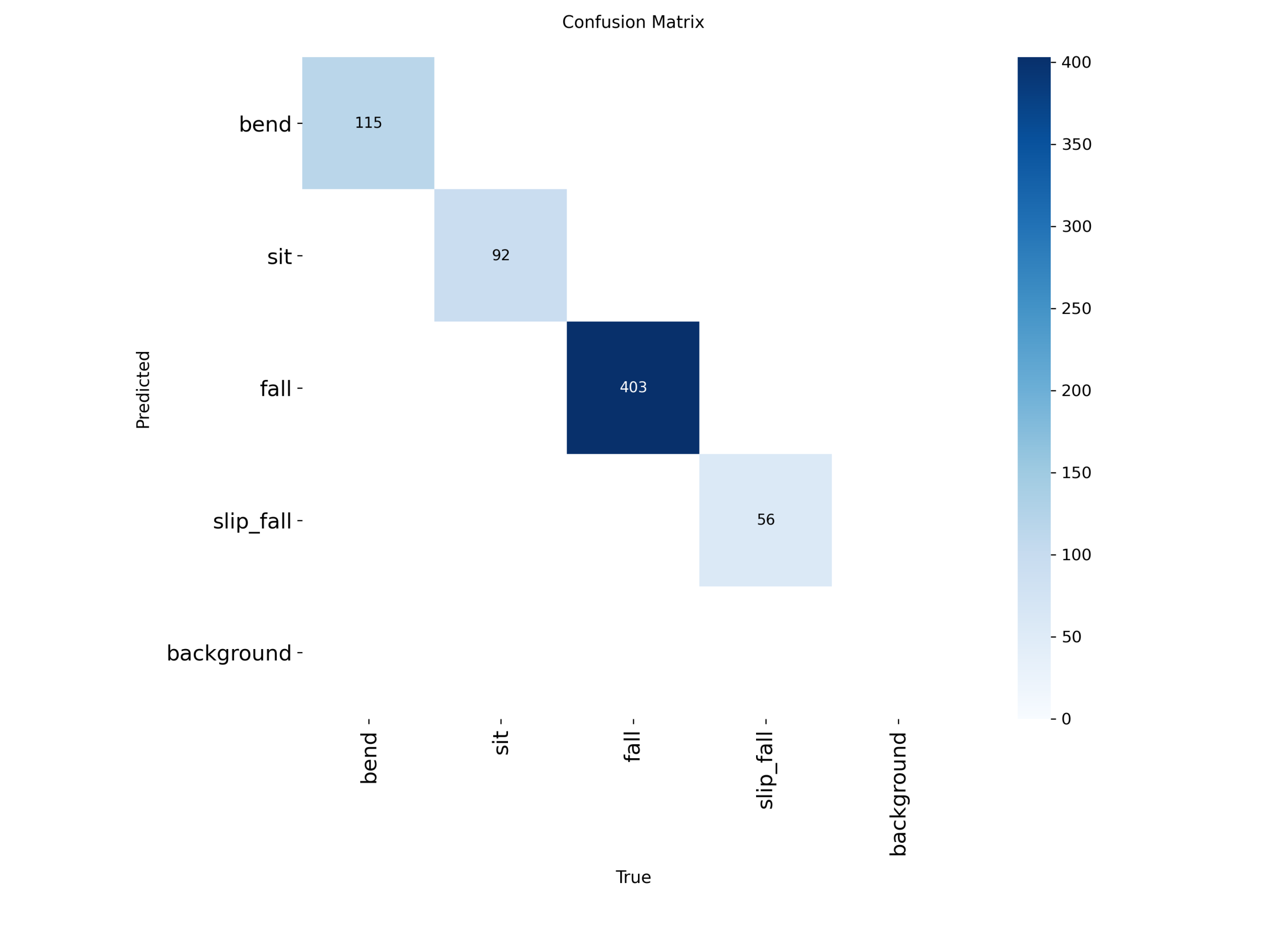

3.分类与识别效果分析

图13 老年人行为识别混淆矩阵

该混淆矩阵显示各类老年人行为样本主要集中于对角线位置,误分类现象较少,尤其在摔倒(fall)与滑倒(slip_fall)等关键异常行为上具有较高的识别准确率,表明模型具备良好的类别区分能力与整体识别性能。

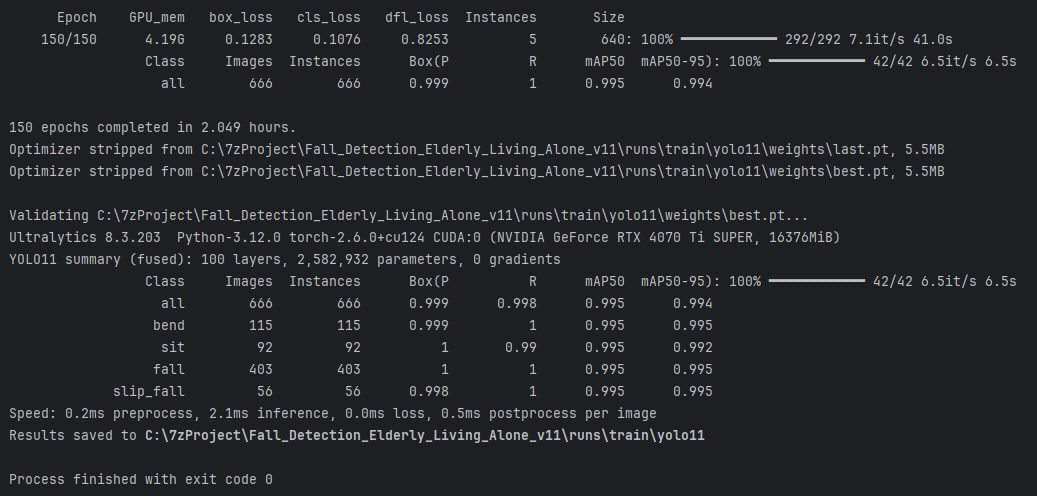

4.最终性能结果汇总

图14 YOLOv11 模型训练完成后的性能评估结果

从训练与验证结果可以看出,YOLOv11 模型在各类别上的 Precision、Recall 及 mAP 指标均接近 1.0,推理速度快且模型参数规模适中,表明模型在老年人行为识别任务中兼具较高检测精度与良好的实时性,满足实际应用需求。

模型推理

模型推理阶段通过加载训练得到的最优模型权重,对输入图像进行前向推理,输出目标的类别、置信度及位置信息,并经非极大值抑制筛选后生成最终检测结果,实现对老年人行为的自动识别与定位。

图15 YOLOv11 模型老年人摔倒行为推理检测结果示意图

如图所示,YOLOv11 模型能够准确识别图像中的老年人摔倒行为,并以较高置信度(0.97)完成目标定位,验证了模型在实际场景下具备良好的检测精度与推理效率。

运行展示

运行mainwindow.py

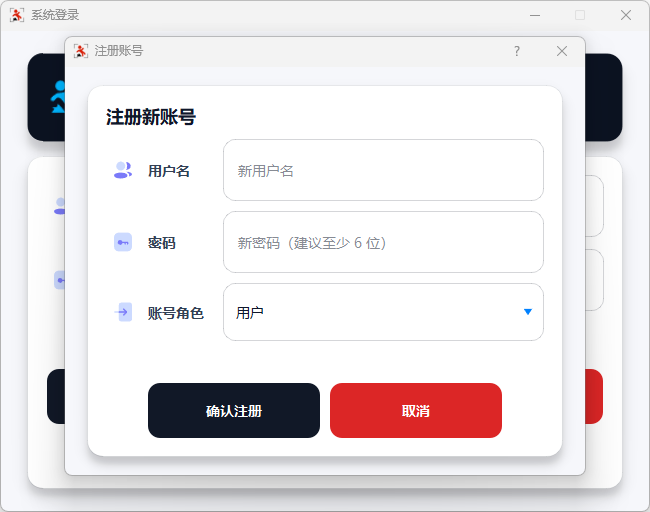

登录和注册

图16 登录注册主界面

图17 用户注册界面

图18 管理员注册界面

系统运行状态

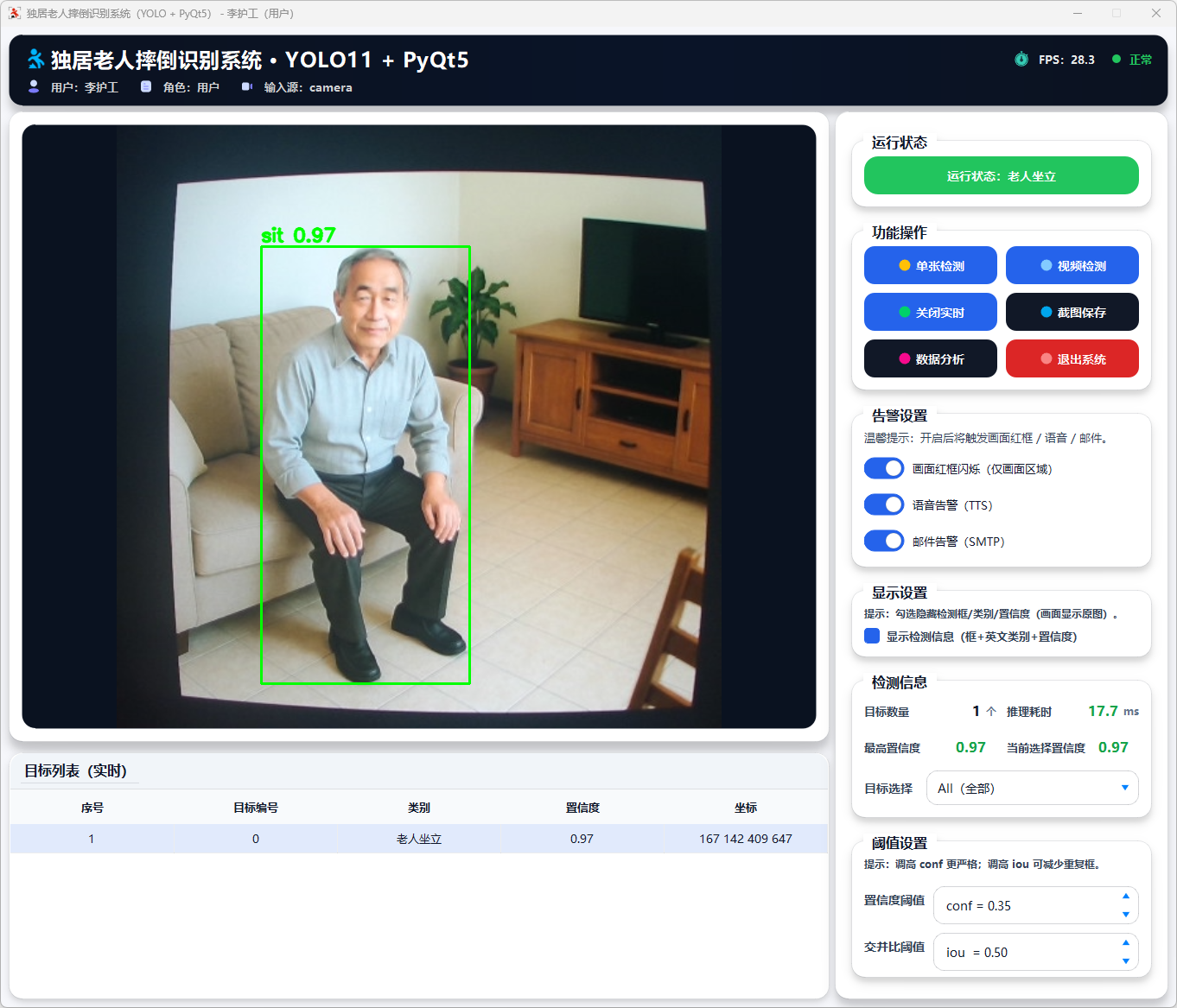

图18 系统主界面

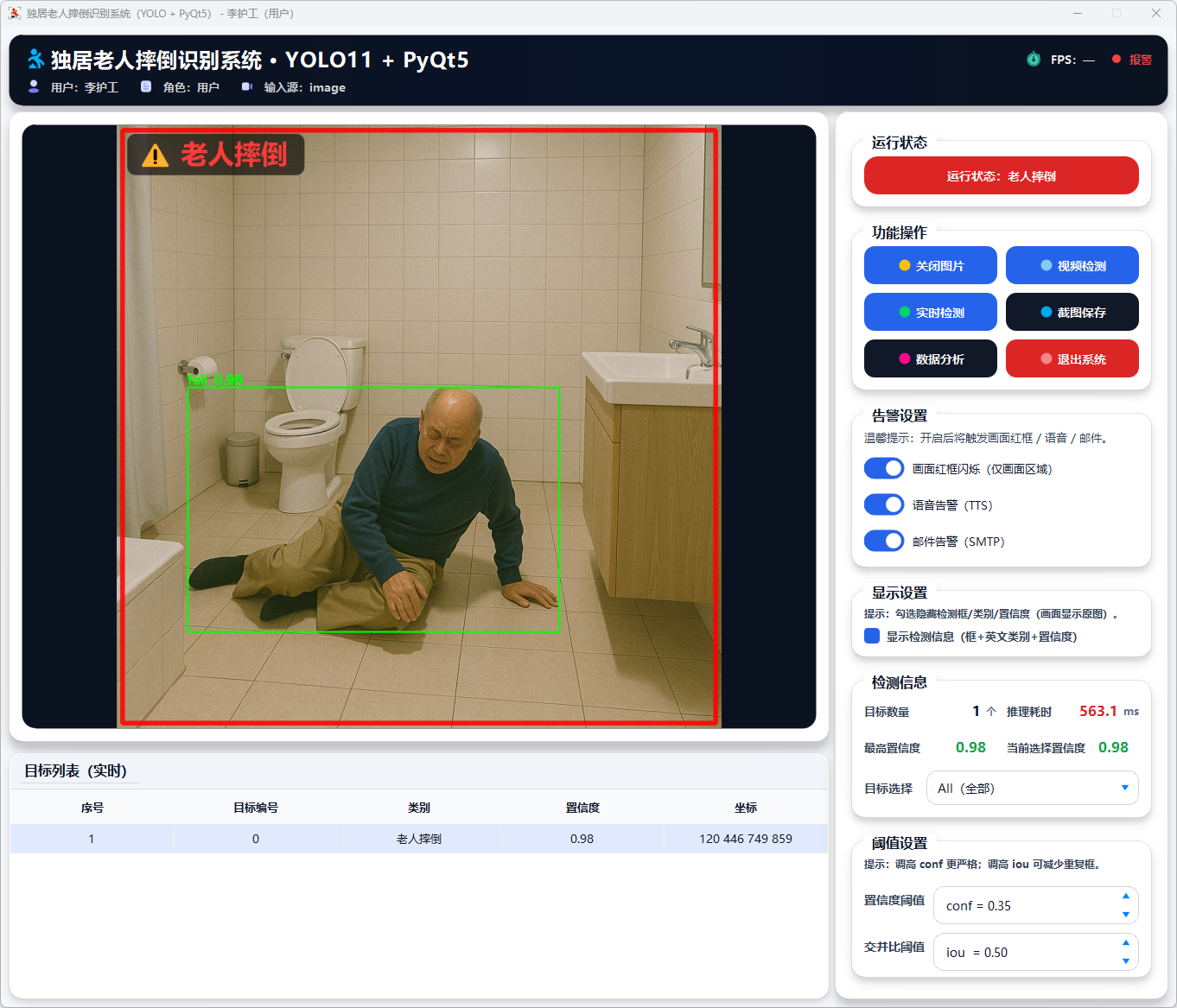

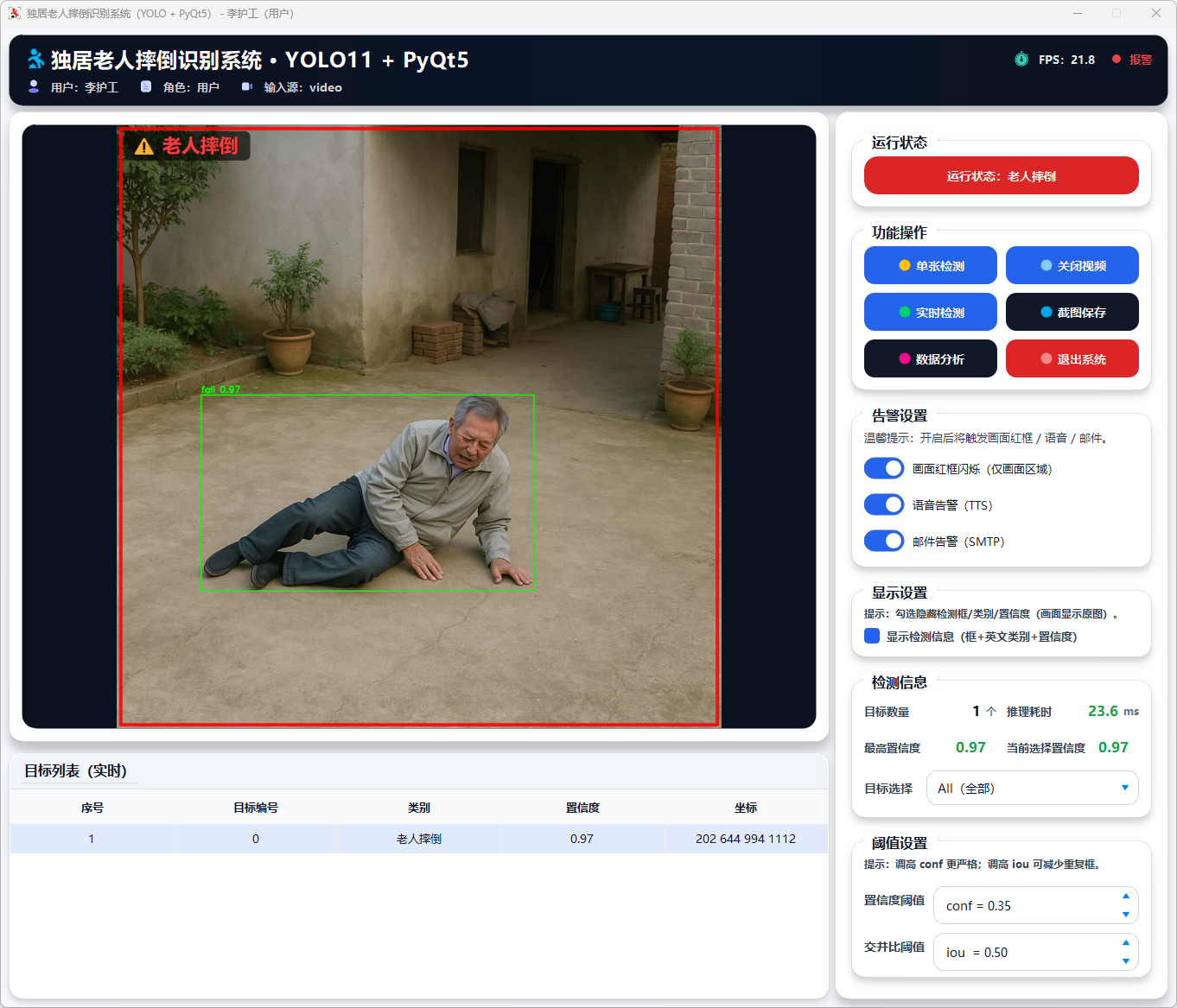

图19 单张检测:老人摔倒(画面红闪、语音告警、邮件通知)

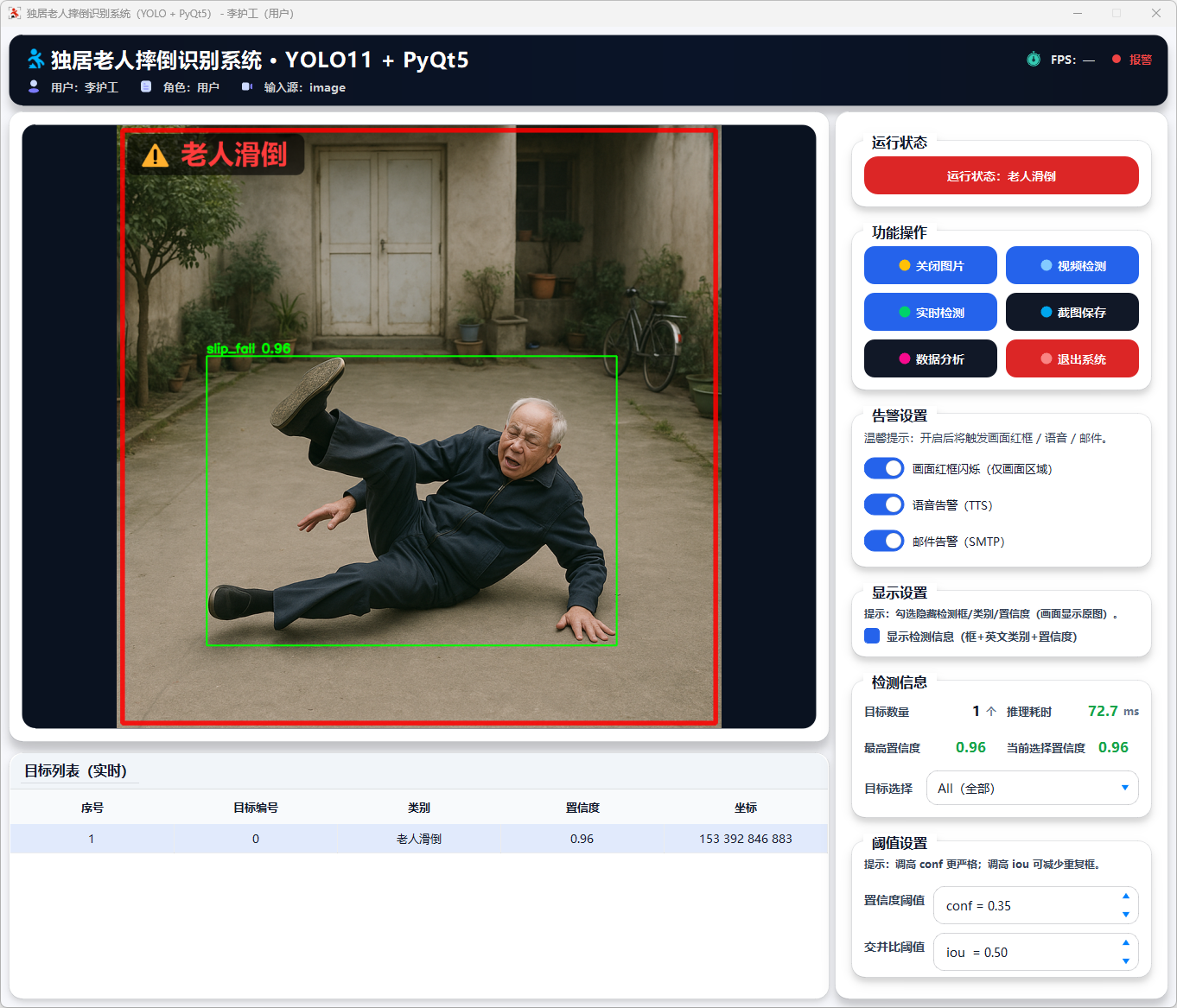

图20 单张检测:老人滑倒(画面红闪、语音告警、邮件通知)

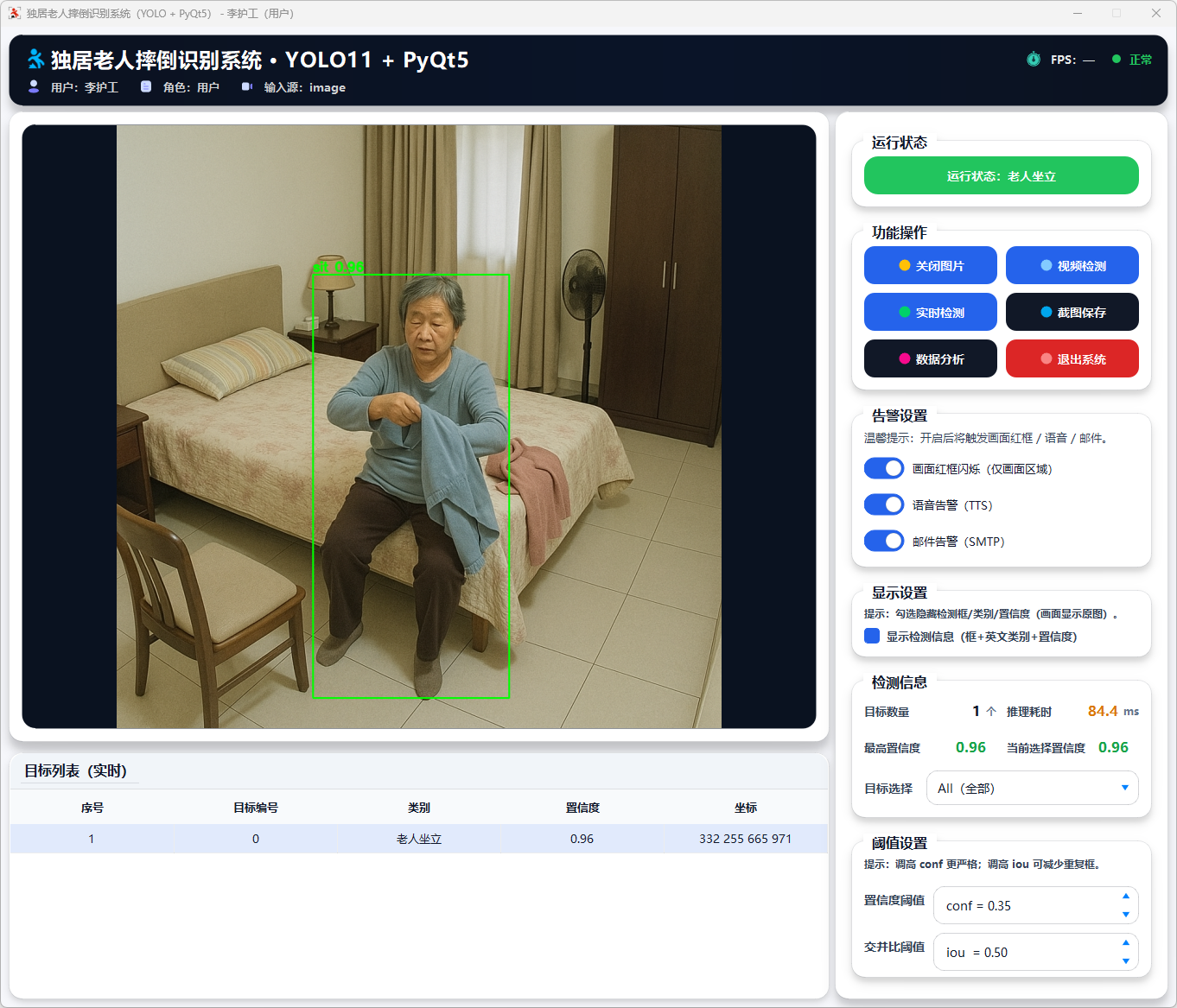

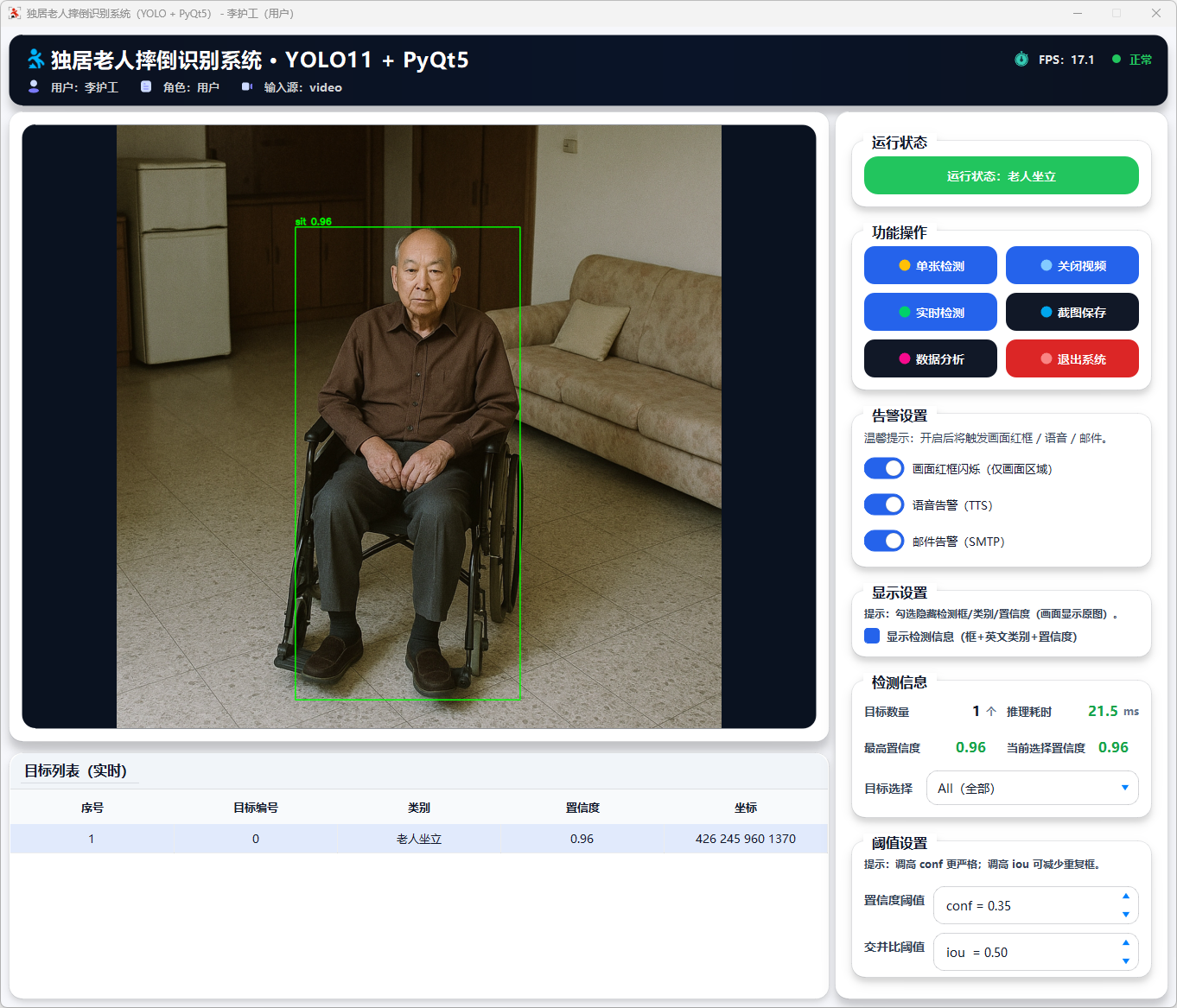

图21 单张检测:老人坐立 正常状态

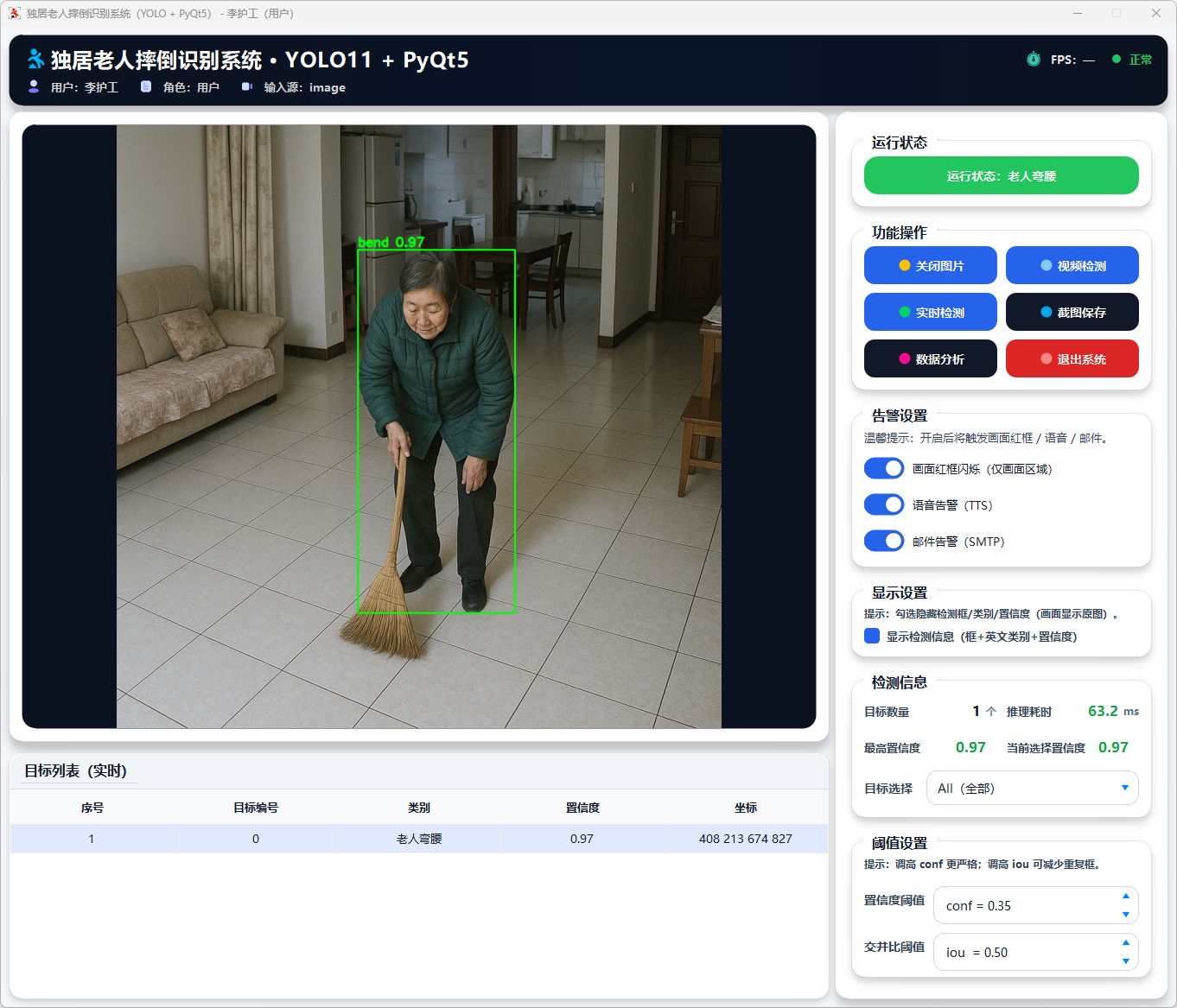

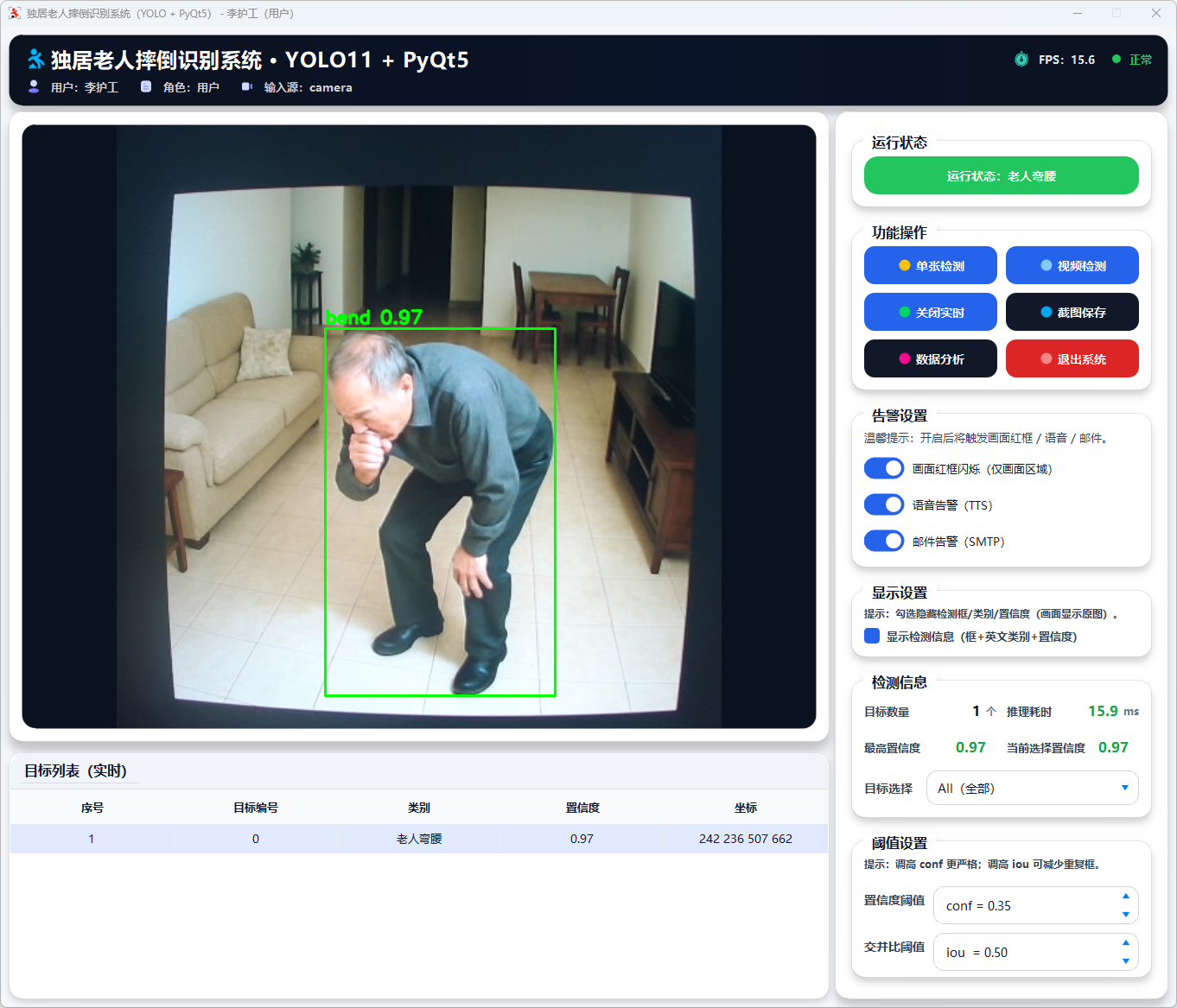

图22 单张检测:老人弯腰 正常状态

图23 视频检测:老人摔倒(画面红闪、语音告警、邮件通知)

图24 视频检测:老人滑倒(画面红闪、语音告警、邮件通知)

图25 视频检测:老人坐立 正常状态

图26 视频检测:老人坐立 正常状态

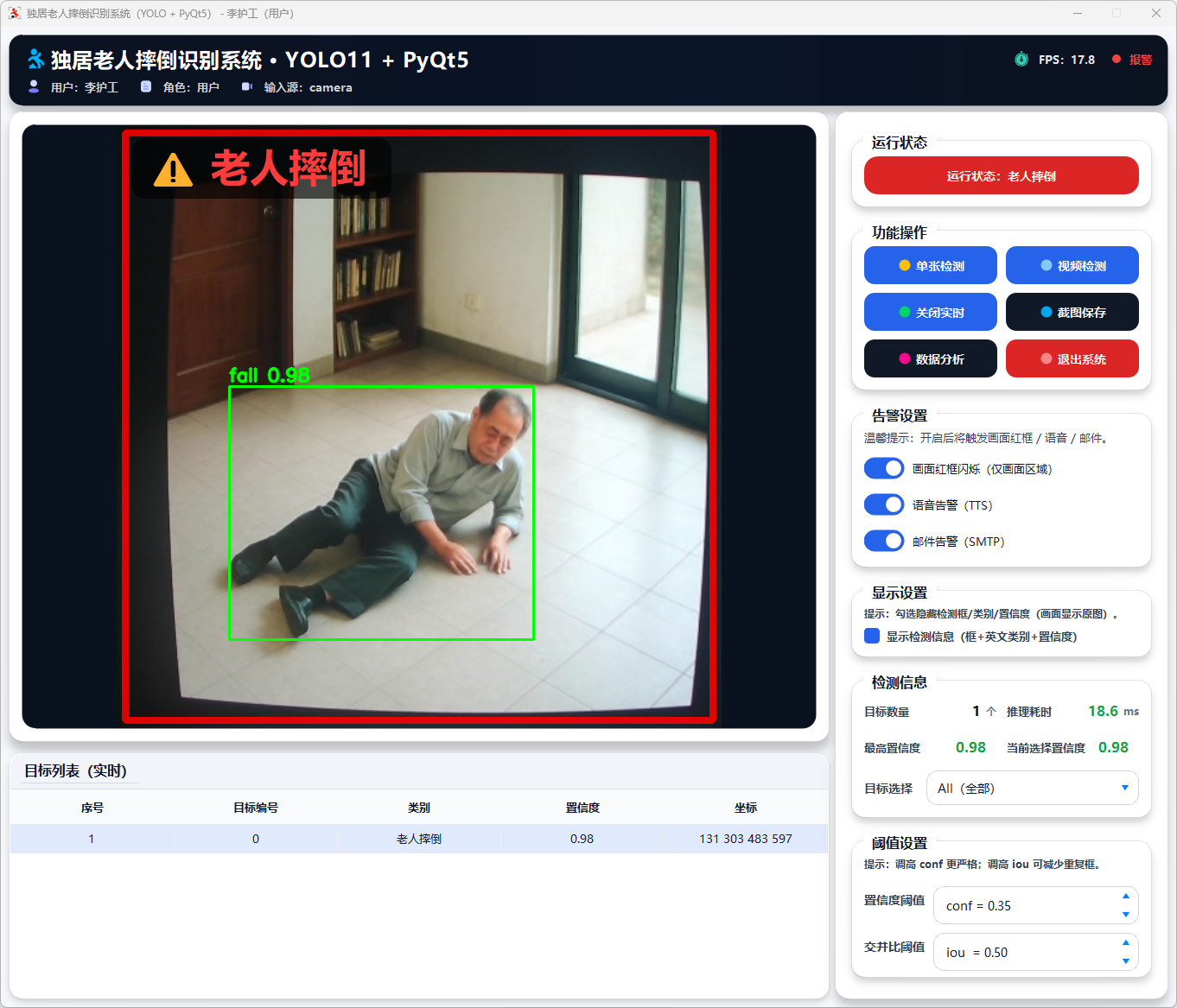

图27 实时检测:老人摔倒(画面红闪、语音告警、邮件通知)

图28 实时检测:老人摔倒(画面红闪、语音告警、邮件通知)

图29 实时检测:老人坐立 正常状态

图30 实时检测:老人坐立 正常状态

图31 邮件报警:手机收到邮件和邮件内容

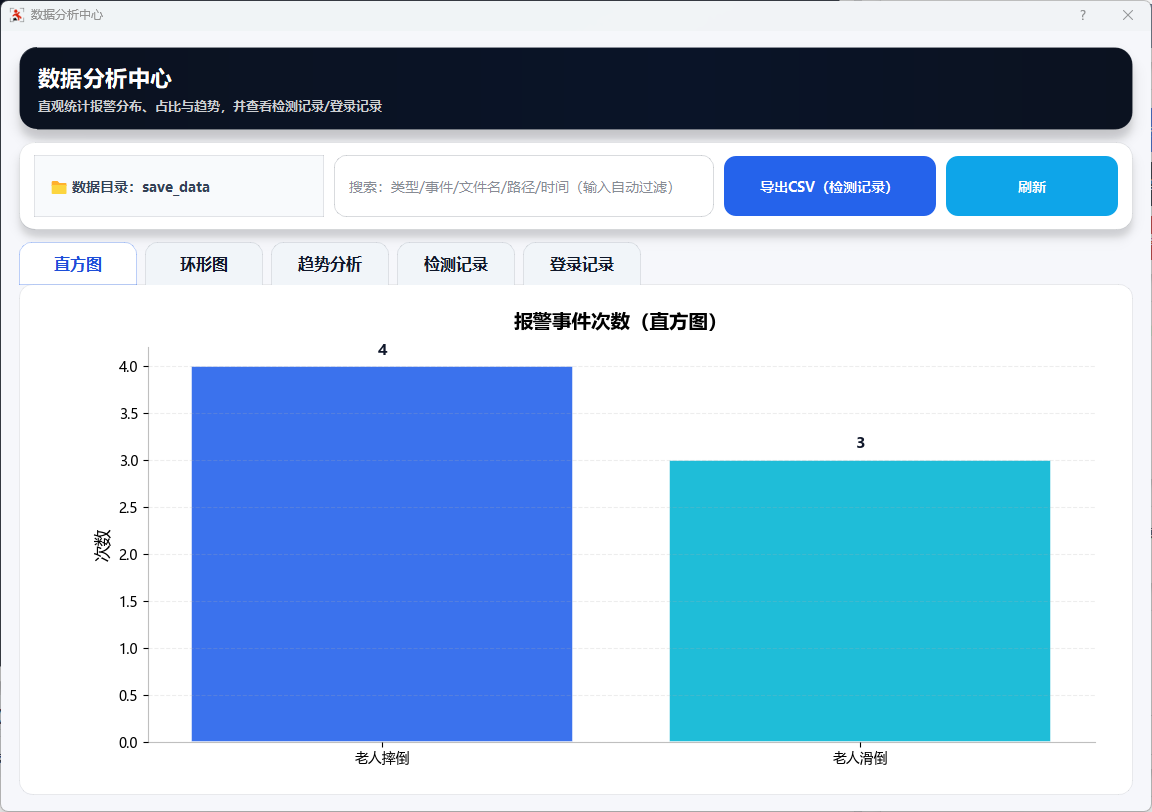

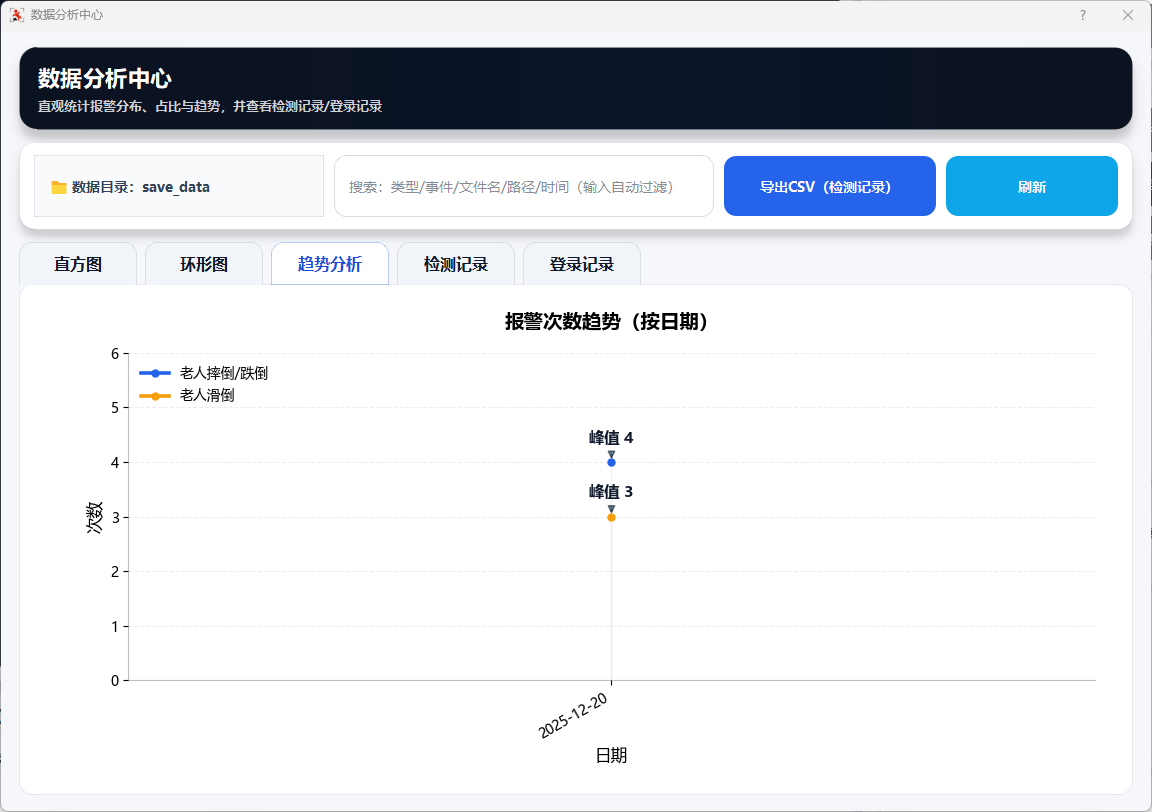

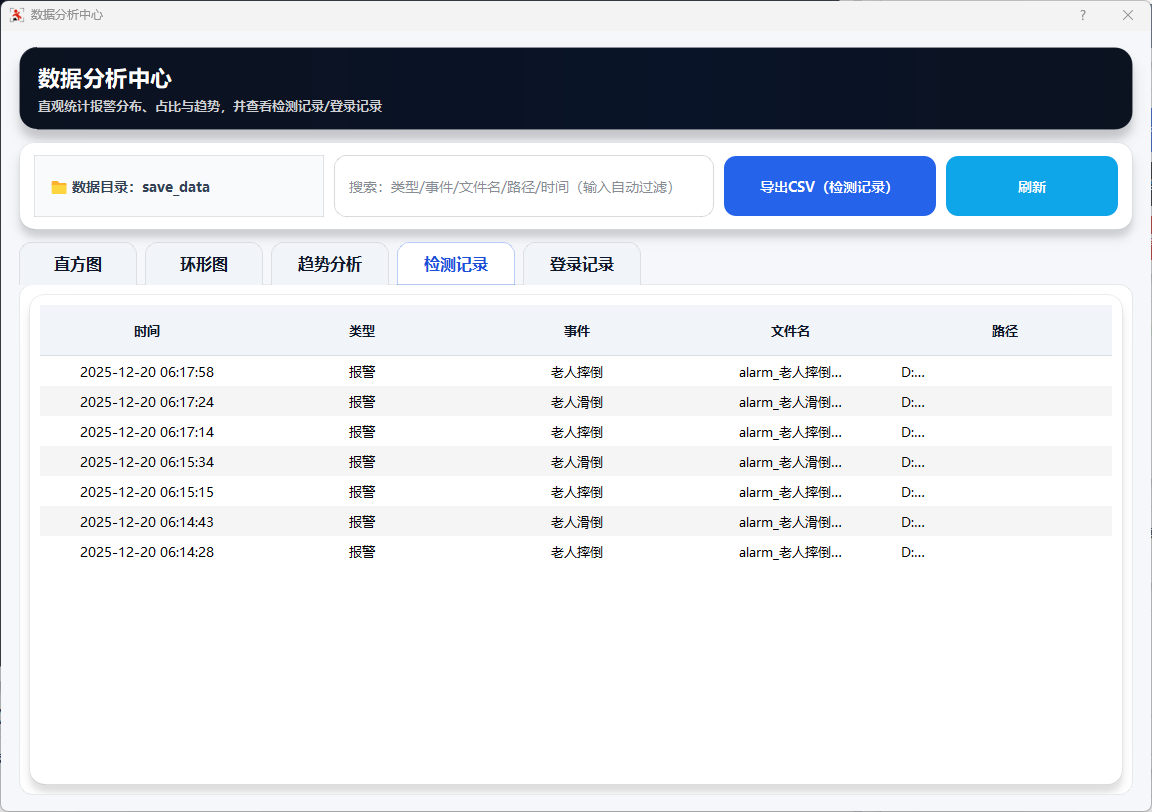

数据分析

图32 直方图分析

图33 环形图分析

图34 趋势分析

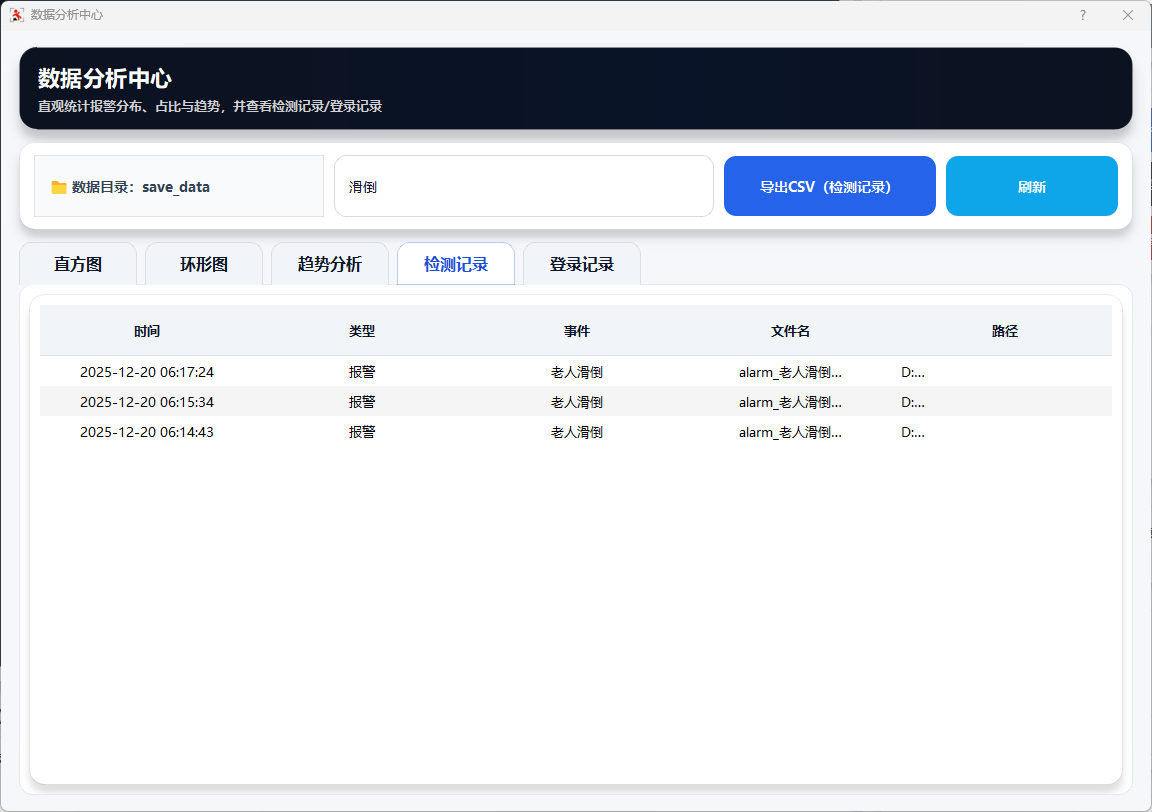

图35 检测记录

图36 检测记录内容搜索

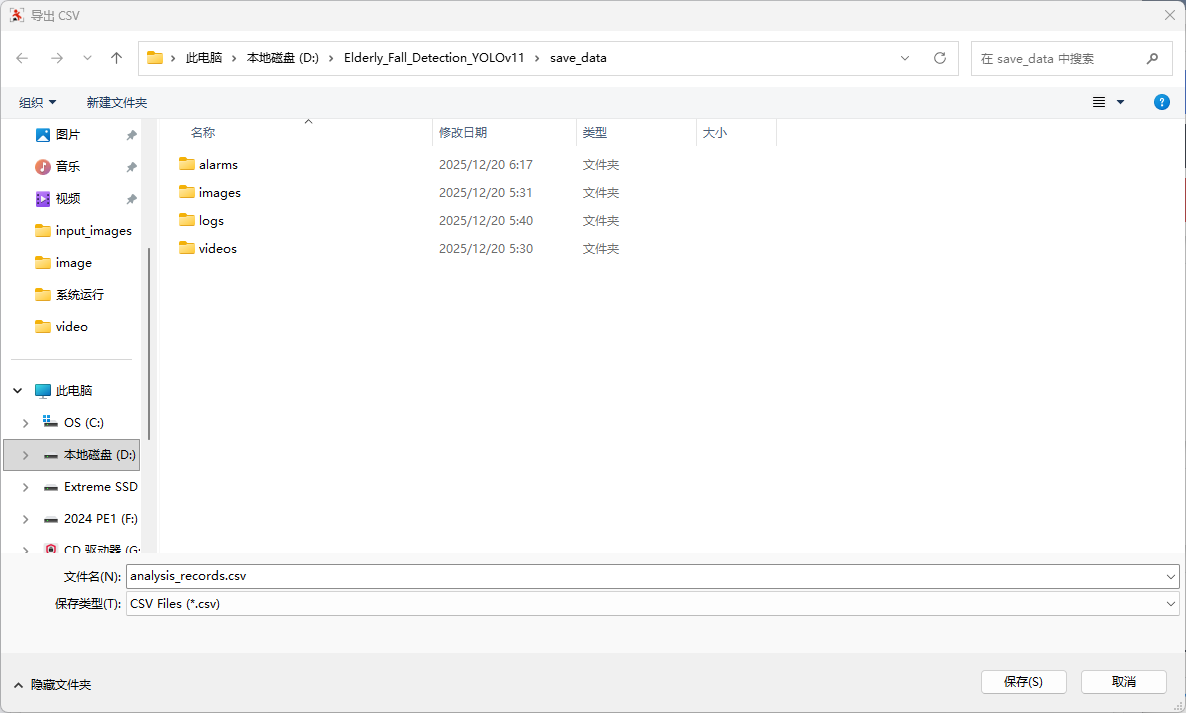

图37 检测记录 导出CSV

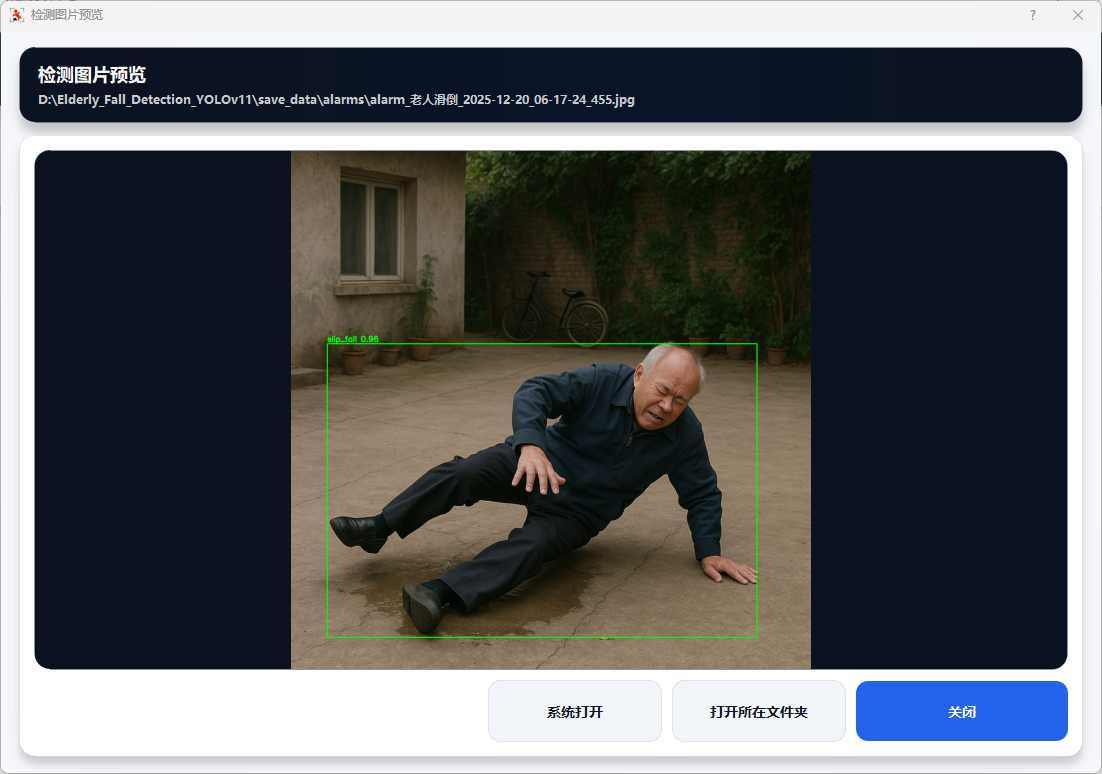

图38 检测记录图片查看

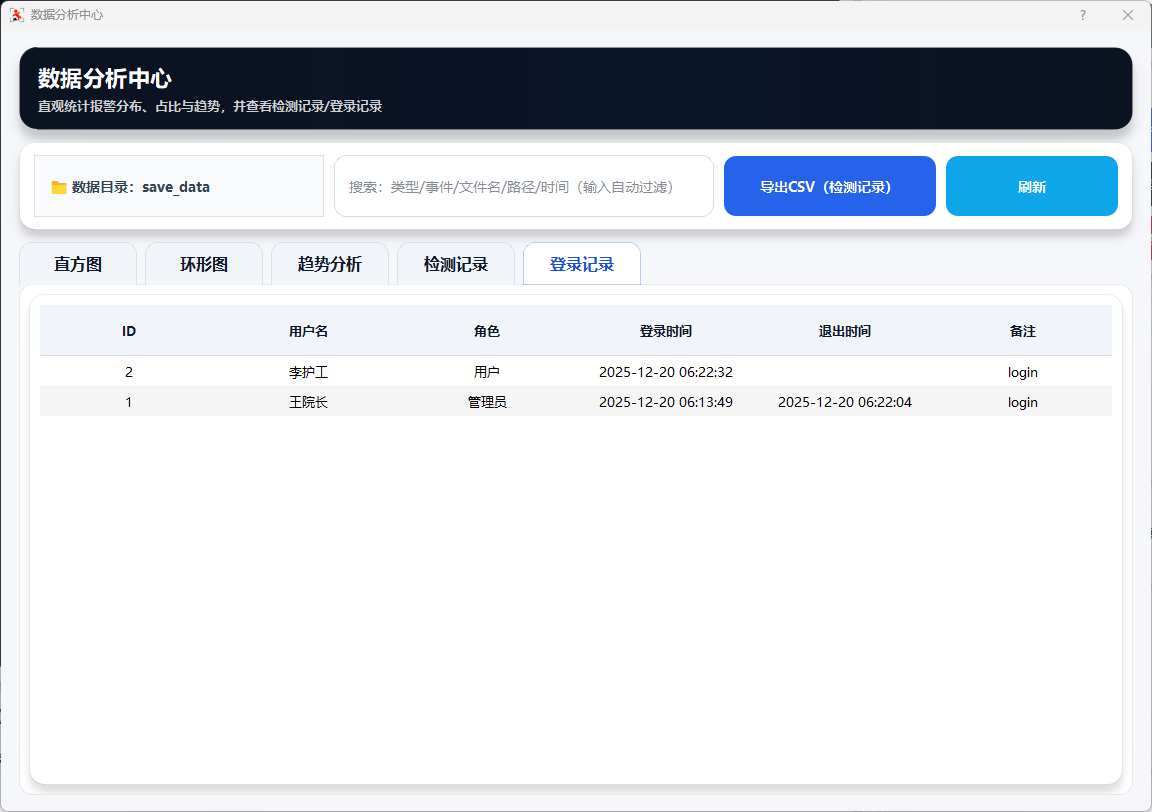

图39 管理员和用户登录记录

1038

1038

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?