您需要先看下pix2pix、pix2pixHD的大概原理!着重看下其判别器,另外您需要懂一些变分自编码器的简单原理和关键知识,如关于其重参数部分和KL散度。

您需要先看下pix2pix、pix2pixHD的大概原理!着重看下其判别器,另外您需要懂一些变分自编码器的简单原理和关键知识,如关于其重参数部分和KL散度。

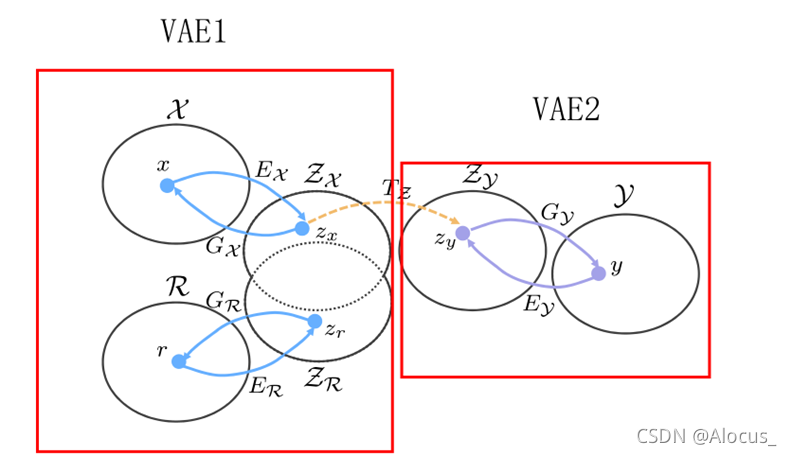

模型主要可以看作三个部分,如图。VAE1和VAE2是两部分,第三部分是中间的黄色箭头Tz部分。VAE1是用来将低质照片映射到隐空间,VAE2是将清晰图像映射到隐空间;中间的黄色箭头Tz部分是两个VAE生成的隐空间连接的桥梁。可以看到VAE1中含有两大块,其实在代码中仅仅是输入的数据不同而已。

EX、ER、EY是三个编码器,用来将图像映射到隐空间。GX、GR、GY是三个生成器,用来将隐空间的向量还原为图片。

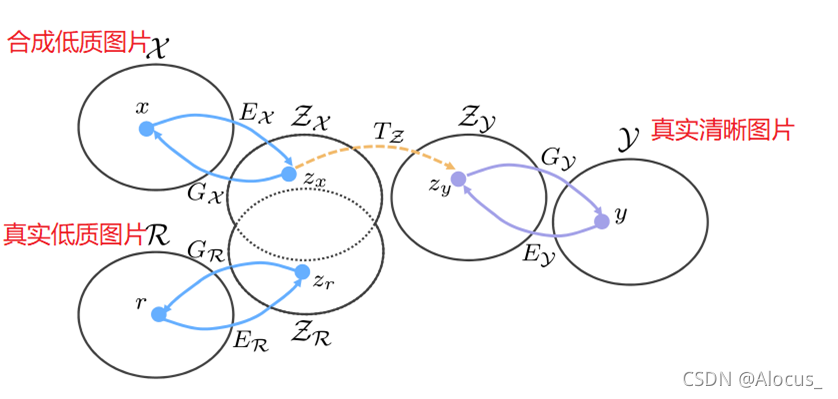

下图为数据部分的注释。

关于测试,按照readme的部分,需要下载权重文件,包括

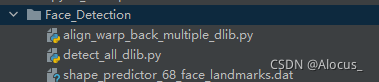

1、人脸关键点权重,放到如下位置

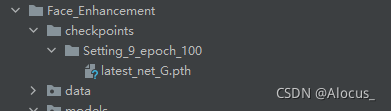

2、人脸增强权重,如下位置。

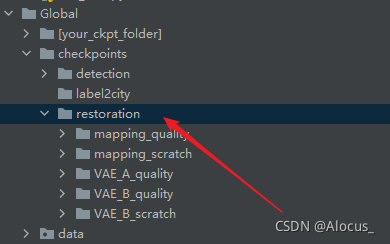

3、论文的模型文件,放到如下位置

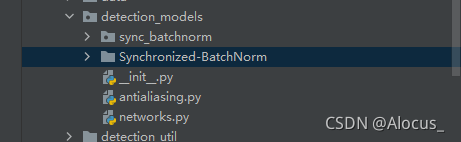

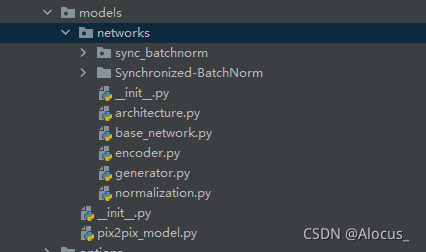

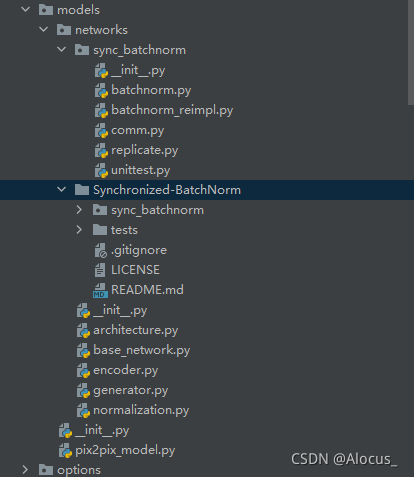

4、还可能需要下载下面文件,sync_batchnorm,并放到如下两个位置。

我这里的sync_batchnorm与该文件夹下内容一样,记不得实际是哪个发挥作用,您可以尝试一下。

然后就是放进自己的图片运行了,也可以使用它的图片。我这个版本较老,不含有官方新加的UI界面和高分辨率处理的内容。

运行代码我提取出来了,如下所示。注意调整自己的输入图片的目录和存放结果的目录。

python run.py --input_folder ./test_images/ha --output_folder ./test_images/ha/output/ --GPU 0

本文介绍了pix2pix和pix2pixHD模型的原理,特别是其判别器和变分自编码器(VAE)的应用。模型由VAE1和VAE2组成,分别处理低质和清晰图像的隐空间映射,通过中间转换层Tz进行连接。在测试阶段,需要下载相关权重文件并配置路径。代码运行涉及GPU设置和输入输出目录的调整。

本文介绍了pix2pix和pix2pixHD模型的原理,特别是其判别器和变分自编码器(VAE)的应用。模型由VAE1和VAE2组成,分别处理低质和清晰图像的隐空间映射,通过中间转换层Tz进行连接。在测试阶段,需要下载相关权重文件并配置路径。代码运行涉及GPU设置和输入输出目录的调整。

2032

2032