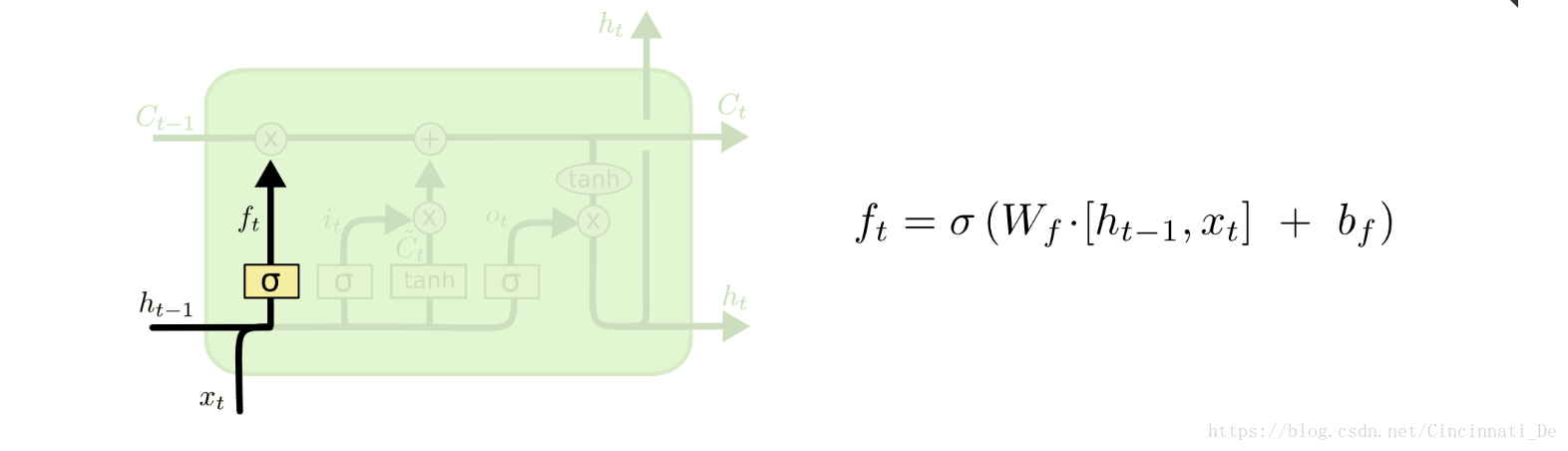

1、LSTM的第一步是决定我们要从细胞状态中扔掉什么信息。这个决定是由一个称为“忘记门层”的sigmoid 层组成。

选择保持记忆传递,还是忘记。

例如:

记忆:语言模型,试图根据前面所有的单词来预测下一个单词。

忘记:拥有当前的主题类别,我们想换新的主题类别,就要忘记当前的主题类别。

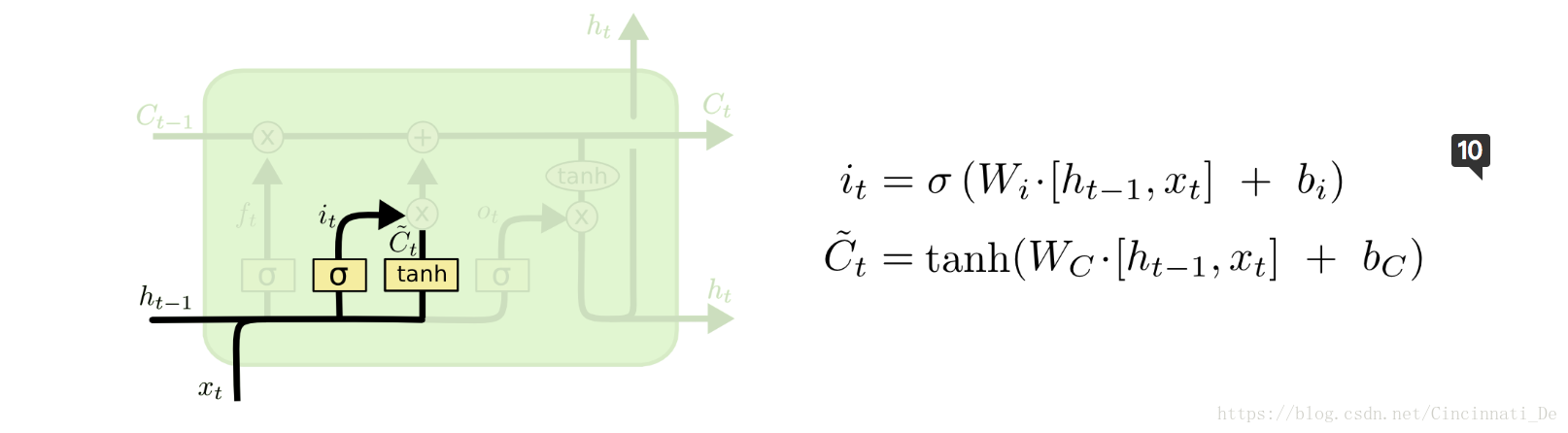

2、第二步是决定什么样新的信息我们将保存在细胞状态中。这里面包含两部分。

a.首先一个sigmoid 层,叫做输入门层决定什么的值我们将会更新。

b. 接着tanh层会创建一个候选向量 C,它可以被添加到状态当中。

在我们的语言模型的例子中,我们希望把新主题的性别添加到单元格状态,以替换我们遗忘的旧的。

C̃

本文介绍了LSTM(长短期记忆网络)中的记忆与遗忘机制。通过“忘记门层”来决定丢弃哪些信息,而“输入门层”则决定更新哪些信息。此外,还介绍了一个tanh层用于创建一个候选向量C,可以用来更新细胞状态。

本文介绍了LSTM(长短期记忆网络)中的记忆与遗忘机制。通过“忘记门层”来决定丢弃哪些信息,而“输入门层”则决定更新哪些信息。此外,还介绍了一个tanh层用于创建一个候选向量C,可以用来更新细胞状态。

2612

2612

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?