点击下方卡片,关注“自动驾驶之心”公众号

>>直播和内容获取转到 → 自动驾驶之心知识星球

点击按钮预约直播

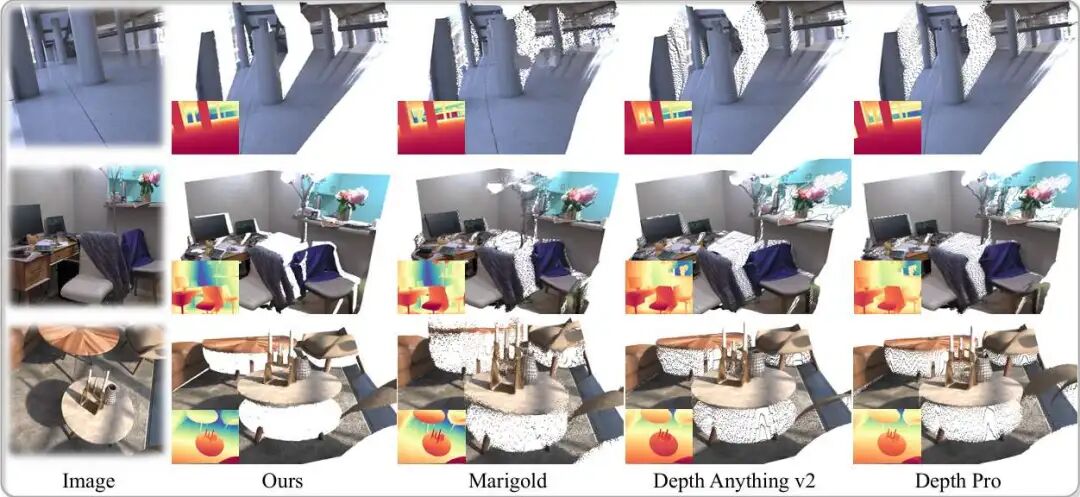

深度估计是机器人感知、三维重建、AR/VR 等应用的核心。然而,现有的深度估计方法普遍存在边缘飞点(Flying Pixels)问题,而这会导致机器人执行决策时候,引发错误动作;三维重建时导致物体轮廓鬼影重重等。现有方法经历边缘飞点主要因为以下原因:

判别式模型(如 Depth Anything v2, Depth Pro)由于回归损失的平滑倾向,容易在深度突变处产生平均化预测,导致边缘飞点;

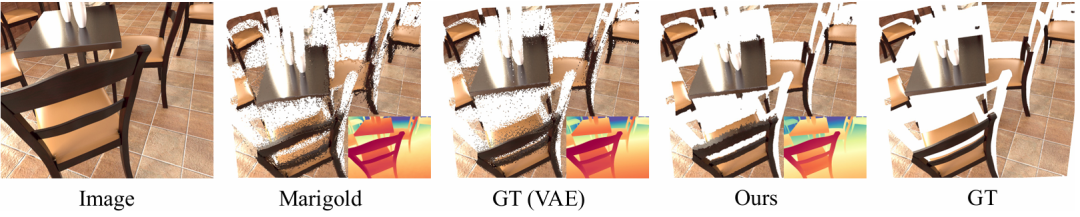

生成式模型(如 Marigold, Lotus)虽然能通过像素分布建模保留更多细节,但依赖 Stable Diffusion 的 VAE 压缩,仍会损失结构锐度与几何保真度,产生大量飞点。

本文提出 Pixel-Perfect Depth (PPD),一种直接在像素空间进行扩散生成的单目深度估计模型,从根源上避免了因 VAE 压缩导致的伪影问题。然而,高分辨率像素空间的扩散建模极具挑战:模型需兼顾全局语义的一致性与局部细节的精确性,否则极易出现结构失真或深度跳变。为此,本文设计了语义引导的扩散 Transformer(SP-DiT),在扩散过程中引入来自视觉基础模型的高层语义特征作为提示,有效增强了模型对全局结构的把握与细节恢复能力。同时,本文提出一种语义特征正则化方法,促使外部语义信息与 DiT 内部表示更好对齐,从而确保训练稳定、收敛可靠。我们很荣幸邀请到一作许刚伟博士,为大家分享这篇最新的工作!今晚七点半继续锁定自动驾驶之心直播间~

论文标题:Pixel-Perfect Depth with Semantics-Prompted Diffusion Transformers

论文链接:https://arxiv.org/abs/2510.07316

Project Page:https://pixel-perfect-depth.github.io/

Code: https://github.com/gangweix/pixel-perfect-depth

Huggingface Demo: https://huggingface.co/spaces/gangweix/Pixel-Perfect-Depth

分享介绍

更多精彩回顾

🚀 直播精华看不够?完整版深度内容已独家上线知识星球「自动驾驶之心」!涵盖所有技术细节、QA及未公开彩蛋。深度解析!

DriveBench:VLM在自动驾驶中真的可靠吗?(ICCV'25)

AI Day直播 | LangCoop:自动驾驶首次以“人类语言”的范式思考

干货满满,快来加入

END

像素级完美深度估计新突破

像素级完美深度估计新突破

515

515

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?