点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

今天自动驾驶之心为大家分享毫末智行最新的工作—OAD!该方法显著提高了规划精度和安全性,在nuScenes上将L2 error降低了近40%。如果您有相关工作需要分享,请在文末联系我们!

自动驾驶课程学习与技术交流群事宜,也欢迎添加小助理微信AIDriver004做进一步咨询

论文作者 | Zhennan Wang等

编辑 | 自动驾驶之心

写在前面 & 方法概览

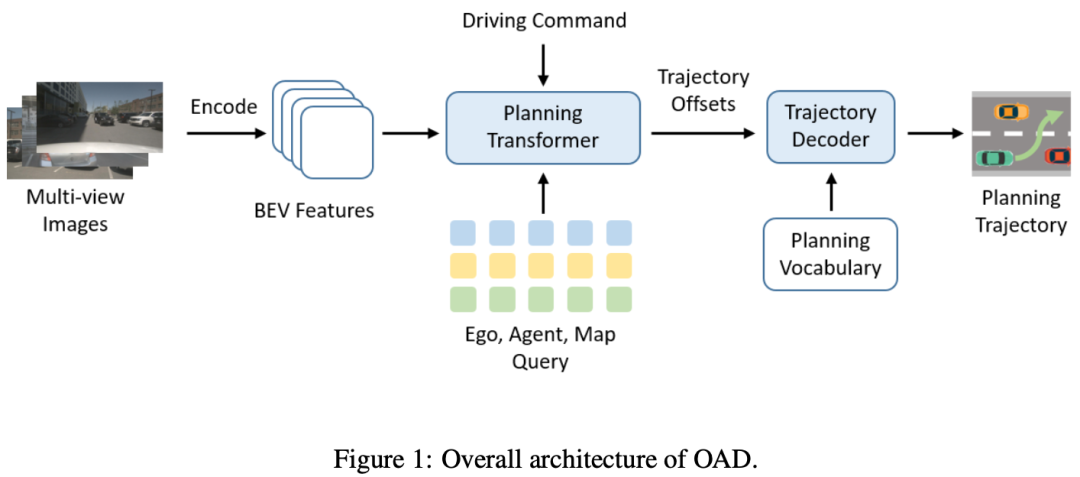

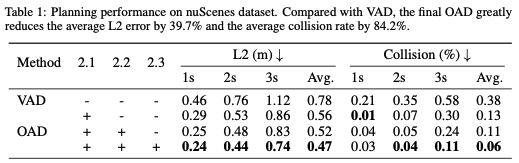

端到端自动驾驶技术在近年来取得了显著进展。在本研究中,我们提出了轨迹偏移学习,将传统的直接预测自车轨迹,转换为预测相对于轨迹锚点的偏移,降低模型学习的难度。与baseline模型相比,该方法显著提高了规划精度和安全性,在nuScenes上将L2 error降低了39.7%(从0.78m降至0.47m),并将碰撞率降低了84.2%(从0.38%降至0.06%)。此外,OAD展示了生成多样化、多模轨迹的能力,增强了其对复杂驾驶场景的适应性。

技术报告和可视化内容,参考项目主页:https://wzn-cv.github.io/OAD

简介

本报告在VAD框架的基础上构建了更强大的基线模型。具体而言,我们通过实证验证了几种明确且有效的技术,包括与鸟瞰视角(BEV)的交互、指令插入位置。此外,我们设计了一种创新的方法,利用轨迹词汇表来学习偏移量,而非直接学习轨迹。

OAD算法核心

与BEV的交互

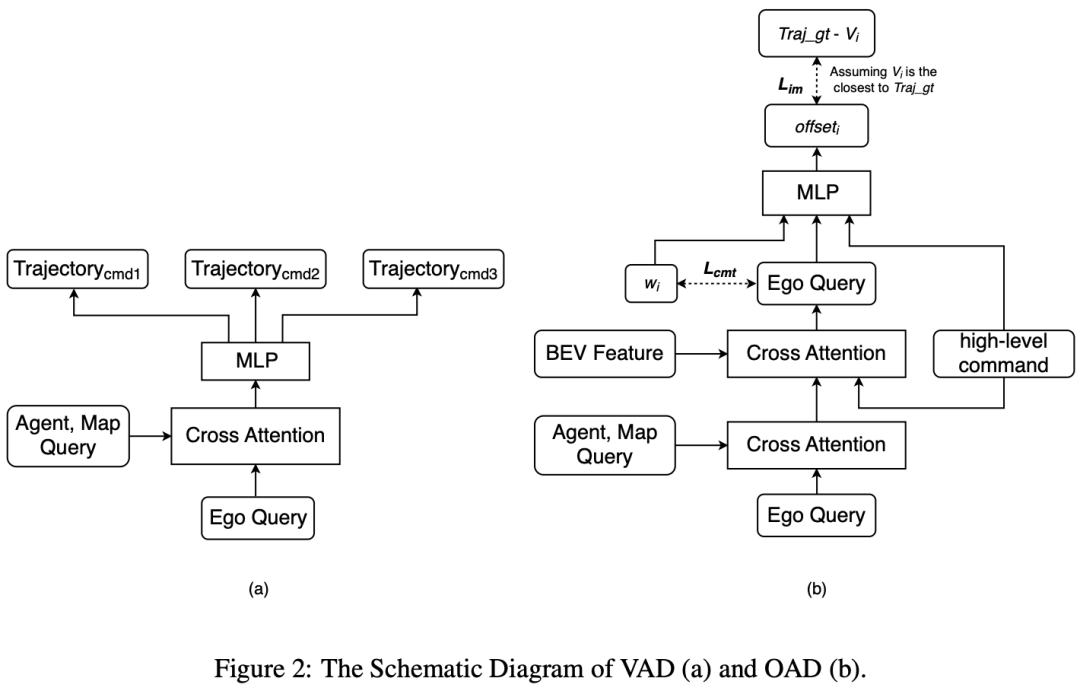

在规划模块中,VAD仅设计了自车查询(ego query)与Agent查询(agent queries)和地图查询(map queries)之间的交互,其中并未涉及BEV特征,如图2(a)所示。这导致自车查询只能感知结构化的障碍物和地图信息,而无法捕捉周围环境的丰富特征和全面信息。受UniAD的启发,我们将自车查询与BEV特征进行关联,从而使系统能够更好地理解和感知其周围环境。

此外,对于每个高级指令(high-level command),VAD使用一个对应的多层感知机(MLP)头来输出轨迹。我们认为这种设计可能导致参数冗余。因此,我们引入了高级指令嵌入作为条件输入,使所有高级指令共享一个单一的MLP头进行轨迹解码。

高级指令插入位置

在UniAD中,高级指令仅在自车查询与密集BEV特征进行交叉注意力(cross-attention)之前被引入。我们认为,高级指令不仅应在与BEV的交叉注意力之前引入,还应在轨迹解码MLP之前引入。前者使自车能够更加关注与高级指令相对应的区域,从而降低碰撞率;后者则使轨迹解码器能够显式捕捉未来方向,从而减少位移误差。因此,我们在两个位置都引入了高级指令嵌入,如图2(b)所示。

学习轨迹偏移量

我们认可VADv2和Hydra-MDP中采用的理念,即构建一个固定的规划词汇表以降低规划的复杂性。略微不同的是,我们采用了在线K-means进行词汇表学习,这使得实现更为简单。

更重要的是,我们认为基于该规划词汇表学习偏移量,而非直接学习轨迹,可以带来更高的有效性。这种方法受到目标检测领域工作的启发,其中学习相对于锚框(anchor boxes)的偏移量。

具体设计如图2(b)所示。自车查询结合轨迹锚点嵌入和高级指令,在关联Agent查询、地图查询和BEV特征后学习偏移量,可表述如下:

其中, 表示自车查询, 是一个可学习参数,表示规划词汇表中第 条轨迹的锚点嵌入。

在训练过程中,从词汇表中选择具有最低偏移量的轨迹来计算损失:

其中, 表示最终位移误差。总训练目标为:

其中,表示真实自车轨迹, 表示规划词汇表中的第条轨迹,并作为轨迹锚点,表示模仿损失,表示用于学习的承诺损失:

其中, 表示停止梯度操作符。

在推理过程中,选择最接近 的 来解码规划轨迹:

在此,我们使用的超参数为:词汇表大小=30,,。

实验结果分析

相关配置

本文采用的基线模型是VAD-Tiny,其具有100×100的鸟瞰图(BEV)查询。为清晰简洁起见,在本论文中VAD-Tiny统一简称为VAD。与VAD一致,我们的研究也使用了nuScenes数据集。在评估方面,位移误差(DE)和碰撞率(CR)被用于全面评估规划性能。需要注意的是,在所有实验中,我们有意不将自车状态作为输入数据,以避免开环规划中的捷径学习。在训练过程中,我们使用8块NVIDIA A100 GPU,并遵循VAD的优化调度器。我们进行了超参调整,总批次大小为32、初始学习率为4×10⁻⁴时可实现最佳性能。

定量结果

上述方法的定量结果汇总于表1。显然,每项设计都带来了显著的性能提升。

定性结果

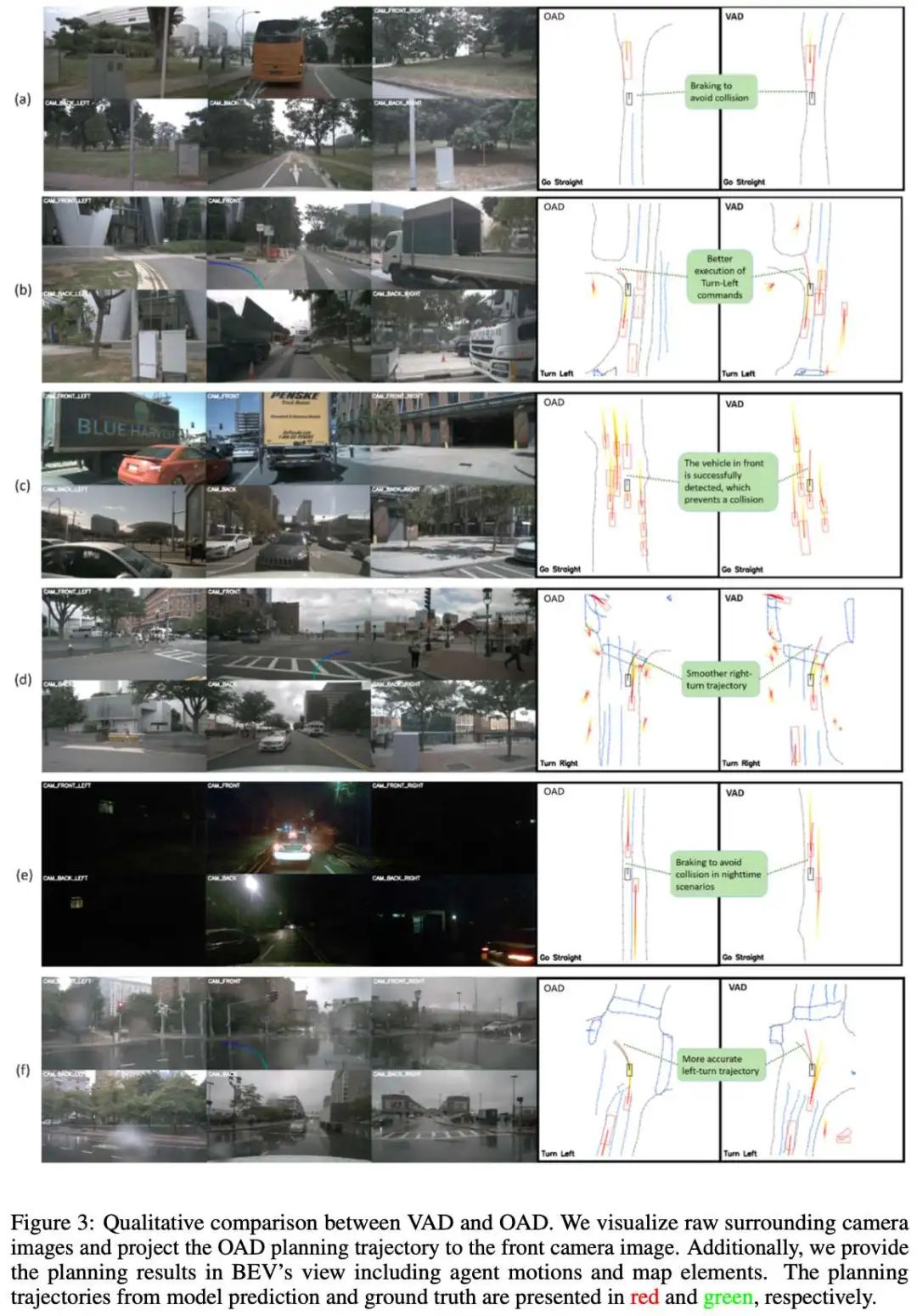

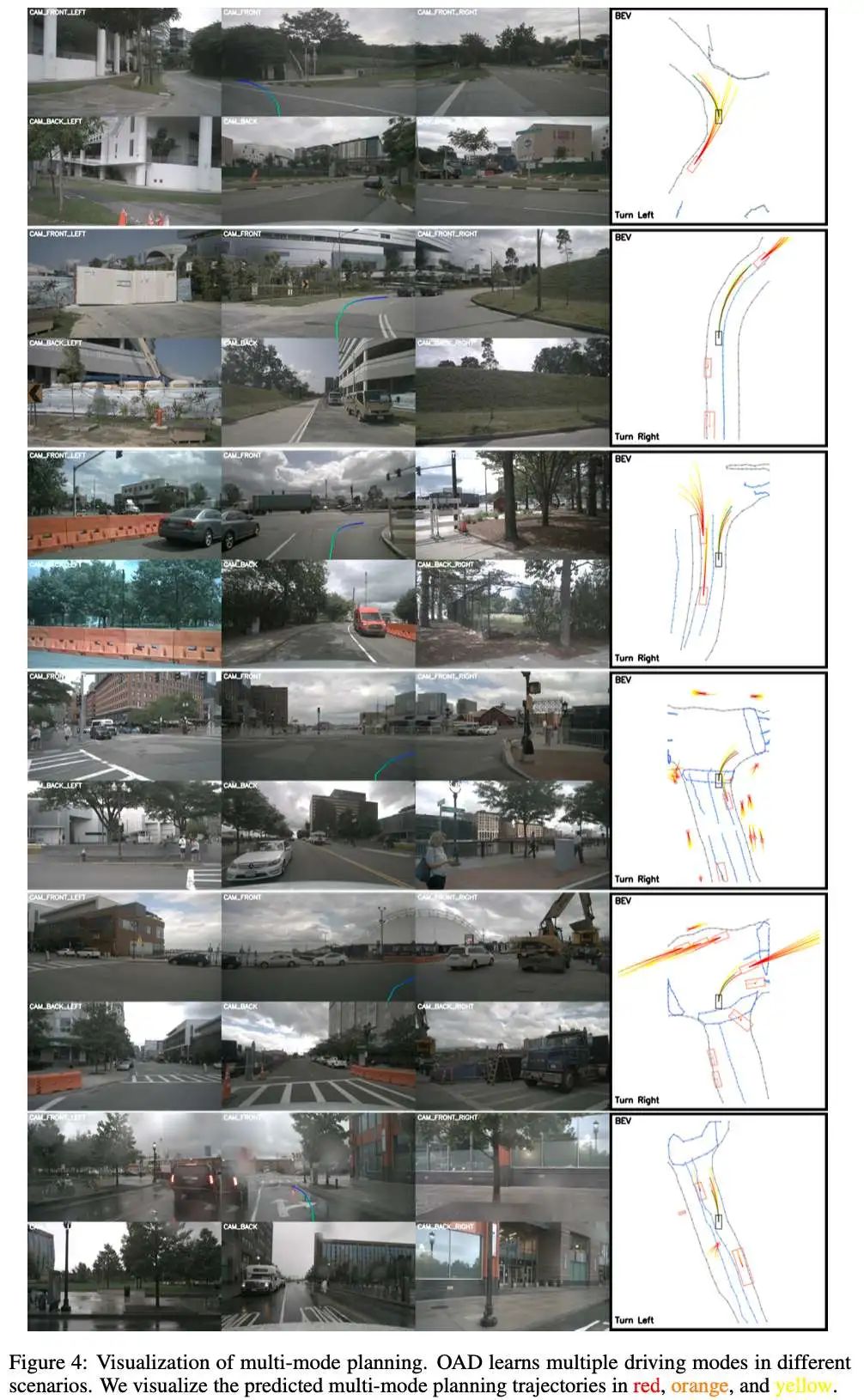

我们对OAD和VAD进行定性比较,以说明改进措施的有效性,如图3所示。可视化结果表明,OAD能够在复杂场景中实现更好的轨迹规划。在图(a)和(e)中,即使在夜间条件下,OAD在接近前车时也能通过制动展现出避撞能力。在图(c)中,OAD成功识别出前方车辆(VAD未能识别),从而避免了直线行驶,有效降低了碰撞风险。在路口转弯场景中,与VAD相比,OAD生成的轨迹更平滑、更合理,在图(b)、(d)和(f)中降低了驾驶风险。利用轨迹词汇表,OAD天然具备多模态规划能力,如图4所示。这为下游任务提供了更大的潜力。

结论

在本研究中,我们提出了对VAD框架的多项改进,特别聚焦于学习相对于规划词汇表的偏移量。定量结果和定性结果均表明了这些改进的有效性。我们将持续提出新的优化措施,以实现更卓越的端到端规划性能。闭环评估也将成为我们未来工作的一部分。

① 自动驾驶论文辅导来啦

② 国内首个自动驾驶学习社区

『自动驾驶之心知识星球』近4000人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(端到端自动驾驶、世界模型、仿真闭环、2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型,更有行业动态和岗位发布!欢迎扫描加入

③全网独家视频课程

端到端自动驾驶、仿真测试、自动驾驶C++、BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、CUDA与TensorRT模型部署、大模型与自动驾驶、NeRF、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

④【自动驾驶之心】全平台矩阵

1685

1685

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?