点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

今天自动驾驶之心为大家分享浙大&华为最新的工作Drive-OccWorld!基于Occ世界模型的端到端自动驾驶,直接干到未来!如果您有相关工作需要分享,请在文末联系我们!

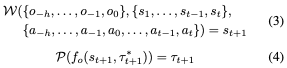

自动驾驶课程学习与技术交流群事宜,也欢迎添加小助理微信AIDriver004做进一步咨询

编辑 | 自动驾驶之心

写在前面 & 笔者的个人理解

世界模型基于各种自车行为预测潜在的未来状态。它们嵌入了关于驾驶环境的广泛知识,促进了安全和可扩展的自动驾驶。大多数现有方法主要关注数据生成或世界模型的预训练范式。与上述先前的工作不同,我们提出了Drive-OccWorld,它将以视觉为中心的4D预测世界模型应用于自动驾驶的端到端规划。具体来说,我们首先在内存模块中引入语义和运动条件规范化,该模块从历史BEV嵌入中积累语义和动态信息。然后将这些BEV特征传输到世界解码器,以进行未来时刻的OCC和flow预测,同时考虑几何和时空建模。此外我们在世界模型中注入灵活的动作条件,如速度、转向角、轨迹和命令,以实现可控发电,并促进更广泛的下游应用。此外,我们探索将4D世界模型的生成能力与端到端规划相结合,从而能够使用基于职业的成本函数对未来状态进行连续预测并选择最佳轨迹。对nuScenes数据集的广泛实验表明,Drive-OccWorld可以生成合理可控的4D占用,为推动世界生成和端到端规划开辟了新途径。

总结来说,本文的主要贡献如下:

提出了Drive OccWorld,这是一个以视觉为中心的世界模型,旨在预测4D Occ和flow,我们探索了世界模型的未来预测能力与端到端规划的整合。

设计了一个简单而高效的语义和运动条件归一化模块,用于语义增强和运动补偿,提高了预测和规划性能。

提供了一个统一的调节接口,将灵活的动作条件集成到后代中,增强了Drive OccWorld的可控性,并促进了更广泛的下游应用。

相关工作回顾

World Models for Autonomous Driving

基于未来状态的生成模式,现有的自动驾驶世界模型主要可分为基于2D图像的模型和基于3D体积的模型。2D Image-based Models:旨在使用参考图像和其他条件(例如动作、HDMaps、3D框和文本提示)预测未来的驾驶视频。GAIA-1使用自回归Transformer作为世界模型,根据过去的图像、文本和动作标记预测未来的图像标记。其他方法,如DriveDreamer、ADriver-I、DrivengDiffusion,GenAD、Vista、Delphi和Drive-WM,使用潜在扩散模型(LDMs)生成图像到输出视频。这些方法侧重于设计模块,将动作、BEV布局和其他先验元素纳入去噪过程,从而产生更连贯、更合理的未来视频代。

3D Volume-based Models:以点云或占领的形式预测未来的状态。Copilot4D使用VQVAE对LiDAR观测进行标记,并通过离散扩散预测未来的点云。ViDAR实现了视觉点云预测任务,以预训练视觉编码器。UnO根据激光雷达数据预测了一个具有自我监督功能的持续占领区。OccWorld和OccSora使用场景标记器压缩职业输入,并使用生成变换器预测未来的职业。UniWorld和DriveWorld提出通过4D职业重建进行4D预训练。

在这项工作中通过输入动作条件来实现动作可控生成,并将这种生成能力与端到端的安全驾驶规划者相结合,从而研究了世界模型的潜在应用。

Drive-OccWorld方法详解

准备工作

端到端的自动驾驶模型旨在直接基于传感器输入和自我行为来控制车辆(即规划轨迹)。从形式上讲,给定历史传感器观测值和h个时间戳上的自我轨迹,端到端模型A预测了未来f个时间戳的理想自车轨迹:

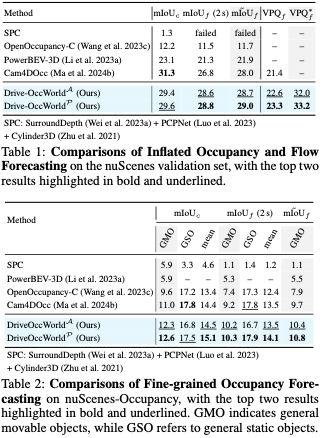

驾驶世界模型W可以被视为一种生成模型,它将先前的观察和自车行为作为输入,生成环境的合理未来状态:

鉴于世界模型预测未来状态的能力,我们建议将其与规划器集成,以充分利用世界模型在端到端规划中的能力。具体来说引入了一个名为Drive-OccWorld的自回归框架,该框架由一个用于预测未来职业和流动状态的生成世界模型W和一个基于职业的规划器P组成,该规划器P使用成本函数来基于评估未来预测来选择最佳轨迹。从形式上讲,我们将Drive OccWorld公式化如下,它自动回归预测下一个时间戳的未来状态和轨迹:

值得注意的是,对于动作可控的生成,可以以速度等形式将a注入W中作为条件,并丢弃P以防止潜在的自车状态泄漏。在端到端规划中,预测轨迹用作处的动作条件,用于预测下一个状态,从而不断推出预测和规划。

在接下来的部分中,我们将详细介绍世界模型的结构,为W配备动作可控生成,并将其与P集成以进行端到端规划。

4D Forecasting with World Model

如图2所示,Drive-OccWorld包括三个组件:(1)历史编码器WE,它将历史相机图像作为输入,提取多视图几何特征,并将其转换为BEV嵌入。根据之前的工作,我们使用视觉BEV编码器作为我们的历史编码器。(2)具有语义和运动条件归一化的记忆队列WM,它在潜在空间中采用简单而高效的归一化操作来聚合语义信息并补偿动态运动,从而积累更具代表性的BEV特征。(3)世界解码器WD,其通过具有历史特征的时间建模来提取世界知识,以预测未来的语义职业和流动。灵活的动作条件可以注入WD,以实现可控生成。集成了基于occ的规划器P,用于连续预测和规划。

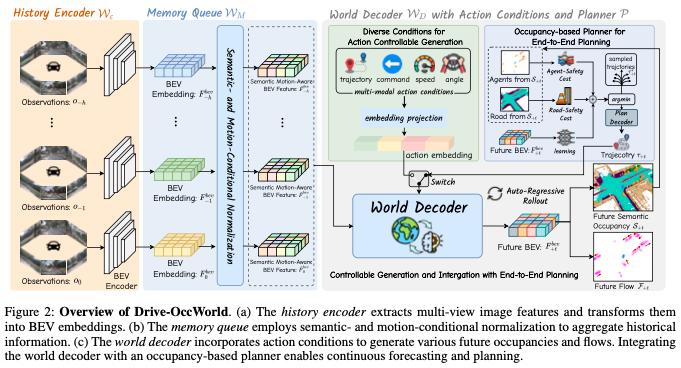

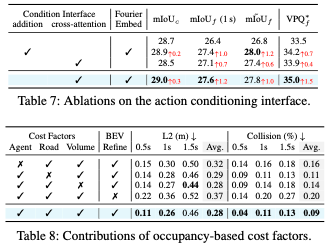

Semantic- and Motion-Conditional Normalization旨在通过结合语义和动态信息来增强历史BEV嵌入。

如图3所示,我们实现了一个轻量级的预测头来生成体素语义概率:

在运动条件归一化中,我们补偿自车和其他代理在不同时间戳上的运动。具体来说,自车姿态变换矩阵(考虑了自我载体从时间戳-t到+t的移动)被展平并编码到MLP处理的嵌入中,以生成仿射变换参数。

Future Forecasting with World Decoder:WD是一种自回归变换器,它根据存储在WM中的历史BEV特征和预期动作条件预测未来帧+t的BEV嵌入。

具体来说,WD将可学习的BEV查询作为输入,并执行可变形的自注意、与历史嵌入的时间交叉注意、与动作条件的条件交叉注意力以及前馈网络来生成未来的BEV嵌入。条件层在BEV查询和动作嵌入之间执行交叉注意力,这将在下一节中说明,将动作可控信息注入预测过程。在获得下一个BEV嵌入后,预测头利用通道到高度操作来预测语义占用和3D backward centripetal flow。

Action-Controllable Generation

由于现实世界的固有复杂性,自我载体的运动状态对于世界模型理解主体如何与其环境交互至关重要。因此,为了全面涵盖环境,我们建议利用各种行动条件,使Drive OccWorld具有可控生成的能力。

Diverse Action Conditions:包括多种格式:(1)速度在给定的时间步长定义为(vx,vy),表示自车辆沿x和y轴分解的速度,单位为m/s。(2)转向角从转向反馈传感器收集。根据VAD,我们将其转换为中的曲线。(3)轨迹表示自车位置到下一个时间戳的移动,公式为(),单位为米。它被广泛用作端到端方法的输出,包括我们的规划器P。(4)命令由前进、左转和右转组成,代表了控制车辆的最高级别意图。

Unified Conditioning Interface旨在将异质动作条件整合到连贯的嵌入中。我们首先将所需的动作编码到傅里叶嵌入中(,通过额外的学习投影将其连接和融合,以与WD中条件交叉注意力层的维度对齐。该方法有效地将灵活的条件集成到可控的生成中。

End-to-End Planning with World Model

现有的世界模型主要关注数据生成或自动驾驶的相关范式。尽管最近的一项开创性工作Drive WM提出将生成的驾驶视频与基于图像的奖励函数相结合来规划轨迹,但环境的几何3D特征并没有完全用于运动规划。如图2所示,鉴于我们的世界模型提供的未来occ预测能力,我们引入了一个基于occ的规划器,对代理和可驾驶区域的占用网格进行采样,以确定安全约束。此外,未来的BEV嵌入用于学习考虑细粒度3D结构的成本量,为安全规划提供更全面的环境信息。

基于占用的成本函数旨在确保自驾车的安全驾驶。它由多个成本因素组成:(1)代理安全成本限制了自车与其他代理(如行人和车辆)的碰撞。它惩罚与其他道路使用者占用的网格重叠的轨迹候选者。此外,在横向或纵向距离方面与其他主体太近的轨迹也受到限制,以避免潜在的碰撞。(2)道路安全成本确保车辆在道路上行驶。它从占用预测中提取道路布局,惩罚超出可驾驶区域的轨迹。(3)学习量成本受ST-P3的启发。它使用基于F bev+t的可学习头部来生成成本量,从而对复杂的世界进行更全面的评估。

BEV Refinement:引入BEV嵌入来进一步细化潜在空间中的轨迹。我们将编码为嵌入,并将其与命令嵌入连接起来,形成自我查询。最终的轨迹是通过MLP基于精炼的自我查询进行预测的。

规划损失Lplan由三个部分组成:引入的max-margin损失,用于约束轨迹候选的安全性;用于模仿学习的l2损失;以及确保规划轨迹避开障碍物占用的网格的碰撞损失。

实验结果

Main Results of 4D Occupancy Forecasting

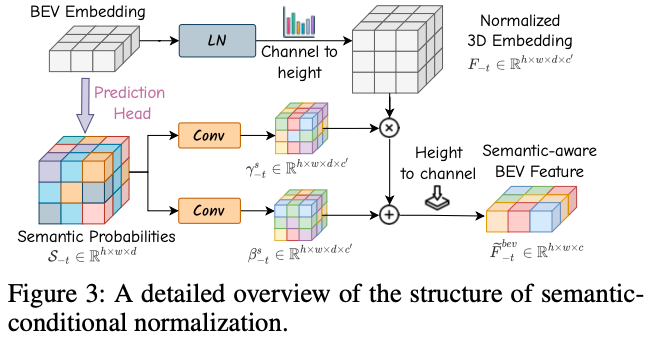

Inflated Occupancy and Flow Forecasting。表1展示了nuScenes数据集上Inflated的占用率和流量预测的比较。尽管Drive OccWorld在当前时刻的结果mIoUc上表现稍差,但它在mIoUf上的表现比Cam4DOcc高出2.0%,表明其预测未来状态的能力更强。

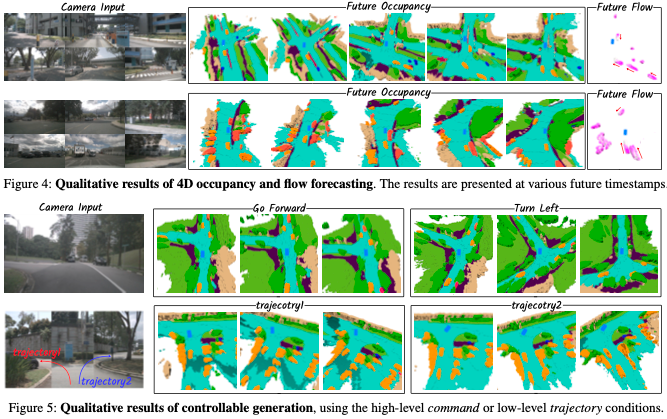

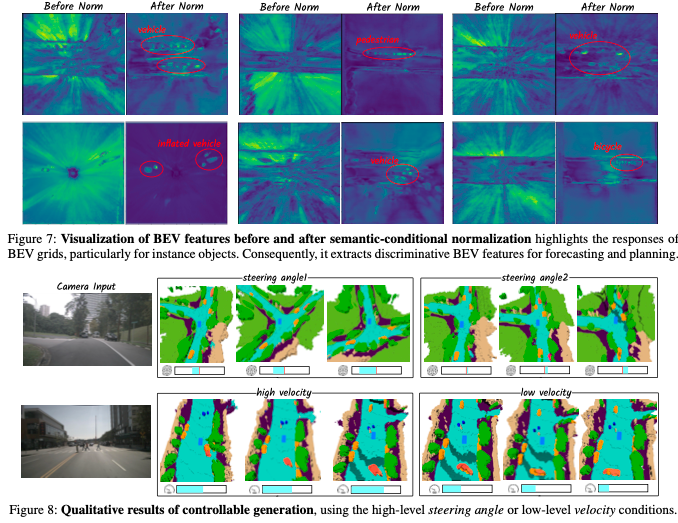

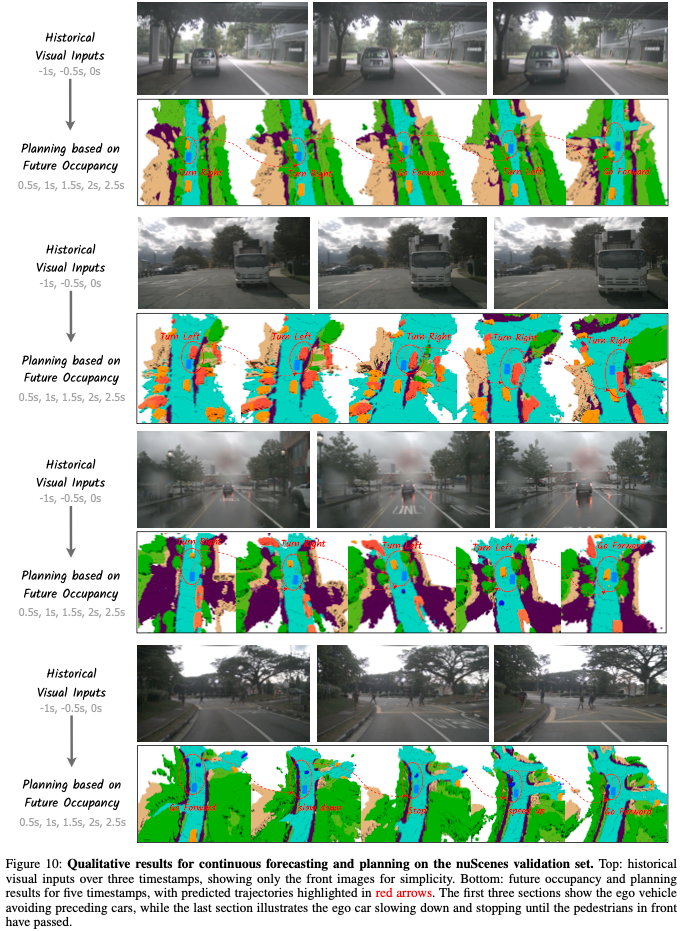

Fine-grained Occupancy Forecasting:表2展示了nuScenes占用率的细粒度占用预测比较。结果表明,与所有其他方法相比,Drive OccWorld实现了最佳性能。值得注意的是,对于当前和未来时间戳的一般可移动对象,Drive OccWorldP在mIoU上分别比Cam4DOcc高出1.6%和1.1%,这表明它能够准确定位可移动对象以进行安全规划。图4提供了跨框架的职业预测和流量预测的定性结果。

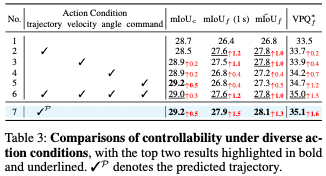

可控性。在表3中,我们考察了各种作用条件下的可控性。与基线变量相比,注入任何动作条件都会产生收益。值得注意的是,低水平条件,即轨迹和速度,为未来的预测提供了更大的改进。相比之下,最高级别的命令条件改善了当前时间戳的mIoUc结果,但对未来的预测提供了有限的增强。可以这么理解,结合更多的低级条件,如轨迹,可以为自车提供更具体的行动,以了解其与世界的相互作用,从而有效地增强未来的预测。

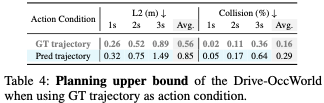

有趣的是,如表4所示,与使用预测轨迹相比,使用地面真实轨迹作为行动条件可以获得更好的规划结果。相反,在入住率和流量预测质量方面观察到相反的趋势。表3中第2行和第7行的比较表明,使用预测轨迹而不是地面真实轨迹可以略微提高预测质量。表1和表2中的结果进一步支持了这一观察结果,其中Drive OccWorldP的表现优于Drive OccWorldA。我们认为,在使用预测轨迹时,对BEV特征施加的轨迹约束可能会导致占用率和流量质量的性能提高。这一发现表明,应用轨迹预测也可以提高感知性能,这与UniAD的结果一致。

此外,在图5中,我们展示了Drive OccWorld基于特定自我运动模拟各种未来职业的能力,展示了Drive OccWorld作为神经仿真为自动驾驶生成合理职业的潜力。

End-to-end Planning with Drive-OccWorld

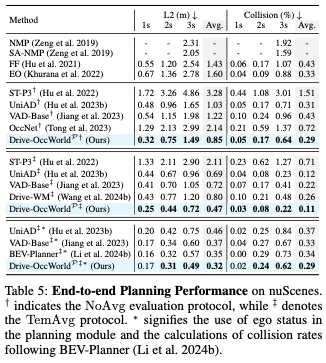

表5展示了与现有端到端方法相比,L2错误和冲突率方面的规划性能。我们提供ST-P3和UniAD不同评估方案设置下的结果。具体来说,NoAvg表示相应时间戳的结果,而TemAvg则通过0.5秒到相应时间戳之间的平均性能来计算指标。

如表5所示,与现有方法相比,Drive OccWorldP实现了更优的规划性能。例如,Drive OccWorldP†在以下方面分别获得了33%、22%和9.7%的相对改善L2@1s、L2@2s和L2@3s与UniAD相比†。我们将这一改进归因于世界模型积累世界知识和展望未来状态的能力。它有效地增强了未来时间戳的规划结果,并提高了端到端规划的安全性和鲁棒性。

最近的研究考察了将自车状态纳入规划模块的影响。根据这项研究,我们还对我们的自我状态模型和之前的工作进行了公平的比较。我们的研究结果表明,Drive OccWorld在遥远的未来时间戳仍然达到了最高的性能,证明了持续预测和规划的有效性。

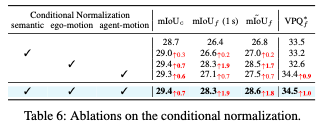

消融实验结果如下:

其他可视化结果:

结论

本文提出了Drive OccWorld,这是一个用于自动驾驶的4D Occ预测和规划世界模型。灵活的动作条件可以注入到动作可控发电的世界模型中,促进更广泛的下游应用。基于职业的规划器与运动规划的世界模型相结合,考虑了安全性和环境的3D结构。实验表明,我们的方法在职业和流量预测方面表现出了显著的性能。通过利用世界模型积累世界知识和展望未来状态的能力来提高规划结果,从而增强端到端规划的安全性和稳健性。

参考

[1] Driving in the Occupancy World: Vision-Centric 4D Occupancy Forecasting and Planning via World Models for Autonomous Driving

投稿作者为『自动驾驶之心知识星球』特邀嘉宾,欢迎加入交流!重磅,自动驾驶之心科研论文辅导来啦,申博、CCF系列、SCI、EI、毕业论文、比赛辅导等多个方向,欢迎联系我们!

① 全网独家视频课程

BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、大模型与自动驾驶、Nerf、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

网页端官网:www.zdjszx.com

网页端官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

国内最大最专业,近3000人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型、端到端等,更有行业动态和岗位发布!欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦感知、定位、融合、规控、标定、端到端、仿真、产品经理、自动驾驶开发、自动标注与数据闭环多个方向,目前近60+技术交流群,欢迎加入!扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】全平台矩阵

207

207

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?