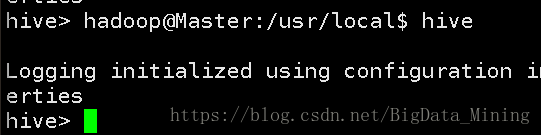

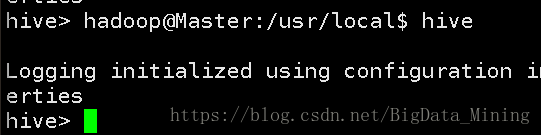

原因是这个jar包在新版本的spark中的位置已经改变!我们要做的只是将hive中的启动文件中的sparkAssemblyPath这一行更改为你安装的spark的jar包路径即可。具体如下:

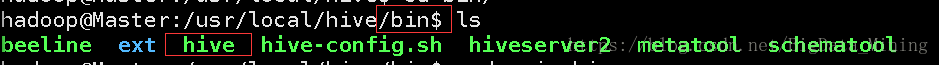

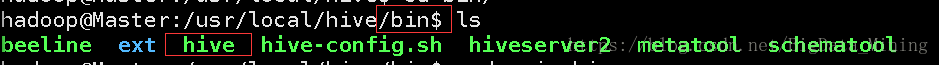

到Hive的bin目录下编辑hive:

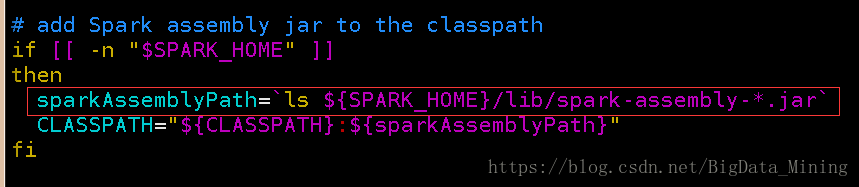

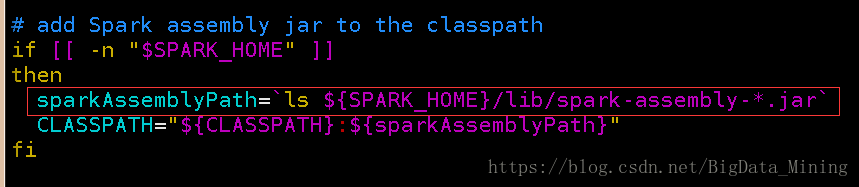

找到下图标记的这一行;

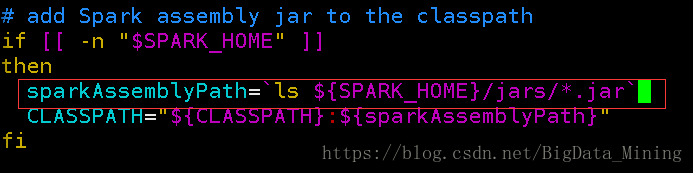

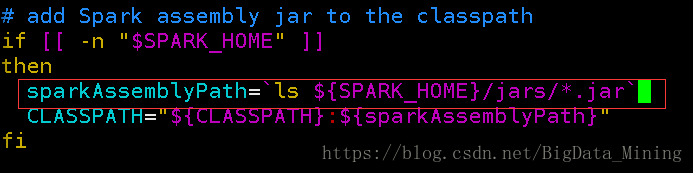

将上图红框内的内容更改为下图所示内容。

问题解决!!

修复Spark新版中Hive启动问题

修复Spark新版中Hive启动问题

本文介绍了解决在新版本Spark中由于jar包位置变动导致Hive启动失败的问题。通过更新Hive配置文件中的sparkAssemblyPath路径指向正确安装的Spark jar包,可以有效解决该问题。

本文介绍了解决在新版本Spark中由于jar包位置变动导致Hive启动失败的问题。通过更新Hive配置文件中的sparkAssemblyPath路径指向正确安装的Spark jar包,可以有效解决该问题。

原因是这个jar包在新版本的spark中的位置已经改变!我们要做的只是将hive中的启动文件中的sparkAssemblyPath这一行更改为你安装的spark的jar包路径即可。具体如下:

到Hive的bin目录下编辑hive:

找到下图标记的这一行;

将上图红框内的内容更改为下图所示内容。

问题解决!!