这不仅仅是常见的提示词与上下文之争,而是在构建AI智能体时,二者的作用有何不同。

如果你一直在深入研究多智能体AI系统——无论是使用CrewAI、LangGraph,还是AutoGen之类的工具——你可能已经意识到这一点:

→ 提示工程只是起点。

→ 而上下文工程才是真正让智能体具备智能的关键。

我们来详细分析一下。不搞虚的,只谈实用架构。

我们真正在设计的是什么?

在智能体AI中,你不只是向语言模型抛出提示词。

你正在设计由大语言模型(LLM)驱动的智能体,它们:

-

有目标

-

使用工具

-

存储记忆

-

与其他智能体通信

-

随着时间推移做出决策

它们不只是“响应”。它们会推理、适应和协作。

因此,很自然地,我们必须“越过”提示词。我们必须构建完整的上下文,供智能体在其中运行。

提示工程

我们从基础开始讲起。

提示工程 = 编写大语言模型(LLM)实际看到的消息,它设定了智能体的即时行为。

实际应用中:

prompt = f"""

You are a financial analyst agent.

Your job is to extract anomalies from transaction logs.

Use tools if needed. Always return only the top 3 suspicious activities.

Input Data:

{log_chunk}

"""

llm(prompt)

这会告诉模型要扮演什么角色、执行什么任务以及遵循什么输出格式。

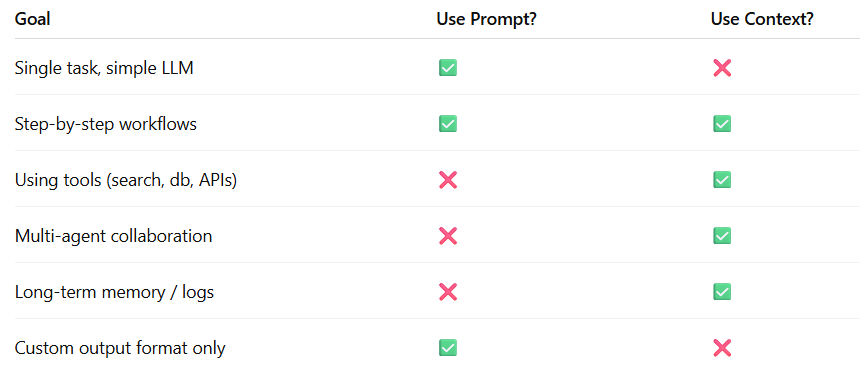

在以下场景中使用提示工程:

-

精确的格式

-

单任务内的良好推理能力

-

清晰的工具使用说明

-

少样本学习(提示词中包含示例)

但问题在于:

提示词只能控制某个瞬间。它们无法为智能体提供记忆、连续性或协作能力。

上下文工程(在AI智能体中)

现在我们来谈谈系统级思维。

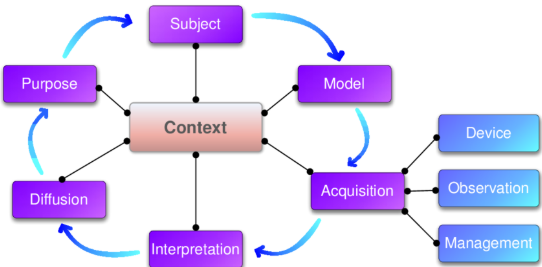

上下文工程 = 管理提示词周围的所有内容:记忆、任务历史、工具、智能体状态、检索到的知识以及智能体间的交互流程。

在实际的智能体中:

agent = Agent(

name="TransactionInvestigator",

role="Investigate suspicious transaction patterns",

memory=True,

tools=[search_tool, database_tool],

verbose=True,

backstory="You've worked with fraud teams for years...",

goals=["Ensure accuracy", "Minimize false positives"]

)

这个配置会告诉智能体:

-

它们的身份

-

它们之前做过什么

-

它们可以使用哪些工具

-

它们的使命是什么

即便有完美的提示词,智能体长期的行为也取决于这个上下文。

并列对比分析

仅使用提示词:

prompt = "You are a sales coach. Improve this pitch:\n" + input_text

llm(prompt)

结合上下文:

context = {

"persona": "Sales coach with SaaS experience",

"history": previous_pitch_attempts,

"tool_output": crm_tool.query(customer_id),

"goal": "Personalize pitch based on behavior data",

}

llm(context + prompt_template)

看出区别了吗?

一个只是给出指令,另一个则构建了一整个“大脑”。

总结

提示词编写是一种写作技巧。

上下文工程是一种架构能力。

如果你正在构建真正的AI智能体——那些能够思考、记忆、协作和适应的智能体——你的工作就不只是写出好的提示词,而是要设计思考环境。因为在智能体AI中,上下文就是“大脑”。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?