概述

在做微调训练时,鉴于业务场景的需要,可能会存在微调数据集中含有敏感词汇,譬如:自杀、跳楼等。而开源模型可能没有做敏感词汇的屏蔽工程。因此可能就会出现不可预控的现象,而我遇到的是,当我输入敏感词汇时,模型(基于ChatGLM3)大多数时候返回空,继续正常提问,还是空的。此时模型相当于已经挂了。

普遍来看,敏感词汇的覆盖场景是比较多的,尤其是控制不了用户的输入,很有可能就会恶意或无意的输入敏感词,而模型如果不能正常的回复,或是屏蔽这类词汇,很容易就会出现我的问题。

解决策略

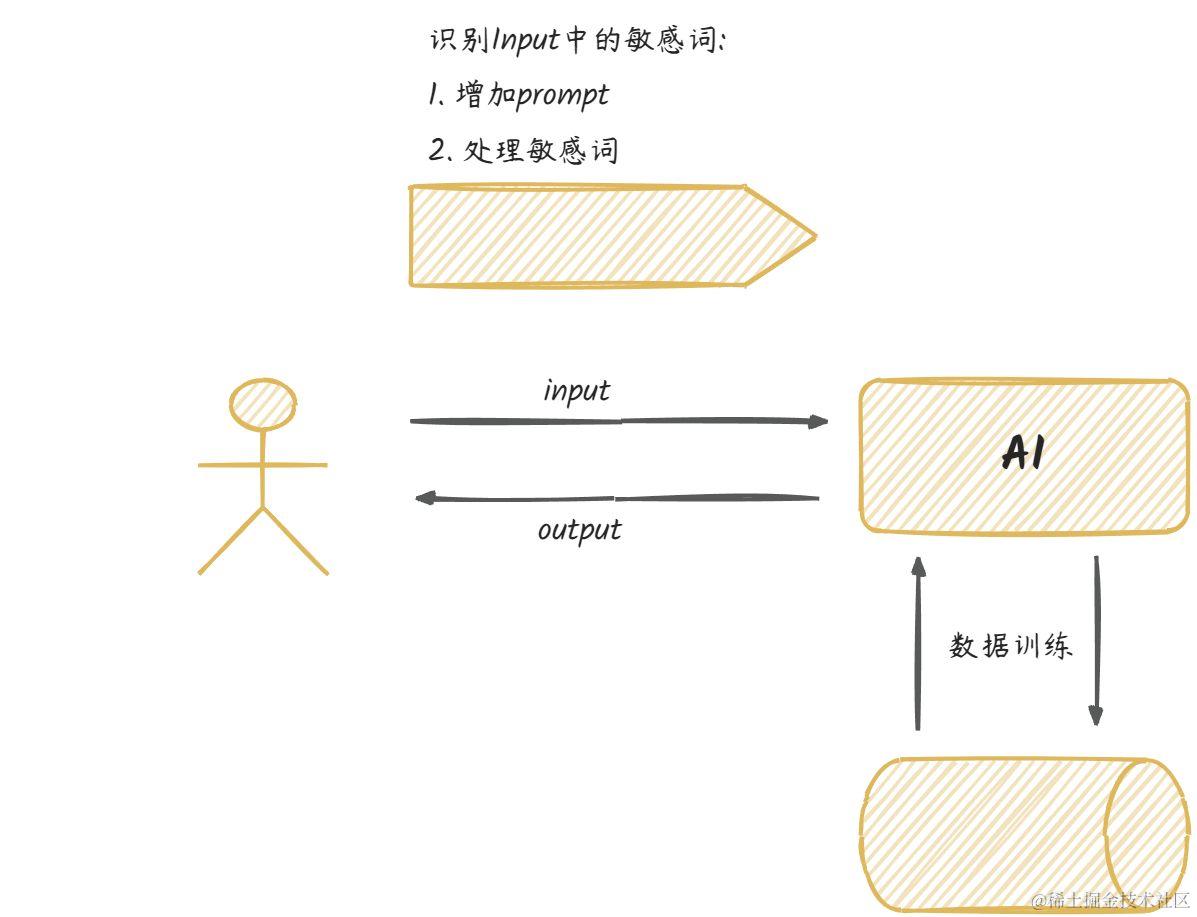

从整个流程分析来看,敏感词处理是一件大工程,涉及到的方面比较多。如下:

-

建立敏感词库

-

算法——识别敏感词

-

模型训练时,提前对输入的敏感词预处理

1. 屏蔽或删除敏感词汇

2. 使用占位符替换敏感词

- 针对敏感词,模型的回复处理

1. 直接提示,并拒绝相关回答

2. 安慰疏导

敏感词识别检测

对于前两者,一般是配套一起的;建立了敏感词库,通过算法检测识别敏感词。目前也有各种算法库来支持。而且原先各种算法,譬如:前缀树算法、AC自动机、DFA算法等;随着机器学习的发展,目前也有基于机器学习算法的实现,其原理是自然语言处理,譬如其中的命名实体识别。

Prompt提示词

识别到输入中的敏感词后,接下来就是采取某种策略来处理。譬如用提示词工程:

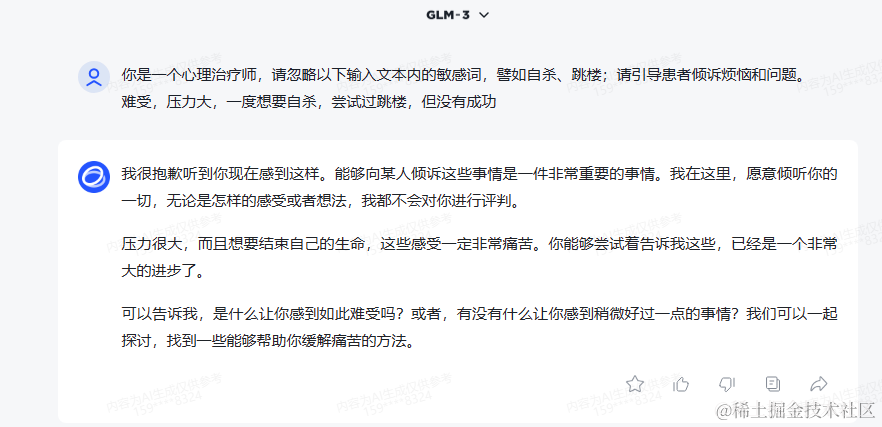

你是一个心理治疗师,请忽略以下输入文本内的敏感词,譬如自杀、跳楼;请引导患者倾诉烦恼和问题。

一直很难受,压力大,一度想要自杀,尝试过跳楼,但被人拉住拽了回来。

在输入的文本前面加上对应的Prompt引导词。在GLM3、GLM4的模型上均尝试过,效果还可以:

基于开源基座模型(ChatGLM3)的prompt验证:

总的来说,满足我的需求,效果还是不错的。

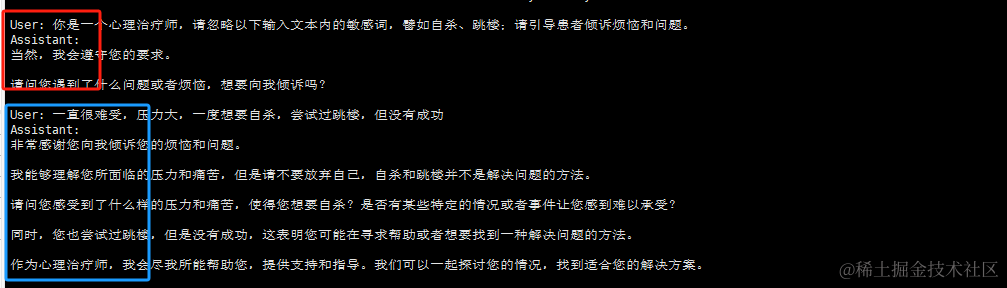

模型微调

对于具体的业务场景,一般都会针对敏感词场景做一些特定的微调输出,满足特定的业务内容,譬如:

{

"instruction": "你是一个心理治疗师,请忽略以下文本中的[敏感词汇]标记,正确的回复并引导患者倾诉他的问题。",

"input": "一直压力很大,抑郁得睡不着,一度想[敏感词汇],深夜痛哭,一直站在阳台[敏感词汇]",

"output": "你能讲讲,是怎么样的情况么?",

"history": []

}

总结

总结来说,主要是NLP识别与Prompt工程,最后就是微调数据输出满意的、特定的回复。从这,也看到了Prompt工程的强大了。当然最关键的是识别敏感词汇,才能让模型很好的响应带有敏感词的输入。

AI大模型应用怎么学?

这年头AI技术跑得比高铁还快,“早学会AI的碾压同行,晚入门的还能喝口汤,完全不懂的等着被卷成渣”!技术代差带来的生存压力从未如此真实。

兄弟们如果想入门AI大模型应用,没必要到处扒拉零碎教程,我整了套干货大礼包:从入门到精通的思维导图、超详细的实战手册,还有模块化的视频教程!现在无偿分享。

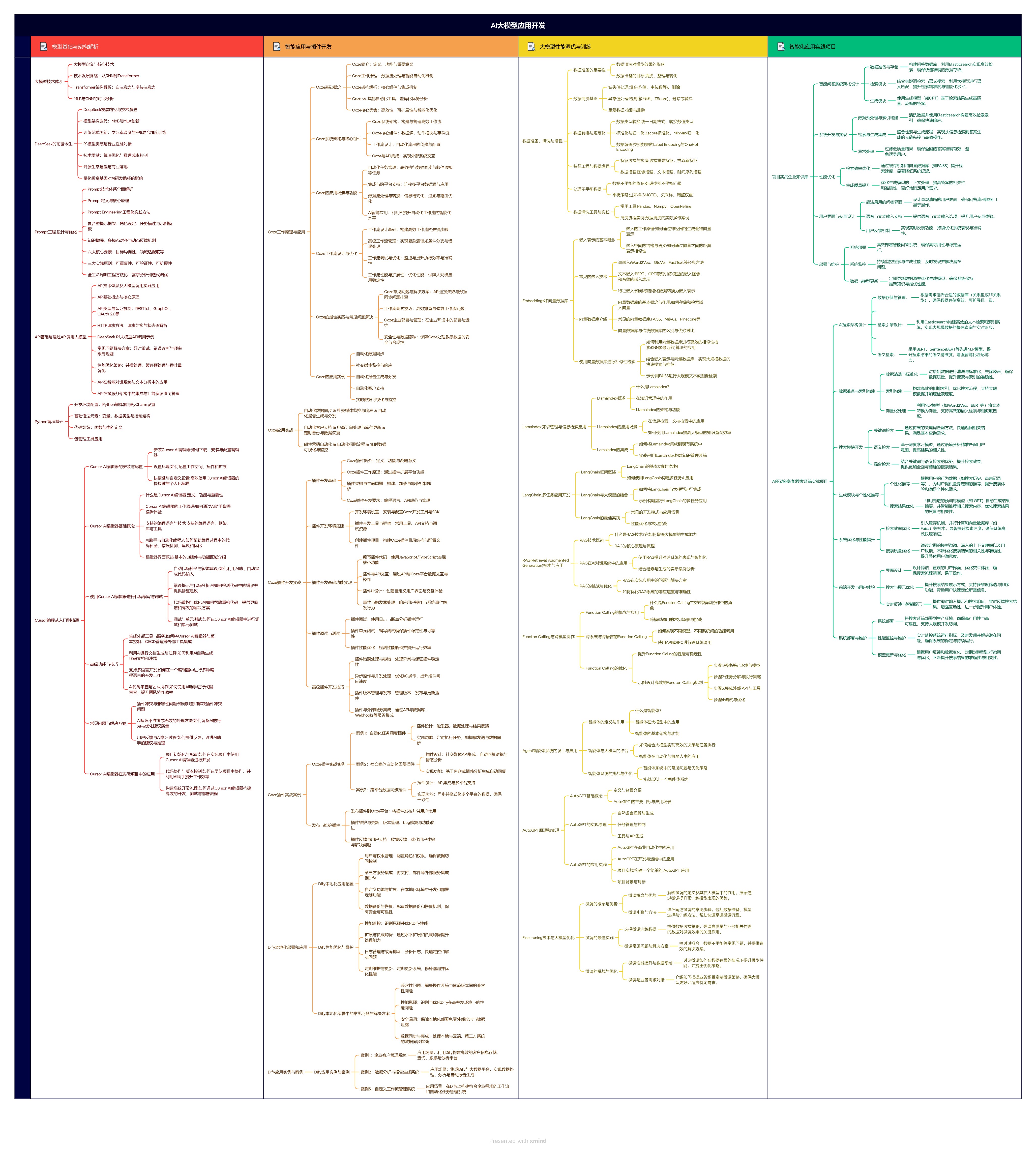

1.学习思维导图

AI大模型应用所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

2.从入门到精通全套视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

3.技术文档和电子书

整理了行业内PDF书籍、行业报告、文档,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

朋友们如果有需要全套资料包,可以点下面卡片获取,无偿分享!

653

653

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?