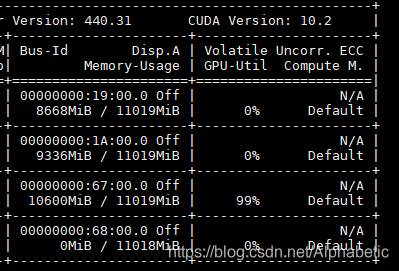

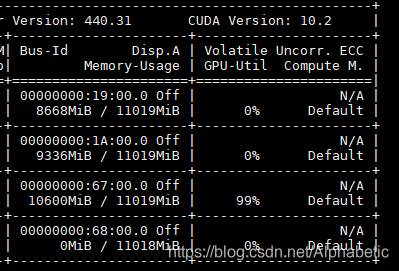

gpu利用率经常在0-99%之间跳动,找了一圈原因,可能是以下几点:

1. 数据预处理:CPU预处理太长,GPU空闲跟不上

解决办法:

可能是读数据或者数据预处理的时间过长,读数据部分可以尝试把全部或者部分数据放在内存,也可以放固态上。

数据预处理部分有些变换是否可以固定,假如是图像数据,有些resize或者padding的操作是否可以离线处理好。

适当调整dataloader读数据的线程数 pin_memory=4/8。

本文探讨了GPU利用率波动的原因,主要集中在数据预处理和加载时间过长。建议通过优化数据读取策略,如内存缓存、固态硬盘存储,以及调整Dataloader设置(如pin_memory参数)来缩短CPU处理时间,从而提高GPU利用率。同时提出对预处理步骤进行离线处理,例如图像的resize和padding,以确保GPU工作流畅。

本文探讨了GPU利用率波动的原因,主要集中在数据预处理和加载时间过长。建议通过优化数据读取策略,如内存缓存、固态硬盘存储,以及调整Dataloader设置(如pin_memory参数)来缩短CPU处理时间,从而提高GPU利用率。同时提出对预处理步骤进行离线处理,例如图像的resize和padding,以确保GPU工作流畅。

gpu利用率经常在0-99%之间跳动,找了一圈原因,可能是以下几点:

1. 数据预处理:CPU预处理太长,GPU空闲跟不上

解决办法:

可能是读数据或者数据预处理的时间过长,读数据部分可以尝试把全部或者部分数据放在内存,也可以放固态上。

数据预处理部分有些变换是否可以固定,假如是图像数据,有些resize或者padding的操作是否可以离线处理好。

适当调整dataloader读数据的线程数 pin_memory=4/8。

您可能感兴趣的与本文相关的镜像

TensorFlow-v2.15

TensorFlow 是由Google Brain 团队开发的开源机器学习框架,广泛应用于深度学习研究和生产环境。 它提供了一个灵活的平台,用于构建和训练各种机器学习模型

8928

8928

6509

6509

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?