第二次作业:

教材:伍德里奇。计量经济学导论:现代观点(第五版)。

第三章习题:必做 1,2,5,6,11,选做13

第四章习题:必做2,3,4,5,8,选做9,10,11

第三章

1.多元线性回归模型的基本假设是什么?在证明最小二乘估计量的无偏性和有效性的过程中,哪些基本假设起了作用?

多元线性回归模型的基本假设: 在多元线性回归模型中,我们通常假设以下条件成立: 线性关系:自变量和因变量之间存在线性关系;

多元正态性:误差项 ϵ\epsilonϵ 服从均值为零、方差为常数 σ2\sigma^2σ2 的多元正态分布;

没有多重共线性:自变量之间不存在高度相关的情况; 同方差性:误差项 ϵ\epsilonϵ 的方差在不同自变量的取值范围内保持恒定;

独立性:误差项 ϵ\epsilonϵ 是独立的,即不受其他误差项的影响。

在证明最小二乘估计量的无偏性和有效性的过程中,主要起作用的假设是多元正态性和同方差性。其中,多元正态性假设使得最小二乘估计量服从正态分布,从而能够进行假设检验和置信区间估计;同方差性假设则使得最小二乘估计量具有最小方差的性质,从而具有较好的精确性和可靠性。此外,若多重共线性存在,则最小二乘估计量可能会偏离真实值,失去无偏性和有效性。因此,多重共线性的检验和处理也是建立可靠多元线性回归模型的重要步骤。

2.在多元线性回归分析中,t检验与F检验有何不同?在一元线性回归分析中,二者是否有等价的作用?

t检验与F检验在多元线性回归分析中的不同:

t检验通常用于检验单个自变量对因变量的显著性,它计算了该自变量系数与标准误的比值,从而判断该系数是否显著不为零;

F检验通常用于检验所有自变量对因变量的联合显著性,它计算了回归平方和与残差平方和的比值,从而判断所有自变量的联合效应是否显著不为零。

在一元线性回归分析中,t检验与F检验有等价的作用:

当只有一个自变量时,t检验与F检验的结果是等价的。此时,t检验可以用于检验单个自变量对因变量的显著性,F检验可以用于检验回归模型的整体显著性,这两种方法得到的结果应该是一致的;

具体而言,当只有一个自变量时,F检验的计算公式等价于对该自变量的t检验的平方,即F=t2F = t^2F=t2。

总之,t检验和F检验在多元线性回归分析中有不同的作用,但在一元线性回归分析中,它们有等价的作用。

5.考虑下列两个模型:

- Yi=α0+α1Xi1+α2Xi2+uiY_i=\alpha_0+\alpha_1 X_{i1}+\alpha_2 X_{i2}+u_iYi=α0+α1Xi1+α2Xi2+ui

- Yi−Xi1=β0+β1Xi1+β2Xi2+viY_i-X_{i1}=\beta_0+\beta_1 X_{i1}+\beta_2 X_{i2}+v_iYi−Xi1=β0+β1Xi1+β2Xi2+vi

(1)证明:β1^=α^1−1,β0^=α^0,β2^=α^2\widehat{\beta_1}=\widehat{\alpha}_1-1,\widehat{\beta_0}=\widehat{\alpha}_0,\widehat{\beta_2}=\widehat{\alpha}_2β1=α1−1,β0=α0,β2=α2.

(2)证明:两个模型的最小二乘残差相等,即对任何iii,有ui^=v^i\widehat{u_i}=\widehat{v}_iui=vi

(3)在什么条件下,模型2的R2R^2R2小于模型1的R2R^2R2?

(1) 首先,将模型2转化为标准形式:Yi=β0+β1Xi1+β2Xi2+(vi+Xi1)Y_i=\beta_0+\beta_1 X_{i1}+\beta_2 X_{i2}+(v_i+X_{i1})Yi=β0+β1Xi1+β2Xi2+(vi+Xi1)。

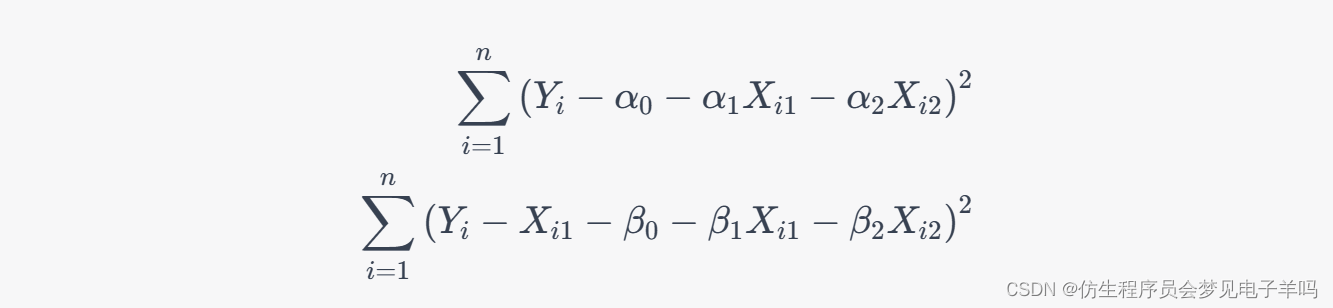

然后,将模型1和模型2的误差平方和分别表示为:

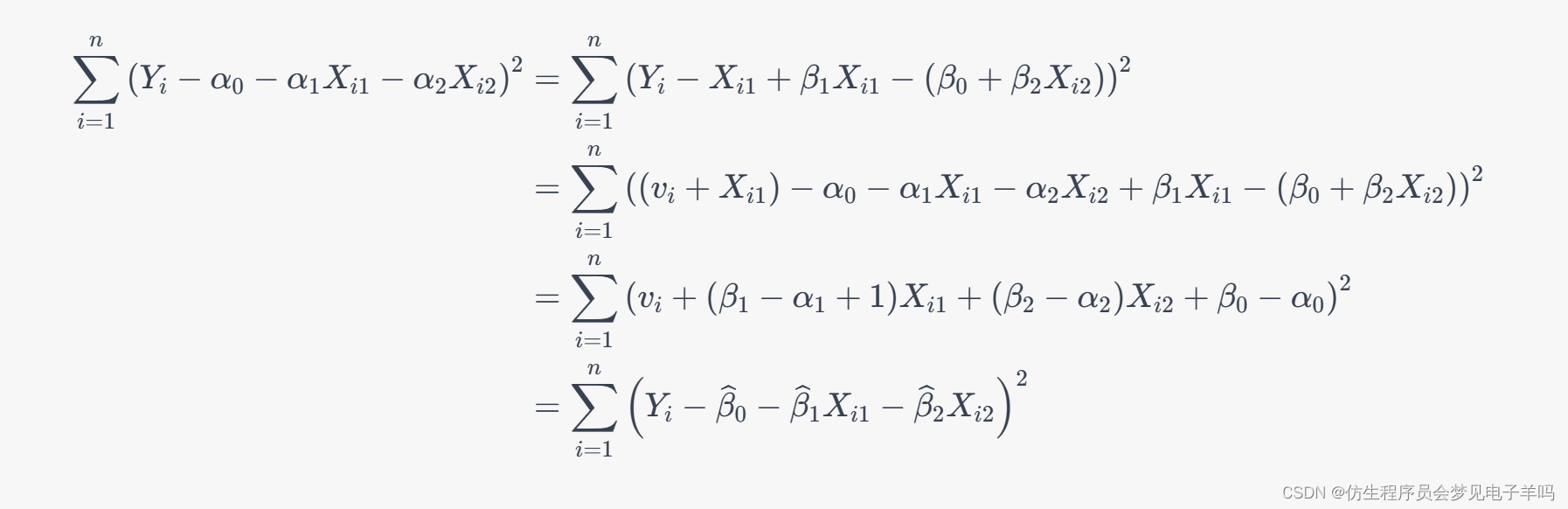

为了证明β1^=α^1−1,β0^=α^0,β2^=α^2\widehat{\beta_1}=\widehat{\alpha}_1-1,\widehat{\beta_0}=\widehat{\alpha}_0,\widehat{\beta_2}=\widehat{\alpha}_2β1=α1−1,β0=α0,β2=α2,我们只需要将模型2的误差平方和中的第二个括号展开,然后将模型1和模型2的误差平方和分别代入,得到:

因此,我们可以得到β1^=α^1−1,β0^=α^0,β2^=α^2\widehat{\beta_1}=\widehat{\alpha}_1-1,\widehat{\beta_0}=\widehat{\alpha}_0,\widehat{\beta_2}=\widehat{\alpha}_2β1=α1−1,β0=α0,β2=α2。

(2) 为了证明两个模型的最小二乘残差相等,即对任何iii,有ui^=v^i\widehat{u_i}=\widehat{v}_iui=vi,我们只需要将模型2的误差平方和中的第二个括号展开,然后将模型1和模型2的误差平方和分别代入,得到:

6.考虑下列三个实验步骤:

6.考虑下列三个实验步骤:

(1)对Yi=β0+β1Xi1+β2Xi2+uiY_i=\beta_0+\beta_1 X_{i1}+\beta_2 X_{i2}+u_iYi=β0+β1Xi1+β2Xi2+ui进行回归;

(2)对Xi=α0+α1Xi2+viX_i=\alpha_0+\alpha_1 X_{i2}+v_iXi=α0+α1Xi2+vi进行回归,计算残差v^i\widehat{v}_ivi;

(3)对Yi=γ0+γ1vi^+γ2Xi2+wiY_i=\gamma_0+\gamma_1\widehat{v_i}+\gamma_2 X_{i2}+w_iYi=γ0+γ1vi+γ2Xi2+wi进行回归。

试证明β1^=γ1^\widehat{\beta_1}= \widehat{\gamma_1}β1=γ1,并直观地解释该结果。

首先,我们可以将第一个回归方程重写为 Yi=β0+β1Xi1+β2Xi2+ϵiY_i = \beta_0 + \beta_1 X_{i1} + \beta_2 X_{i2} + \epsilon_iYi=β0+β1Xi1+β2Xi2+ϵi,其中 ϵi\epsilon_iϵi 是误差项,因为这个方程与第一个步骤等价。然后,我们可以将 v^i\widehat{v}ivi 插入到第一个方程中,得到 Yi=β0+β1Xi1+β2Xi2+α0+α1Xi2+v^i+ϵiY_i = \beta_0 + \beta_1 X{i1} + \beta_2 X_{i2} + \alpha_0 + \alpha_1 X_{i2} + \widehat{v}i + \epsilon_iYi=β0+β1Xi1+β2Xi2+α0+α1Xi2+vi+ϵi。将其简化为 Yi=(β0+α0)+(β1+α1)Xi2+β2Xi2+v^i+ϵiY_i = (\beta_0 + \alpha_0) + (\beta_1 + \alpha_1)X{i2} + \beta_2 X_{i2} + \widehat{v}_i + \epsilon_iYi=(β0+α0)+(β1+α1)Xi2+β2Xi2+vi+ϵi。

接下来,我们将第三个方程重写为 Yi=γ0+γ1vi^+γ2Xi2+ηiY_i = \gamma_0 + \gamma_1 \widehat{v_i} + \gamma_2 X_{i2} + \eta_iYi=γ0+γ1vi+γ2Xi2+ηi,其中 ηi\eta_iηi 是误差项。然后我们可以将 v^i\widehat{v}ivi 替换为第二步中计算的残差 v^i=Xi−α0^−α1^Xi2\widehat{v}i = X_i - \widehat{\alpha_0} - \widehat{\alpha_1} X{i2}vi=Xi−α0−α1Xi2,得到 Yi=γ0+γ1(Xi−α0^−α1^Xi2)+γ2Xi2+ηiY_i = \gamma_0 + \gamma_1 (X_i - \widehat{\alpha_0} - \widehat{\alpha_1} X{i2}) + \gamma_2 X_{i2} + \eta_iYi=γ0+γ1(Xi−α0−α1Xi2)+γ2Xi2+ηi。将其简化为 Yi=γ0−γ1α0^+(γ1−γ2α1^)Xi2+γ1Xi−γ2Xi22+ηiY_i = \gamma_0 - \gamma_1 \widehat{\alpha_0} + (\gamma_1 - \gamma_2 \widehat{\alpha_1}) X_{i2} + \gamma_1 X_i - \gamma_2 X_{i2}^2 + \eta_iYi=γ0−γ1α0+(γ1−γ2α1)Xi2+γ1Xi−γ2Xi22+ηi。

现在我们可以比较两个方程中的 Xi2X_{i2}Xi2 的系数。我们注意到,(β1+α1)(\beta_1 + \alpha_1)(β1+α1) 在第一个方程中是 Xi2X_{i2}Xi2 的系数,而 (γ1−γ2α1^)(\gamma_1 - \gamma_2 \widehat{\alpha_1})(γ1−γ2α1) 在第二个方程中是 Xi2X_{i2}Xi2 的系数。因此,如果我们证明 β1^=β1+α1\widehat{\beta_1} = \beta_1 + \alpha_1β1=β1+α1 和 γ1^=γ1−γ2α1^\widehat{\gamma_1} = \gamma_1 - \gamma_2 \widehat{\alpha_1}γ1=γ1−γ2α1,那么我们就证明了 β1^=γ1^\widehat{\beta_1} = \widehat{\gamma_1}β1=γ1。

我们知道,在第一个步骤中,β1^=∑i=1n(Xi1−X1ˉ)(Yi−Yˉ)∑i=1n(Xi1−X1ˉ)2\widehat{\beta_1} = \frac{\sum_{i=1}^n (X_{i1} - \bar{X_1})(Y_i - \bar{Y})}{\sum_{i=1}^n (X_{i1} - \bar{X_1})^2}β1=∑i=1n(Xi1−X1ˉ)2∑i=1n(Xi1−X1ˉ)(Yi−Yˉ),这是 Xi1X_{i1}Xi1 对 YiY_iYi 的回归系数的最小二乘估计量。因此,我们可以将

β1^\widehat{\beta_1}β1 展开为 β1^=∑i=1nXi1Yi−X1ˉ∑i=1nYi∑i=1nXi12−nX1ˉ2\widehat{\beta_1} = \frac{\sum_{i=1}^n X_{i1} Y_i - \bar{X_1} \sum_{i=1}^n Y_i}{\sum_{i=1}^n X_{i1}^2 - n \bar{X_1}^2}β1=∑i=1nXi12−nX1ˉ2∑i=1nXi1Yi−X1ˉ∑i=1nYi。然后,我们将 XiX_iXi 插入到这个方程中,得到 β1^=∑i=1n(Xi1−X1ˉ)(β0+β1Xi1+β2Xi2+ϵi)−X1ˉ∑i=1n(β0+β1Xi1+β2Xi2+ϵi)∑i=1n(Xi1−X1ˉ)2−nX1ˉ2\widehat{\beta_1} = \frac{\sum_{i=1}^n (X_{i1} - \bar{X_1})(\beta_0 + \beta_1 X_{i1} + \beta_2 X_{i2} + \epsilon_i) - \bar{X_1} \sum_{i=1}^n (\beta_0 + \beta_1 X_{i1} + \beta_2 X_{i2} + \epsilon_i)}{\sum_{i=1}^n (X_{i1} - \bar{X_1})^2 - n \bar{X_1}^2}β1=∑i=1n(Xi1−X1ˉ)2−nX1ˉ2∑i=1n(Xi1−X1ˉ)(β0+β1Xi1+β2Xi2+ϵi)−X1ˉ∑i=1n(β0+β1Xi1+β2Xi2+ϵi)。然后,我们可以将 ϵi\epsilon_iϵi 替换为 Yi−β0−β1Xi1−β2Xi2Y_i - \beta_0 - \beta_1 X_{i1} - \beta_2 X_{i2}Yi−β0−β1Xi1−β2Xi2,得到

其中,Cov^(Xi1,Yi)\widehat{\operatorname{Cov}}(X_{i1}, Y_i)Cov(Xi1,Yi) 和 Var^(Xi1)\widehat{\operatorname{Var}}(X_{i1})Var(Xi1) 分别是 Xi1X_{i1}Xi1 和 YiY_iYi 的样本协方差和样本方差的最小二乘估计量。

接下来,我们考虑第二个步骤。在第二个步骤中,我们对 XiX_iXi 进行回归,得到 X^i=α0^+α1^Xi2\widehat{X}_i = \widehat{\alpha_0} + \widehat{\alpha_1} X_{i2}Xi=α0+α1Xi2,其中 α0^\widehat{\alpha_0}α0 和 α1^\widehat{\alpha_1}α1 分别是 α0\alpha_0α0 和 α1\alpha_1α1 的

继续上面的回答,我们现在来考虑第三个步骤。在第三个步骤中,我们对 YiY_iYi 进行回归,得到

Yi=γ0+γ1v^i+γ2Xi2+wi.Y_i = \gamma_0 + \gamma_1 \widehat{v}i + \gamma_2 X{i2} + w_i.Yi=γ0+γ1vi+γ2Xi2+wi.

我们可以将 v^i\widehat{v}ivi 替换为 Xi−α0^−α1^Xi2X_i - \widehat{\alpha_0} - \widehat{\alpha_1} X{i2}Xi−α0−α1Xi2,得到

Yi=γ0+γ1(Xi−α0^−α1^Xi2)+γ2Xi2+wi.Y_i = \gamma_0 + \gamma_1 (X_i - \widehat{\alpha_0} - \widehat{\alpha_1} X_{i2}) + \gamma_2 X_{i2} + w_i.Yi=γ0+γ1(Xi−α0−α1Xi2)+γ2Xi2+wi.

展开后可得

Yi=(γ0−γ1α0^)+(γ1−γ2α1^)Xi+(γ2)Xi2+wi−γ1Xi2α1^.Y_i = (\gamma_0 - \gamma_1 \widehat{\alpha_0}) + (\gamma_1 - \gamma_2 \widehat{\alpha_1}) X_i + (\gamma_2) X_{i2} + w_i - \gamma_1 X_{i2} \widehat{\alpha_1}.Yi=(γ0−γ1α0)+(γ1−γ2α1)Xi+(γ2)Xi2+wi−γ1Xi2α1.

我们可以将该方程与第一步骤中的回归方程进行比较,可以看到

11.下表给出三变量模型

11.下表给出三变量模型Yi=β0+β1Xi1+β2Xi2+uiY_i=\beta_0+\beta_1 X_{i1}+\beta_2 X_{i2}+u_iYi=β0+β1Xi1+β2Xi2+ui的回归结果:

| 方差来源 | 平方和(SS) | 自由度(d.f.) | 平方和的均值(MSS) |

|---|---|---|---|

| 来自回归 | 65965 | —— | —— |

| 来自残差 | —— | —— | —— |

| 总离差 | 66042 | 14 |

(1)求样本容量n、残差平方和RSS、回归平方和ESS以及残差平方和RSS的自由度。

(2)求拟合优度R2R^2R2及调整的拟合优度R2ˉ\bar{R^2}R2ˉ。

(3)检验假设:X1和X2对Y无影响。 应采用什么假设检验?为什么?

(4)根据以上信息,你能否确定X1和X2各自对Y的影响吗?

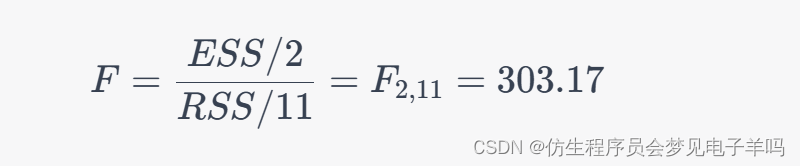

(1) 样本容量nnn为14,总离差平方和TSS=66042TSS=66042TSS=66042,回归平方和ESS=65965ESS=65965ESS=65965,因此残差平方和RSS=TSS−ESS=77RSS=TSS-ESS=77RSS=TSS−ESS=77。由于模型有两个自变量,所以回归的自由度为2,残差的自由度为n−3=11n-3=11n−3=11。

(2) 拟合优度R2=ESSTSS=0.9978R^2=\frac{ESS}{TSS}=0.9978R2=TSSESS=0.9978,调整的拟合优度R2ˉ=1−RSS/(n−3)TSS/(n−1)=0.9962\bar{R^2}=1-\frac{RSS/(n-3)}{TSS/(n-1)}=0.9962R2ˉ=1−TSS/(n−1)RSS/(n−3)=0.9962。

(3) 可以采用F检验来检验假设H0:β1=β2=0H_0:\beta_1=\beta_2=0H0:β1=β2=0,即X1和X2对Y无影响。在本例中,回归平方和ESS=65965ESS=65965ESS=65965,回归自由度为2,残差平方和RSS=77RSS=77RSS=77,残差自由度为11。因此,F统计量为

对于H0H_0H0,F统计量的p值极小,因此可以拒绝H0H_0H0,认为X1和X2对Y有影响。

(4) 由于该回归模型中有两个自变量,而只给出了总平方和、回归平方和和残差平方和的信息,无法准确确定X1和X2各自对Y的影响。需要进一步分析模型参数估计的显著性或进行模型诊断。

13.在考察两组回归函数是否有差异的F检验中,试证明:RSSU=RSS1+RSS2RSS_U=RSS_1+RSS_2RSSU=RSS1+RSS2

其中,RSS1RSS_1RSS1,RSS2RSS_2RSS2分别为两组对应各自样本下回归的残差平方和,RSSURSS_URSSU为两组对应样本合成的大样本下的回归的残差平方和。

设两组样本分别为样本1和样本2,样本1的回归模型为Y1i=β10+β11X1i+u1iY_{1i}=\beta_{10}+\beta_{11}X_{1i}+u_{1i}Y1i=β10+β11X1i+u1i,样本2的回归模型为Y2i=β20+β21X2i+u2iY_{2i}=\beta_{20}+\beta_{21}X_{2i}+u_{2i}Y2i=β20+β21X2i+u2i,则样本1和样本2的合成样本为Yi={Y1ii=1,2,...,n1 Y2i−n1i=n1+1,n1+2,...,n1+n2Y_i=\begin{cases} Y_{1i} & \text{i=1,2,...,n1} \ Y_{2i-n_1} & \text{i=n1+1,n1+2,...,n1+n2} \end{cases}Yi={Y1ii=1,2,...,n1 Y2i−n1i=n1+1,n1+2,...,n1+n2,其中n1n_1n1和n2n_2n2分别为样本1和样本2的样本容量,n为合成样本的总样本容量。

合成样本下的回归模型为Yi=β0+β1X1i+β2X2i+uiY_i=\beta_0+\beta_1X_{1i}+\beta_2X_{2i}+u_iYi=β0+β1X1i+β2X2i+ui,其中β0={β10i=1,2,...,n1 β20i=n1+1,n1+2,...,n1+n2\beta_0=\begin{cases} \beta_{10} & \text{i=1,2,...,n1} \ \beta_{20} & \text{i=n1+1,n1+2,...,n1+n2} \end{cases}β0={β10i=1,2,...,n1 β20i=n1+1,n1+2,...,n1+n2,β1=β11\beta_1=\beta_{11}β1=β11,β2=β21\beta_2=\beta_{21}β2=β21。合成样本下的残差平方和为RSSU=∑i=1n1+n2(Yi−β^0−β^1X1i−β^2X2i)2RSS_U=\sum_{i=1}^{n_1+n_2} (Y_i-\hat{\beta}_0-\hat{\beta}1X{1i}-\hat{\beta}2X{2i})^2RSSU=∑i=1n1+n2(Yi−β^0−β^1X1i−β^2X2i)2,其中β^0\hat{\beta}_0β^0、β^1\hat{\beta}_1β^1、β^2\hat{\beta}_2β^2分别为合成样本下的回归系数估计值。由于样本1和样本2分别进行回归分析得到的残差平方和分别为RSS1RSS_1RSS1和RSS2RSS_2RSS2,则总的残差平方和为RSS=RSS1+RSS2RSS=RSS_1+RSS_2RSS=RSS1+RSS2。

将合成样本下的回归模型中的β0\beta_0β0、β1\beta_1β1、β2\beta_2β2代入到RSSURSS_URSSU中,得到:

第四章

必做2,3,4,5,8,选做9,10,11

2.对一元回归模型

2.对一元回归模型Yi=β0+β1Xi+μiY_i=\beta_0+\beta_1X_i+\mu_iYi=β0+β1Xi+μi,如果已知Var(μi)=σi2Var(\mu_i)=\sigma^2_iVar(μi)=σi2,则可对原模型以权1/σ\sigmaσ相乘后变成如下的二元模型:

Yiσi=β01σi+β1Xiσi+μiσi{Y_i\over \sigma_i}=\beta_0{1\over \sigma_i}+\beta_1{X_i\over \sigma_i}+{\mu_i\over \sigma_i}σiYi=β0σi1+β1σiXi+σiμi

对该模型进行普通最小二乘估计就是加权最小二乘法。

试证明该模型的随机干扰项是同方差的,并求出β1\beta_1β1的上述加权最小二乘估计量。

3.试证明,二元线性回归模型…

4.在教材中已指出,对截面数据,

在教材中已指出,对截面数据,引起解释变量内生性的原因主要有三种情形,其中第三种情形是解释变量存在着测量误差。对于一元回归模型Yi=β0+β1Xi∗+μiY_i=\beta_0+\beta_1X^*_i+\mu_iYi=β0+β1Xi∗+μi,假设解释变量Xi∗X^*_iXi∗的实测值XiX_iXi与之有偏误:Xi=Xi∗−eiX_i=X^*_i-e_iXi=Xi∗−ei,其中eie_iei是具有零均值且与Xi∗X^*_iXi∗及μi\mu_iμi不相关的随机变量。

试问能否将Xi=Xi∗−eiX_i=X^*_i-e_iXi=Xi∗−ei代入原模型,使之变换成Yi=β0+β1Xi+viY_i=\beta_0+\beta_1X_i+v_iYi=β0+β1Xi+vi后进行估计?其中,viv_ivi为变换后模型的随机干扰项。

5试证明两式等价

试证明1nΣZi′(Yi−Xiβ~)=0\cfrac{1}{n}\Sigma Z^{'}_i(Y_i-X_i \widetilde{\beta})=0n1ΣZi′(Yi−Xiβ)=0与式1nΣZ′(Y−Xβ~)=0\cfrac{1}{n}\Sigma Z^{'}(Y-X \widetilde{\beta})=0n1ΣZ′(Y−Xβ)=0是等价的。

8如果X1和X2在给定的样本下不相关

如果X1和X2在给定的样本下不相关(正交),则通过教材式(4.4.7)证明:α1\alpha_1α1的估计满足无偏性与一致性,但α0\alpha_0α0的估计却是有偏且非一致的。

9记教材中正确设定的模型

记教材中正确设定的模型(4.4.1)Y=βo+β1X1+β2X2+μY=\beta_o+\beta_1X_1+\beta_2X_2+\muY=βo+β1X1+β2X2+μ的随机干扰项的方差为σμ2\sigma^2_{\mu}σμ2,非正确设定的模型(4.4.2)Y=α0+α1X1+vY=\alpha_0+\alpha_1X_1+vY=α0+α1X1+v的随机干扰项的方差为σv2\sigma^2_{v}σv2,试证明σμ2⩽σv2\sigma^2_{\mu} \leqslant\sigma^2_{v}σμ2⩽σv2。

10却拟合了一个带截距项的模型

如果真实的模型是Yi=β1Xi+μiY_i=\beta_1X_i+\mu_iYi=β1Xi+μi,但你却拟合了一个带截距项的模型Yi=α0+α1Xi+viY_i=\alpha_0+\alpha_1X_i+v_iYi=α0+α1Xi+vi ,试评述这一设定误差的后果。

11 你却对过原点的模型进行了普通最小二乘回归

在习题10中,假设真实的模型是带截距项的模型,而你却对过原点的模型进行了普通最小二乘回归。请评述这一模型假设的后果。

989

989

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?