学习方法

监督学习、无监督学习、半监督学习、强化学习

PyTorch 训练过程(Training Process)

加载数据:通过 DataLoader 加载数据。

定义损失函数和优化器。

前向传播(forward):计算模型的输出。

计算损失(loss):输出和真实值之间的差距。

反向传播:通过 loss.backward() 计算梯度。

更新参数:通过 optimizer.step() 使用优化器根据梯度更新模型的参数

重复上述步骤,直到达到预定的训练轮数。

绘制 Loss/Accuracy 曲线的方法

使用 TensorBoard 分析的方法

六、模型应用

图像分类、图像分割、目标检测的实现

对抗生成、循环网络等场景的应用

优化器的两个核心

梯度下降方法:参数更新方向

学习率:参数更新程度

正则化

归一化、标准化

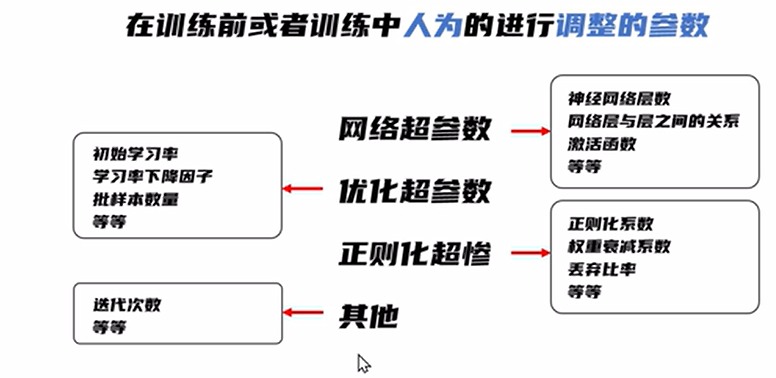

超参数

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?