背景

Meta于2023年2月,发布了Llama 1,这是一个里程碑式的时间点,标志着Meta正式进入大语言模型的竞争。Llama 1展示了在多个任务上的性能,并证明了高质量数据而非仅仅增加模型参数大小的重要性。

Meta与2023年7月,发布了Llama 2,它在性能上有着显著提高,并且在数据量上增加了40%,上下文长度翻倍,采用了分组查询注意力(Grouped Query Attention)机制。Llama 2还提供了针对对话场景微调的版本,即Llama 2-CHAT。技术方面,Llama 2使用了优化的自回归Transformer框架,支持PyTorch,并进行了数据清理和混合数据更新。

发布

ChatGPT又多了一个强有力的竞争对手:Meta发布Llama 3开源模型!附体验地址 from AI信息GAP

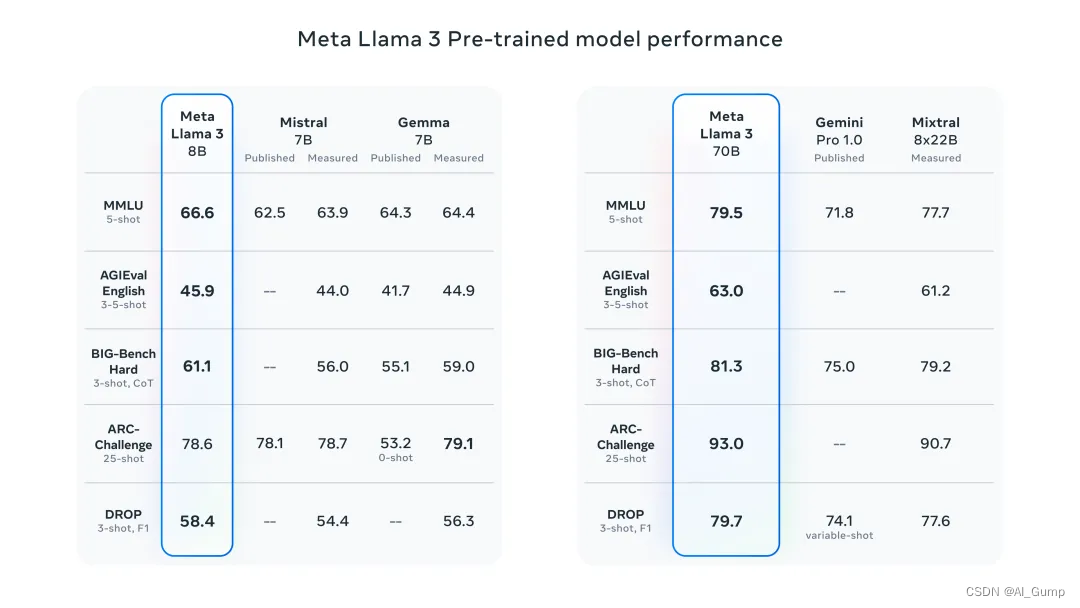

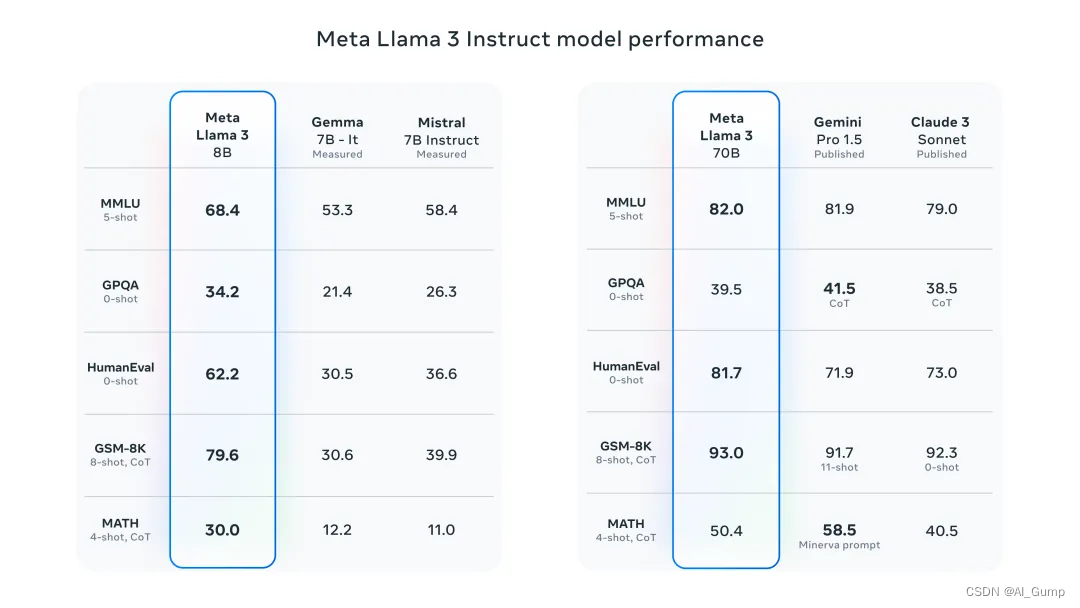

Llama 3的最新8B(80亿参数)和70B(700亿参数)模型在性能上相比Llama 2实现了飞跃式提升

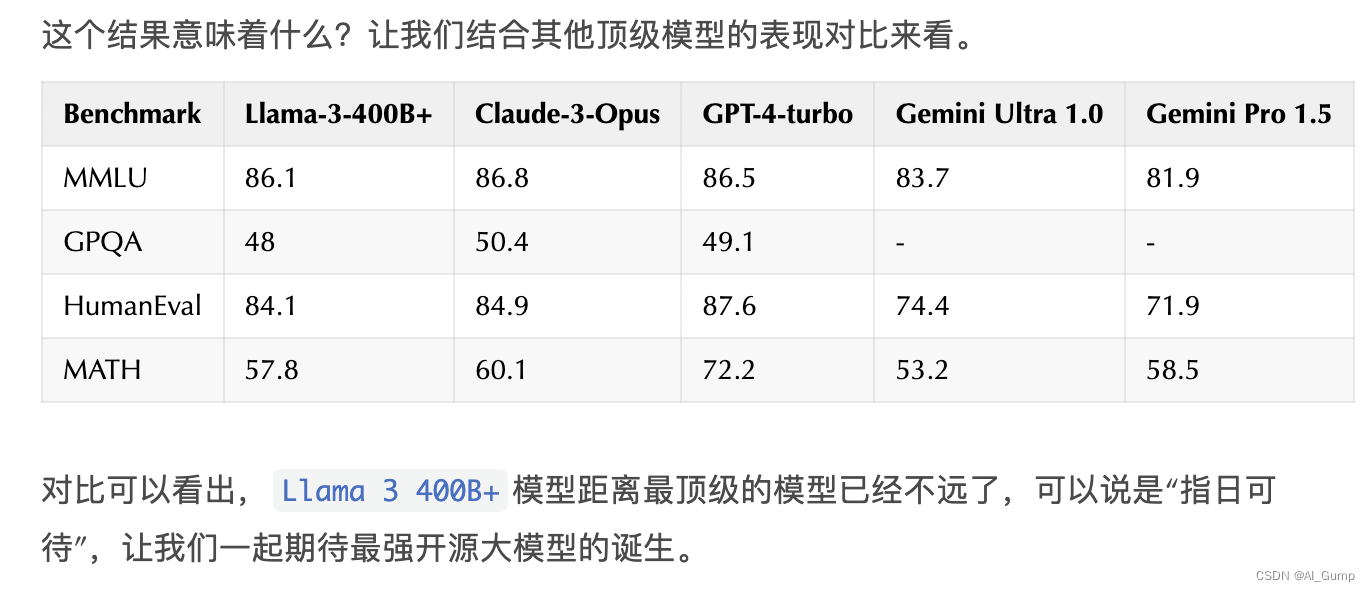

lama 3的8B和70B参数模型仅是开始,未来计划推出具备更多先进功能的模型,包括超过400B(4000亿)参数的模型。这些模型将引入多模态交互、多语言对话、更长上下文理解以及更全面的增强能力。

Meta公布的4月15日的基准测试结果,Llama 3 400B+模型的表现已经持平Claude 3 Opus,超过Gemini 1.5 Pro,仅在数学部分落后于最先进的 GPT-4 Turbo 2024-04-09模型

评测

Llama 3“智商”测试:英文提示表现亮眼,中文不完美但差强人意! From AI信息GAP

-

语言支持:Llama 3支持中文,但并不完美。官方提到预训练数据集中有超过5%的非英语数据,覆盖超过30种语言,但主要语料库是英文的。Meta计划未来优化多语言支持。

-

使用区域:Llama 3是一个开源模型。Meta AI平台提供了Llama 3的直接使用方式,服务区域包括美国和其他13个国家。

-

测试结果:在英文提示下,Llama 3表现亮眼。但在中文提示下,表现不稳定,有时会出现幻觉。

评论:国内可不用;

评测:书房读书后数量计算问题;不同空间开关灯泡映射问题;

英文通过,中文可能会出现幻觉问题;

Meta于2023年先后发布Llama 1、Llama 2,2024年发布Llama 3开源模型。Llama 3的8B和70B参数模型性能相比Llama 2有飞跃式提升,未来还计划推出更多先进功能模型。基准测试中表现良好,英文提示表现亮眼,中文提示表现不稳定。

Meta于2023年先后发布Llama 1、Llama 2,2024年发布Llama 3开源模型。Llama 3的8B和70B参数模型性能相比Llama 2有飞跃式提升,未来还计划推出更多先进功能模型。基准测试中表现良好,英文提示表现亮眼,中文提示表现不稳定。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?