作者:北方的郎

原文:https://zhuanlan.zhihu.com/p/15596329418

在人工智能的浪潮中,大语言模型(LLMs)如ChatGPT等已经展现出了令人惊叹的能力,能够生成流畅的文本、回答复杂的问题,甚至进行多轮对话。然而,尽管这些模型在通用任务上表现出色,但在处理特定领域或需要最新信息的查询时,它们仍然面临着“幻觉”问题——即生成看似合理但实际不准确的内容。为了解决这一问题,检索增强生成(Retrieval-Augmented Generation, RAG)技术应运而生。RAG通过动态检索外部信息来增强LLMs的回答能力,从而减少不准确内容的生成。而在这个过程中,查询优化(Query Optimization, QO)成为了决定RAG效果的关键因素。

由来自腾讯的研究者发表了“A Survey of Query Optimization in Large Language Models”,深入探讨了查询优化技术的演变、核心方法及其在大语言模型中的应用,带领读者全面了解这一领域的最新进展与未来方向。

Paper:A Survey of Query Optimization in Large Language ModelsAbs:https://arxiv.org/abs/2412.17558

以下为内容摘要:

1. 引言

大语言模型(LLMs)在自然语言处理领域取得了显著成就,但在处理特定领域或需要最新信息的任务时,仍然存在明显的局限性。特别是在面对超出其训练数据范围的查询时,LLMs容易产生“幻觉”,即生成看似合理但实际不准确的内容。为了解决这一问题,检索增强生成(RAG)技术被引入,通过动态检索外部信息来增强LLMs的回答能力,从而减少不准确内容的生成。

自Lewis等人于2020年提出RAG以来,该领域发展迅速,尤其是在ChatGPT等模型的出现后。然而,尽管RAG技术取得了显著进展,但关于其底层机制和后续研究的系统性分析仍然缺乏。此外,该领域的研究焦点分散,术语使用不一致,导致了一定的混乱。

RAG通常涉及多个核心概念,包括查询优化、信息检索和响应生成。其中,查询优化在直接决定检索信息的相关性方面起着至关重要的作用,进而影响最终回答的质量。尽管查询优化在检索增强的大语言模型中经历了快速发展,但缺乏系统性的总结来阐明其更广泛的轨迹。本文旨在填补这一空白,通过梳理查询优化在检索增强LLMs中的演变过程,展望其未来发展。

2. 查询优化的分层

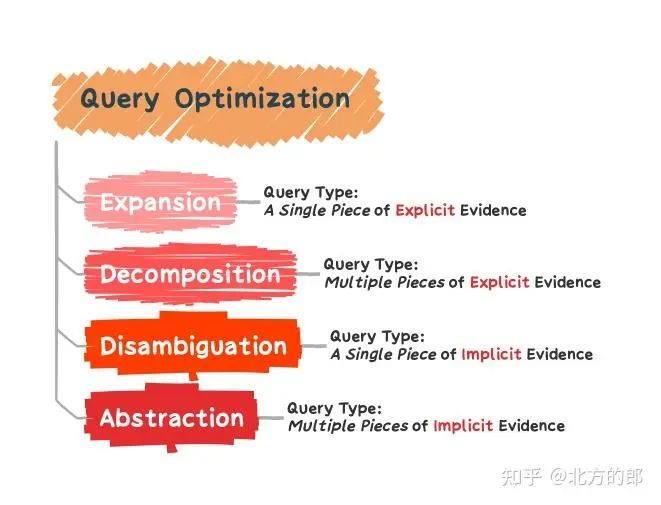

查询优化对于提升检索增强生成的效果和精度至关重要。通过优化用户的原始查询,这一过程解决了语义模糊、复杂需求以及查询与目标文档之间的相关性差异等挑战。有效的查询优化需要对用户意图和查询上下文有深刻的理解,尤其是在处理复杂或多方面的查询时。成功实施查询优化可以显著提高问题解决的性能,从而大幅提升模型生成输出的质量。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1288

1288

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?