1.感知机

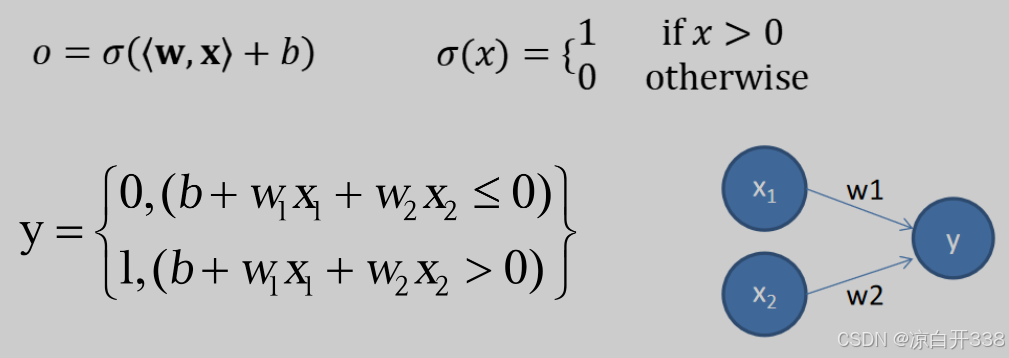

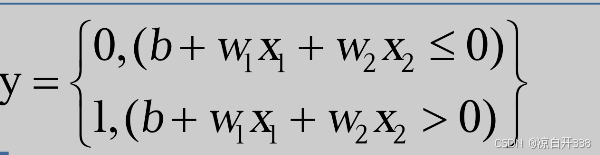

感知机是由美国学者弗兰克·罗森布拉特在1957年提出,是神经网络与支持向量机的基础。其基本原理是将输入特征通过线性组合,然后使用激活函数进行处理来做出分类决策。

w称为权重:控制输入信号的重要性的参数

b称为偏置:偏置是调整神经元被激活的容易程度参数

二分类 (0 或 1) Vs. 回归:输出实数Vs. Softmax:输出的概率,多个分类

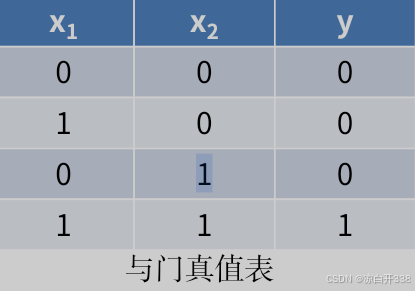

1.与门

- 与门是一种实现逻辑与运算的电路元件,只有当所有输入都为高电平(逻辑1)时,输出才为高电平(逻辑1);只要有一个输入为低电平(逻辑0),输出就为低电平(逻辑0),其功能符合逻辑乘法规则。

- 电路符号

在电路设计中,与门有特定的符号。常见的符号是一个矩形,在输入端有两条或多条线表示多个输入,输出端有一条线,在矩形的前端(输入端一侧)有一个“&”符号,表示逻辑与的关系。

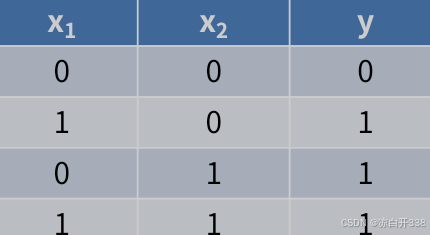

与门的逻辑功能可以用真值表清晰表示,假设有两个输入X1和X2,一个输出y,其真值表如下:

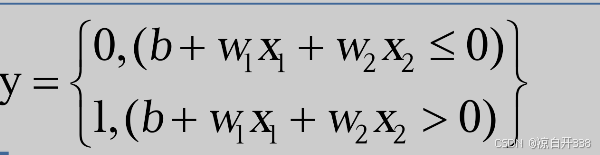

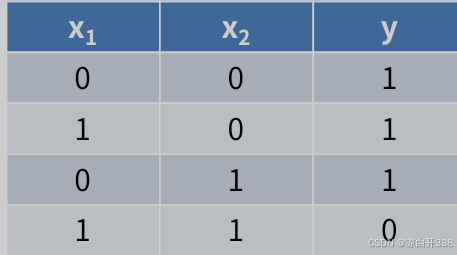

2.与非门

- 与非门是一种实现“与非”逻辑运算的电路元件,它先对输入信号进行“与”运算,然后再对“与”运算的结果取反。也就是说,只要输入中有一个为低电平(逻辑0),输出就为高电平(逻辑1);只有当所有输入都为高电平(逻辑1)时,输出才为低电平(逻辑0)。

- 在电路设计中,与非门的符号通常是一个矩形,输入端有两条或多条线表示多个输入,输出端有一条线,在矩形的前端(输入端一侧)有一个“&”符号,表示先进行“与”运算,在输出端有一个小圆圈,表示对“与”运算的结果取反。

与门的逻辑功能可以用真值表清晰表示,假设有两个输入X1和X2,一个输出y,其真值表如下:

3.或门

- 或门实现的是逻辑或运算,只要其多个输入中有一个为高电平(逻辑1),输出就为高电平(逻辑1);只有当所有输入都为低电平(逻辑0)时,输出才为低电平(逻辑0),其功能符合逻辑加法规则。

- 在电路设计里,或门一般用一个特定符号表示,是一个类似D的形状,在输入端有两条或多条线表示多个输入,输出端有一条线,在D形的前端(输入端一侧)有一个“≥1”符号,表示只要有一个或一个以上输入为高电平,输出即为高电平。

以两个输入X1和X2、一个输出y为例,或门的真值表如下:

4.异或门

- 异或门实现的是逻辑异或运算,当两个输入信号不同时,输出为高电平(逻辑1);当两个输入信号相同时,输出为低电平(逻辑0)。

- 异或门的电路符号通常是一个特殊形状,类似一个大于号和小于号拼接在一起,在输入端有两条线表示两个输入,输出端有一条线,在符号中间有一个“⊕”符号,表示异或运算。

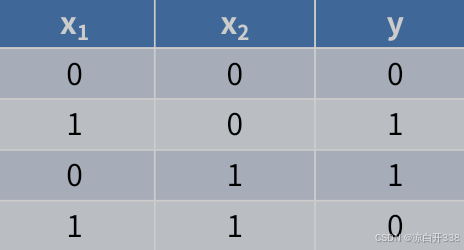

以两个输入X1和X2、一个输出y为例,或门的真值表如下:

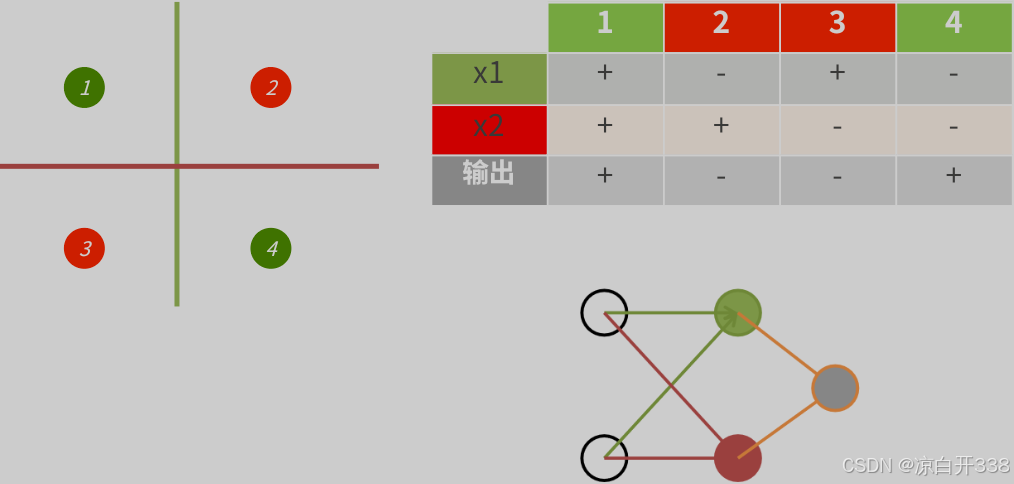

5.局限性

- 感知机的局限性就是只能表示由一条直线分割的空间。

- 可以用非线性的曲线划分出非线性空间

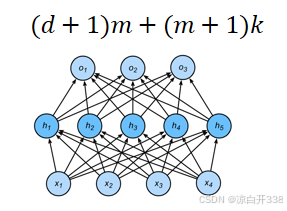

6.多层感知机

多层感知机(Multilayer Perceptron,MLP)是一种基本的人工神经网络。

- 优势:具有强大的非线性拟合能力,理论上可以逼近任何连续的非线性函数;对数据的适应性强,能处理各种类型的数据。

- 局限性:容易过拟合,尤其是在数据量较小或模型复杂度较高的情况下;训练过程计算量较大,需要较长的时间和较高的计算资源;对数据的依赖性强,数据质量和分布对模型性能影响大。

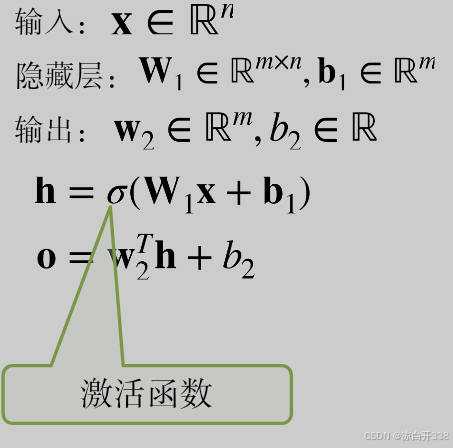

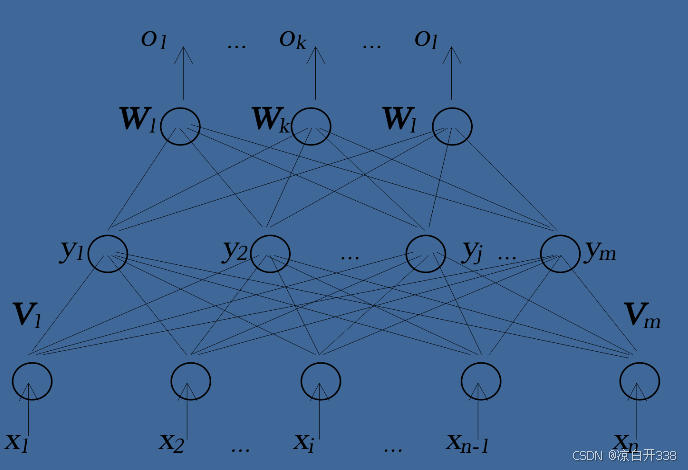

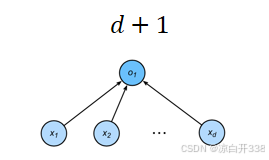

7.单隐藏层

单隐藏层是多层感知机(MLP)中的一种简单结构形式。

- 输入层:负责接收原始输入数据,节点数量由输入数据的特征数量决定。比如在手写数字识别中,若将每个数字图像表示为784维的向量,则输入层节点数为784。

- 隐藏层:处于输入层和输出层之间,只有一层。其中包含一定数量的神经元,每个神经元与输入层的所有神经元全连接,通过权重和偏置对输入进行线性变换,再经过激活函数引入非线性。

- 输出层:产生最终的输出结果,节点数量根据具体任务而定。如在二分类问题中,输出层通常只有1个节点,表示属于某一类别的概率;在多分类问题中,若有10个类别,则输出层有10个节点。

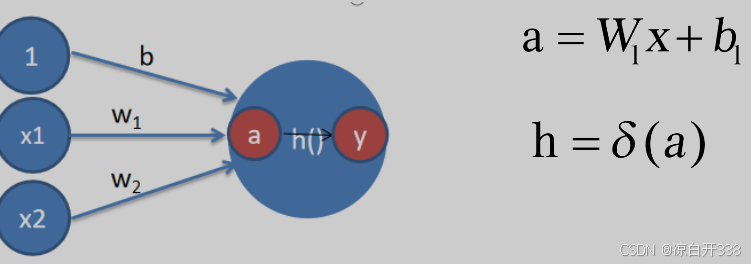

激活函数

刚才登场的h(x)函数会将输入信号的总和转换为输出信号,这种函数一般称为激活函数(activation function)。如“激活”一词所示,激活函数的作用在于决定如何来激活输入信号的总和。

- 激活函数在神经元中非常重要的。为了增强网络的表示能力和学习能力,激活函数需要具备以下几点性质:

- 连续并可导(允许少数点上不可导)的非线性函数。

- 激活函数及其导函数要尽可能的简单,有利于提高网络计算效率。

- 激活函数的导函数的值域要在一个合适的区间内,不能太大也不能太小,否则会影响训练的效率和稳定性。

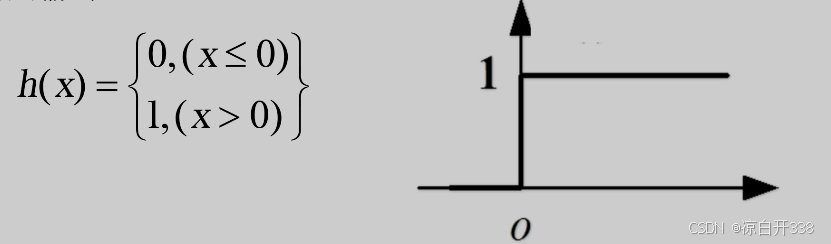

1.阶跃函数

阶跃函数以0为界,一旦输入超过0,就切换输出1,否则输出0。

可以说感知机使用了阶跃函数作为激活函数。

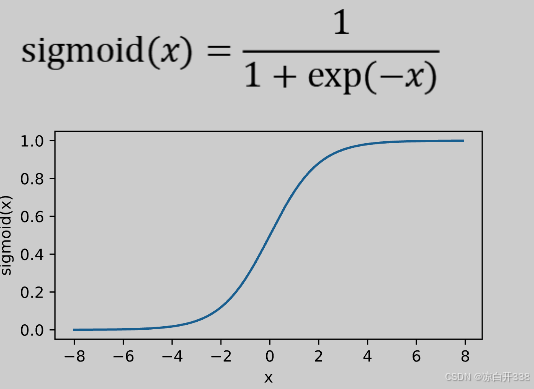

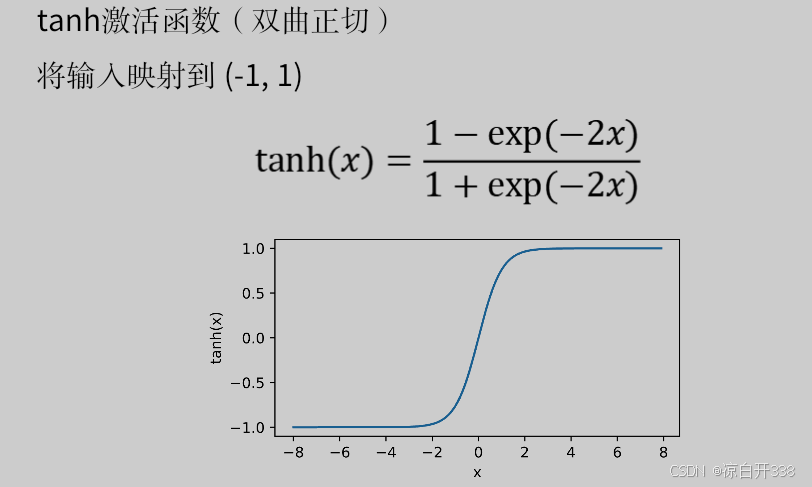

- S型(sigmoid) 激活函数(挤压函数)将输入投影到(0,1),是一个软的

2.多个隐藏层多类分类

- 多个隐藏层:在输入层和输出层之间存在两个或两个以上的隐藏层。每个隐藏层包含多个神经元,神经元之间通过权重连接,信息在层与层之间传递时会经过加权求和与激活函数的处理,从而对输入数据进行逐步的特征提取和抽象。

- 多层感知机使用隐藏层和激活函数来得到非线性模型

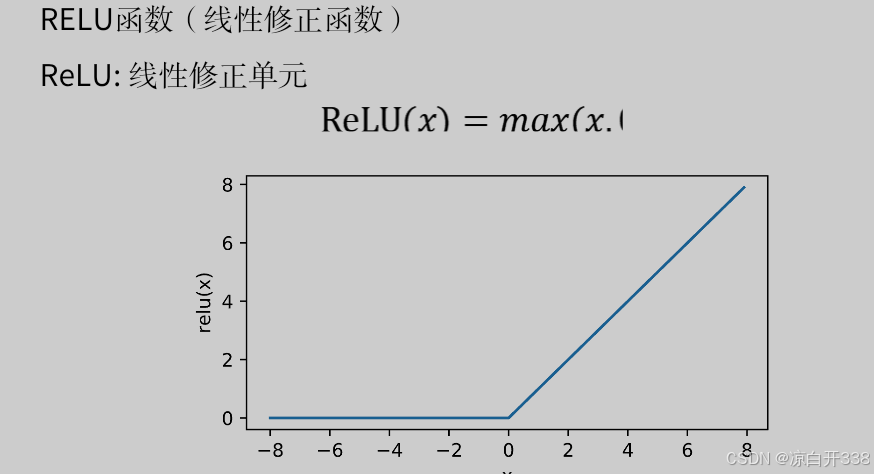

- 常用激活函数是Sigmoid,Tanh,RELU

- 使用Softmax来处理多分类

- 超参数为隐藏层数和各个隐藏层大小

1.参数更新

前向传播(正向传播)输入样本--输入层--各隐藏层--输出层反向传播(误差反传)输出层——各隐藏层——输入层计算神经网络参数梯度的方法修正各层单元的权值。

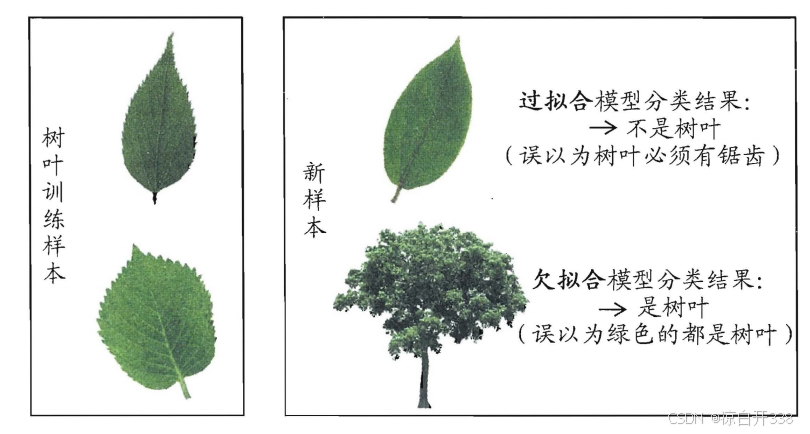

2.过拟合和欠拟合

- 当学习器把训练样本学得"太好"了的时候,很可能已经把训练样本自身的一些特点当作了所有潜在样本都会具有的一般性质——过拟合;

- 对训练样本的一般性质尚未学好——欠拟合

模型复杂度的影响

比较不同算法之间的复杂度;例如树与神经网络给定算法族,两个主要因素很重要:参数个数每个参数值的选择范围

多种因素很重要:

- 样本数量

- 每个样本中的特征数量

- 时间、空间

- 结构多样性

3127

3127

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?