2. Word2vec的两种训练模式

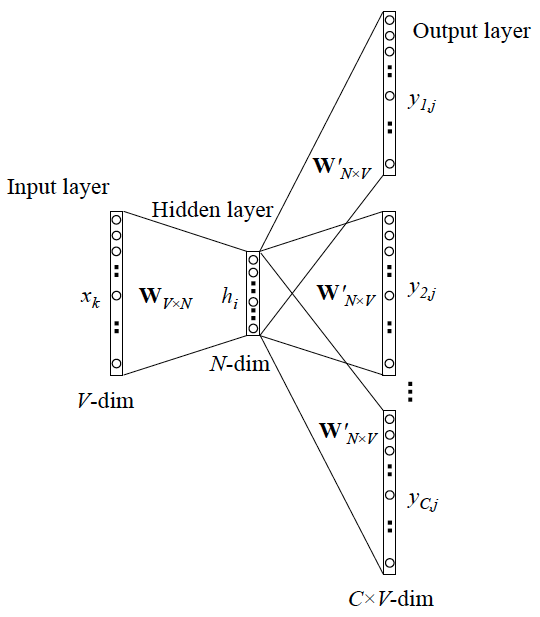

2.1 Skip-gram 模型(Continuous Skip-gram Model)

Skip-gram模型:如果是用一个词语作为输入,来预测它周围的上下文,那这个模型叫做【Skip-gram 模型】。

____ ____ 我 ____ ____

可以看成是 单个x->单个y 模型的并联,cost function 是单个 cost function 的累加(取log之后)。

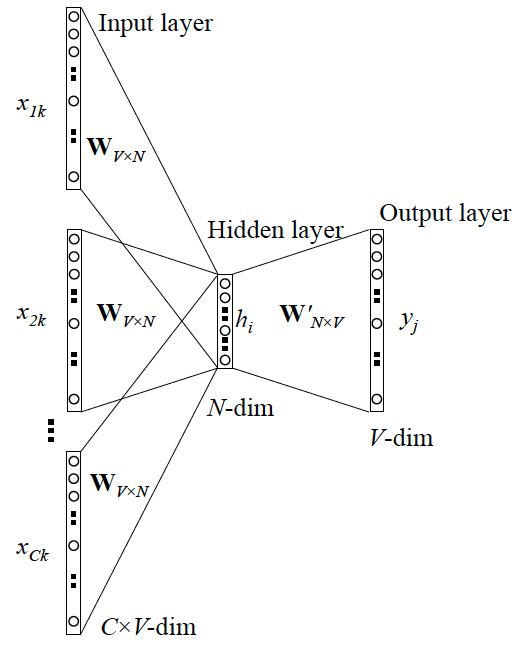

2.2 CBOW 模型(Continuous Bag-of-Words Model)

CBOW 模型:如果是拿一个词语的上下文作为输入,来预测这个词语本身,则是 【CBOW 模型】。

吴彦祖 没有 ____ 长的 帅气

这里的输入变成了多个单词,所以要对输入处理下(一般是求和然后平均),输出的 cost function 不变

3. One-Hot Encoder(独热编码)

独热编码又称一位有效编码,其方法是使用N位状态寄存器来对N个状态进行编码,每个状态都有它独立的寄存器位,并且在任意时候,其中只有一位有效。举个例子,假设我们有四个样本(行),每个样本有三个特征(列),如下图:

feature_1有两种可能的取值,比如是男/女,这里男用1表示,女用2表示。feature_2 和feature_3各有4种取值(状态)。one-hot编码就是保证每个样本中的单个特征只有1位处于状态1,其他的都是0。上述状态用one-hot编码如下图所示:

考虑一下的三个特征:

[“male”, “female”]

[“from Europe”, “from US”, “from Asia”]

[“uses Firefox”, “uses Chrome”, “uses Safari”, “uses Internet Explorer”]

将它换成独热编码后,应该是:

feature1=[01,10]

feature2=[001,010,100]

feature3=[0001,0010,0100,1000]

4. Word2vec

Word2vec模型其实就是简单化的神经网络,上文所说的输入的 x 就是One-Hot Vector,Hidden Layer没有激活函数,也就是线性的单元。Output Layer维度跟Input Layer的维度一样,用的是Softmax回归。当这个模型训练好以后,我们并不会用这个训练好的模型处理新的任务,我们真正需要的是这个模型通过训练数据所学得的参数,例如隐层的权重矩阵。

这个模型是如何定义数据的输入和输出呢?就是上面提到的 CBOW 与 Skip-Gram 两种模型。CBOW对小型数据库比较合适,而Skip-Gram在大型语料中表现更好。

百度百科:

Word2vec,是一群用来产生词向量的相关模型。这些模型为浅而双层的神经网络,用来训练以重新建构语言学之词文本。网络以词表现,并且需猜测相邻位置的输入词,在word2vec中词袋模型假设下,词的顺序是不重要的。训练完成之后,word2vec模型可用来映射每个词到一个向量,可用来表示词对词之间的关系,该向量为神经网络之隐藏层。

二、网安视频合集

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

三、精品网安学习书籍

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、网络安全源码合集+工具包

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

五、网络安全面试题

最后就是大家最关心的网络安全面试题板块

nimg.cn/15c1192cad414044b4dd41f3df44433d.png)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?