(一)任务一:数据获取与清洗

1.子任务一:数据获取

(1)启动Hadoop集群,使用HDFS Shell指令,在HDFS根目录下级联创建一个名为/behavior/origin_log的目录,用于存储采集到的用户行为日志;

答:hadoop fs -mkdir -p /behavior/origin_log

(2)目录创建完成,使用HDFS Shell指令,将本地/root/eduhq/data/app_log/behavior目录下的所有用户行为日志文件采集至HDFS的/behavior/origin_log目录下;

答:hadoop fs -put /root/eduhq/data/app_log/behavior/* /behavior/origin_log

(3)采集完成,在本机打开浏览器,访问http://本机主机名:9870或http://本机IP地址:9870进入HDFS WebUI界面,查看是否成功将数据采集到HDFS上。

答:使用浏览器访问即可。

2.子任务二:数据清洗

(1)使用Windows操作系统上的Excel软件,打开名为

"behavior2023-01-01.csv"的文件;

(2)对数据进行清洗,专注处理名为"behavior2023- 01-01.csv"的文件中的"time"列。将时间日期格式进行分列,分别处理为日期和时间两列。

答:

(二)任务二:数据标注

开 发 一 个 简 单 的 Java 类 IpToLocUdf , 继 承

org.apache.hadoop.hive.ql.udf.generic.GenericUDF ,重载initialize()、evaluate()和 getDisplayString()方法;该类需要实现通过 IP 从/root/eduhq/data/area.json文件中随机获取“省份”和“城市”信息,完成数据的分类标注。

答:

import org.apache.hadoop.hive.ql.exec.UDFArgumentException;

import org.apache.hadoop.hive.ql.exec.UDFArgumentLengthException;

import org.apache.hadoop.hive.ql.exec.UDFArgumentTypeException;

import org.apache.hadoop.hive.ql.metadata.HiveException;

import org.apache.hadoop.hive.ql.udf.generic.GenericUDF;

import org.apache.hadoop.hive.serde2.objectinspector.ObjectInspector;

import org.apache.hadoop.hive.serde2.objectinspector.ObjectInspectorFactory;

import org.apache.hadoop.hive.serde2.objectinspector.primitive.StringObjectInspector;

import org.codehaus.jackson.JsonNode;

import org.codehaus.jackson.map.ObjectMapper;

import org.codehaus.jackson.node.ObjectNode;

import java.io.File;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List;

public class IpToLocUdf extends GenericUDF {

private StringObjectInspector stringInspector;

private ObjectInspector outputOI;

// 初始化函数,用于设置函数参数和输出类型

/*

这个initialize方法的主要作用是验证输入参数的数量和类型,并设置输出类型为字符串。

如果输入参数不符合要求,它将抛出异常。

最后,它返回一个输出类型的ObjectInspector,供其他方法使用。

*/

@Override

public ObjectInspector initialize(ObjectInspector[] arguments) throws UDFArgumentException {

// 检查参数数量是否为1,如果不是则抛出异常

if (arguments.length != 1) {

throw new UDFArgumentLengthException(

"The function iptoloc(ip) takes exactly 1 argument.");

}

// 检查第一个参数是否为StringObjectInspector类型,如果不是则抛出异常

if (!(arguments[0] instanceof StringObjectInspector)) {

throw new UDFArgumentTypeException(0,

"The argument must be a string, but " + arguments[0].getTypeName()

+ " was given.");

}

// 将第一个参数设置为字符串类型的ObjectInspector

this.stringInspector = (StringObjectInspector) arguments[0];

// 设置输出类型为字符串,通过反射创建ObjectInspector实例

this.outputOI = ObjectInspectorFactory.getReflectionObjectInspector(String.class,

ObjectInspectorFactory.ObjectInspectorOptions.JAVA);

// 打印输出类型的ObjectInspector信息

System.out.println(outputOI);

return outputOI; // 返回输出类型的ObjectInspector,供其他方法使用

}

@Override

public Object evaluate(DeferredObject[] arguments) throws HiveException {

// 获取传入的IP地址参数

String ip = stringInspector.getPrimitiveJavaObject(arguments[0].get());

// 从指定文件中读取地区信息

//File file = new File("/root/eduhq/data/area.json");

File file = new File("/resources/area.json");

ObjectMapper mapper = new ObjectMapper();

List<String> provinces = new ArrayList<>();

List<String> cities = new ArrayList<>();

try {

// 解析JSON文件

JsonNode rootNode = mapper.readTree(file);

// 遍历JSON节点,获取省份和城市信息

for (JsonNode node : rootNode) {

String province = node.path("province").getTextValue();

String city = node.path("city").getTextValue();

provinces.add(province);

cities.add(city);

}

} catch (IOException e) {

throw new HiveException("Failed to read area.json file: " + e.getMessage(), e);

}

// 根据IP地址进行分类标注

int index = ipToIndex(ip);

String province = provinces.get(index);

String city = cities.get(index);

// 返回分类标注结果

ObjectNode result = mapper.createObjectNode();

result.put("province", province);

result.put("city", city);

return result.toString();

}

@Override

public String getDisplayString(String[] children) {

return "iptoloc(" + children[0] + ")";

}

private int ipToIndex(String ip) {

// 根据IP地址的某种算法得到索引值

// 这里简单地使用IP地址的字符长度模拟算法

return ip.length() % 7;

}

}

<dependency>

<groupId>org.apache.hive</groupId>

<artifactId>hive-exec</artifactId>

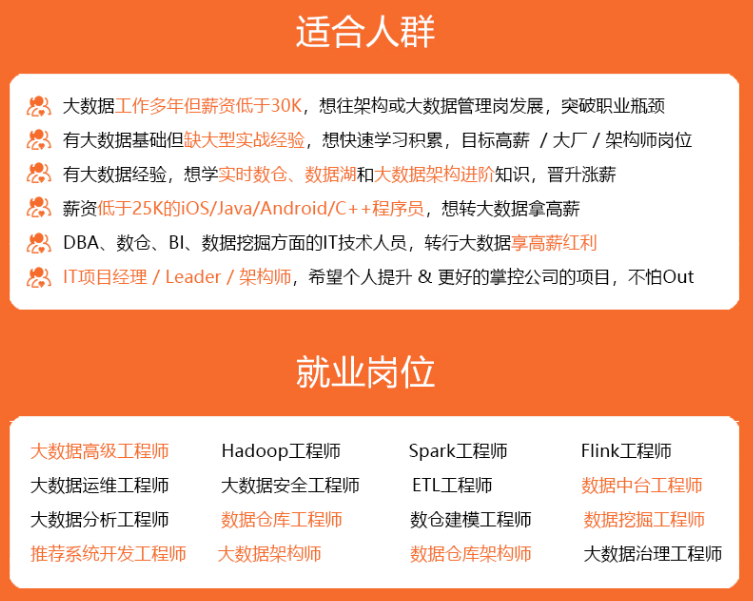

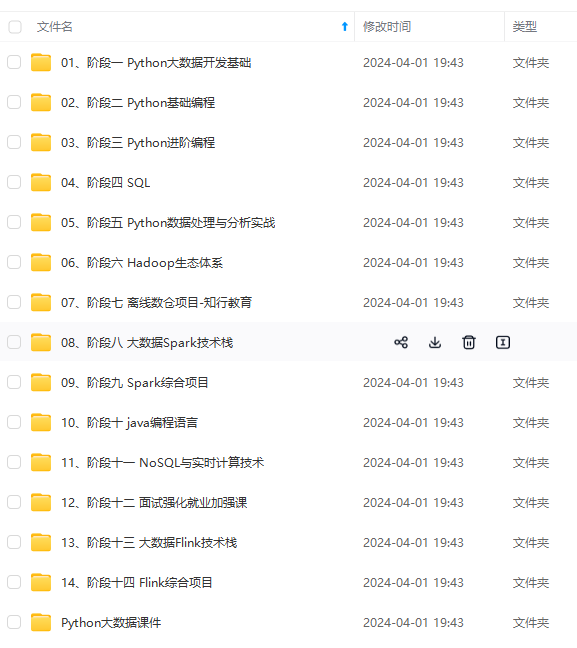

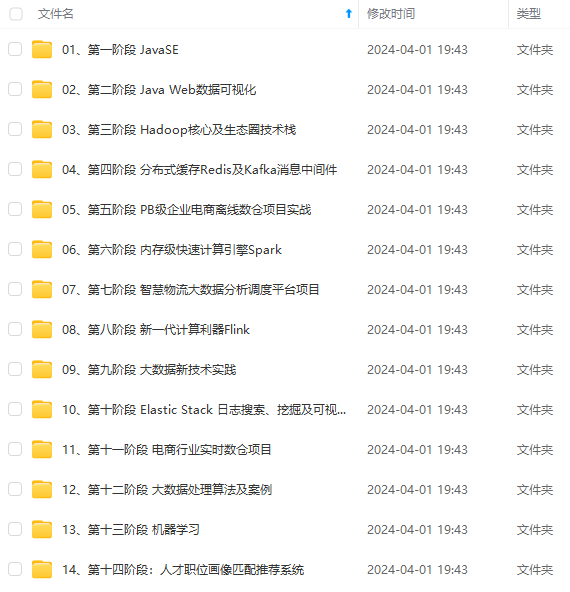

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.youkuaiyun.com/topics/618545628)**

知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.youkuaiyun.com/topics/618545628)**

文章介绍了如何使用Hadoop进行数据采集,包括创建目录、上传文件,并使用Excel清洗特定列。同时,详细展示了如何开发一个Java类IpToLocUdf,继承自GenericUDF,从JSON文件中随机获取省份和城市信息,对数据进行分类标注。

文章介绍了如何使用Hadoop进行数据采集,包括创建目录、上传文件,并使用Excel清洗特定列。同时,详细展示了如何开发一个Java类IpToLocUdf,继承自GenericUDF,从JSON文件中随机获取省份和城市信息,对数据进行分类标注。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?