本期介绍了书生浦语大模型相关的全链路开源体系。讲述老师为上海人工智能实验室的青年科学家 陈恺。

一.大模型成为发展通用人工智能的重要途径:(如图所示)

二.书生浦语2.0的体系

1.7B:为轻量级的研究和应用提供了模型 ;

20B:模型的综合性更为强劲,可支持更复杂的应用场景

两种模型都包含了InternLM2-Base,InternLM2,InternLM2-Chat

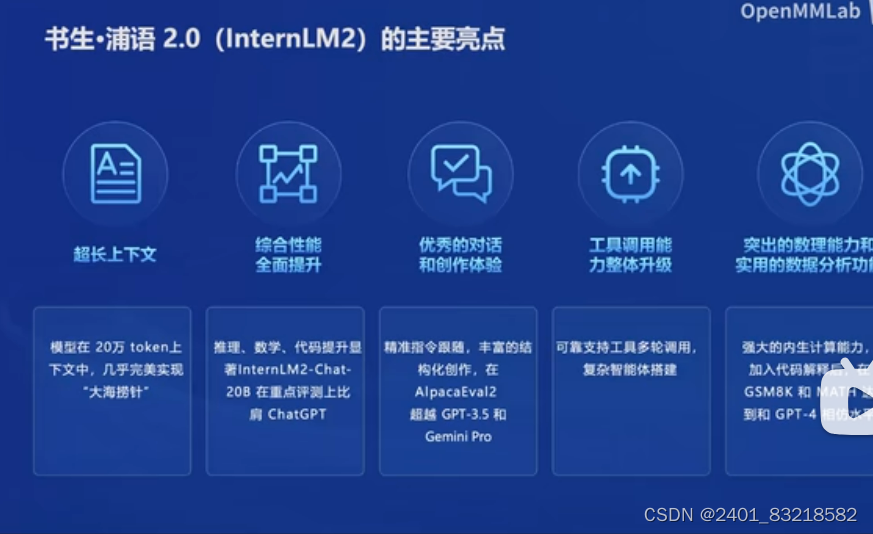

2.InternLM2的主要亮点是什么呢?

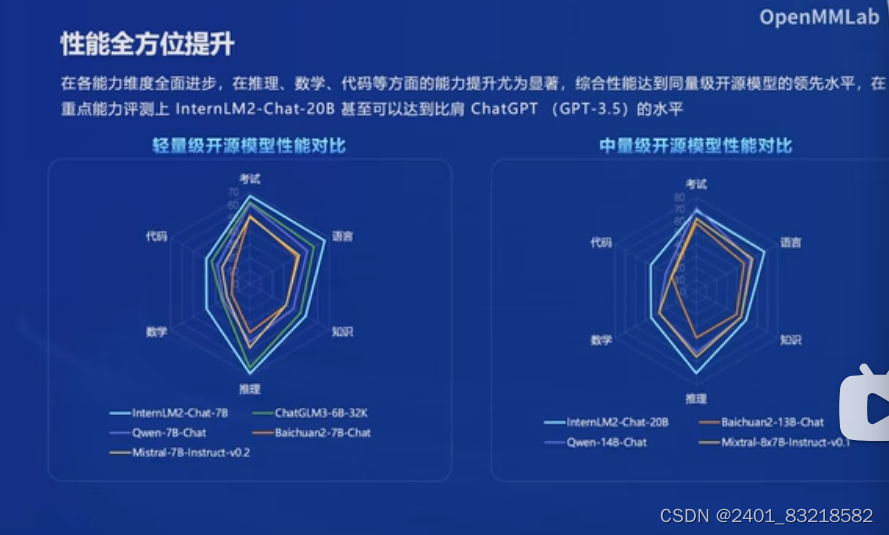

3.既然是2.0,那么在性能方面肯定也有所提升,其中在推理,数学,代码等方面的能力提升尤为显著,综合性能达到同量级开源模型的领先水平,在重点能力评测上InternLM2-Chat-20B甚至可以达到比肩ChatGPT(GPT-3.5)的水平

4.工具调用能力升级

(1)强大的内生计算能,(高准确率,复杂运算求和)

通过代

本文介绍了书生浦语大模型的最新2.0版本,强调了其在性能提升和应用场景支持上的优势。文章详细阐述了InternLM2的特点,以及从模型选择到应用的典型流程,包括开源的预训练、微调、部署和评测工具。

本文介绍了书生浦语大模型的最新2.0版本,强调了其在性能提升和应用场景支持上的优势。文章详细阐述了InternLM2的特点,以及从模型选择到应用的典型流程,包括开源的预训练、微调、部署和评测工具。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?