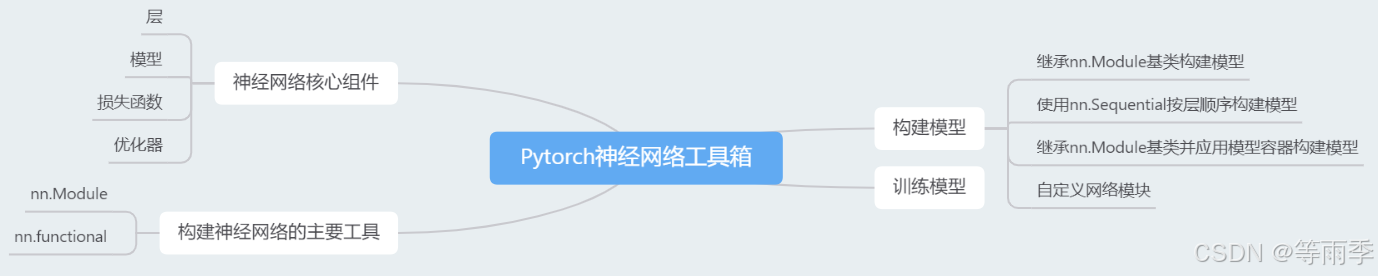

一、Pytorch神经网络工具箱

二、神经网络核心组件

| 层 | 神经网络的基本结构,将输入张量转换为输出张量。 |

| 模型 | 层构成的网络。 |

| 损失函数 | 参数学习的目标函数,通过最小化损失函数来学习各种参数。 |

| 优化器 | 如何是损失函数最小,这就涉及到优化器。 |

三、

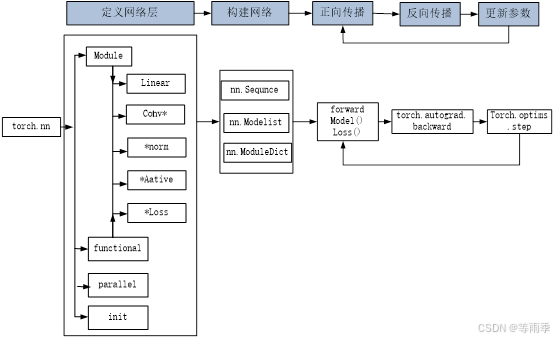

三、构建神经网络的主要工具

1、nn.Module

①继承自Module类,可自动提取可学习的参数。

②适用于卷积层、全连接层、dropout层。

2、nn.functional

①更像是纯函数。

②适用于激活函数、池化层。

四、构建神经网络的主要工具-nn.Module

五、构建神经网络的主要工具-nn.functional

nn.Module,写法一般为nn.Xxx,如nn.Linear、nn.Conv2d、nn.CrossEntropyLoss等。

nn.functional中的函数,写法一般为nn.funtional.xxx,如nn.funtional.linear、nn.funtional.conv2d、nn.funtional.cross_entropy等。

两者的主要区别如下:

1、nn.Xxx继承于nn.Module,nn.Xxx 需要先实例化并传入参数,然后以函数调用的方式调用实例化的对象并传入输入数据。它能够很好的与nn.Sequential结合使用,而nn.functional.xxx无法与nn.Sequential结合使用。

2、nn.Xxx不需要自己定义和管理weight、bias参数;而nn.functional.xxx需要你自己定义weight、bias,每次调用的时候都需要手动传入weight、bias等参数, 不利于代码复用。

3、dropout操作在训练和测试阶段是有区别的,使用nn.Xxx方式定义dropout,在调用model.eval()之后,自动实现状态的转换,而使用nn.functional.xxx却无此功能。

六、构建模型

继承nn.Module基类构建模型。

使用nn.Sequential按层顺序构建模型。

继承nn.Module基类构建模型,又使用相关模型容器(nn.Sequential,nn.ModuleList,nn.ModuleDict等)进行封装。

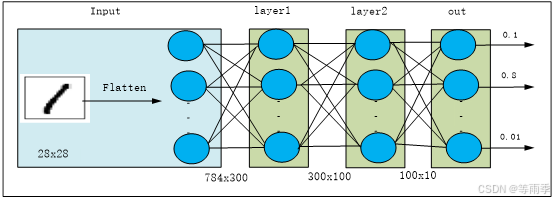

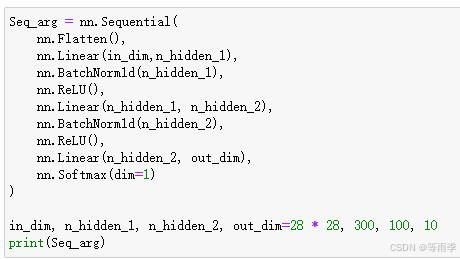

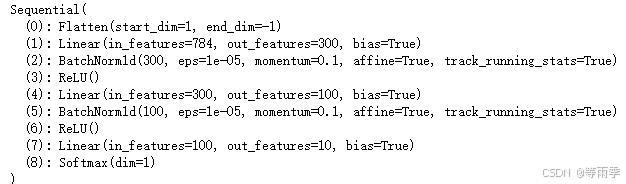

七、使用nn.Sequential按层顺序构建模型

1.利用可变参数

该方法构建时不能给每个层指定名称,如果需要给每个层指定名称,可使用add_module方法或OrderedDict方法。

2、使用add_module方法

3、使用OrderedDict方法

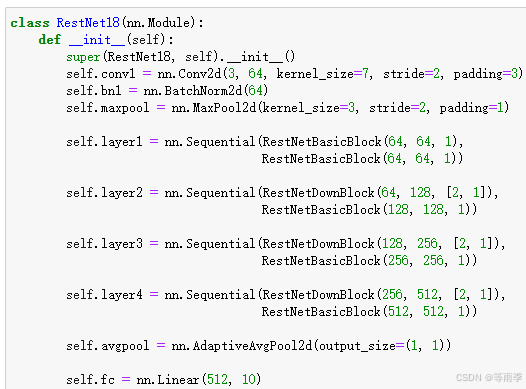

八、继承nn.Module基类并应用模型容器构建模型

1.使用nn.Sequential模型容器

2.使用nn.ModuleList模型容器

3.使用nn.ModuleDict模型容器

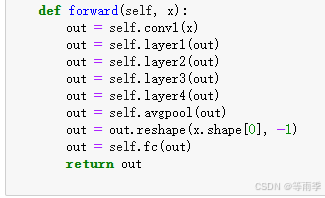

九、自定义网络模块

·残差块有两种,一种是正常的模块方式,将输入与输出相加,然后应用激活函数ReLU。

·另一种是为使输入与输出形状一致,需添加通过1×1卷积调整通道和分辨率。

·组合这两个模块得到现代经典RetNet18网络结构。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?