概述

提出主要是group convolution和DW convolution.

提出主要是group convolution和DW convolution.

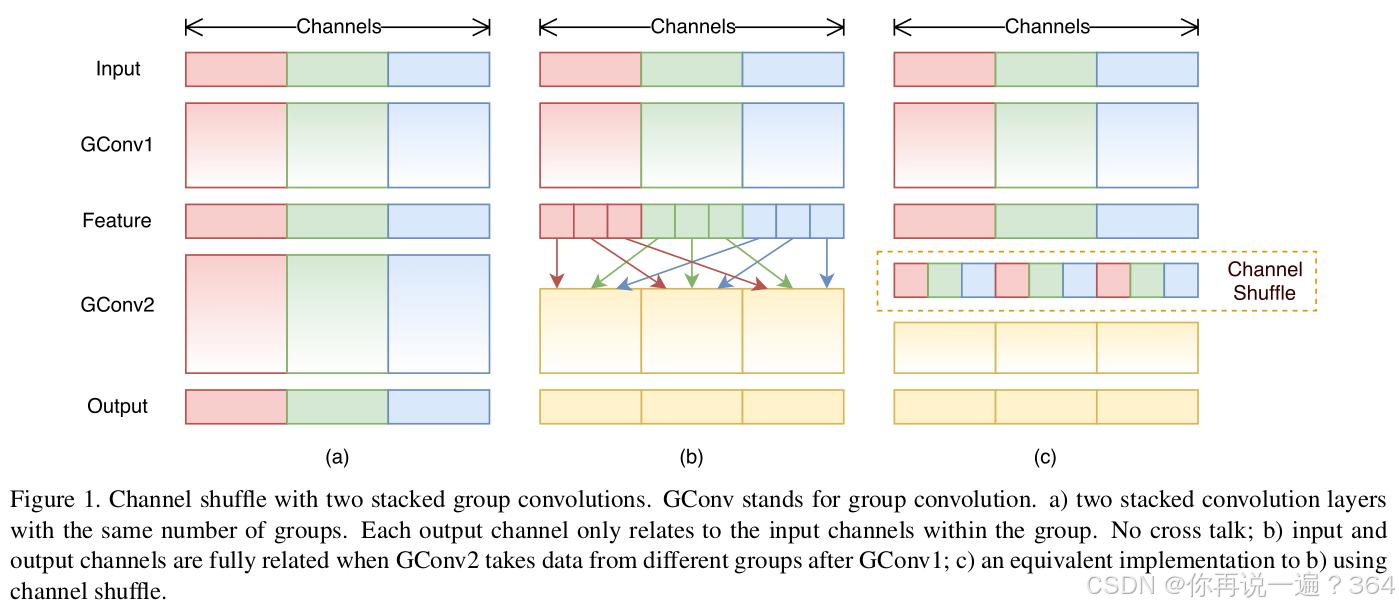

GConv虽然能够减少参数与计算量,但GConv中不同组之间信息没有交流。

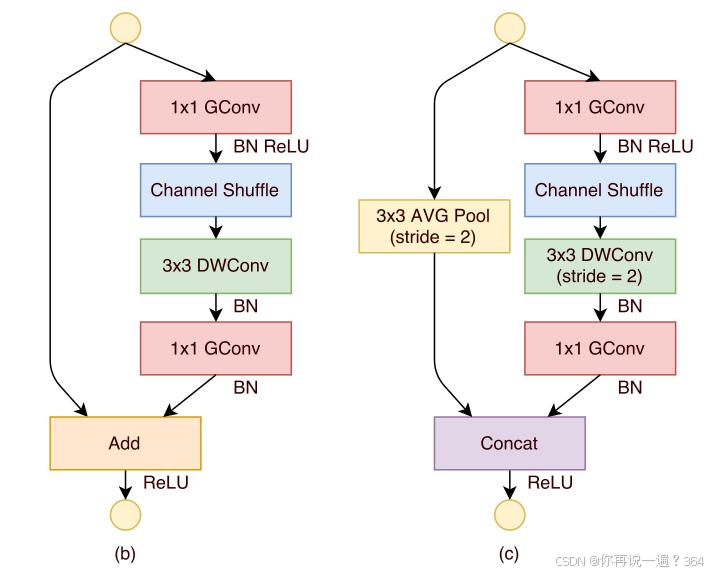

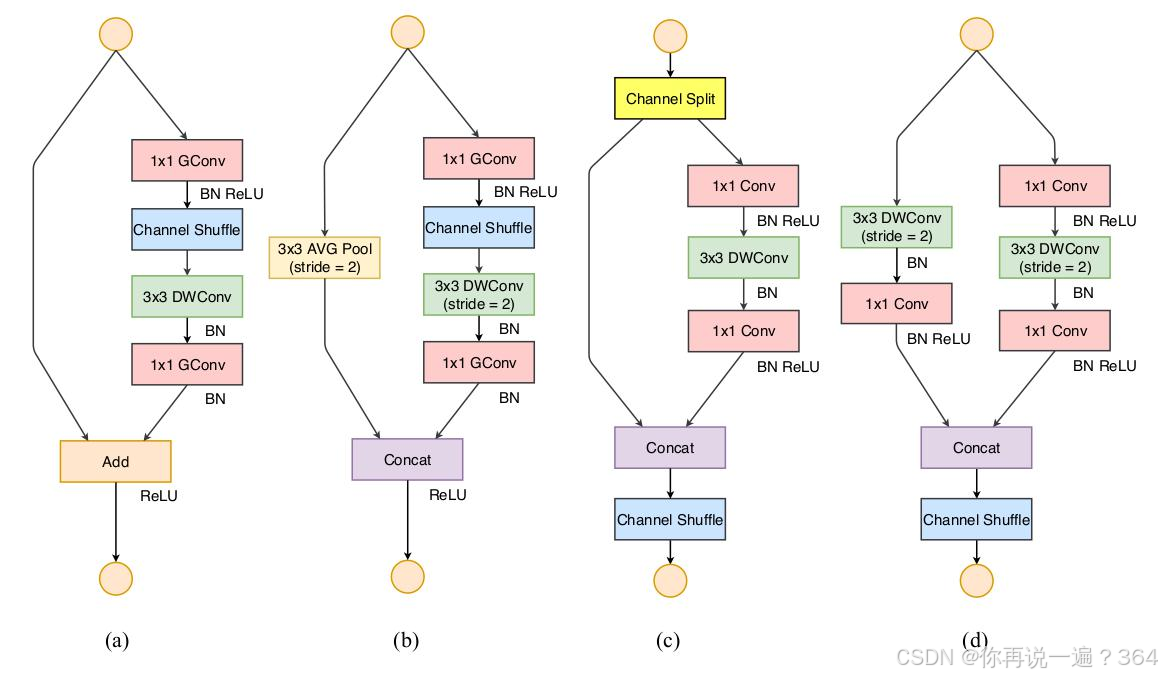

把Group分为三份,把每一份的第一份放在一起......这样得到Shufflenetv1卷积,这样就能融合不同group之间的应该权重信息了。

核心内容

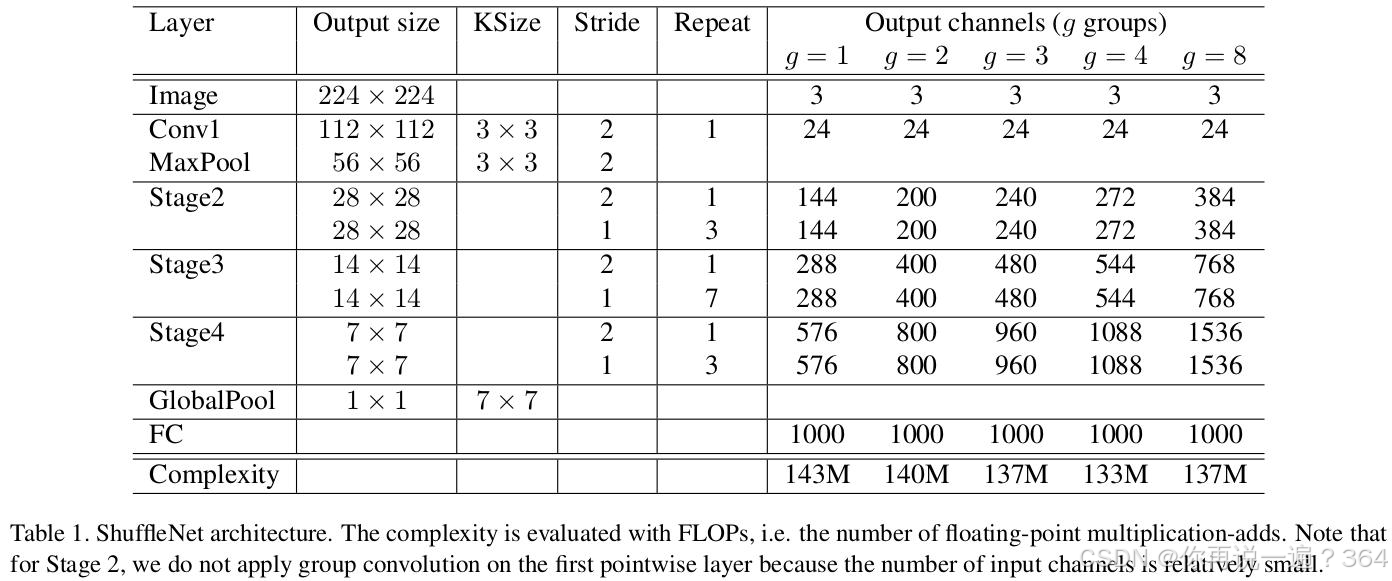

在第二stage,由于输入通道的数量相对较少,我们没有在第一层点阵层(1*1卷积层)上进行分组卷积。

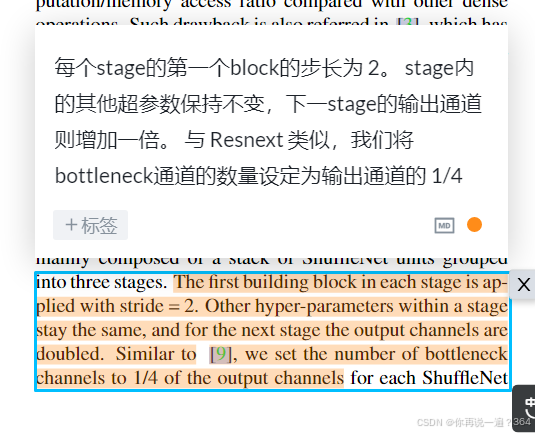

论文上一般是使用的都是g=3,首先通过应该3*3的卷积层,步距为2,重复次数为1,输出特征矩阵(卷积1)卷积核为24,然后经过最大池化3*3,步距为2,接着就是Stage2,Stage3,Stage4,(对于每个Stage就是将shuffle net当中的每个block进行一个堆叠,第一个block它的步距都为2图c)下一stage的输出通道则增加一倍。

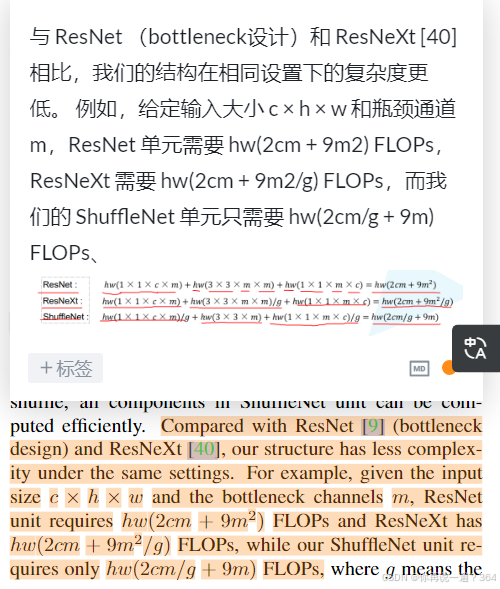

优势

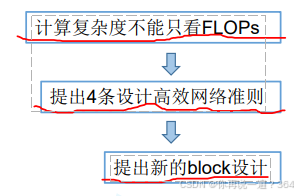

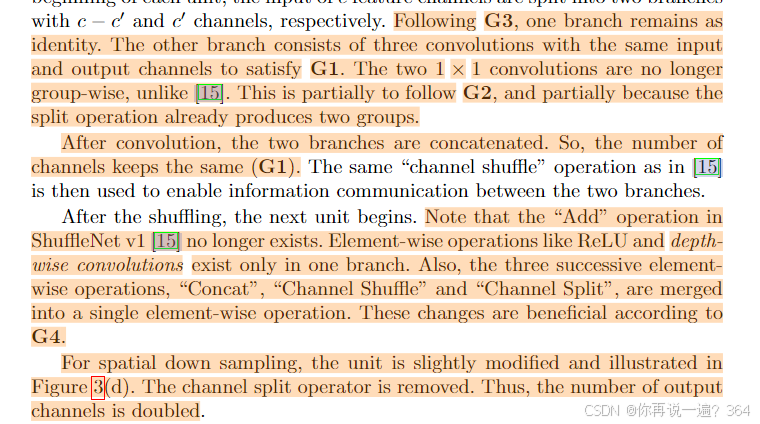

shuffle net v2

概述

作者提出:

4条设计高效网络准则

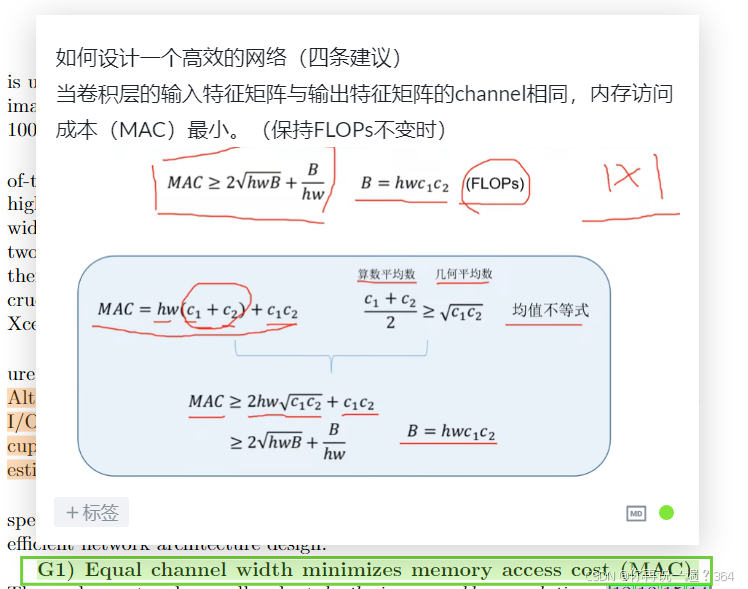

Several practical guidelines for efficient network architecture design

G1: Equal channel width minimizes memory access cost (MAC)

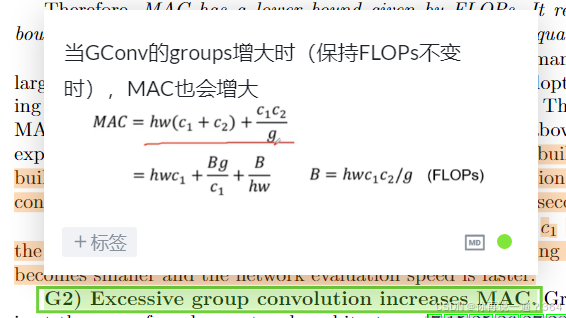

G2: Excessive group convolution increases MAC

G3: Network fragmentation reduces degree of parallelism

G4: Element-wise operations are non-negligible

上述翻译:

高效网络架构设计的若干实用指南

block:

FLOPS和FLOPs

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?