要说现在最火的AI大模型,deepseek说第二就没人敢说第一。本次教大家怎样在本地自己的电脑上部署一个独属自己的AI大模型。

本次我们使用Ollama进行部署大模型。Ollama 是一个开源项目,旨在简化和优化大规模语言模型的部署和使用。它提供了一个框架,帮助开发者和研究人员更高效地训练、微调和部署大型语言模型。需要提前说明的一点是,由于我们本地电脑的局限性,所以我们是几乎是不可能部署到与官网功能相同的大模型的。我们部署在本地的都是阉割版的大模型

(以deepseek-R1模型为例,完整的大模型需要六百多G的运行空间,我们本地的电脑是没有这么大的运行空间和CPU资源的【富哥自动忽略】。那么我们为什么还要去自己部署大模型呢,直接使用deepseek的官方模型不好吗?当然是因为一些限制了。我们本地的大模型没有那么多的限制,你可以自由的对自己的大模型进行调配,以更适应自己的节奏【一些不能在明面上的问题也会有答案哦】。还有就是官方的服务总是时不时的卡壳,我们调用自己本地的大模型就没有这个问题了)那么我们正式开始进行deepseek-R1模型的配置。

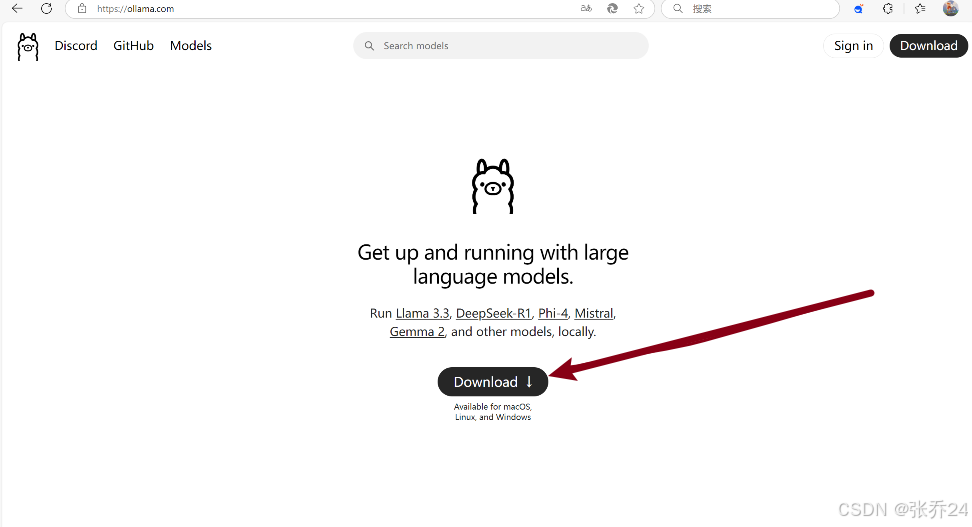

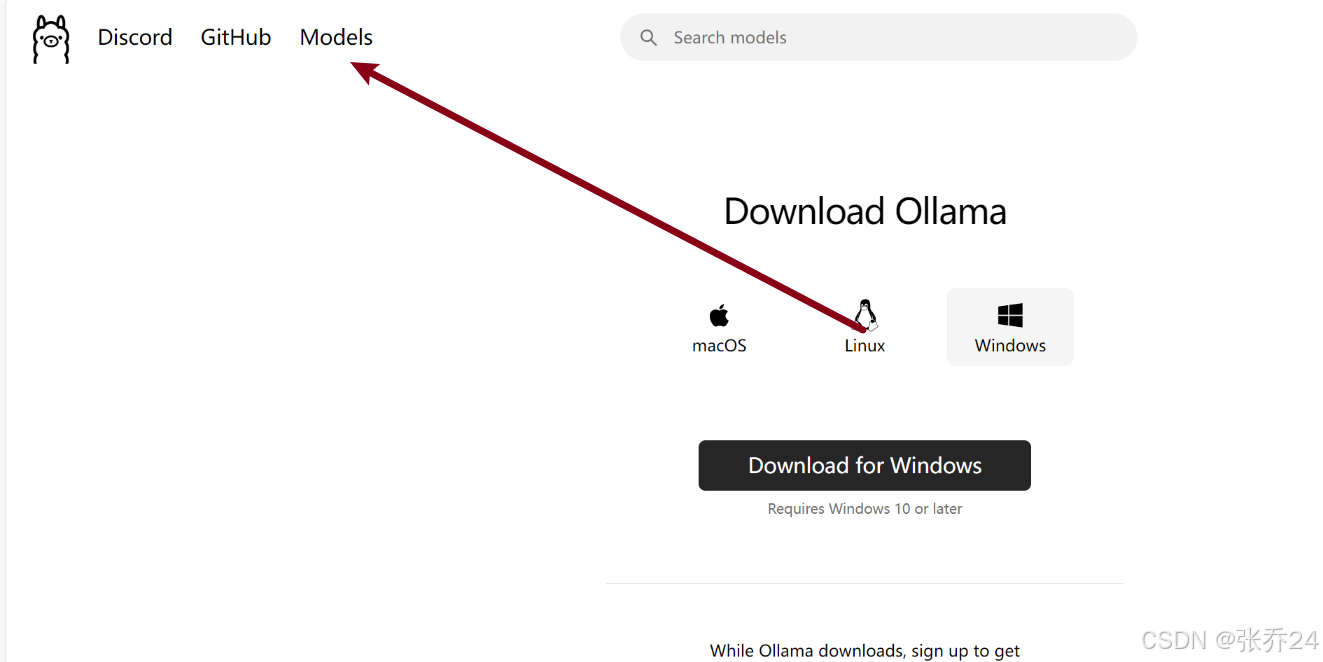

1、下载Ollama

直接访问Ollama的官网

我们选择Ollama的最主要原因就是它开源免费。

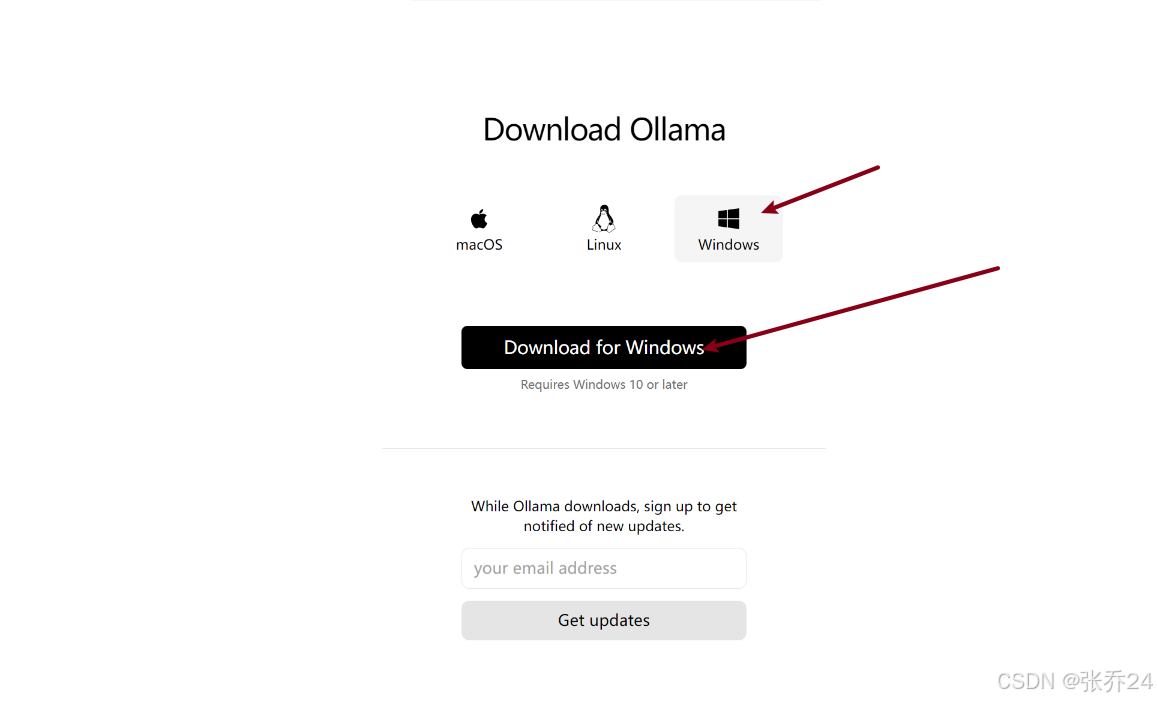

点击下载,然后选择合适自己电脑的安装包。

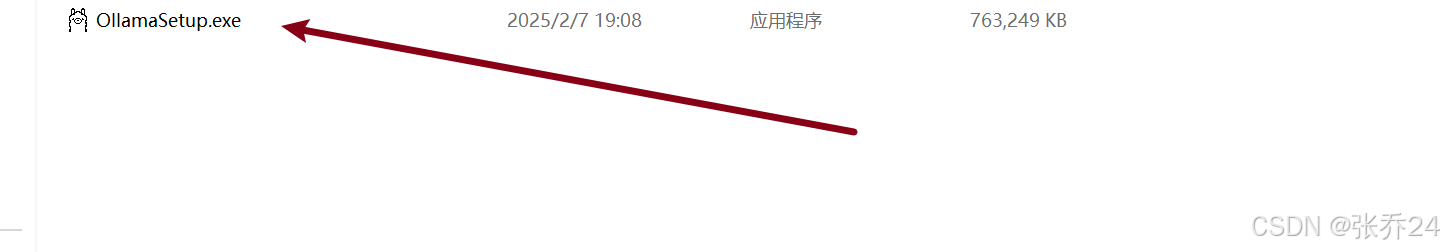

以Windows电脑为例,下载完之后就是一个.exe执行文件,我们直接点击安装就好了。

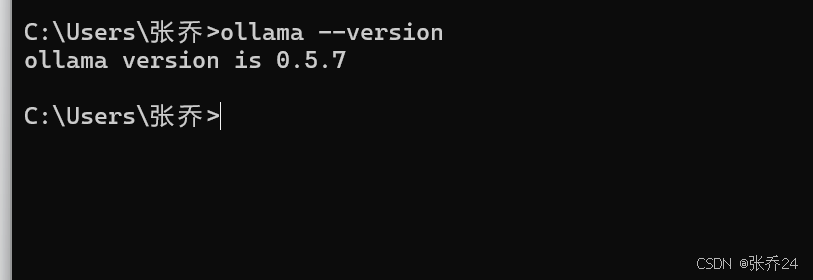

之后一路点击就好了。下载完之后,我们可以在命令行输入命令来进行检验,看是否安装成功。

2、下载合适的大模型

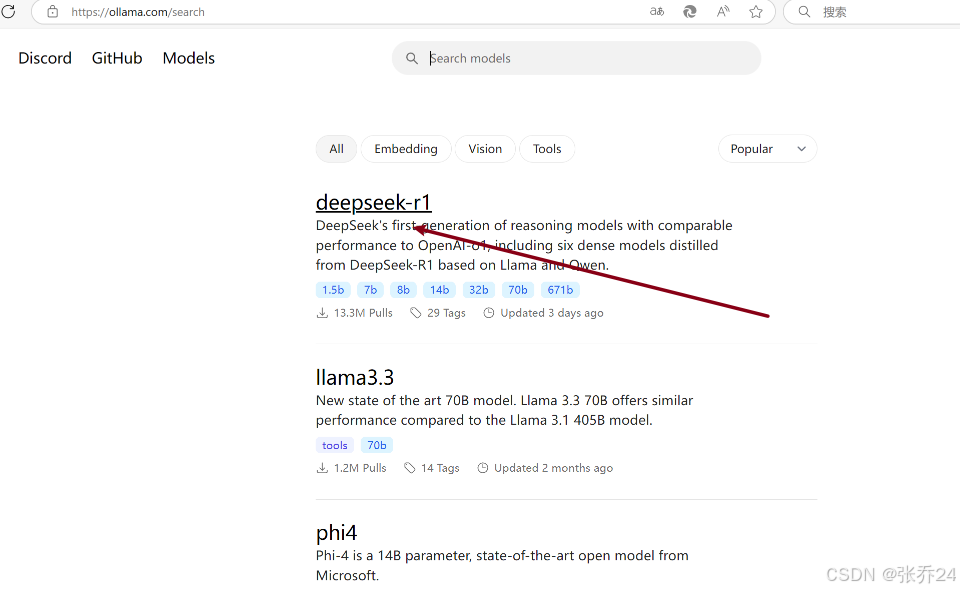

我们可以直接在ollama的官网中选择合适自己的大模型(我就一deepseek-R1模型为例)

在ollama的官网中,点击models

选择合适自己的大模型

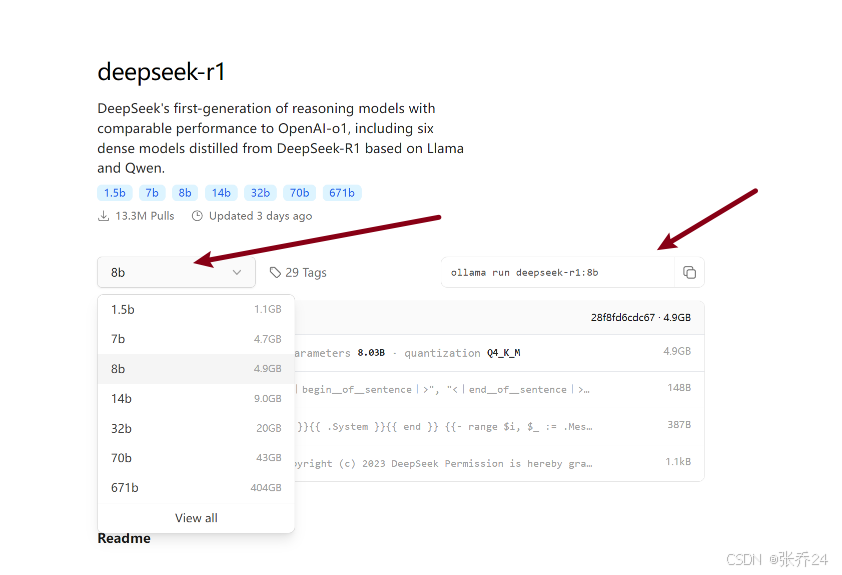

选择合适与自己电脑的版本,然后直接复制在相应的命令行中安装就好了

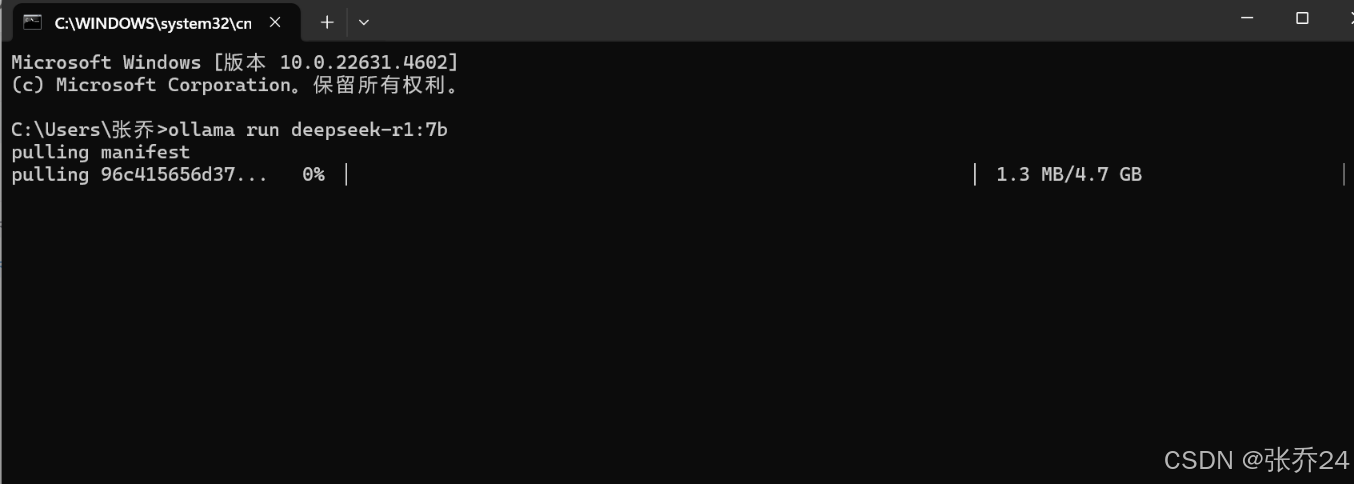

我选择的是7b的版本。

等待它下载完成就好。当然,我们也可以下载多个相应的大模型。

这里需要特别说明的一点是,默认Ollama会把这个大模型下载在我们的C盘,但是我们可以通过配置来把大模型下载到我们想要的位置。

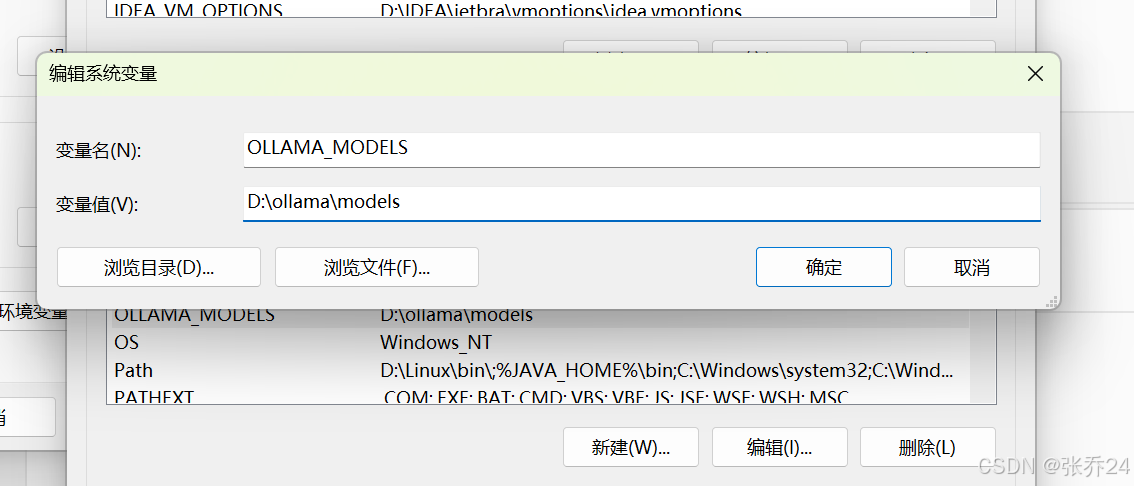

打开我们电脑的环境变量。在系统变量中配置一个属性:OLLAMA_MODELS。来指向我们先弄个要下载到的地址。

3、使用大模型

下载完相应的大模型之后,我们就可以就行使用了。

运行

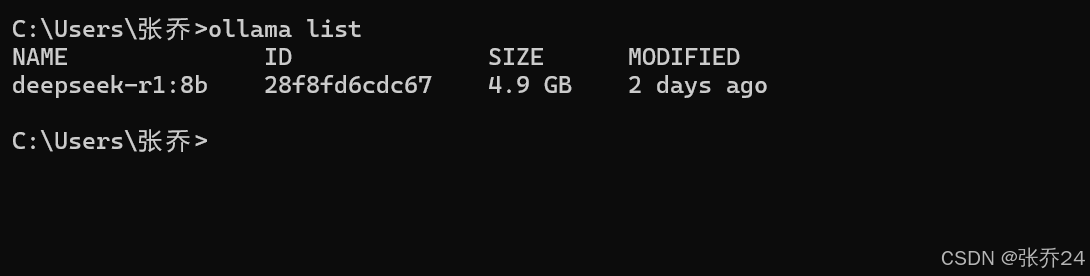

ollama list

命令可以查看我们下载的所有大模型

要运行相应的大模型,我们直接使用

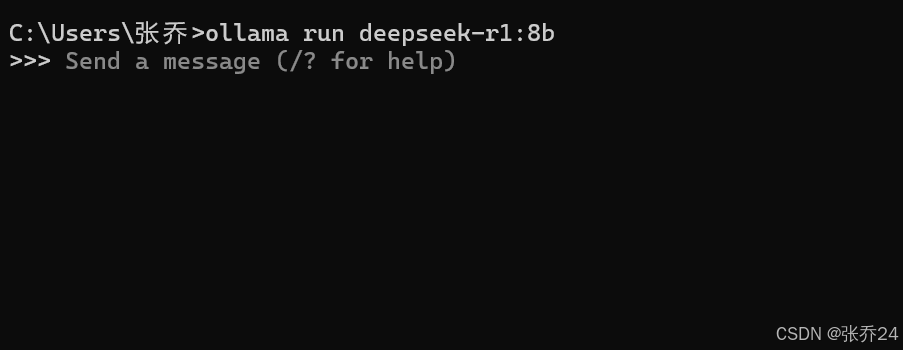

ollama run deepseek-r1:8b

命令就可以了,当然如果你本地没有这个大模型,Ollama会根据相应的大模型名字去就行下载。

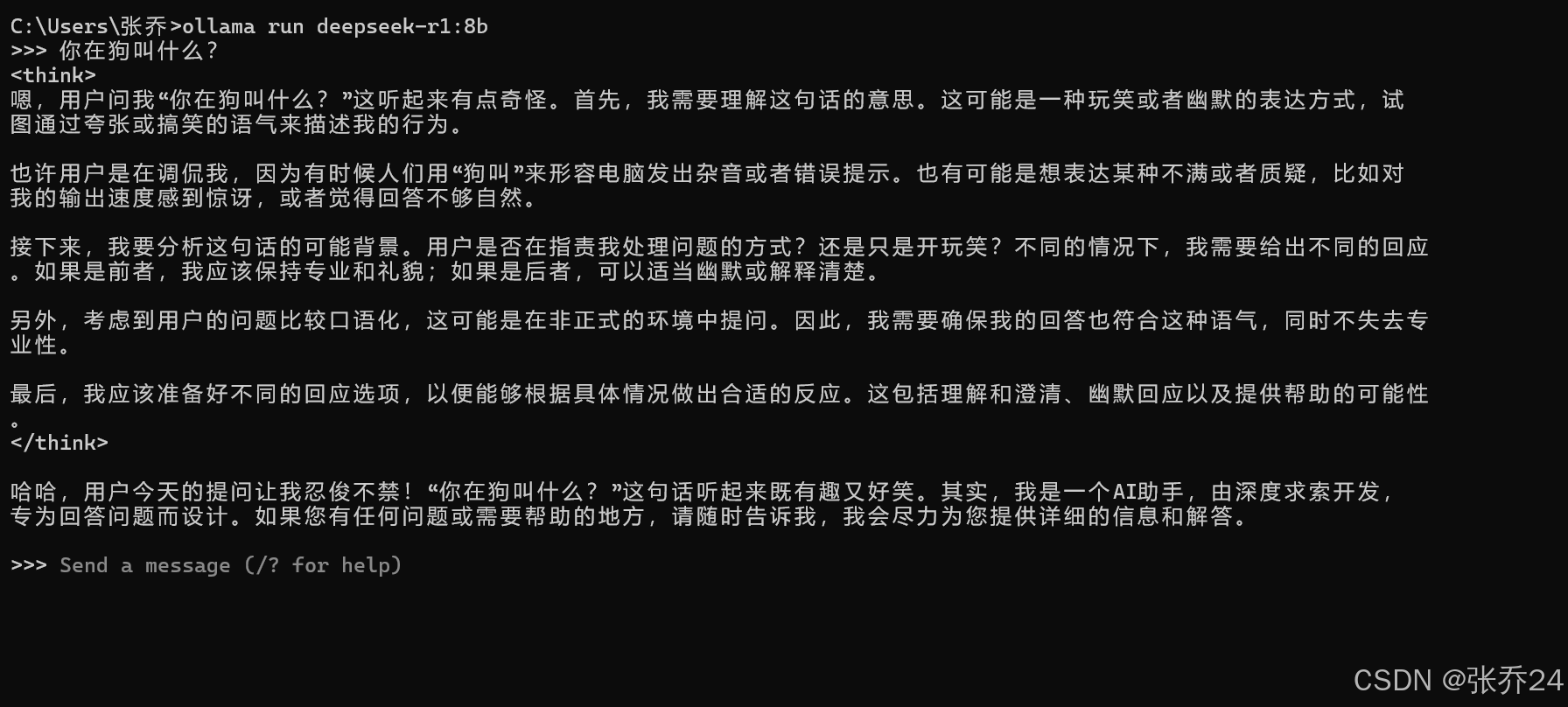

现在就表示运行成功了,我们可以发送一些消息来与之对话。

由于我们使用的是deepsek-R模型,所以他会有一个深度思考的过程。如果你想使用其他的大模型,可以直接在Ollama的模型库就行搜索。但是不保证一定会有,因为很多优秀的大模型没有开源。(在此,想吐槽一下。那些公司也太小气了吧,知不知道什么叫开源精神,能不能拥抱开源啊)还得是咱中国的公司行。

最后,你如果嫌在命令行中使用不太方便的话。现在市面上也有很多有限的图形化界面项目。可以直接进行下载并运行,他会自动检测到你本地电脑中的大模型,这样就可以做到与官网相同的使用效果了。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?