构建知识图谱是一个令人兴奋但充满挑战的任务,核心在于将非结构化的文本转化为结构化数据。

前排提示,文末有大模型AGI-优快云独家资料包哦!

这种方法已经存在了一段时间,但随着 LLM 的出现,这项技术开始进入主流应用领域。

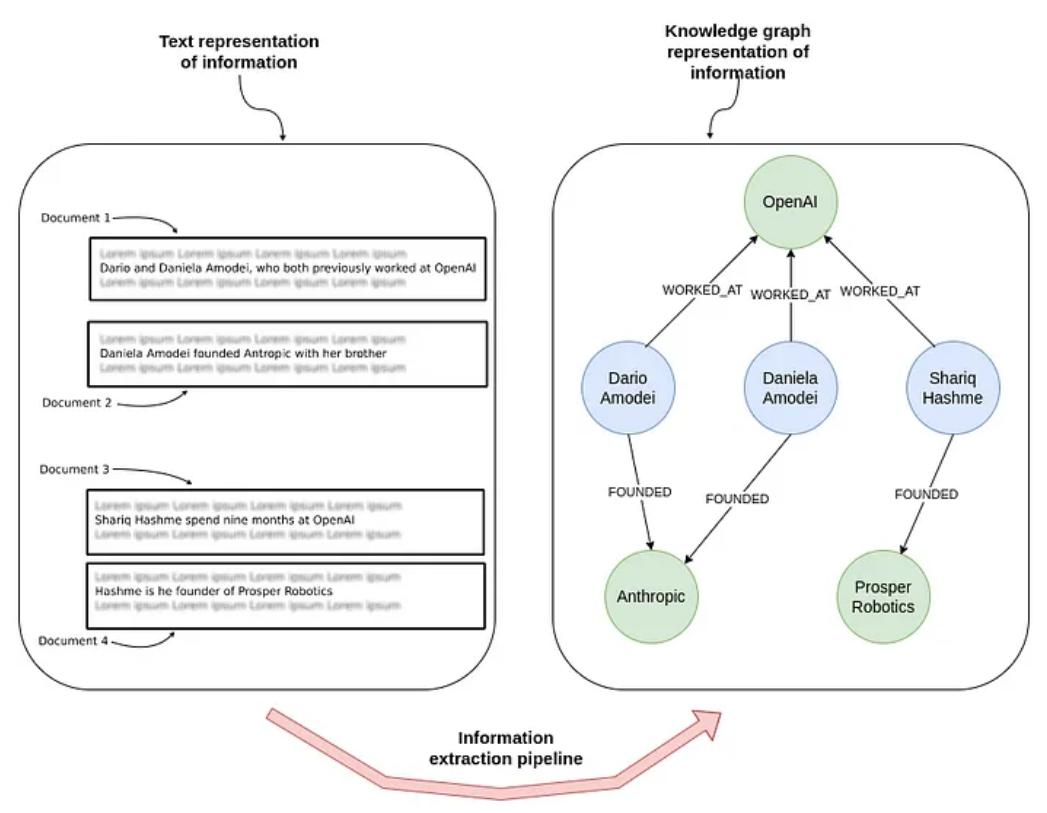

下图展示了将多篇文档中的文本信息(例如描述某人及其与公司的关系)转化为知识图谱。在左侧,我们看到的是原始的非结构化句子;而在右侧,这些信息被提取、组织,形成了实体和关系的可视化图谱,清晰地展现了“谁创立了什么公司”或“谁在哪些公司工作”等信息。

那么,为什么要将文本转化为结构化的知识图谱呢?

一个重要的应用场景是 RAG。虽然基于嵌入模型直接处理非结构化文本是一种有效的方法,但在回答复杂、多跳问题时会显得力不从心。例如:

-

需要理解多个实体间关系的问题。

-

需要进行过滤、排序、聚合等结构化操作的问题。

通过知识图谱,数据的组织变得更加高效,不仅可以支持更复杂的问题回答,还能显著提升准确性和适用性。

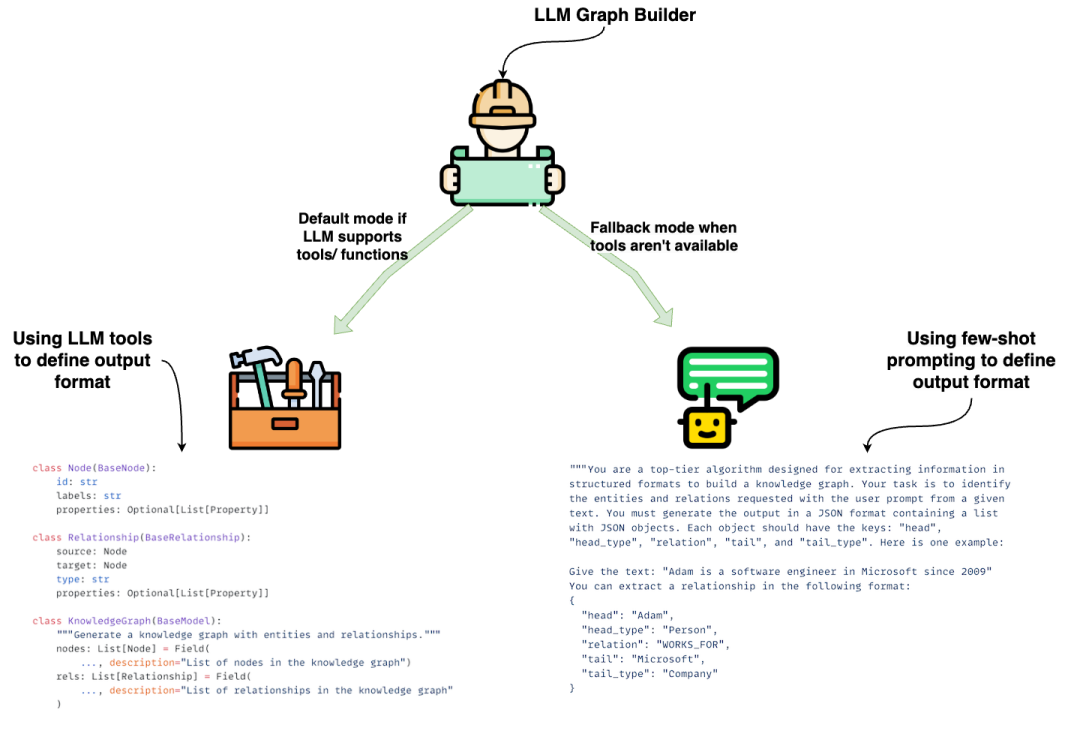

LLM Graph Transformer 旨在支持通过任意 LLM 构建知识图谱。面对当前多种模型和服务商的复杂生态,LangChain 通过标准化简化了这个过程,而 LLM Graph Transformer 则提供了强大的适应能力。

这个模块的核心特色在于它的“双模式设计”,可以根据场景需求选择不同的方式生成图谱,分别适应不同的操作逻辑。

- 基于工具的模式(默认模式)

-

适用场景:当 LLM 支持结构化输出或函数调用时。

-

实现方式:利用 LLM 的内置功能(如 with_structured_output),通过工具指定输出格式,将实体和关系提取为预定义的结构化数据。

-

优势:

-

输出结果一致性强,结构明确。

-

适合对精确性要求较高的任务。

- 基于提示的模式(备用模式)

-

适用场景:当 LLM 不支持工具或函数调用时。

-

实现方式:通过少样本提示(few-shot prompting),以自然语言指导 LLM 提取实体和关系。提取结果以文本形式输出,再通过自定义函数解析为 JSON 格式,用于生成节点和关系。

-

优势:

-

不依赖工具支持,适应性强。

-

适合探索性任务和初期实验。

这两种模式使 LLM Graph Transformer 能够适应不同的 LLM:

-

在工具支持的情况下,利用工具直接生成结构化数据。

-

在工具受限时,通过提示引导模型实现类似功能。

此外,即使在支持工具的模型中,也可以通过设置 ignore_tools_usage=True 强制启用基于提示的模式,以满足特定需求。

这种灵活性让 LLM Graph Transformer 能够高效适配多样化的 LLM,提供了统一且易用的知识图谱构建体验。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

8528

8528

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?