作者:毛烁

人形机器人的“下一公里”,是单点算力的竞赛,更是确定性的系统工程!

2025 年,“具身智能”持续从“展台”推向“实盘”。Figure AI推出了自研的 VLA 模型 Helix,让人形机器人具备了端到端的自主推理能力;特斯拉Optimus继续高频迭代,实测性能不断刷新;同时,中国的“新锐力量”Engine AI也在算法与硬件的深度整合上取得进一步突破....

01 黄仁勋的“礼物”:Jetson Thor让机器人稳健“步入”物理世界

如今,通用人形机器人产业离真正意义上的“iPhone 时刻”又近了一步。但是,与其他通用技术一样,越接近“通用化”的最后一公里,技术鸿沟反而愈发清晰。物理世界的非结构化场景、多模态任务深度耦合,以及推理与控制链路上的异构延迟,正在把传统算力架构逼向极限。

其实,对人形机器人而言,其商业化落地普及的关键技术问题并不仅仅在于“大模型”,更在于其“身处”多频域闭环中,能否“稳定”。

用一句从业者的戏谑:“走都走不稳,还谈什么商用呢?”

所以,人形机器人要在“稳定”这条路站得住脚,才谈得上落地应用。从背后的实现上看,在真实的物理世界中,人形机器人每一次机械步伐背后,其实都隐藏着一套完整的思维链闭环——感知、推理、规划、执行四个阶段:

在多模态感知(Perception)阶段,人形机器人的头部、胸部、腿部的多组摄像头、激光雷达、触觉传感器将不断生成海量异构数据,需要毫秒级融合,构建 360°的全息环境识别。

高阶推理(Reasoning)阶段,要有效处理模糊指令。例如人形机器人接到“拿一下桌上的红色苹果”这一指令,其就需要调用大模型来完成语义解析、视觉识别与路径规划。而这一过程往往是“慢思考”(System 2)过程,需要在数百毫秒至数秒内完成。

在实时规划(Planning)阶段,人形机器人理解指令后,其须以每20~50毫秒一次高频率生成运动轨迹,保证避障与抓取动作的连续与平稳。

而即时驱动(Actuation)阶段,则需要人形机器人的关节电机的伺服指令,以数百至上千赫兹下发,支撑行走、抓取等动态动作。

从“慢思考”到“快反应”(快思考,System 1),要想让人形机器人满足“稳定”的需求,就需要让四个阶段在同一算力架构上高效并行,实现毫秒级确定性,严格控制任何延迟和抖动。因为,一旦某一环节失衡,系统稳定性就会被拖垮,轻则动作迟缓、路径偏移,重则机器人直接“失能”。

但是,如果把大部分推理过程都迁移到云端,“云边通信”的延迟和不稳定链路所产生风险或将成倍放大。而且,如果在隧道、地下室等弱信号的现实场景中,人形机器人甚至将因通信问题彻底“瘫痪”。

所以,打造真正面向规模化商业“人形机器人大脑”,就需要在边缘侧实现从大模型推理的毫秒级控制和全链路中确定性的高性能算力支撑。

而就在行业对“边缘确定性”探索陷入瓶颈的当口,NVIDIA创始人、CEO黄仁勋在一份礼物的贺卡上,留下一句话——“致机器人:好好享受你的新大脑吧!”

于是,8月25 日,NVIDIA Jetson AGX Thor(以下称Jetson Thor)开发者套件和量产级模组,正式发布,开发者套件售价为3,499美元。作为专为物理AI和人形机器人打造的“全栈大脑”,Jetson Thor正通过底层架构的演进,解决推理与控制的全链路问题,让“慢思考”与“快反应”协同并行工作,打造出具身智能效率与稳定性的“更优解”。

截取自NVIDIA官方微博

黄仁勋表示:“Jetson Thor 专为全球数百万开发者打造,助力他们构建可与物理世界交互、甚至改变物理世界的机器人系统。它具备无与伦比的性能与能效,还能够在边缘设备上同时运行多个生成式AI模型。作为一款卓越的超级计算机,Jetson Thor 正致力于推动物理 AI 与通用机器人时代真正到来。”

截取自NVIDIA官方微博

02 “雷神”加冕:Jetson Thor塑造人形机器人“思想副本”

Jetson Thor的命名,源自“雷神索尔”,其性能也确实是“雷霆万钧”。相较于上一代广受好评的Jetson AGX Orin,Jetson Tho在边缘AI算力上实现了“跨代”的跃升。

根据NVIDIA官网数据显示,Jetson Thor系列模组可提供高达2070 TFLOPS(FP4)的AI 计算性能,配备最高128 GB显存,功率可在40W~130W之间灵活配置。这一性能意味着,Jetson Thor的AI计算能力比 AGX Orin 提升了7.5 倍,能效提升至3.5 倍,在处理生成式 AI及大型Transformer模型时,拥有了显著的实时处理优势。

这样的性能飞跃,进一步扩展了人形机器人系统在复杂环境下的自主决策和多模态感知能力,使边缘AI从“辅助工具”跃升为真正的“智能大脑”。

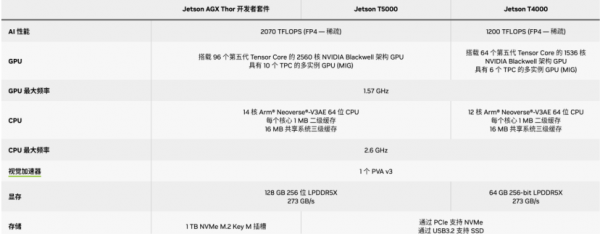

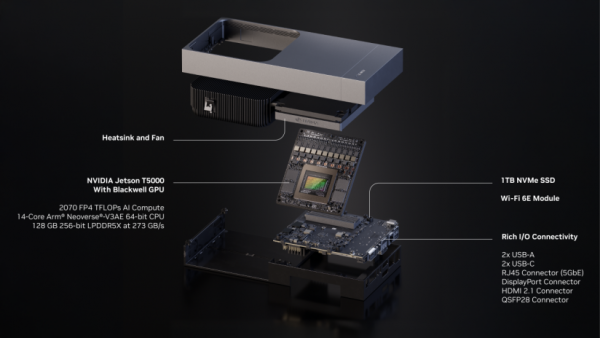

Jetson Thor(开发者套件)提供Jetson T5000(旗舰级)和Jetson T4000(高阶性能)两款核心模块。

截取自NVIDIA官网

T5000模块集成了拥有2560个CUDA核心和96个第五代Tensor Core,可提供高达2070 TFLOPS的AI算力,并与强大的14核Arm Neoverse-V3AE CPU协同工作。

截取自NVIDIA官网

如此强大的计算引擎,使其能够轻松在边缘侧原生运行多模态的(VLA)基础模型,为人形机器人赋予前所未有的自主推理与交互能力。

更关键的是,其多实例GPU(MIG)技术可划分多达10个独立的硬件分区,这意味着T5000不仅能承载最复杂的AI“慢思考”任务,还能同时为多个毫秒级的运动控制“快反应”任务提供硬件级的确定性保障,是构建真正通用、稳定的人形机器人和L5级自动驾驶系统的理想计算核心。

而Jetson T4000模块则为高性能机器人市场提供另一个极具吸引力的选择,其在确保适配下一代AI能力的同时,实现了性能、功耗与成本的精妙平衡。

T4000搭载了1536个CUDA核心、64个第五代Tensor Core,以及一颗12核Arm Neoverse-V3AE CPU,可提供超过1200 TFLOPS(FP4)的AI算力。这一性能足以驱动复杂的感知、融合与规划算法,适用于先进的自主移动机器人(AMR)、无人机编队和智能制造系统。

无论是选择T5000还是T4000,开发者都将受益于Jetson Thor平台共享的核心优势——1.57 GHz的GPU最大频率、128GB LPDDR5X统一高速内存、专用硬件加速器集群(PVA、光流、编解码引擎)、为机器人设计的丰富I/O接口,以及完整的NVIDIA Isaac软件栈和生态系统支持。

这种统一性极大地降低了开发门槛,使得开发者可以在同一个平台上验证算法,而后根据最终产品的市场定位灵活选择计算核心,无缝地将人形机器人创新应用,从实验室推向市场。

目前,AgiBot、Engine AI、Galbot、优必选(UBTECH)、联影智能(United Imaging)、宇树科技(Unitree)、万集科技(Vanjee),等企业已经采用了Jetson Thor,行业覆盖服务机器人、工业自动化、医疗健康和智慧城市等多个细分领域。

03 三台计算机“协奏”:落点AGX支撑通用机器人和自动驾驶

“实现物理AI,需要三台计算机——DGX、AGX、Omniverse+Cosmos”这是NVIDIA不断强调的定位和观点。其中,Jetson Thor便承担了AGX(边缘部署平台)“端侧执行”的核心角色。

通过三者协同,开发者能够将机器人开发的全流程——数据采集、算法训练、模型验证和落地部署,形成高效闭环。

在“三台计算机”的配合下,NVIDIA DGX 平台作为机器人的“训练中心”,支持大模型训练、多模态数据融合以及复杂环境下的推理,为机器人在现实场景中处理高维数据、执行复杂任务提供计算基础,其负责将海量数据转化为可执行的智能算法。

NVIDIA Omniverse则是机器人的“实验场”。由于真实环境测试成本高、风险大,利用Omniverse可提供虚拟环境,使开发者能够生成海量合成数据,并进行数百万公里级的虚拟测试,从而确保算法在部署前的稳定性与可靠性。

NVIDIA Jetson Thor便是归属AGX落地的机器人“大脑”。Jetson Thor可将经过DGX的训练、Omniverse的验证后的模型落地,实现从算法到执行的闭环。

“三台计算机”依托统一的CUDA架构和AI软件栈,形成了从云到边缘的无缝闭环,构建出强大的生态护城河。自 2014 年推出以来,截至目前,已有超过200万开发者使用NVIDIA的机器人技术栈。

在NVIDIA面向通用机器人推出Jetson Thor的同时,还宣布面向自动驾驶的DRIVE AGX Thor已经开放预订,预计 9 月开始发货。

这一发布的节点,也契合了一个业界共识——汽车是机器人的母形态,是四个轮子的机器人。机器人与自动驾驶汽车在技术本质上都是移动智能体,都依赖高性能的环境感知、高阶决策和实时控制能力。

所以,DRIVE AGX Thor与Jetson Thor基于相同底层硬件技术,但在软件和认证标准上有所区分。

Jetson AGX Thor主要面向通用机器人、工业自动化、医疗健康及智慧城市等场景,强调开发灵活性和生态开放性,支持多种算法和模型落地。

而DRIVE AGX Thor则面向自动驾驶汽车,其硬件通过车规级认证,并搭载经过功能安全认证的DriveOS操作系统,符合汽车行业严格的准入标准。

这种“同芯异构”的策略,充分展现了NVIDIA在平台复用上的深厚功力。通过统一底层架构,NVIDIA不仅实现了研发成本分摊,还促进了技术互通,进一步巩固了其在机器人和自动驾驶两大万亿级市场的领先地位。更提供了将机器人与“智能移动体”的开发从实验室概念推向可规模化落地的现实路径。

写在最后

Jetson Thor 的发布,是一次体系化能力的兑现,其将人形机器人所需的算力、延迟控制、生态适配和规模化生产力,第一次放进了可被行业且能快速“消化”的平台。这意味着,长期停留在实验室阶段的“技术孤岛”正在被打通。

从技术战略上看,NVIDIA 正把“通用计算”推向“通用智能体”。三台计算机形成的“飞轮”,将在统一架构下,让更多生态伙伴共享技术红利。这种模式的力量在于:一旦底层确定性能力稳定攀升,行业创新就可以从算力焦虑转向场景创新,从“能跑”转向“跑得稳、跑得好”。在通用机器人、自动驾驶、智慧医疗、工业自动化等万亿级市场中,NVIDIA 正在成为“底层秩序的制定者”。

反观Jetson Thor的发布,也是对“确定性智能”的一次宣言。人形机器人的真正商业化,不仅在于其是否能回答更复杂的问题,更在是否能在现实世界的不确定中,持续、可靠地执行。

或许,这正是“物理 AI”时代的命题,当智能被精确地“钉”在每一毫秒的感知、推理、规划与执行之中,技术的意义就从“可能性”,转化“必然性”。而Jetson Thor,正在打造一种更优的确定性落地方式。

2135

2135

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?