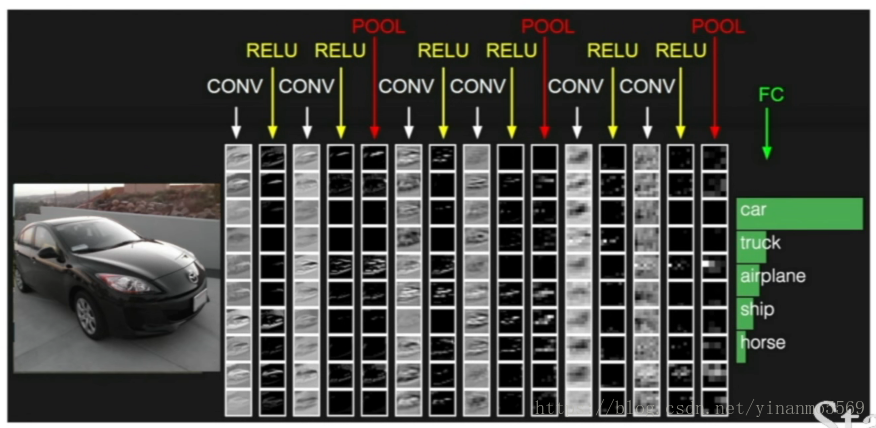

CNN通常用来进行图像处理,经历一系列卷积层,非线性层,池化层和完全连接层,最终得到输出,输出通常是一个单独分类或者一组分类的概率.

Fully Connected Layer & Convolution Layer & Pooling Layer & Rectified Linear Unit

卷积层与全连接层的主要区别是卷积层保留了基本的空间结构(Spatial Structure)

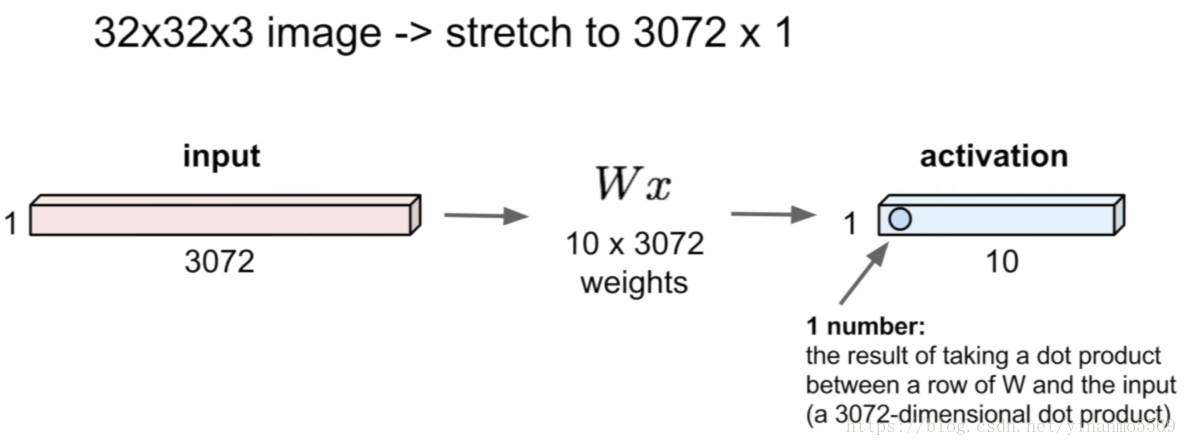

全连接层(FC Layer)

Fully Connected

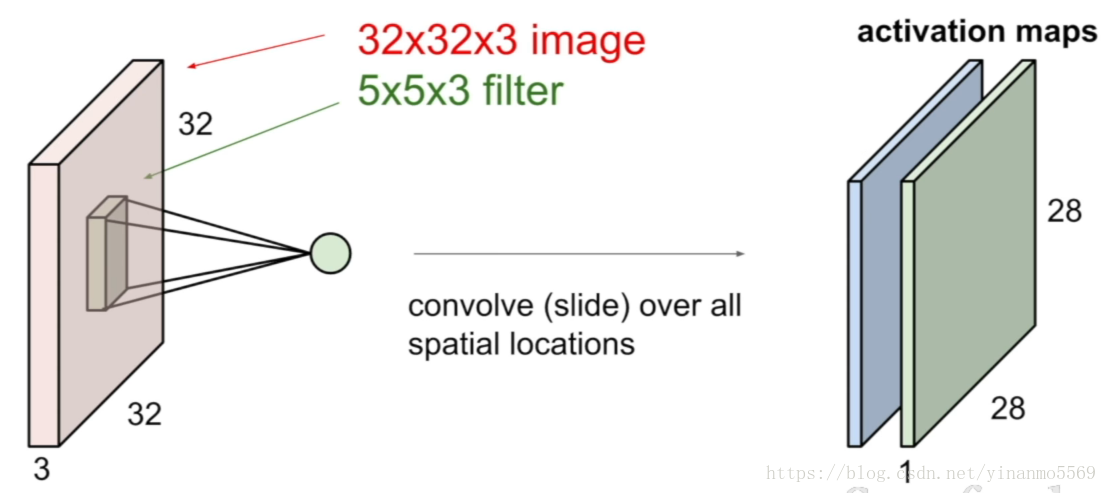

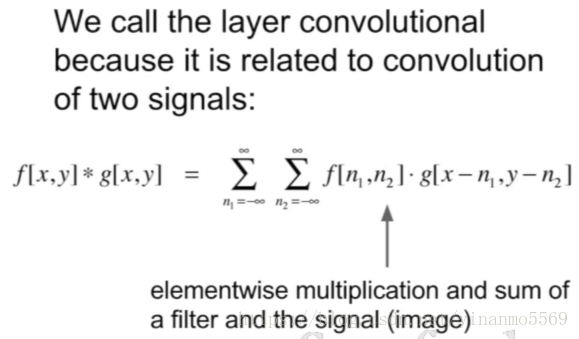

卷积层(Conv)

Conv通过filter输出一个激活映射(activation map) Conv经历相较全连接来说主要有以下几个特点:

- 局部连接

- 保留空间结构

- 参数共享 (filter)

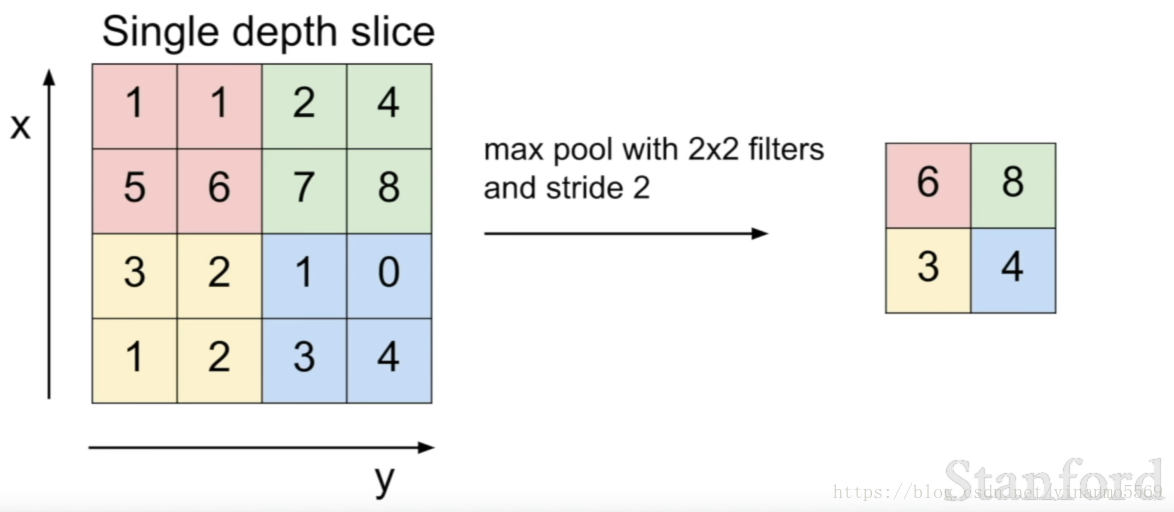

池化层(POOL)

同时也被叫做downsampling层.最受欢迎的就是最大池化层(max-pooling,如图).

1. 减小输入卷空间维度,也可以控制过拟合

2. 对于每个激活层进行单独处理

线性整流函数(ReLU)

在每个卷积层之后,通常会立即应用一个非线性层(或激活层)。其目的是给一个在卷积层中刚经过线性计算操作(只是数组元素依次(element wise)相乘与求和)的系统引入非线性特征。通常意义下,线性整流函数指代数学中的斜坡函数,即

f(x)=max(0,x)f(x)=max(0,x)

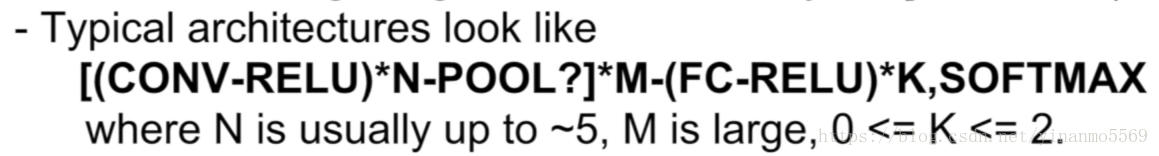

CNN Typical architectures

本文详细介绍了卷积神经网络(CNN)的基本架构,包括卷积层、池化层、全连接层等核心组件的功能与作用。解释了卷积层如何通过滤波器保留空间结构并进行参数共享,以及池化层如何降低维度防止过拟合。此外还讨论了ReLU作为非线性激活函数的作用。

本文详细介绍了卷积神经网络(CNN)的基本架构,包括卷积层、池化层、全连接层等核心组件的功能与作用。解释了卷积层如何通过滤波器保留空间结构并进行参数共享,以及池化层如何降低维度防止过拟合。此外还讨论了ReLU作为非线性激活函数的作用。

1100

1100

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?