Chatgpt很强大,开源的bloomz可以做些什么呢?效果如何?下面使用其70亿参数的模型测试一下效果。

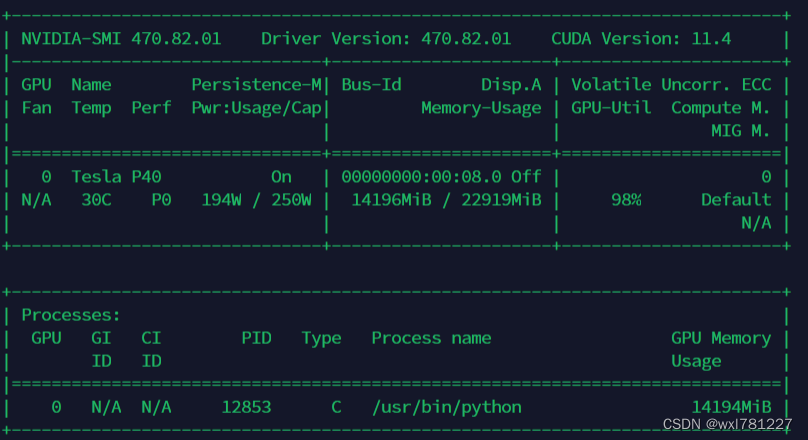

运行环境:腾讯云P40(24G),deepspeed,transformers

使用模型:bigscience/bloomz-7b1-mt,支持中文

推理时GPU占用:14G+

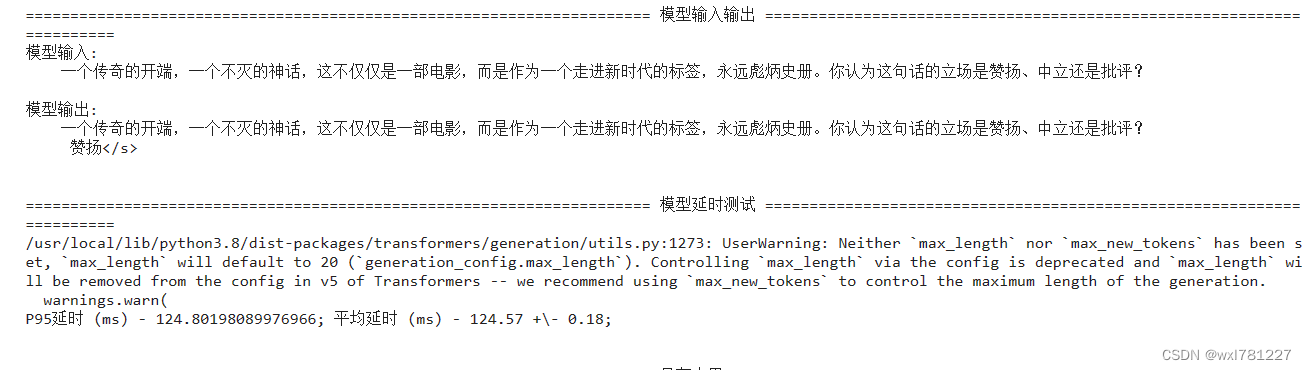

1.情感分类-结果是对的

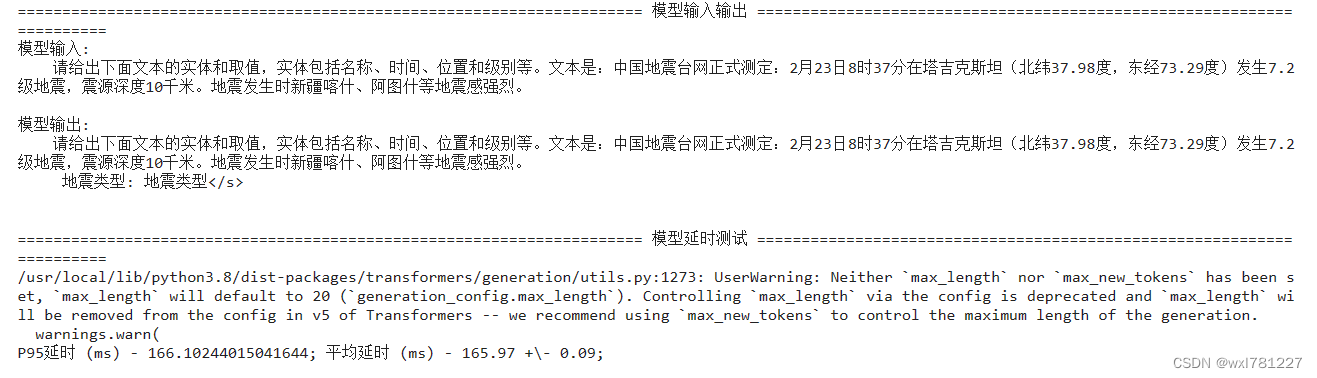

2.实体提取-结果不对

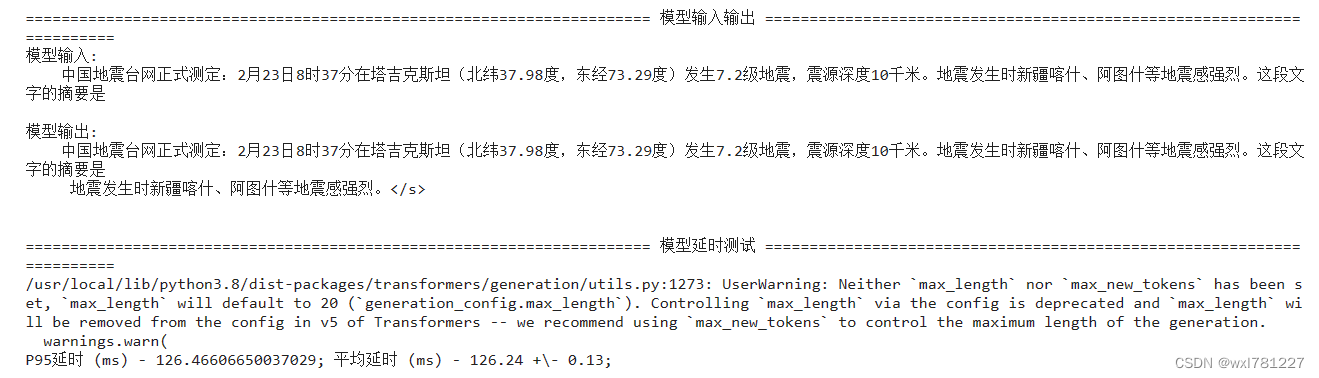

3.摘要-效果不佳

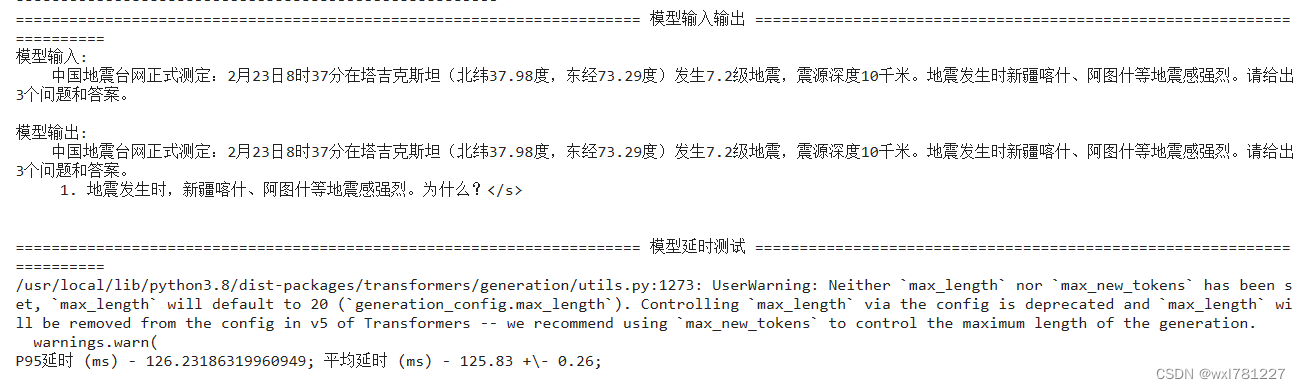

4.问答提取-效果不佳

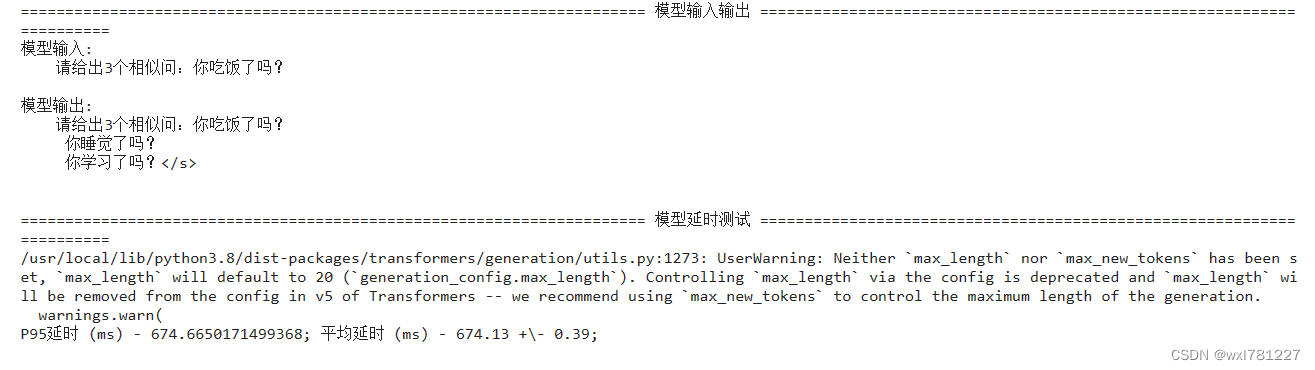

5.相似问-效果不佳

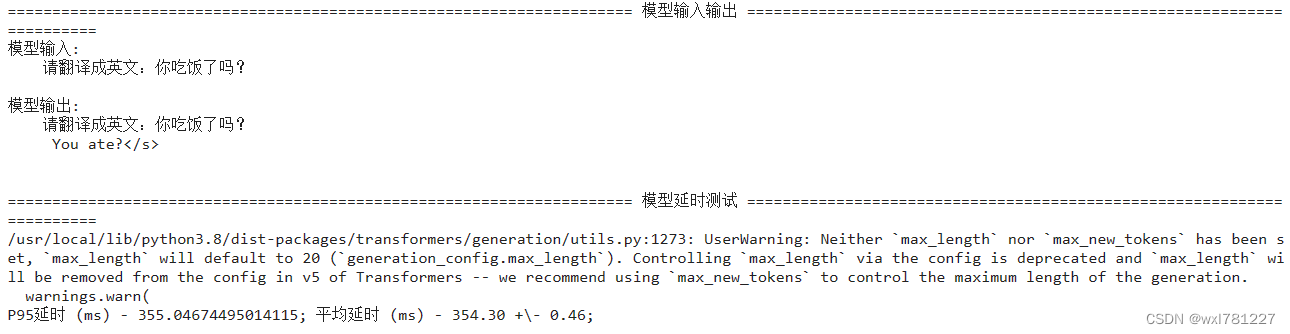

6.翻译-直译?

结论:优点是能同时支持多类任务,缺点是效果与chatgpt相差甚远,即便是gpt3与chatgpt也相差甚远。预训练大模型gpt-3+指令微调+人类对齐=chatgpt。

文章对开源项目Bloomz的70亿参数模型进行了测试,涉及情感分类、实体提取、摘要、问答和翻译等任务。尽管Bloomz能支持多类任务,但在效果上与ChatGPT和GPT-3有显著差距,尤其是在实体提取、问答和翻译方面。表明预训练大模型结合指令微调和人类对齐对于提升性能至关重要。

文章对开源项目Bloomz的70亿参数模型进行了测试,涉及情感分类、实体提取、摘要、问答和翻译等任务。尽管Bloomz能支持多类任务,但在效果上与ChatGPT和GPT-3有显著差距,尤其是在实体提取、问答和翻译方面。表明预训练大模型结合指令微调和人类对齐对于提升性能至关重要。

231

231

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?