目录

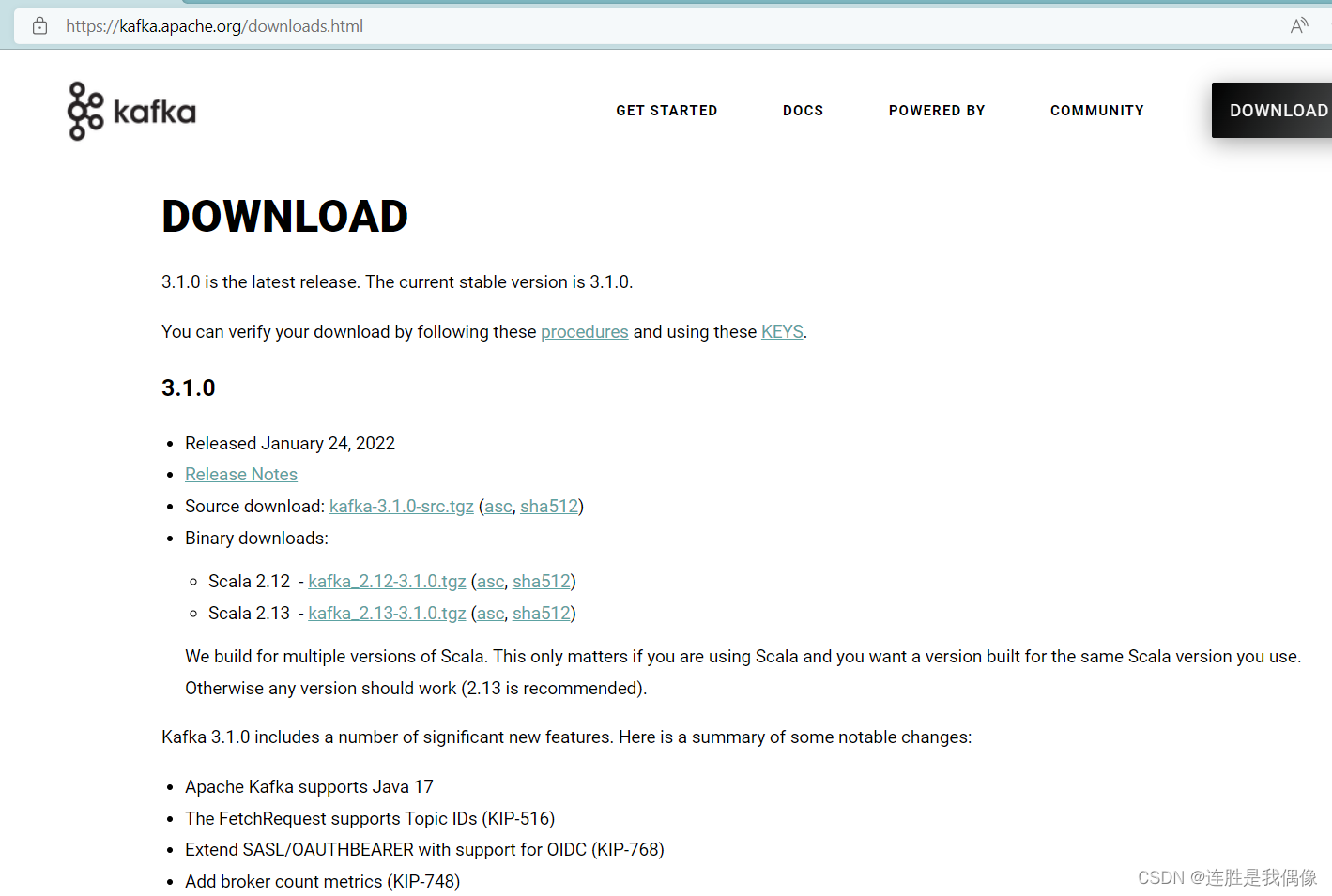

1. 下载 解压 安装 Kafka安装包

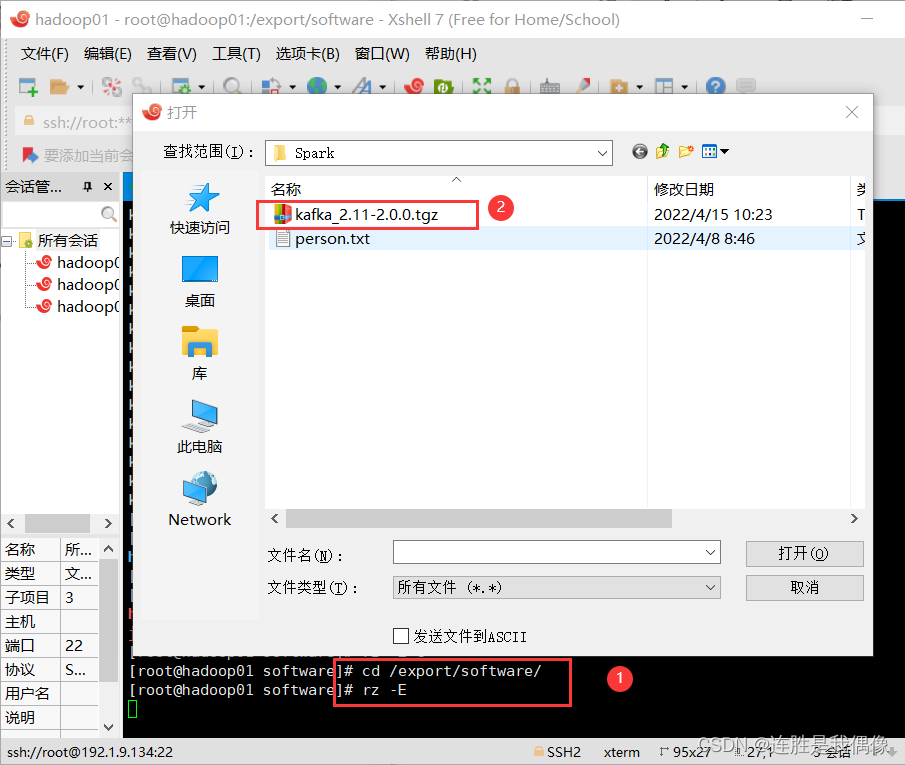

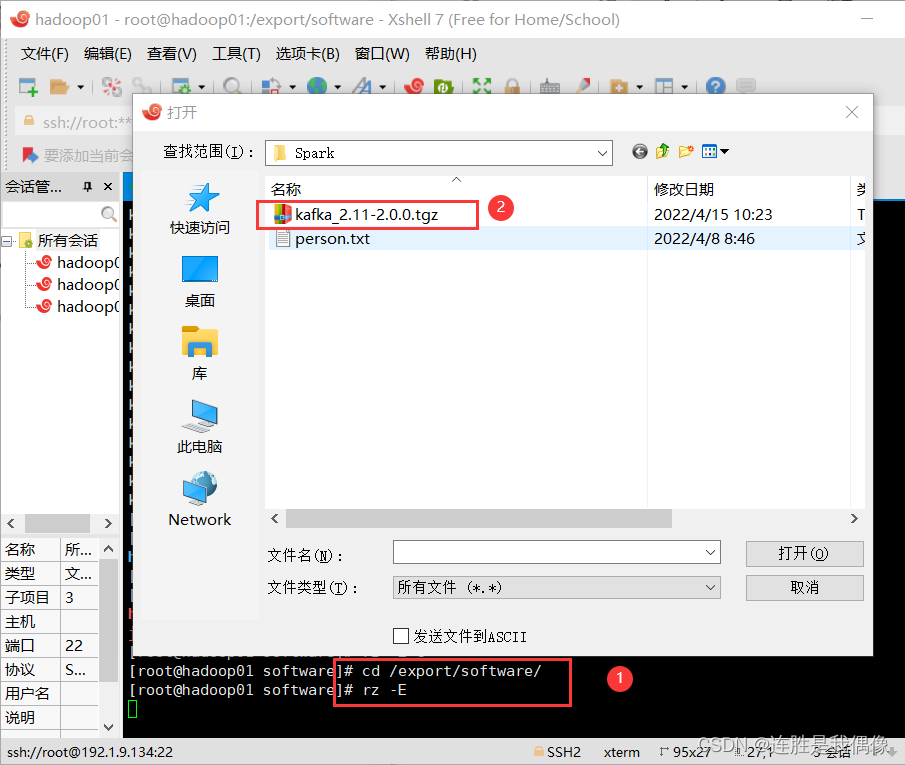

在hadoop01中

输入:cd /export/software/

输入:rz -E

选择Kafka安装包

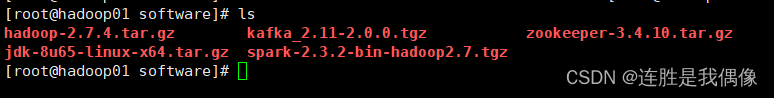

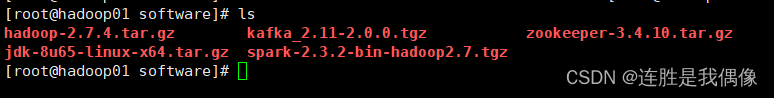

打开并上传,输入ls查看,第一行第二个是Kafka

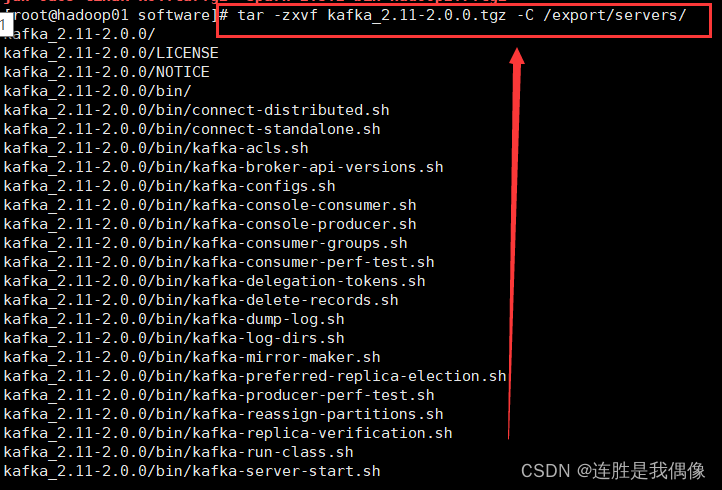

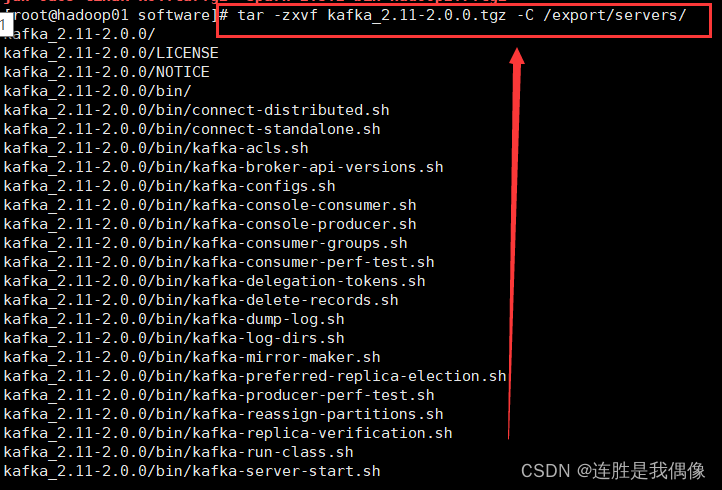

解压安装包到 /export/servers

输入:tar -zxvf kafka_2.11-2.0.0.tgz -C /export/servers/

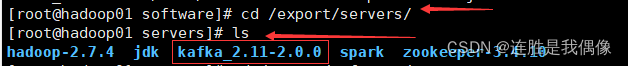

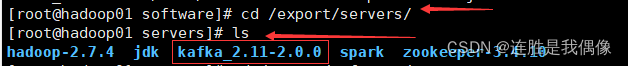

验证安装

输入:cd /export/servers/

输入:ls

2. 修改Kafka配置文件

输入:cd /

目录

在hadoop01中

输入:cd /export/software/

输入:rz -E

选择Kafka安装包

打开并上传,输入ls查看,第一行第二个是Kafka

解压安装包到 /export/servers

输入:tar -zxvf kafka_2.11-2.0.0.tgz -C /export/servers/

验证安装

输入:cd /export/servers/

输入:ls

输入:cd /

1103

1103

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?